如果你用过XPath,八成有过这种经历:右键点击页面元素,选择“复制XPath”,粘贴到代码里,然后祈祷它能一直工作。直到某天,页面布局微调,你的爬虫就瘫痪了。

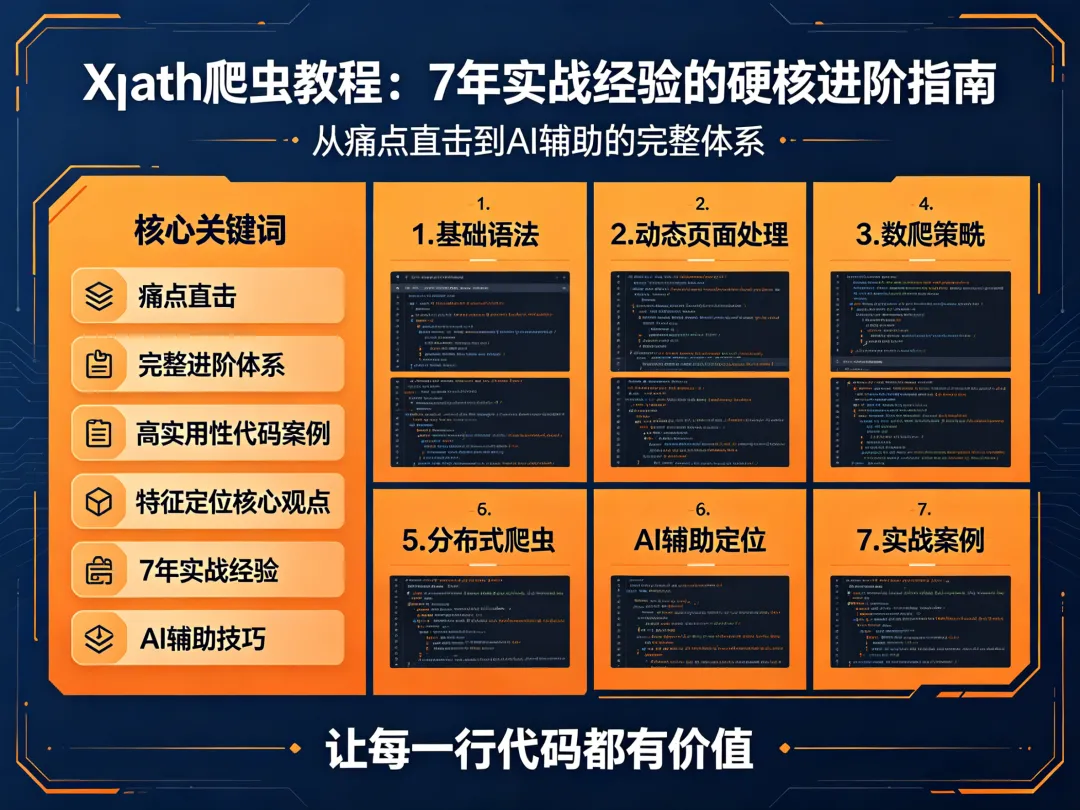

我在数据抓取这条路上摸爬滚打了七年,从最初的“复制粘贴党”到现在能游刃有余地处理各种复杂页面,中间踩过的坑数不清。今天就把这些经验掰开揉碎,给你一份真正实用的XPath进阶指南。

一、基础篇:别让默认路径骗了你

右键复制得到的XPath,大概率是这样的绝对路径:

/html/body/div[3]/div[2]/div[5]/div[1]/div[2]/table/tbody/tr[2]/td[3]看起来精确,实则脆弱。页面结构稍有变动,这个路径就失效了。我建议,从一开始就忘掉右键复制这个功能。

真正的起点应该是相对路径:

//table[@class='data-table']//tr[2]/td[3]这个简单的改变,让路径不再依赖从html开始的固定结构,而是寻找页面中具有特征的元素作为起点。

二、定位篇:如何找到“那一个”元素

1. 基本定位策略

按属性定位(最常用):

//input[@id='username']//div[@class='item product']//a[@href='/login']按文本定位:

//button[text()='提交']//span[contains(text(),'价格')]//h1[starts-with(text(),'第')]多重条件组合:

//input[@type='text'and@name='email']//li[contains(@class, 'active') and @data-id]2. 处理动态属性

现代网站常用动态生成的ID,比如id="user-5f8e3a2b"。处理技巧:

//div[starts-with(@id, 'product-')]//input[contains(@id, 'username')]//*[ends-with(@id, '-container')] // XPath 2.03. 精准匹配 vs 模糊匹配

该精确时要精确:

// 模糊匹配可能误伤//a[contains(text(),'登录')] // 可能匹配到"立即登录"、"登录中"等// 精确匹配更稳妥//a[normalize-space(text())='登录']normalize-space()能去除首尾空格,处理HTML格式不一致的问题。

三、高级技巧:轴的妙用

XPath的轴(axis)是最被低估的功能。掌握它们,定位精度能提升一个等级。

1. 常用轴操作

父子关系:

//div[@id='parent']/child::span // 直接子元素//div[@id='parent']/descendant::span // 所有后代元素兄弟关系:

//h2[text()='商品信息']/following-sibling::div[1] // 后面的第一个兄弟元素//div[@class='price']/preceding-sibling::div[1] // 前面的第一个兄弟元素父级查找:

//span[text()='特价']/ancestor::div[@class='product-card']//input[@name='email']/parent::form2. 实际案例

假设有这样的HTML结构:

<divclass="product-list"><divclass="item"data-id="1"><h3>商品A</h3><spanclass="price">¥100</span></div><divclass="item"data-id="2"><h3>商品B</h3><spanclass="price">¥200</span></div></div>任务:获取“商品B”的价格

新手做法:

(//span[@class='price'])[2]问题:如果商品A不显示,这个位置就错了

正确做法:

//h3[text()='商品B']/following-sibling::span[@class='price']或:

//div[@class='item'and ./h3[text()='商品B']]/span[@class='price']四、函数库:XPath的秘密武器

1. 字符串处理

// 提取特定部分substring(//span[@class='price']/text(), 2) // 从第二个字符开始,去掉"¥"// 处理数字//span[number(text()) > 100] // 价格大于100的// 替换translate(//div/text(), 'ABC', 'abc') // 大小写转换2. 位置逻辑

// 选择前3个(//li)[position() <= 3]// 选择最后一个(//li)[last()]// 偶数位置//li[position() mod 2 = 0]3. 布尔逻辑

// 多条件满足//div[@class and@id] // 既有class又有id// 条件判断//input[@required='true'or @aria-required='true']五、避坑指南:那些我踩过的雷

1. 动态内容的坑

// 避免:页面加载后才出现的元素//div[@id='lazy-content']/span // 可能为空// 应对:等待或检查可见性//div[@id='lazy-content']/span[normalize-space()!='']2. 伪元素的坑

CSS伪元素(::before, ::after)的内容XPath无法获取。如果数据在伪元素中,考虑其他方法。

3. 性能陷阱

// 避免:全局搜索导致性能低下//div//span//a// 优化:缩小搜索范围//div[@id='content']//a4. 编码问题

XPath对特殊字符敏感,需要转义:

//div[@id="quote'with'apostrophes"] // 错误//div[@id="quote'with'apostrophes"] // 正确六、实战:复杂页面的应对策略

场景1:表格数据提取

<table><tr><th>姓名</th><th>年龄</th><th>城市</th></tr><tr><td>张三</td><td>25</td><td>北京</td></tr><tr><td>李四</td><td>30</td><td>上海</td></tr></table>提取李四的年龄:

//tr[td[1]='李四']/td[2]// 或者更稳定//tr[./td[1][text()='李四']]/td[position()=2]场景2:嵌套结构的精准定位

<divclass="section"><divclass="header">第一部分</div><divclass="content">内容A</div></div><divclass="section"><divclass="header">第二部分</div><divclass="content">内容B</div></div>获取"第二部分"的内容:

//div[@class='header'][text()='第二部分']/following-sibling::div[@class='content']七、调试技巧:写在最后的小贴士

1. 浏览器控制台测试: $x("//div[@class='test']") // Chrome/Firefox2. 逐步构建:从简单开始,逐步添加条件,每次测试确认。 3. 多种选择器备用:同一个元素,准备2-3种不同的XPath策略,主策略失效时有备无患。 4. 关注特征,而非位置:元素在页面中的特征(文本、属性、关系)比它在DOM树中的位置更稳定。

从最初只会复制粘贴,到现在能针对复杂页面设计健壮的定位策略,我最大的体会是:好的XPath不是找到元素的路径,而是描述元素的特征。

它应该像这样:

"

我要找的是那个“提交按钮”(特征:是按钮,type=submit,文字是“提交”),而不是“第三个div下的第二个按钮”。

这种思维转变,让我的代码不再因为页面结构调整而崩溃。希望你也能从“复制粘贴”走向“精准定位”,写出经得起时间考验的XPath表达式。

最后的绝招

其实,我还有一个压箱底的技巧——让AI当我的XPath助手。

当我面对特别复杂的页面结构时,不再自己一点点琢磨,而是:

1. 复制网页的HTML代码片段 2. 告诉AI我要提取什么内容 3. 让AI帮我生成精准的XPath

比如,我会这样问AI:

"

这是网页代码:

<div class="product-list"> <div class="item" data-id="101"> <h3 class="title">商品A</h3> <div class="price-section"> <span class="current-price">¥299</span> <span class="old-price">¥399</span> </div> </div> <div class="item" data-id="102"> <h3 class="title">商品B</h3> <div class="price-section"> <span class="current-price">¥199</span> <del class="old-price">¥299</del> </div> </div></div>帮我写XPath:

1. 提取所有商品名称 2. 提取商品B的现价 3. 提取所有有原价的商品ID

AI不仅能给出答案,还会解释为什么这样写,有哪些替代方案,如何应对可能的页面变化。这让我在遇到复杂结构时,能快速得到多个可选方案,然后选择最健壮的那一个。

当然,我从不盲目使用AI生成的代码,而是把它当成一个学习伙伴——看它如何思考,如何组合条件,如何规避陷阱。这样几次下来,我自己写XPath的水平也在无形中提高了。

这大概就是成长的滋味——开始觉得简单的东西都变复杂了,后来才发现,是你看得更清楚了。而现在,我学会了借力。

夜雨聆风

夜雨聆风