周五晚上九点,你打开电脑,想问 AI 帮你理一下明天汇报的思路。

点开网页,弹出登录框。你想起来上次登录是三个月前,密码早忘了。点了"找回密码",邮件发过来,你又去邮箱翻。折腾五分钟,终于进去了。

结果发完问题,屏幕上转了三秒,弹出来一个框:免费次数已用完,开通 Plus 每月 20 美元。

那一刻你什么感觉?

就是不想用了。

在线 AI 三个过不去的坎

我用在线 AI 服务用了快两年,总结下来就三个字:等、怕、花。

1、等。 高峰期真的会卡。有一次我赶着写东西,它愣是转了快一分钟才回。那一分钟里我盯着进度圈,心里想的是"这东西到底在干什么"。

2、怕。 不是怕 AI,是怕"我的东西去了哪里"。我让它帮我改过一版还没公开的产品文档,后来心里一直有个疙瘩——那些内容会不会被拿去训练?下个月会不会在别人的对话里看到类似的表述?

3、花。免费版不是不能用,是用得憋屈。额度卡着、速度压着、偶尔还给你弹充值提示。用着不爽,但真要付费又觉得冤——本质上我就是在租一台服务器,按月交租,凭什么?

这三个问题,不是换一个 AI 就能解决的。这是在线服务的商业模式决定的。

所以我换了一个思路:不租了,买断。

把大模型装进自己电脑

这个想法不是今年才有的,但今年才变得真的可以做到。

原因是一个叫Ollama 的工具成熟了。它的逻辑很简单:把大语言模型变成一个本地应用,跑在你自己的电脑上,所有数据不联网,处理全在本地完成。

没有登录、没有额度、没有付费弹窗、没有数据上云。

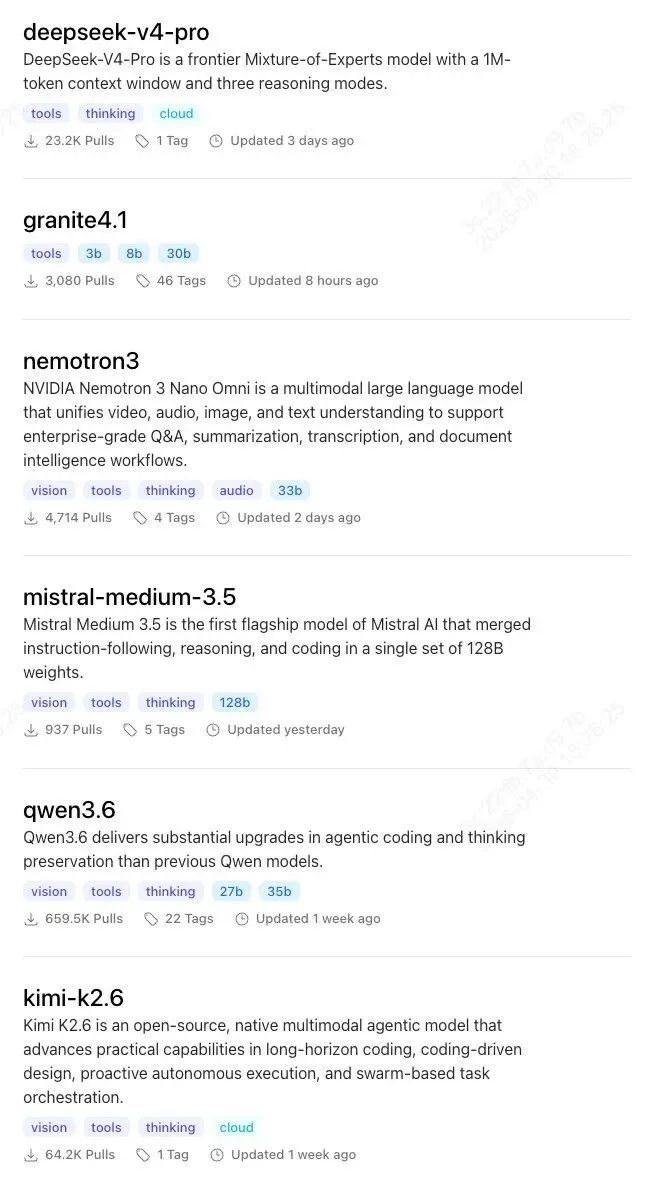

Ollama 支持的模型挺多的,Llama、DeepSeek、Kimi、GLM、Qwen、Mistral、Gemma——基本上你能叫出名字的开源大模型它都能跑。Mac、Windows、Linux 都能装。

GitHub 上 Star 数从去年到今年翻了好几倍,增长速度在开源 AI 工具里算很快的。这说明不是小众极客在用,是真的有人在生产环境里用。

我自己跑了一段时间,最直接的感受是:我的电脑现在可以随时回答我的问题,不需要打开任何网页,不需要等加载,不需要担心任何数据问题。

三步安装,Mac 和 Windows 都能跑

具体说说怎么装。真的不难。

第一步:下载安装包

打开 www.ollama.com,首页就有 Download 按钮,选你的系统,下载安装包,双击运行,全程下一步,没有捆绑软件。

装完之后不会有任何窗口弹出来——它运行在后台,是一个静默的服务。

第二步:在终端里拉模型

打开终端。Mac 用户是「终端.app」,Windows 用户是「PowerShell」或「命令提示符」。

输入这行命令:

ollama pull llama3这行命令的意思是从 Ollama 的模型库下载 llama3 模型。首次下载大概 4 到 5 个 G,取决于你的网速,喝杯咖啡的时间就差不多了。终端显示 success,说明模型已经在你电脑里了。

第三步:开始对话

在终端里输入:

ollama run llama3回车,等几秒,终端里会出现一个输入提示符,直接打字就行。

用简单的语言解释一下什么是大语言模型

它会直接在终端里回复你。没有界面、没有广告、没有加载动画,就是这么朴素。

说几个可能踩的坑:

第一,硬件门槛是真实存在的

Mac 用户建议 16GB 内存以上,跑起来比较顺。Windows 用户建议有独立显卡。8GB 内存的老机器能跑,但你会明显感觉到慢。如果你的电脑用了五年以上,别指望它能跑得很舒服。

第二,命令行劝退了一部分人

我第一次用的时候,盯着那个没有任何装饰的终端输入框,有那么一瞬间我觉得自己在用黑客工具。说实话,Ollama 本身没有图形界面这件事,确实是有门槛的。

但用久了你会发现,这反而是优势——它不占后台资源,不弹通知,不在你写代码的时候跳出来打断你。你什么时候需要它,它就在那里。

第三,它没法联网查实时信息

本地模型的特点就是"只看训练数据",你想问今天天气、查最新新闻,它做不到。这类需求还是得回到在线 AI。

适合谁,不适合谁

适合你,如果你:

对隐私有顾虑,不想让私人内容上传到服务器

用 AI 比较频繁,想省掉每月订阅费

对技术有点好奇心,不介意打开终端敲几行命令

有一台配置不算太旧的电脑

不适合你,如果你:

需要实时联网的信息,比如查今天的股价、新闻

完全不想接触命令行,只想要一个图形界面

电脑用了五年以上、内存只有 8GB

有一类人我不推荐用这个:你的工作需要 AI 帮你做大量实时联网检索、数据分析,或者你是重度 Copilot 用户,本地模型满足不了你的需求,它解决的是不同的问题。

夜雨聆风

夜雨聆风