AI 红队工具怎么选?6 类 18 款对比

前天我刚发了 LiteLLM 那个 CVE,文末挂出 GitHub repo 之后。

第一个工程师私信问的不是漏洞细节。

是这句:

我们老板说要建 AI 红队,让我下周交工具选型表。 你能不能把你 repo 里那一堆工具,给我画张图,分个类?

我当时第一反应是——这事儿挺扯的。

AI 红队工具我自己也是看花了。看完工具列表头疼三天。OWASP、NIST、CSA、Gartner 各家分类口径不一样,开源项目 200+ 个,光名字就能背半天。一个 PyRIT 跟 promptfoo 到底是不是一回事,连我自己都得查文档。

这赛道卷得有点离谱。

但工程师不这么看。他要的不是综述,是一张能直接交给老板的表。

所以这两天我把这事儿干完了。

下面拆 4 段:

1. 先把 4 个权威分类摆桌面,告诉你为什么市面上分类乱 2. 6 大类的边界怎么画(特别是 Guardrail vs Eval,这条线 90% 的人画错) 3. 18 款主流工具按类摆,每个标星标 + 维护活跃度(半年没更新的得标) 4. 一张选型决策矩阵:你的场景对应哪几款,直接抄 文末有完整 GitHub 持续更新版(star 一下追新),repo 内可下载选型对比表 PDF。

一、为什么市面上分类乱:4 家权威分了 4 套

国际几家都有自己的口径,谁也不让谁。

OWASP(最广泛被引用)有两套:

• LLM Top 10 (2025) — 10 类漏洞:提示注入、敏感信息泄露、供应链、数据投毒、过度授权…… • GenAI Red Teaming Guide (2025-01) — 4 个测试维度:模型评估、实现测试、基础设施评估、运行时行为分析 NIST(最学术派):

• AI 600-1 + ARIA 体系 — 三层评估:模型测试 → 对抗性红队 → 实地测试 • 引入了一个叫"情境鲁棒性指数(CoRIx)"的度量。听名字就知道是研究院的人写的——工程师看了大概率想骂人,名词太学术,落地痛苦 CSA(最聚焦 Agent):

• Agentic AI Red Teaming Guide (2025-05) — 12 类 Agent 威胁 • 这套在 Agent 选型里最有说服力,OWASP Top 10 在 Agent 上下文里反而没那么贴 Gartner(最商业派):

• 把整个 AI 安全市场切成两个支柱:AIUC(用户使用控制)+ AIAC(应用网络安全) • 预测 2026 后由"合并平台"主导 四家口径不一样,开源工具厂商各拣对自己有利的引——所以分类乱。

我没法把四套口径合一。但可以画一张自己用的 6 大类图。

二、6 大类的边界,我是怎么画的

这是核心。

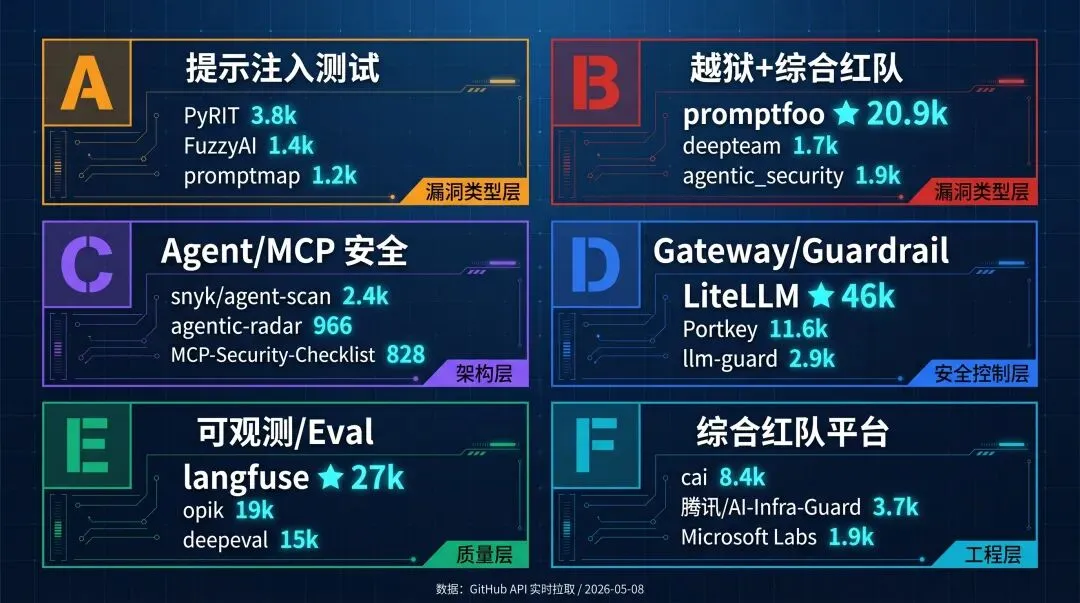

A 提示注入测试 → 漏洞类型层(OWASP LLM01 直接对应)B 越狱+综合红队 → 漏洞类型层(多漏洞综合扫)C Agent/MCP 安全 → 架构层(CSA 12 威胁背书)D LLM Gateway/Guardrail → 安全控制层(实时拦截)E 可观测/Eval → 质量层(事后评估)F 综合 AI 红队平台 → 工程层(一站式)A、B 偏漏洞攻防,C、D 偏架构防护,E、F 偏工程化运营。

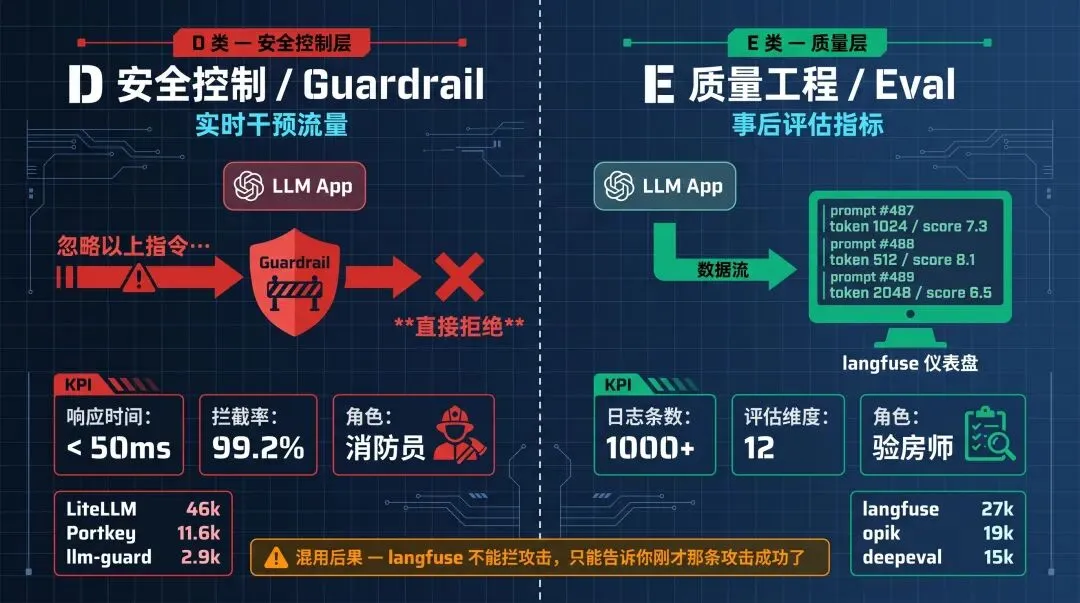

D vs E 怎么分

这个边界 90% 的人画错。

D 是安全控制(实时干预流量):你部署一个 LLM 应用,请求进来先过 Guardrail,发现"忽略以上指令"这种 prompt injection,直接拒绝。

E 是质量工程(事后评估指标):你跑了 1000 条 prompt,langfuse 把日志、token、回答质量都记下来,复盘看哪条出了问题。

一个是消防员,一个是验房师。

混用的后果:你以为 langfuse 能拦住攻击,结果它只能告诉你"刚才那条攻击成功了"。出过这种事故的不止一家。

C 类的特殊性

CSA 把 Agent 单独拎出来写了 12 类威胁,这是有道理的。

Agent 的攻击面跟传统 LLM 完全不一样:你不只是要防 prompt injection,还要防"Checker 脱离循环"、“内存上下文操控”、“多智能体串谋”——这些东西在 chatbot 时代根本不存在。

所以 C 类工具我单独拎出来。MCP 是 Agent 协议层,自然挂在 C 类里。

剩下的,下面一类一类摆。

三、6 大类 18 款工具:按类摆 + 维护活跃度标注

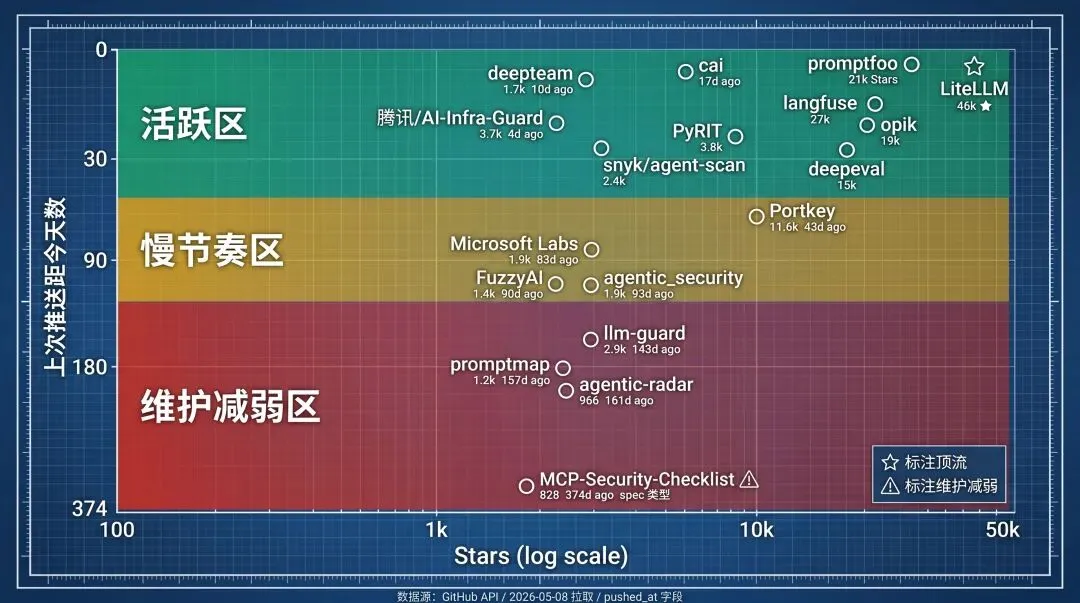

说明:每款标了 GitHub Stars + 上次代码推送距今天数。超过 90 天没动的,工具能用但有维护风险。180 天以上的不建议作为唯一选项。

A 类:提示注入测试(3 款)

| microsoft/PyRIT | |||

| cyberark/FuzzyAI | |||

| utkusen/promptmap | 157d ⚠️ |

直接选:PyRIT。微软在维护,今天还在 push,社区生态好。

PyRIT 学习曲线不算低。如果你只是想跑个快速测试,promptmap 简单 5 分钟能上手——但记得它已经半年没更新了。

顺手吐槽:promptmap 当年是这个赛道开创者之一,但现在被 PyRIT 抢了风头。开源圈这事儿挺现实的——你今年开创的赛道,明年可能就被大厂的工具碾过去。

B 类:越狱 + 综合红队(3 款)

| promptfoo/promptfoo | 20,965 | ||

| msoedov/agentic_security | |||

| confident-ai/deepteam |

直接选:promptfoo。如果你只能用一个工具,就是它。

promptfoo 已经是事实工业标准了。一线 AI 安全公司基本都接了。21k stars 不是白来的——它解决的是"我有 100 条 prompt 模板想批量测"这个真实痛点。

deepteam 是后起之秀,跟 deepeval 同公司——配着用的话,红队 + 评估一条龙。

C 类:Agent/MCP 安全(3 款)

| snyk/agent-scan | |||

| splx-ai/agentic-radar | 161d ⚠️ | ||

| slowmist/MCP-Security-Checklist | 374d ⚠️ |

直接选:snyk/agent-scan。商业公司维护,今天还在 push,跟 Snyk 自身的 SCA 工具栈打通。

MCP-Security-Checklist 374 天没更新,但它是 spec 类型的清单文档,不是代码工具——本来也不需要跟代码一样的更新频率。SlowMist 这套清单仍然是 MCP 安全的事实参考,别因为 pushed 字段就否定它。

这就是为什么"维护活跃度"不能当唯一指标。Spec / Doc 类型的项目天然就是低频更新。

D 类:LLM Gateway / Guardrail —— 安全控制层(3 款)

| BerriAI/LiteLLM | 46,122 | ||

| Portkey-AI/gateway | |||

| protectai/llm-guard | 143d ⚠️ |

直接选:LiteLLM + Portkey 二选一。

LiteLLM 占用率高,社区生态强,但有过 CVE 历史——你看昨天那篇文章就知道,配置不当能直接 root。我自己昨天 CVE 那篇文章发完到现在,邮件还在被问「为什么用了 LiteLLM 反而不安全」。说真的,安全的不是工具,是配置。要用就严守 allowlist 加固,别偷懒。

Portkey 出生就带 Guardrail,开箱即用,维护频率也不错。如果你团队里没人想再写一套 Guardrail,Portkey 省事。

llm-guard 半年没更新——曾经是这个赛道的标杆,现在感觉团队精力不在这上面了。新项目别拿它作单点依赖。

E 类:可观测 / Eval —— 质量层(3 款)

| langfuse/langfuse | 26,799 | ||

| comet-ml/opik | |||

| confident-ai/deepeval |

直接选:langfuse。

这一类是公众号读者最容易混淆 D 类的地方,再强调一次——

langfuse 不能拦攻击。它是给你"事后审计 + 长期监控 + Eval"的。你想实时拦 prompt injection,去 D 类。

三家都活跃,没有踩坑工具。选 langfuse 因为它社区最大、教程最多、上手最快。Eval 想做更深就接 deepeval。

F 类:综合 AI 红队平台(3 款)

| aliasrobotics/cai | |||

| Tencent/AI-Infra-Guard | |||

| microsoft/AI-Red-Teaming-Playground-Labs |

直接选:腾讯 AI-Infra-Guard。

国内项目,活跃维护,腾讯背书,全栈型平台——你想一站式,就是它。

CAI 抽象更好,但中文文档少,落地慢。微软那个是培训用的,不是生产工具——别搞错。

四、选型决策矩阵:你的场景,对应哪几款

工具一类一类讲完了,但工程师真正问我的还是同一个问题:

我现在就一个 LLM 客服 / RAG 文档问答 / Agent 自动化任务,到底装哪几个?

直接抄表:

3 条决策规则:

1. B + D + E 三件套是底线:promptfoo 红队 + Gateway 拦截 + langfuse 监控,少一个都漏。 2. Agent 上 C 类:传统 LLM 工具不覆盖 Agent 特殊威胁(CSA 12 类),不上 C 类等于裸奔。 3. F 类是替代不是补充:AI-Infra-Guard 这种平台型工具是给"团队 ≤3 人没精力维护多套工具"的小团队用的,不要又装 F 又把 A B C D E 都装一遍——重复没意义。 老板有时候会说"装多一点更安全",我每次都得跟他争半天——多不等于稳,配合着用反而互相打架,告警噪音大到让人想关掉。

场景 × 必装/推荐/可选 决策矩阵 — 直接抄表

五、不推荐的工具(避坑)

说几个让我失望的。直说几个我自己用过、但不会再推荐的。

• promptmap:开创性产品,但 157 天没更新。社区已转向 PyRIT。 • agentic-radar:跟 splx-ai 商业产品绑定深,开源版功能阉割,且 161 天没更新。 • llm-guard:曾是 D 类标杆,团队精力转向其他项目,143 天没更新。新项目别 ALL IN。 这不是说它们能不能用——能用。但作为唯一依赖就有问题。开源工具就是这么残酷:今天的明星,明年的遗产。

顺手放一句吐槽:开源 AI 安全工具的"半衰期"明显比传统安全工具短得多。可能跟 LLM 本身迭代太快有关——昨天的 jailbreak 套路今天就失效了,工具还没适应,团队也累。这一行卷得有点不像话,每年都有几个明星项目突然就停更,挺让人破防的。

六、附录:18 款工具完整 URL 速查

数据采集自 GitHub API(2026-05-08 实时拉取)。Star 数和维护活跃度都会变,建议直接点进去看现状。

A 提示注入测试

• PyRIT — https://github.com/microsoft/PyRIT • FuzzyAI — https://github.com/cyberark/FuzzyAI • promptmap — https://github.com/utkusen/promptmap B 越狱+综合红队

• promptfoo — https://github.com/promptfoo/promptfoo • agentic_security — https://github.com/msoedov/agentic_security • deepteam — https://github.com/confident-ai/deepteam C Agent / MCP 安全

• snyk/agent-scan — https://github.com/snyk/agent-scan • agentic-radar — https://github.com/splx-ai/agentic-radar • MCP-Security-Checklist — https://github.com/slowmist/MCP-Security-Checklist D LLM Gateway / Guardrail

• LiteLLM — https://github.com/BerriAI/litellm • Portkey gateway — https://github.com/Portkey-AI/gateway • llm-guard — https://github.com/protectai/llm-guard E 可观测 / Eval

• langfuse — https://github.com/langfuse/langfuse • opik — https://github.com/comet-ml/opik • deepeval — https://github.com/confident-ai/deepeval F 综合 AI 红队平台

• cai — https://github.com/aliasrobotics/cai • Tencent / AI-Infra-Guard — https://github.com/Tencent/AI-Infra-Guard • Microsoft / AI-Red-Teaming-Playground-Labs — https://github.com/microsoft/AI-Red-Teaming-Playground-Labs 整理版(含 Stars / 维护活跃度 / 推荐场景对应表)已挂 GitHub repo:

→ https://github.com/taielab/ai-security-workshop

每周持续更新。Star ⭐ 一下,新工具上线第一时间追到。

七、收尾

回到开头那个问的工程师。

我把这张选型表交给他了。他让老板看完,老板说"这个表挺扎实,下周开始按 B+D+E 三件套部署"。

工具选型这事儿挺像装修。市面上有 100 种瓷砖,但你家厨房就那么大,需要的就那么几种。不在于你知道多少款,在于你能不能给具体场景配出最少必要工具集。

我自己每次帮人做 AI 红队 SOP,写出来的工具清单从来没超过 5 个。再多就是给老板撑场面,不解决问题。

希望这篇文章是你那张可抄的表,不是又一份让你头疼的综述。

写完我自己也觉得不够全——AI 安全工具这一行变得太快,今天的清单两个月后可能就有几款掉队。但全无穷尽。先把这 18 款用好。

完整 6 类 18 款工具对比表(含 Stars / 维护活跃度 / 推荐场景)(「AI 红队工具选型决策矩阵」):

1. 全部代码 + 知识库 + 工具导航(持续累积)

→ 代码:https://github.com/taielab/ai-security-workshop — 企业 AI 落地的安全实战工具集(持续累积)

→ 知识库:https://my.feishu.cn/wiki/TTAkwC0GliX141kZBSuccucrnDb — 中文 AI 安全开放知识库(数据 / 模型 / Agent / RAG / MCP / A2A / 供应链 / 治理)

→ 工具导航:https://aiseckit.com/ — AI 安全工具导航站(找工具 / 找入口)

→ Star ⭐ + 收藏一下,下一篇上线第一时间追到,持续自查不踩坑。

2. 工程师交流 / 企业 AI 安全咨询

加我个人微信(备注一句话来意,对得上才聊):

3. 知识星球「AI 安全工坊」— 公众号写不了的细节

→ 实战:AI 渗透 / 模型加固 / 数据防护 → 落地:案例拆解 / 选型避坑 / 合规指南 → 资源:工具包 / 漏洞库 / 一对一答疑

顺手关注「AI 安全工坊」并设为 ⭐ 星标,高频更新主轨深度文,CVE 速报第一时间推送。

※ 本文 PoC 仅用于安全研究 / 自查 / 修复验证。在他人系统未授权运行等同非法入侵,法律责任自负。

夜雨聆风

夜雨聆风