> 本文约 3736 字,阅读大约需要 8 分钟。

我见过太多这样的场景。

一个人桌上摆着ChatGPT、Claude、Kimi三个对话窗口,浏览器标签栏里还躺着Notion AI和Copilot,收藏夹里收藏夹着一堆"AI工具合集"。每天在各个工具之间跳来跳去,平均每隔20分钟就换一个窗口。

月底复盘,发现真正产出有效工作的内容,大部分还是用最熟悉的那个工具完成的。其他的,基本是"研究过,但没坚持用"。

这不是个例。这是一种普遍存在的AI使用困境。

核心问题不是"哪个工具更强",而是"什么值得你花时间去学一个新工具"。

这是一个看起来像工具选择问题,但实际上是一个认知和决策优先级的问题。

第一个反直觉的事实:工具越多,切换成本越高

我们先来算一笔账。

假设你同时使用3个AI对话工具。每个工具的上下文容量不同、擅长的任务类型不同、价格不同、API限制也不同。

表面上,你在"用AI提升效率"。

实际上,你每天在完成一项隐藏任务:判断这个任务应该交给哪个工具。

这个判断需要时间。切换窗口需要时间。适应不同工具的输出风格需要时间。重新建立上下文需要时间。

管理3个工具的碎片成本,可能比你想象的更高。

大多数人低估了"维护工具栈"的认知成本。当你同时维护多个工具时,你实际上同时承担了以下隐性成本:

第一,上下文迁移成本。每次切换工具,你需要重新建立对话背景。AI不是记忆你的项目,它只记忆当前对话窗口里的内容。这意味着切换工具=重新解释问题。

第二,风格适应成本。不同模型有不同的输出风格,有的偏向结构化,有的偏向口语,有的会过度展开,有的会过度简洁。你需要花时间校准自己的提问方式。

第三,结果验证成本。当你用多个工具做同一件事得到不同结果时,你需要额外判断哪个结果更可靠。这不是"比较选优",这是"额外工作"。

第四,持续学习成本。每个工具都在更新,每个工具的新功能都需要你重新学习。学习时间+试错时间,是工具维护成本的大头。

这四个成本加在一起,构成了"工具越多,效率越低"的根本原因——不是工具本身有问题,而是管理工具的认知负担超过了工具带来的收益。

第二个反直觉的事实:"试试再说"是最大的时间陷阱

很多人有一个习惯:看到一个新的AI工具报道,先收藏,等有空了再研究。

然后,就没有然后了。

这不是因为懒。这是一种理性的决策回避。

当你评估一个新工具时,你需要花费时间了解它的能力边界、使用场景、价格模型、和其他工具的差异化特征。这个评估过程需要持续投入,而不是一次性看完介绍就能下结论。

"试试再说"的问题在于:它让你把决策推迟到一个永远不会到来的时间点。

因为:

1. 评估一个工具需要时间

2. 时间是有限的

3. 有限的时间应该优先用在已经被验证有用的工具上

4. 所以"有空再研究"的时间永远不会被分配给新工具

这不是一个道德问题,而是一个资源分配问题。

那些真正把AI用出效果的人,往往不是"拥有最多工具的人",而是"对少数工具理解最深的人"。

他们的策略是:先用透一个工具,再考虑下一个。

这里的"用透"有两个标准:

- 这个工具能够覆盖你80%以上的日常需求

- 你对这个工具的能力边界和局限有清晰的认知

当你达到这两个标准时,如果还有明显的需求无法被满足,再去找下一个工具。

而不是反过来:先收集一堆工具,然后再问"这个工具能干什么"。

第三个反直觉的事实:AI工具之间差距,比你想的要小

一个常见的认知陷阱是:认为顶级AI工具之间存在巨大的能力差距。

实际上,对于大多数知识工作场景,当前主流AI工具之间的差距正在快速收窄。

GPT-4o、Claude 3.7、Gemini 2.0、DeepSeek V3这些主流模型,在通用对话、文本撰写、信息整理、代码辅助这些常见任务上,输出质量的差异对大多数用户来说是可以接受的。

差异真正大的地方在于:

- 特定领域的微调质量

- 长上下文窗口的实际可用性

- 价格和速率限制

- 与特定工作流的集成深度

但这些差异,对一个"每天写报告、整理会议记录、回复邮件"的普通知识工作者来说,重要程度远没有"你是否真正用起来了"来得高。

换句话说:真正限制你效率的,不是工具的代际差,而是你对自己工作流的整合深度。

你用一个工具完成80%的任务,还是用三个工具完成80%的任务?

前者只需要维护一套工作流。后者需要维护三套,并且承担切换成本。

这不是工具选择的问题。这是工作流设计的问题。

那么,什么真正值得自动化?

这是核心问题。

在我们讨论"什么工具更好"之前,我们需要先回答一个问题:你的工作中,什么真的值得花时间去自动化?

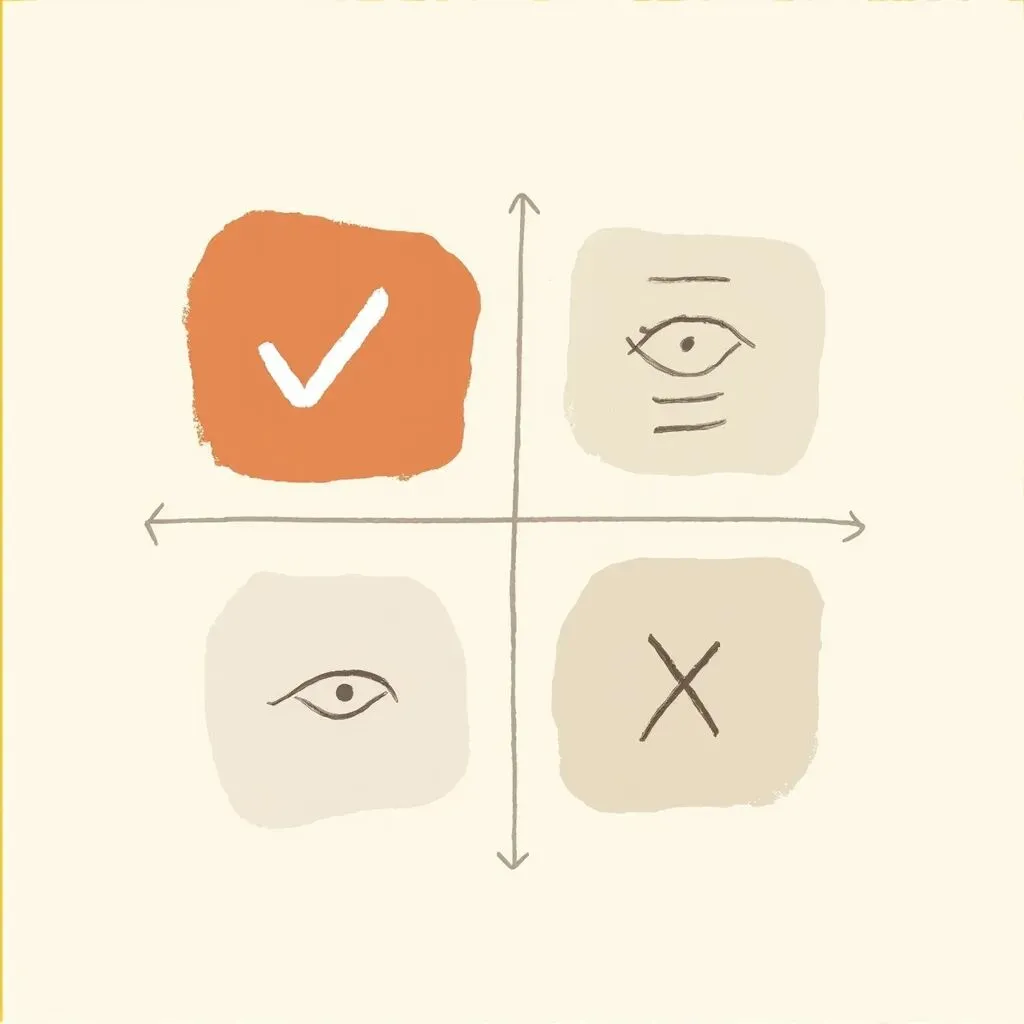

这里有一个判断框架,我把它叫做"自动化价值矩阵"。

按两个维度把你的工作分成四类:

高频率 × 高耗时 → 优先自动化

这类任务每天都要做,每次都花时间。比如:邮件分类和起草、会议记录整理、数据报表生成、日常汇报模板。

这类任务的特点是:重复性强、时间消耗大、自动化的ROI最高。只要找到一个能覆盖这类任务的AI工具,哪怕只有70%的完成度,也值得长期使用。

高频率 × 低耗时 → 可以自动化,但不急

这类任务每天都要做,但每次花不了多少时间。比如:查资料、设闹钟、安排日程。

这类任务自动化的优先级不高,因为时间节省的绝对值有限。除非你有大量碎片时间被这类任务占据,否则投入时间去研究自动化方案不一定值得。

低频率 × 高耗时 → 值得研究自动化方案

这类任务不常见,但一旦出现就很花时间。比如:季度报告撰写、竞品分析、长篇文章结构设计。

这类任务虽然频率低,但单次时间投入大。如果能通过AI工具显著降低单次时间消耗,也是值得投入的。只不过这类任务往往需要更复杂的提示词工程和工作流设计。

低频率 × 低耗时 → 不要浪费自动化的念头

这类任务既不常见又不花时间。比如:一次性查询、改个错别字、临时翻译一段话。

这类任务不值得花时间去研究自动化方案。有这个时间不如用来做真正重要的工作。

大多数人AI效率低下的根本原因,不是不会用AI,而是没有先做这个分类。

他们把大量时间花在了"低频率 × 低耗时"任务的研究上(比如纠结用哪个AI翻译工具更好),而对"高频率 × 高耗时"任务缺乏系统的自动化方案。

一个实用的"少即是多"AI工作流

基于上面的分析,我建议一个最实用的AI工作流设计原则:一个核心工具 + 少数补充工具。

具体来说:

第一步:确定你的"高频任务清单"

列出你每天、每周必须完成的工作任务。不需要列得很细,但需要覆盖80%以上的工作时间。

第二步:找一个工具覆盖尽可能多的高频任务

选择一个你最容易上手、文档最完善、社区资源最丰富的核心工具。这个工具应该能够覆盖你70%以上的任务类型。

不要选最贵的,不要选功能最多的,选你最有可能坚持用下去的。

第三步:为高频+耗时的任务设计专用提示词

这是关键一步。AI工具本身是通用的,但你可以通过"高质量的提示词"把它变成专用的。

比如,如果你每天需要写晨会报告,你不需要每天重新描述背景。你需要一个"晨会报告模板提示词",每次只需要输入关键数据和一个简单指令,就能得到完整报告。

第四步:只为你核心工具覆盖不了的20%任务寻找补充工具

这20%的任务,往往是特定领域的需求,比如代码辅助、数据分析、图片生成、语音转文字等。

这类补充工具不需要多,每个领域1-2个足够了。

第五步:定期做"工具审计"

每隔3个月,问自己三个问题:

- 这个补充工具我真的在用吗?

- 核心工具有没有我还没用上的功能?

- 有没有新工具比现有工具显著更好地解决了我的某个高频需求?

如果一个补充工具连续两个月没有被主动使用,应该考虑把它从工具栈中移除,而不是继续维护它。

一个真实的案例:为什么"少工具"策略更有效

我认识一个产品经理,她告诉我她试用过市面上几乎所有主流AI对话工具。

她的结论是:大部分工具都能满足她的需求,真正的问题是不知道该用哪个。

她每天的时间被切割成无数个小任务,每个任务她都会花5-10分钟在不同的AI工具之间切换,试图找到"最好的答案"。

结果,她花在"找答案"上的时间,比她用任何单一工具直接干活的时间还要多。

后来她做了两件事。

第一件事是给自己定了一个规则:所有文字类工作只用同一个工具,只有当这个工具连续三次给出明显不满意的答案时,才能切换。

第二件事是把每天最耗时的三个任务做成"指令模板",存在备忘录里,每次直接调用。

效果是显著的。她的日均AI使用时间从2小时减少到45分钟,产出质量反而提高了。

因为她不再花时间在选择工具上,而是把时间花在了优化提示词和完善指令模板上。

工具的数量不是优势,工具的深度才是。

最后说一句

这篇文章不是告诉你"不要用AI工具"。

恰恰相反。

我是想告诉你:AI工具的价值实现,不取决于你拥有多少工具,而取决于你对少数工具的理解有多深。

当你同时维护5个AI工具时,你实际上在做一件很矛盾的事:你以为你在提升效率,但你每天都在为管理这些工具付出隐性成本。

真正的效率来自于:减少工具的数量,增加每个工具的使用深度。

这不是一个技术问题。这是一个决策优先级的问题。

如果你今天只有时间做一件事,不要去研究下一个爆款AI工具。把你现有的工具用得更深一点。

那才是真正的杠杆。

今日互动:

你现在同时在用几个AI工具?你觉得"工具太多"这件事真的存在吗,还是只是一个伪命题?欢迎在评论区分享你的真实体验。

如果你觉得管理工具栈本身就是一个挑战,也可以在评论区聊聊你现在的工具组合是什么,我会挑一些有代表性的问题在下周的文章里回应。

夜雨聆风

夜雨聆风