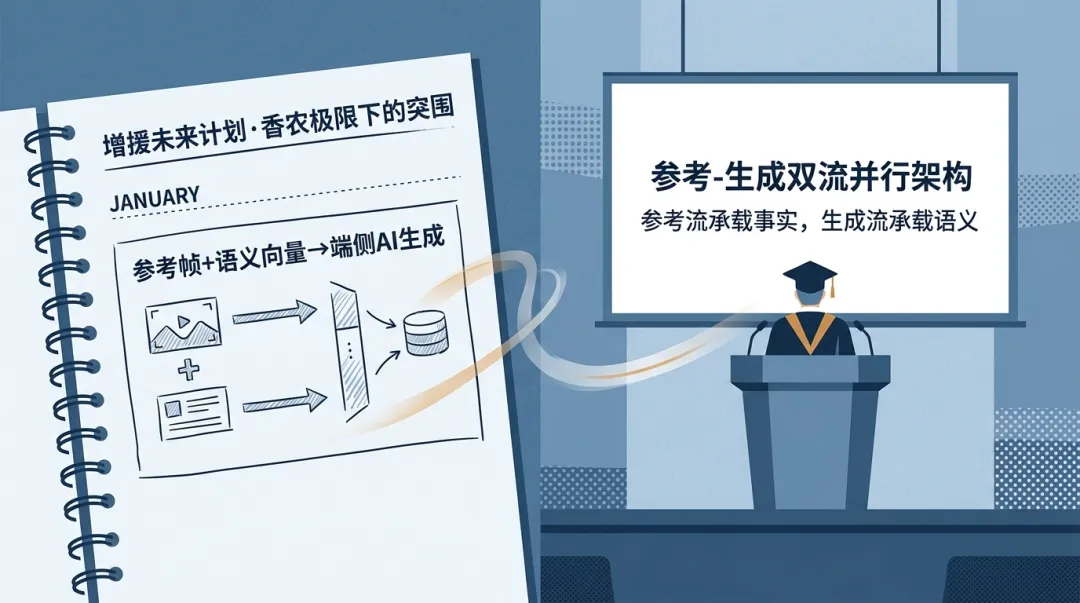

▲图注:1 月的思想实验和 4 月 CCBN 主报告里的"参考-生成双流"几乎一对一。但放回广播这一档具体媒介,会发现一个绕不过去的问题。

今年1月,本号写过一篇《增援未来计划·香农极限下的突围》,设想数字广播借助端侧AI生成,在极低码率下传"参考帧+语义向量",由接收机本地"脑补"出完整的画面与音频。那时这是一个思想实验。

四个月后,CCBN 2026主报告会上,中国工程院院士张文军把"参考-生成双流并行架构"带到了主报告:参考流承载事实,生成流承载语义,终端融合生成。这些词和我们1月那篇几乎一对一。

呼应是真的呼应。不过1月那篇是从通信范式的角度讲AI怎么突破香农极限;把它放回广播这一档具体媒介,会发现一个不太容易绕过去的问题。

广播是一种受规制的公共媒介,监管的对象是发射端发出的内容。如果内容是在每一台接收机上自己生成的,发射端就管不到,监管也跟着没了对象。

而问题不止于"监管不到"。它牵到广播这种媒介的几条根属性。

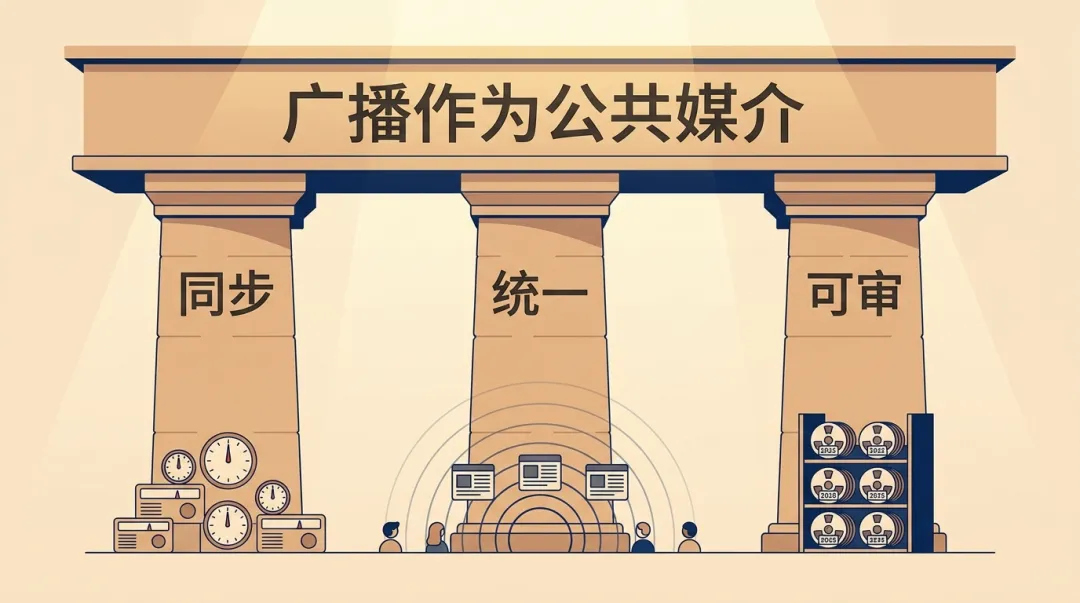

广播作为一种媒介,靠什么立着

广播不是一项技术,是一种媒介。它和流媒体、互联网视频是不同的物种。把它和后两者放在一起说"内容传输",会丢掉广播作为媒介的几个根属性。

第一件事:同步。 国家应急广播体系如果发出地震速报指令,要求各级电台与应急终端在很短的时间窗内统一播出。同步不是技术指标,是这种媒介承担应急职能的前提。流媒体没有这件事,你刷到一条视频和我刷到的可能差几十分钟,没人当回事。

第二件事:统一。 同一时刻打开同一频率,全国所有听众听到的应当是同一段内容。这一点听起来理所当然,但它实际上是法律责任的承载基础:出版义务、广告合规、应急播报责任、新闻审稿,所有这些规制能落到运营方身上,前提是"播了什么"在每一台接收机上都是同一个东西。

第三件事:可审。 广电监测系统记录的是发射端发出的信号,回放出来就是当时所有听众听到的内容。"昨天18:30那个台播了什么"是有答案的,是有据可查的,是可以追责的。这不是技术冗余,是规制成立的前提。

这三件事,同步、统一、可审,支撑着广播作为一种公共媒介的位置。少哪一件,它都会变成另一种东西。

▲图注:广播作为一种公共媒介,靠同步、统一、可审三件事撑着

端侧AI生成把这三件事都掀了

把"参考-生成双流"放进广播,工程上当然成立。发射端送参考帧+语义向量,接收端本地"脑补"出完整画面或音频。但这个动作把广播的三个根属性逐条破掉。

同步被打破。 端侧生成的速度取决于接收机的算力。一台车载座舱芯片可能几百毫秒出图,一台家用网关可能要更久。即便发射端同时下发参考流,接收机的"成片时间"不再一致。在应急广播这种秒级同步要求下,这个延迟参差就是硬伤。

统一被打破。 两台接收机收到同一组参考帧+语义向量,本地生成的结果未必相同。模型版本不同、浮点精度不同、随机种子不同,任何一项差异都会让生成内容产生肉眼可见的偏移。工程上可以加补丁,固定随机种子、绑定模型版本、做"最低公共支持模型"约定,但都是缝补,不改变"每台接收机有自己的输出"这个底色。

可审被打破。 这是最致命的一条。广电监测体系建立在"录到的发射信号=听众接收的内容"这个等式上。一旦内容在接收端生成,发射信号录下来的只是"骨架+提示词",不是听众真正接收到的东西。监测中心录到的是参考帧,落地的是接收机各自"脑补"出来的画面或声音。"播了什么"这个问句,从此没有一个统一的答案。

可以试着加补丁。让接收机定期回传部分输出,违反隐私、不可行;让模型经过预审认证,版本一升级又要重做。每一个补丁都让这条架构离落地更远。

不是工程师水平不够,是结构本身和广播的规制框架不兼容。

▲图注:端侧 AI 生成把同步、统一、可审三件事逐条破掉

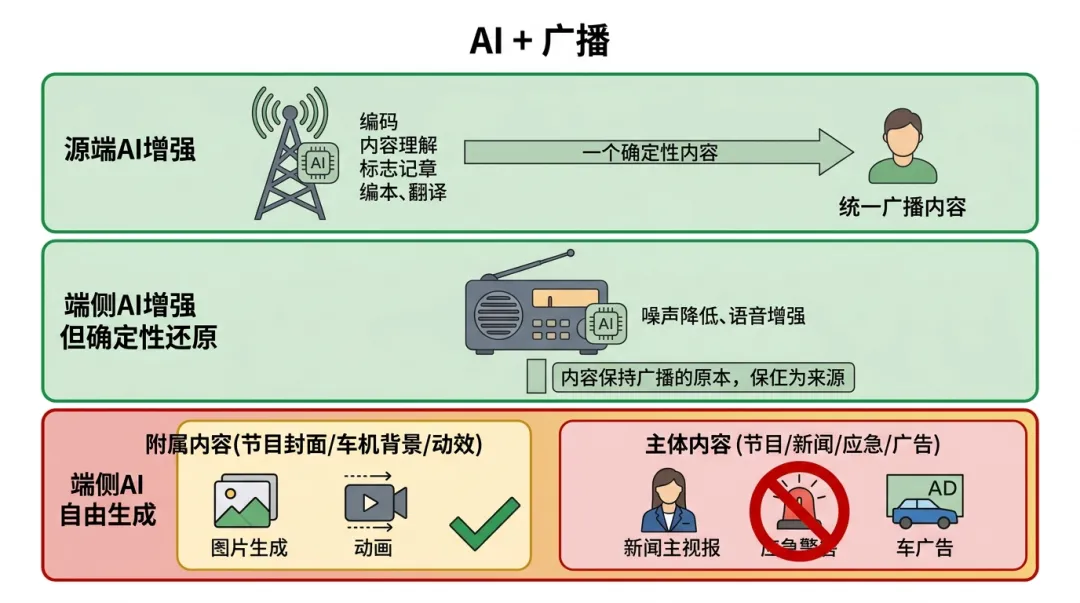

AI+广播的真路径,从来不在端侧自由生成

AI进广播这件事可以做,而且早就在做,只是真路径不是端侧自由生成。

源端AI增强通畅。 把AI用在编码效率提升、内容理解、自动字幕、多语言实时翻译、节目编排辅助,这些动作都在发射端发生,监管照样能管。发射出去的还是确定性内容,监测中心录到的还是听众听到的。源端AI不管多强,都不会破坏广播的三个根属性。

端侧AI增强但确定性还原也通畅。 解码之后做语音增强、噪声抑制、回声消除、低码率音频的感知质量提升,这一类是后处理。内容本身是发射端给的确定性信号,AI只是优化呈现。听众听到的还是原节目,不是AI"脑补"出来的另一个版本。

端侧AI自由生成只能用在附属内容上。 附属内容指节目封面图、车机界面背景、专辑可视化、节目元数据动效这一类,不在监管必管的范围里,让端侧生成参与无妨。SlideShow类的车机配图,今天就是这个工程边界:发射端给一张参考缩略图加文本描述,接收端在车机屏幕上做生成式渲染,没人会去管"那辆车的中控屏上长什么样"。

主体内容是另一回事。节目本身、新闻、应急、广告,必须保持发射端的确定性,必须能被监测体系逐比特还原。这一档没有让步空间。

这三条划下来,"AI+广播"不是空想,是有明确工程边界的一组动作。1月那篇文章里写到的"语义通信、ControlNet引导、压缩比1800倍",这些技术本身没问题,问题在于把它们用在哪里。用在主体内容上,是越界;用在附属内容上,是空间。

▲图注:AI 进广播这件事可以做,只是真路径不是端侧自由生成。源端增强、端侧确定性还原、附属内容生成——三档之外的事,会越界。

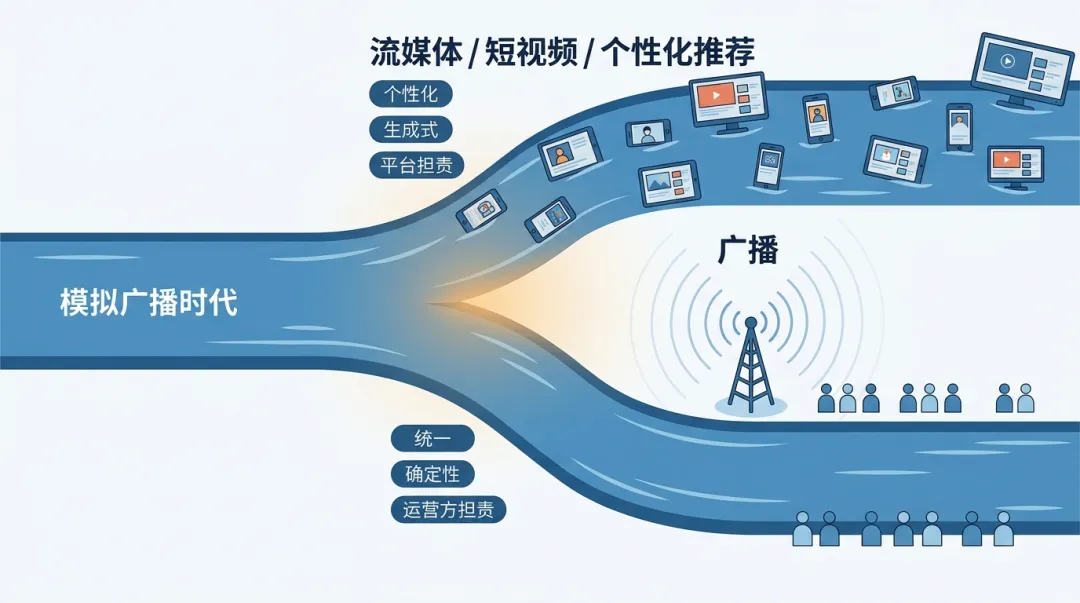

AI时代让广播变稀缺,而不是过时

AI没有让广播过时。它让广播变稀缺了。

流媒体、短视频、个性化推荐,这些是AI时代最热闹的内容形态。它们的共同特征是每个用户看到的不一样、平台对内容生成与分发负责、监管落到平台层面。这种"个性化、不统一、由平台担责"的模式,配生成式AI是天作之合:同一段视频可以个性化推荐给不同人,可以加个性化广告插入,可以生成个性化封面。这一档媒介里,端侧生成是顺势而为。

广播是相反的物种。它的全部价值建立在"全国所有人在同一时刻收到的是同一个东西,且这个东西可查"。在所有人内容都被个性化、信息都被算法分发的时代,统一和可审这两件事反而变成了稀缺品。

应急广播尤其如此。地震速报、防空警报、灾害撤离指令,这些场景要的不是"个性化",是"全国一个声音、每个人都收到、每个字都能复核"。AI时代越是个性化深入,"统一发声"的稀缺性就越凸显。

广播在AI时代很难被取代,但它得守住自己的本质,才不会被稀释成另一种东西。真正的危险不是"AI取代广播",按目前看到的结构这件事很难发生。真正的危险是被AI焦虑驱动,把端侧生成装进广播主体内容,让广播逐渐失去"统一可审"这一根。

媒介到此分叉

回到1月那篇文章和张院士主报告的呼应。

呼应是真的呼应。"参考-生成双流"作为一种通信架构,在张院士描述的"未来媒体网络"里有它成立的位置。那是流媒体、个性化交互、车载场景里AI增强的主战场。这条路应该走,应该走得比现在快。

但那条路通向的不是广播的下一站。两种媒介在AI时代分叉了。一种主打个性化、生成式、平台担责;另一种主打统一、确定性、运营方担责。两者各有不可替代的位置,各自演进,但不会演进成对方。

1月的思想实验仍然有价值。它的价值不在于"预言一种未来的广播形态",而在于逼着我们去想清楚广播的边界在哪里。边界一旦看清,就知道哪些路该走、哪些路看着像广播的升级、其实是它的解构。

AI时代正在重塑很多媒介。广播是其中之一,但重塑的方式可能不是"把广播改造成AI生成的产物",而是在AI让所有别的内容形态都变成个性化时,广播作为统一可审的同步媒介反而变得稀缺。

稀缺,是广播在新时代的位置。

▲图注:两种媒介在 AI 时代分叉。各自演进,但不会演进成对方。

每一座台站的频率与地质环境都是独一无二的。为了帮助您评估DRM改造潜力,我们现开放限时咨询服务。

请在公众号后台私信发送关键词:“覆盖”

在回答几个基础问题(如频率、功率、坐标)后,我们的工程师将为您进行适配您台站实际情况的基准覆盖仿真,并提供针对性的分析建议。

📥【DRM能效计算器上线】

热门文章

转发关注!

夜雨聆风

夜雨聆风