2026年3月,德国汽车工业协会(VDA)正式发布《Artificial Intelligence in Quality Management》(人工智能在质量管理中的应用)黄皮书(第一版),目前该文件仍处于行业意见征集阶段,反馈截止日期为2026年5月12日。本文基于黄皮书原文核心内容,系统提炼其明确的12个AI落地场景、合规监管框架,并同步提供原文下载渠道,助力行业从业者快速把握文件核心价值。

一、文件背景与定位:VDA质量管理体系的AI专项补充

这份黄皮书由VDA QMC(德国汽车工业协会质量管理中心)牵头编制,ISSN编号为0943-9412,是VDA迄今为止在质量管理领域,针对AI应用发布的最全面、最具指导性的规范性文件。其内容覆盖AI在质量管理中的术语定义、AI系统准入审批流程、相关岗位能力要求,以及12个典型应用场景,形成了完整的AI应用指导体系。

按照VDA的惯例,黄皮书属于“草案公示+意见征集”阶段的文件,公示期为三个月,广泛收集行业内各类主体的反馈意见后,将经过质量管理委员会(QMA)审核修订,最终以红皮书或蓝金皮书的形式正式纳入VDA规范体系。这也意味着,当前版本的黄皮书仍具备可调整性,行业从业者可通过官方渠道提交反馈,直接影响文件最终的规范内容,反馈通道将持续开放至2026年5月12日。

黄皮书前言中一句核心表述——“The integration of AI into industrial processes is not a question of whether, but of how.”(人工智能与工业流程的融合,不在于“是否要做”,而在于“如何合规、有序落地”),精准奠定了整份文件的核心基调:不纠结于AI应用的必要性,而是聚焦于AI在质量管理中应用的合规性、可审计性与可操作性。

二、监管背景:双重压力推动AI质量管理规范落地

VDA此时发布这份黄皮书,并非偶然,而是源于外部监管要求与行业自身发展的双重驱动,具体可分为两大核心压力:

其一,欧盟AI法案(EU AI Act,EU 2024/1689)的强制约束。黄皮书明确指出,对于高风险AI系统,欧盟AI法案第17条明确要求企业建立文档化、系统化的质量管理体系,或将AI相关管理要求整合至企业现有QMS(质量管理体系)中。具体而言,需涵盖AI系统的开发、测试、验证全流程方法,数据管理全流程(包括数据质量管控、数据标注规范、数据存储安全),AI系统的风险管理体系与上市后持续监测机制,以及可全程追溯的文档管理体系。这些要求与现有IATF 16949、ISO 9001质量管理体系在核心逻辑上保持兼容,但在AI专项管理要求上,提出了更高、更细致的标准,超出了现有体系的覆盖范围。

其二,IATF 16949与VDA 6.x体系的自身延伸需求。随着AI技术在质量管理中的深度应用,越来越多的AI系统开始承担过去由人工完成的质量决策工作——例如自动对零部件进行OK/NG分类、在无人干预的情况下触发CAPA(纠正和预防措施)流程。这就给现有审核框架带来了新的课题:审核人员在审核过程中,究竟是仅审核AI决策的最终结果,还是需要审核AI系统的训练数据、模型版本、决策逻辑等全流程信息?

对此,黄皮书给出了明确答案:两者缺一不可,且所有环节均需做好痕迹留存,确保全程可追溯。

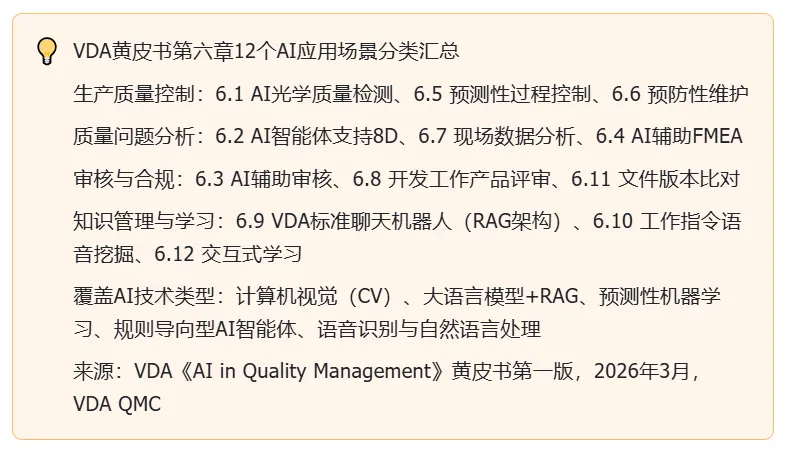

三、核心落地:12个AI应用场景(按类型拆解)

黄皮书第六章“Recommended actions and application examples”(推荐措施与应用案例)是整份文件中最具实操价值的部分,其中明确列出12个AI在质量管理中的应用场景,每个场景均配套详细的应用说明、具体实操案例及使用风险提示。结合应用场景的核心用途,可分为四大类,具体拆解如下:

(一)生产质量控制类(3个场景)

此类场景聚焦于生产全流程的质量管控,核心是通过AI技术提升检测效率、提前规避质量风险,减少人为干预带来的偏差。

场景1:AI光学质量检测(6.1)

基于计算机视觉技术的生产线下线检测方案,模型通过大量标注为“OK/NG”的图像数据训练后,可实现对零部件的自动分类识别。黄皮书特别强调一个关键要点:对于安全相关类零部件,当AI模型的置信度分数(Confidence Score)低于预设阈值时,必须触发人工复核流程。文件明确警示:“置信度不等于准确率,模型完全可能以99%的置信度做出错误判断”,以此规避因AI误判导致的安全风险。

场景5:预测性过程控制(6.5)

依托生产过程中的历史数据——包括传感器读数、设备运行参数、生产批次信息等,训练AI预测模型,实现对质量偏差的提前预判与主动干预。黄皮书特别将其与传统SPC(统计过程控制)进行区分:传统SPC依赖预设的固定阈值,仅能在偏差发生后发出报警;而AI预测性过程控制可从数据模式层面感知异常,在偏差尚未达到报警阈值、未造成质量问题前,提前发出预警信号,实现“防患于未然”。该场景的核心挑战的是数据漂移(Drift)管理,当生产条件发生变化时,AI模型需及时进行重新训练或校准,确保预测精度。

场景6:预防性维护(6.6)

通过采集设备运行过程中的各类数据,利用AI模型预测设备故障发生的时间节点,将传统的“被动维修”模式转变为“主动预防”模式,减少因设备故障导致的生产中断与质量缺陷。黄皮书指出,该场景面临的典型数据难题是:训练数据中“真实故障”样本稀缺——由于设备故障本身属于小概率事件,导致AI模型在边界场景下的表现不够稳定,需通过数据扩充、模型优化等方式弥补这一短板。

注:12个场景均配套“推荐操作指南”与“风险注意事项”,并非单纯的概念性描述,具备极强的实操指导意义。

(二)质量问题分析类(3个场景)

此类场景聚焦于质量问题的高效分析、快速解决,核心是利用AI技术挖掘数据价值,辅助工程师提升问题解决效率与准确性。

场景2:规则导向型AI智能体支持8D流程(6.2)

这是黄皮书中对技术架构描述最细致的场景之一。AI智能体基于预设的结构化规则,全程辅助8D问题解决流程——从D0(问题触发)到D8(经验固化)的每一个环节,均可提供辅助支持。其核心设计原则明确:AI仅承担辅助角色,负责问题初始分类、类似案例检索、标准措辞建议等基础工作,每一步关键决策的确认,必须由人工完成。黄皮书着重强调:AI在8D流程中是“辅助工具”,而非“问题解决主体”,不可替代人工决策。

场景7:现场数据分析(6.7)

通过AI技术对保修数据、现场投诉记录、售后服务数据进行批量分析,快速识别系统性失效模式。传统模式下,此类非结构化数据需依赖人工逐条阅读、分析,效率低下且易遗漏关键信息;AI的核心价值的是从海量非结构化文本中,快速提取隐藏的模式信号——例如“同一批次零部件在特定工况下,三个月内出现集中失效”,为质量改进提供精准方向。黄皮书提示,该场景需重点防范数据偏差(Bias)风险:若不同地区的投诉记录在语言表述、格式规范上不统一,可能导致AI模型的分析结论出现系统性偏差,偏向某一市场的情况。

场景4:AI辅助FMEA(6.4)

利用企业历史FMEA数据、失效案例库及相关标准文档,辅助工程师在新产品FMEA(失效模式与影响分析)过程中,快速识别潜在失效模式。该场景采用RAG(检索增强生成)架构,以大语言模型(LLM)作为生成组件,通过RAG从企业内部知识库中检索相关案例与标准,确保AI生成的建议“不仅语言专业,更符合实际业务场景、内容准确”。黄皮书明确警示幻觉(Hallucination)风险:AI可能生成听起来专业、逻辑通顺,但实际存在错误的失效模式描述,因此所有AI给出的建议,均需经过工程师人工验证后方可采用。

(三)审核与合规文件类(3个场景)

此类场景聚焦于质量管理中的审核流程与合规管理,核心是通过AI技术提升审核效率、确保合规性,同时满足可审计要求。

场景3:AI辅助审核(6.3)

主要用于辅助审核全流程——审核准备阶段的资料梳理、现场核查阶段的重点排查、审核结束后的报告生成。具体而言,AI可自动梳理被审核对象的历史记录、未关闭开口项,将其与审核标准条款进行初步比对,生成审核报告草稿,大幅降低审核人员的重复性工作。黄皮书强调,AI辅助审核的核心合规要求是“可审计性”(Auditability):AI在审核过程中生成的所有决策过程,必须像被审核对象的相关记录一样,具备可追溯、可解释、可文档化的特点,确保审核流程本身的合规性。

场景8:开发工作产品评审(6.8)

针对产品开发过程中的各类产出物——设计文件、规格说明书、测试报告等,提供AI辅助评审服务。黄皮书给出两个典型应用示例:一是自动核查文件是否符合既定模板与格式规范,确保文件统一性;二是跨文件一致性核查,例如校验规格书中的技术参数与测试报告中的测试条件是否一致、无冲突。这两个任务的共同特点是“答案有明确对错标准”,也是AI最擅长的应用

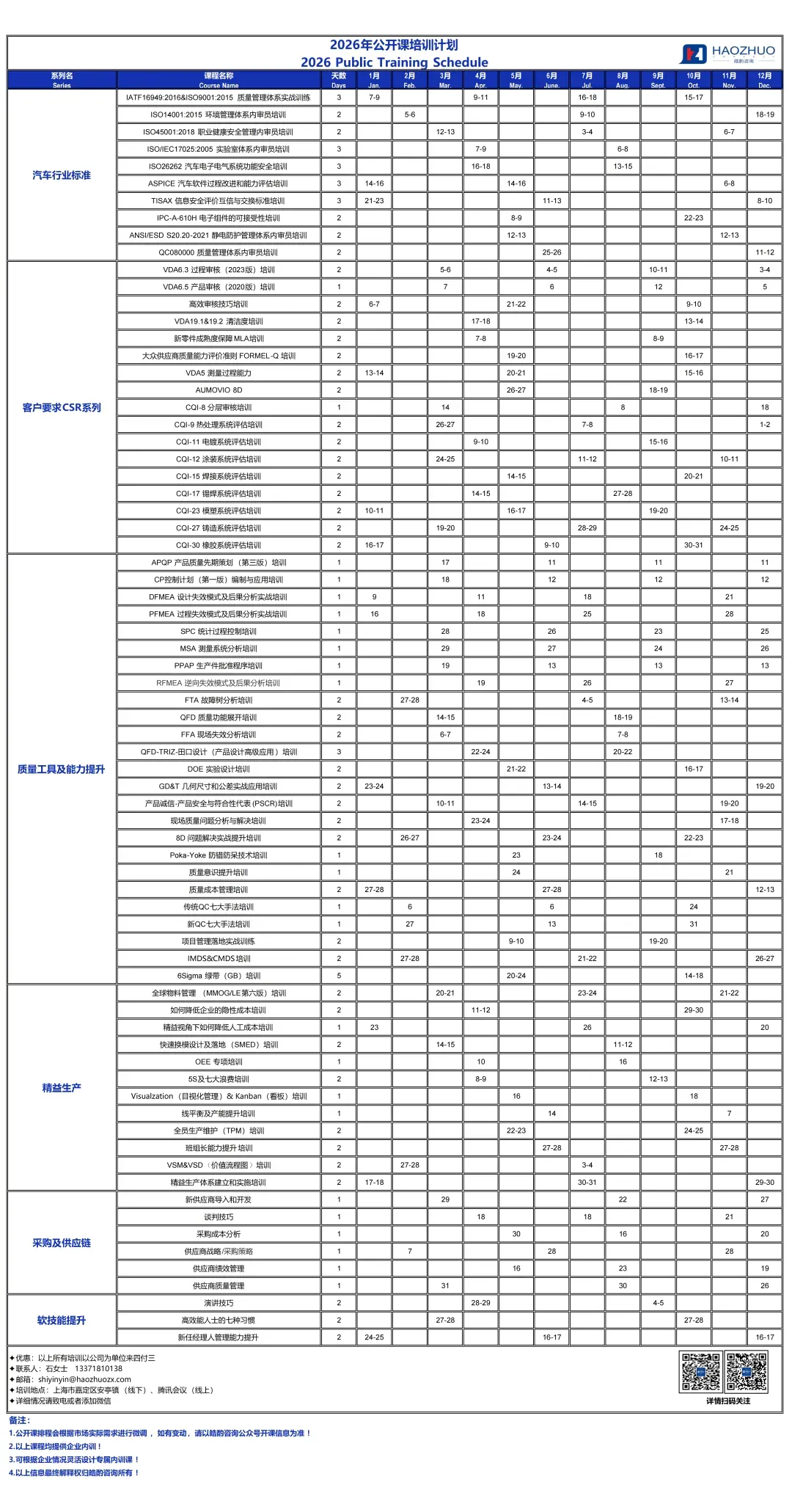

2026年公开课排期,所有课程均可开展公开课或者企业内训,期待您的垂询!

夜雨聆风

夜雨聆风