字节跳动开源了一个"操控一切"的AI助手,本地调研党终于不用怕隐私外泄了

AI深度调研 · 2026年5月11日

Photo by ByteDance / UI-TARS Project

今天刷GitHub Trending的时候,看到一个挺有意思的项目:字节跳动的 UI-TARS-desktop,32k星,3.2k fork,发布才半年。这个项目在做什么?简单说,就是让AI直接操控你的电脑——点击按钮、输入文字、浏览网页,全程不需要你动手。

更重要的是,它完全跑在本地,数据不出本地机器。对于需要调研竞品、做市场分析的人来说,这点太关键了——你不想让AI服务提供商知道你正在研究什么竞品,对吧?

— · —

一、项目是什么?先搞清楚它的定位

Unsplash

UI-TARS-desktop不是一个简单的自动化脚本工具,它是字节跳动开源的多模态AI Agent技术栈的一部分。名字里的TARS来自《星际穿越》的机器人,暗示它追求的是"类人级任务执行能力"。

整个项目分为两个主要方向:

1️⃣ Agent TARS(CLI + Web UI):终端里的AI助手,喊一嗓子就能让它帮你操作文件、查资料、跑脚本。

2️⃣ UI-TARS Desktop(桌面应用):本地GUI Agent,能直接控制你的鼠标键盘,"看"到屏幕内容然后操作。

核心区别于传统RPA:传统RPA靠规则和坐标,UI-TARS靠"视觉理解"——它真的能看懂按钮在哪、输入框在哪。

二、技术原理:它是怎么"看懂"屏幕的?

这是最核心的问题。一个AI要操控电脑,第一步是"看懂"屏幕上有什么。UI-TARS的做法是:基于视觉-语言模型(VLM)进行屏幕理解。

它采用了多模型支持策略:

| 模型 | 来源 | 特点 |

| UI-TARS-1.5/1.6 | 字节跳动自研 | 专为零样本GUI操作优化 |

| Seed-VL-1.5/1.6 | 字节跳动 | 通用多模态,视频理解强 |

| Claude 3.7 Sonnet | Anthropic | 推理能力强,适合复杂任务 |

| Doubao VLM | 火山引擎 | 国内调用便捷,成本低 |

它的核心工作流是这样的:截屏 → VLM分析 → 规划下一步操作 → 执行鼠标/键盘动作 → 循环直到任务完成。整个过程是"端到端"的,不需要你去标注数据、训练模型。

技术上,字节还发布了一篇论文(arXiv:2501.12326),详细解释了UI-TARS的设计细节。有兴趣可以去Hugging Face下载模型权重自己跑。

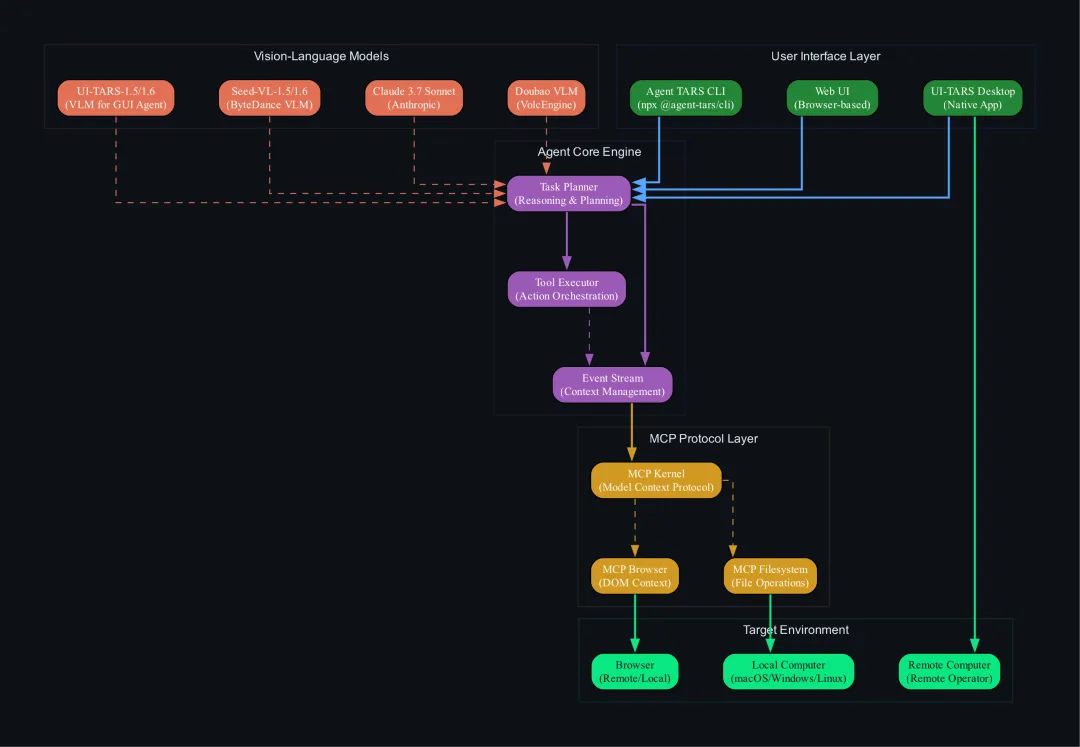

三、架构设计:三层模块的精密配合

Graphviz

整个技术栈分为三层,这种分层设计让项目既可以当作整体用,也能拆开单独使用某个组件。

第一层:用户界面层

三个入口:CLI(命令行)、Web UI(浏览器)、Desktop(桌面应用)。CLI适合开发者集成到自动化流程里,Web UI适合不想装软件的普通用户,Desktop则是最完整的本地体验。

第二层:Agent核心引擎

Task Planner负责任务分解,Tool Executor负责执行具体动作,Event Stream负责上下文管理。Event Stream是个有意思的设计——它把整个对话过程中的所有事件(包括工具调用、模型输出、中间状态)都记录下来,方便调试和回放。

第三层:MCP协议层

MCP(Model Context Protocol)是Anthropic提出来的协议,UI-TARS把内核构建在MCP之上,支持挂载各种MCP Server来扩展能力——浏览器操作、文件系统、代码执行等。这意味着你不需要重复造轮子,直接用现成的MCP生态。

设计亮点:MCP作为内核的好处是标准化——任何实现MCP协议的工具都能无缝接入,不只是字节自己的工具。

四、能做什么?实际场景拆解

Unsplash

光看技术描述可能还是有点虚,我们来看看它实际能处理什么任务。项目README里给了几个展示场景,我来逐个分析:

场景1:机票预订 "帮我订9月1日从圣何塞到纽约最早的航班,以及9月6日最晚的回程航班,在Priceline上。"

→ AI会自动打开浏览器 → 导航到Priceline → 识别航班选择器 → 输入出发地目的地 → 选择日期航班 → 完成预订。相当于自动化完成了整个流程。

场景2:酒店预订+交通指南 "我在洛杉矶,9月1日至6日,预算5000美元,帮我订离机场最近的丽思卡尔顿酒店,并整理交通指南。"

→ 这个更复杂,涉及多个网站切换、数据整理。AI需要同时操作booking.com查酒店、整理地点信息、生成输出。

场景3:VS Code自动配置 "帮我打开VS Code的自动保存功能,并把延迟设为500毫秒。"

→ 这是本地桌面操作的典型场景。AI需要识别VS Code的菜单结构、理解设置面板的层级关系,找到自动保存相关选项并修改。

这些场景的共同点是:需要跨网站/跨应用的复杂操作链路,传统的自动化工具(如AutoJS、Selenium)需要大量脚本适配,而UI-TARS只需要自然语言指令。

五、和竞品比怎么样?优势在哪?

GUI Agent这个赛道最近很热,除了UI-TARS,还有几个知名项目需要放在一起比较:

| 对比维度 | UI-TARS | Claude Computer Use | OpenAI Operator |

| 开源 | ✅ 完全开源 | ❌ 闭源API | ❌ 闭源 |

| 本地部署 | ✅ 支持完全本地 | ⚠️ 需要API调用 | ❌ 必须联网 |

| 远程操控 | ✅ Remote Operator | ❌ 不支持 | ❌ 不支持 |

| MCP生态 | ✅ 基于MCP内核 | ⚠️ 部分支持 | ⚠️ 部分支持 |

| 中文文档 | ✅ 有中文版 | ❌ 全英文 | ⚠️ 有限 |

| 多模型支持 | ✅ 4+主流模型 | ⚠️ 仅Claude | ⚠️ 仅GPT |

核心优势总结:开源 + 本地部署 + MCP生态 + 多模型切换,这四点组合在一起,让UI-TARS在灵活性和可定制性上明显领先。

六、缺点和局限:别被营销带偏

Unsplash

说优点要说透,说缺点也不能藏着掖着。

⚠️ 速度问题:每次操作都需要截图 → 编码 → 发送给VLM → 等待响应 → 执行。在高端Mac上可能还好,在普通机器上这个循环会让人抓狂。一个简单的"点开设置"操作可能需要5-10秒。

⚠️ 成功率问题:论文里报告的成功率看起来不错,但那是精心挑选的演示场景。真实的网页千奇百怪,动态加载、弹窗广告、验证码等都会影响成功率。复杂任务(比如填写一个20字段的表单)中途失败是常见的。

⚠️ 成本问题:虽然模型可以切换,但如果用Claude 3.7 Sonnet API,按token计费,一个完整的机票预订任务可能消耗几十美分的API费用。比自己手动操作贵多了。

⚠️ 安全风险:让AI直接操控你的电脑是双刃剑。它能帮你订机票,也能帮你清空回收站。如果指令有误或者被恶意注入,后果难以预料。

七、快速上手:5分钟跑起来

门槛其实不高,官方给出了两种方式:npx免安装和全局安装。

# 方式1:npx 免安装直接跑(Node >= 22)

npx @agent-tars/cli@latest

# 方式2:全局安装

npm install @agent-tars/cli@latest -g

# 运行(以火山引擎豆包模型为例)

agent-tars --provider volcengine --model doubao-1-5-thinking-vision-pro-250428 --apiKey your-api-key

# 如果用 Claude

agent-tars --provider anthropic --model claude-3-7-sonnet-latest --apiKey your-api-key

运行之后会启动Web UI,在浏览器里打开127.0.0.1:8080就可以开始对话了。Desktop应用则需要去GitHub Releases下载对应平台的安装包。

✅ 推荐:国内用户首选火山引擎Doubao模型,延迟低、成本低、中文理解好。不差钱的可以考虑Claude 3.7 Sonnet,推理能力强很多。

八、典型工作流:市场调研自动化

Unsplash

说一个我实际会用的场景:竞品分析。假设你要调研"谁是国内最好的AI笔记产品",传统做法是打开十几个网站、一个个看功能对比、截图保存、手动整理。耗时2-3小时。

用UI-TARS,可以这样:

# 给Agent TARS的指令

"帮我调研这三款AI笔记产品:Notion、Obsidian、飞书笔记。

对每个产品:

1. 打开官网,了解核心功能介绍

2. 找到定价页面,记录免费版限制

3. 找到移动端支持情况

4. 截图保存关键功能截图

5. 最后整理成对比表格"

AI会自动遍历这三个网站,抓取信息,整理成结构化输出。整个过程你只需要点一杯咖啡的时间喝咖啡等着。关键是:所有操作都在你本地浏览器里发生,不会有人知道你调研了什么竞品。

九、未来展望:GUI Agent能走多远?

这是最让我思考的部分。UI-TARS代表的GUI Agent赛道,正在解决一个根本问题:AI如何与现有的图形界面交互?

历史上,我们经历了CLI时代(程序员专用)→ GUI时代(大众可用)→ 移动时代(随身计算)。每次界面范式迁移,都会诞生新的巨头公司。AI时代会不会有第四个界面范式——对话驱动一切?

| 阶段 | 界面形态 | 用户群体 | 普及时间 |

| CLI | 命令行 | 程序员 | 1970s-1980s |

| GUI | 图形窗口 | 普通用户 | 1984-2000s |

| Mobile | 触屏App | 所有人 | 2007-2015s |

| GUI Agent | AI驱动操作 | AI助手 | 2024-? |

我不认为GUI Agent会"消灭"GUI——就像GUI没有消灭CLI,只是让计算机普及到了更多用户。GUI Agent更可能成为"AI时代的新入口":你告诉AI要做什么,AI帮你操作现有应用完成。现有应用不需要改造,AI来适配它们。

长期思考:如果GUI Agent成熟,现在"复制粘贴"式的信息搬运工作将被自动化替代。那人类的时间应该放在哪里?放在判断和决策上——AI负责执行,人类负责决策。

十、适合你吗?决策树帮你判断

最后给一个实用判断框架,帮你决定要不要深入研究这个项目:

✅ 适合用UI-TARS的场景:

• 需要定期做竞品调研、数据采集(隐私敏感)

• 研发团队需要自动化测试GUI流程

• 想搭建本地AI助手,不想数据外传

• 对MCP协议有兴趣,想研究Agent架构

❌ 不适合用UI-TARS的场景:

• 只是偶尔需要操作一次电脑(学习成本不划算)

• 网络环境需要特殊配置才能访问API

• 任务需要精确到像素级操作(当前VLM精度有限)

• 对安全要求极高(任何自动化工具都有风险)

— · —

GUI Agent不是要取代你,而是替你完成那些"搬砖式"的重复操作。把时间省下来,做真正需要人类判断力的事情。

项目信息

GitHub:github.com/bytedance/UI-TARS-desktop

许可证:Apache-2.0 · 语言:TypeScript(89.1%) · Stars:32k

相关资源:Hugging Face模型 · 论文

— END —

夜雨聆风

夜雨聆风