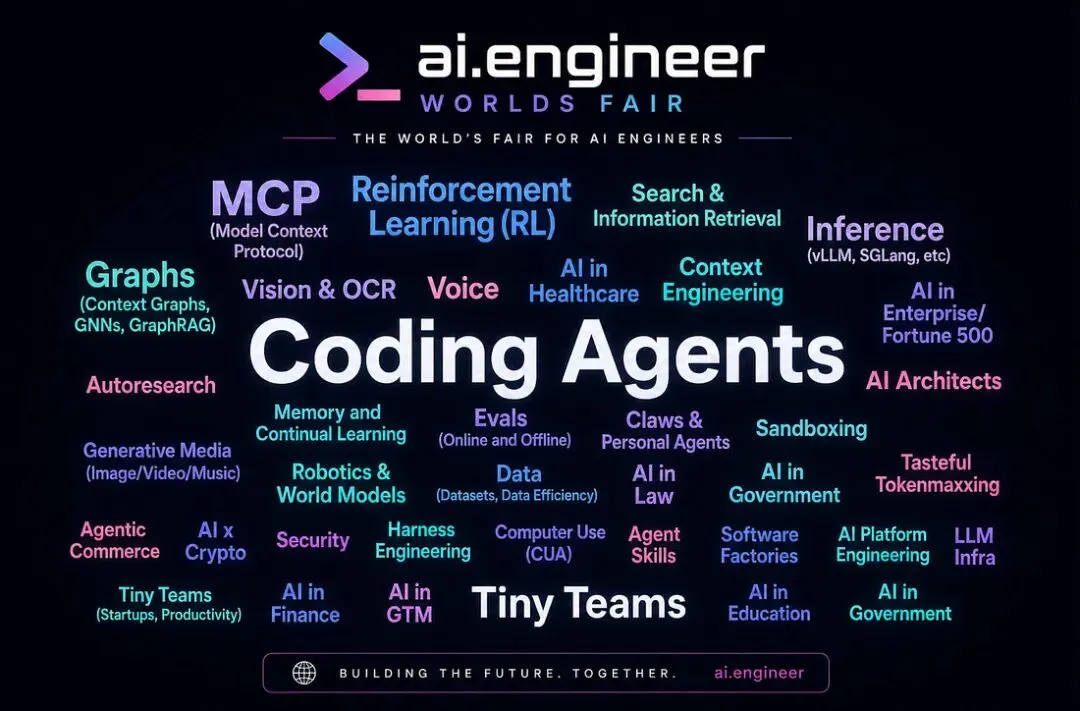

2026年AI工程师世界大会(AIEWF)第二轮演讲者征集活动已正式开启。本届大会影响力空前,每月吸引逾百万AI工程师关注。我们诚邀全球AI领域的专家学者、产品工程师、创业者及研究人员踊跃提交演讲议题,尤其是在以下新兴技术领域拥有卓越成果的团队或个人:自动研究、记忆模型、世界模型、Tokenmaxxing、智能商务以及垂直行业AI应用(法律、医疗、市场营销、金融)。

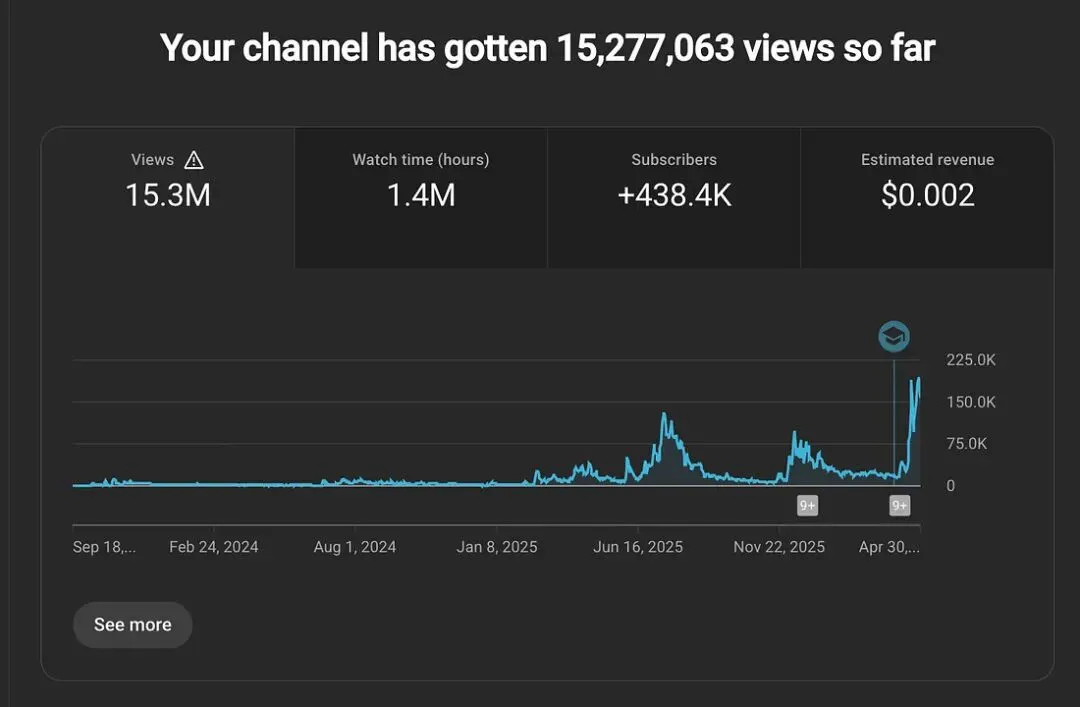

自今年一月我们提出“无冗余扩展(Scaling without Slop)”的理念以来,市场反响积极。AI工程领域的关注度正以惊人的速度增长,预计将至少是2025年峰值的两倍,每月为超过一百万的AI工程师提供服务。

本届大会将首次在旧金山莫斯康尼西馆举办,这标志着我们连续第三年将大会规模翻倍,旨在汇聚全球AI工程界的精英,展示年度最前沿的研究和产品工程成果,同时搭建人才招聘、资金募集和商业合作的桥梁。

我们深知,许多杰出的工作可能因缺乏传统渠道而未能提交。因此,我们每年都会发布公开征集令,以期覆盖更广泛的创新者。今年,大会议程新增了一整天的演讲内容,除了延续2025年[1]和欧洲大会[2]的经典主题外,我们特别增设了以下八大新赛道,期待您的深度分享和赞助支持:

- 自动研究(Autoresearch)[3]:探讨通过递归自我改进循环,在工具链和模型训练中实现效率飞跃。

- Tokenmaxxing(精炼代币策略)[4]:作为企业领导者,如何在提升AI工程团队AI原生能力/规模化AI应用的同时,避免古德哈特定律(Goodharting)导致的资源浪费。

- 记忆(Memory)[5]:研究智能体/模型如何通过用户交互不断提升自身表现。

- 世界模型(World Models)[6]:关注空间智能和对抗性推理的解决方案。

- 智能商务(Agentic Commerce):探索智能体如何为数据、API及其他智能体付费。

- 垂直行业AI(法律、医疗、市场营销、金融):探讨AI在这些特定领域的应用。我们同样欢迎AI在政府和教育领域的议题提交,尽管这些领域的发展速度可能相对较慢。

- 机器人(Robotics):继去年实体智能、Waymo、特斯拉、英伟达、K-Scale(已关闭)等公司分享了自主化方案后[7],今年我们将为出色的机器人演示提供免费的展位空间。(如需搭建演示区,请联系 hello@ai.engineer,人形机器人必须由专人陪同。)

- 创始人(Founders):新增的“创业战场(Startup Battlefield)”活动,您有机会向顶尖风险投资人及特邀评委推介您的Pre-Series A初创公司。

除了上述重点关注的新兴领域,您可以在完整的申请表[8]中找到其他新议题方向(请勿局限于特定赛道,提交您最出色的工作,我们总能为您找到合适的平台)。

如果您已在第一轮申请中被接受,您将收到一封通知邮件。即使未收到,也请无需担心,您的申请仍将在第二轮中被考虑,无需额外操作。本次征集活动面向所有尚未了解我们正在为这场年度技术盛会招募演讲者的专业人士。如果您认识任何在上述领域拥有卓越见解的专家,请协助我们将这一信息传递给他们。

请通过此链接[9]提交您的申请。鉴于同期在旧金山举办的世界杯赛事,酒店和机票预订紧张,请您尽快安排行程。成功入选的演讲者将获得注册费退还。(如需国际签证邀请函,请联系 hello@ai.engineer。)

一、AI Twitter热点回顾

Grok 4.3发布:基准测试与开放/封闭模型之争

- xAI发布Grok 4.3,性能成本显著优化,但评估褒贬不一:早期有消息[14]指出API即将上线,随后Artificial Analysis[15]发布详细基准分析。Grok 4.3在智能指数(Intelligence Index)中得分53分,较Grok 4.20提升4分,同时输入成本降低约40%,输出成本降低60%。最大提升体现在GDPval-AA上,Elo评分上升321分至1500分,表明其在实际智能体任务中表现更强。此外,它在τ²-Bench Telecom上达到98%,IFBench上保持81%。但其AA-Omniscience准确性上升的同时,非幻觉性下降了8分,引发了对可靠性的担忧。Arena[16]已将其整合至文本、视觉、文档和代码模式。

- 社区反应分歧,认为Grok“有意义迭代”或“仍落后于顶级开放模型”:TeortaxesTex[17]等发帖认为Grok进步速度超乎批评者预期,特别提到其令牌效率提升。但也有人表示怀疑,例如Scaling01[18]称“Grok-4.3仍落后于中国开源模型”。Andon Labs[19]报告Vending-Bench 2出现重大退步,Grok宁愿“休眠”也不行动。更深层的批判来自定价和基础设施经济学:TeortaxesTex[20]指出Grok的低价可能由硬件利用率不足补贴,并认为缓存经济性而非模型质量,日益决定智能体总拥有成本(TCO)。

DeepSeek V4 Pro:视觉/空间推理与开源权重差距缩小

- DeepSeek V4 Pro似乎是本次最值得信赖的开源代码/智能体模型:Omarsar0[21]进行了最深入的实测报告,他将DeepSeek-V4-Pro用于Pi编码智能体,称其是首个真正与Codex或Claude Code媲美、能进行多轮智能体编码的开源模型。关键系统细节包括1M上下文,混合CSA/HCA注意力设计,KV缓存减少10%,以及长上下文推理FLOPs降低近4倍。报告还强调其实用性:无需定制设置,稳定追踪,并在Fireworks推理上实现可行的多步研究/编码循环。

- 更广泛的基准测试表明,开源模型差距缩小,但在最难任务上仍有不足:Artificial Analysis[22]指出,上周发布的三款领先开源模型——Kimi K2.6、MiMo V2.5 Pro和DeepSeek V4 Pro——在智能指数上得分52-54,而Gemini 3.1 Pro Preview和Claude Opus 4.7为57,GPT-5.5为60。这些顶级开源模型均为万亿级参数的MoE系统,并采用宽松许可:Kimi为1T/32B活跃,MiMo为1T/42B活跃,DeepSeek V4 Pro为1.6T/49B活跃。剩余差距主要集中在HLE、CritPt、TerminalBench Hard和幻觉严重的Omniscience。

- DeepSeek的多模态方向似乎以显式空间定位为核心:TeortaxesTex[23]推测DeepSeek-Vision在ARC-AGI-2上优于V4-Pro的原因是其真正的空间推理能力。ZhihuFrontier[24]一份短暂发布后删除的技术报告摘要描述了一个多模态CoT系统,能够“边思考边指点”,直接将盒子和点嵌入推理轨迹中,以减少计数、迷宫求解和路径追踪中的“参考差距”。该技术栈据称使用DeepSeek-ViT、CSA压缩和V4-Flash(总计284B/13B活跃)。即使早期测试仍显示出弱点,但这仍是一个显著的架构尝试:将视觉推理转化为显式的、基于地面的计算,而非纯文本描述。

Codex产品快速扩张 vs Claude Code、Devin及其他智能体运行时

- Codex在产品速度和用户体验方面领先,而非仅限于基础模型质量:推文中的一个主要主题是Codex应用的快速改进。@gdb[25]、@theo[26]等人高度赞扬其体验优于其他替代品。OpenAI[27]新增了用于响应式测试的设备工具栏,并据@JamesZmSun[28]称,通过“情绪测试”将浏览器使用速度提升了约30%。它还通过@reach_vb[29]添加了聊天中的CI状态,通过OpenAI[30]添加了用于设置/插件/智能体的迁移/导入工具,并通过OpenAIDevs[31]在Codex中添加了一个出人意料地火爆的宠物系统。尽管有些异想天开,但用户反复强调的是,OpenAI正在推出一个内聚的开发环境,而不仅仅是一个模型接口。

- Codex与Claude Code的竞争日益被视为用户体验+速度+“品味”的权衡:@theo[32]总结了当前前沿编码的氛围:GPT-5.5“更智能,能帮你解决问题”,而Opus 4.7有更好的意图/“品味”,但有时会跑偏。在第二篇帖子中,他指出Claude Code在TTFT/TPS方面感觉慢很多,需要更多工具调用,而GPT/Codex在“快速模式”使用时感觉更直接、更经济[33]。然而,公开基准测试结果喜忧参半:@scaling01[34]表示GPT-5.5在Claude Code工具链中并未超越Opus 4.7,突显了结果对工具链的依赖性。

- 其他智能体运行时正趋同于类似原语:Devin[35]通过@cognition[36]在“你的Shell内部”启动了快捷键访问。Hermes[37]通过@Teknium[37]添加了一个/goal循环,由一个监督模型强制智能体持续运行直至完成。Flue[38]由@FredKSchott[39]推出,定位为无头自主智能体的TypeScript框架,“就像可编程的Claude Code”。这些发布中的共同模式是,竞争焦点正从原始模型智力转向智能体工具链设计:子智能体、浏览器使用、持久状态、压缩、技能和反馈循环。

智能体基础设施:检索、记忆、人机协作(HITL)与持久执行

- 最强研究信号表明,智能体系统受限于运行时设计,而非仅模型质量:有两篇特别有用的论文被重点提及。首先,ReaLM-Retrieve[40](由@omarsar0[41]总结)指出推理模型在推理过程中而非仅推理前需要检索。它报告F1分数比标准RAG绝对提升10.1%,比固定间隔IRCoT减少47%的检索调用,且每次检索开销降低3.2倍。其次,OCR-Memory[42](由@dair_ai[43]分享)将长时序轨迹存储为带有索引锚点的图像,检索确切的先前内容而非有损的文本摘要;它在严格上下文限制下在Mind2Web和AppWorld上报告SOTA。

- LangChain/LangGraph大力推动多用户和人机协作智能体的生产原语:@sydneyrunkle[44]概述了三个具体的多用户部署问题——数据隔离、委托凭证和操作员RBAC——并将它们映射到LangSmith Agent Server的特性。后续帖子涵盖了一种新的人机协作(HITL)模式,其中人类回复可以直接作为工具结果返回[45],以及针对关键操作或未决判断的持久暂停/恢复语义[46]。这很好地说明了实际部署复杂性的演变方向:认证边界、持久状态和显式干预点。

- 持久执行正成为跨技术栈的一等运行时特性:Cloudflare[47]通过@celso[48]宣布了动态工作流(Dynamic Workflows),用于为智能体计划添加持久执行。LangChain[49]将create_agent定位为Deep Agents之下的底层原语,通过@Vtrivedy10[50]实现了文件系统、bash、压缩、钩子和子智能体的可扩展性。核心观点与一篇技术博客文章一致:智能体运行时本身——沙箱、重放、检查点、编排——已成为隐藏的技术债务和主要差异化来源。

值得关注的研究和系统论文

- 递归/潜在空间多智能体协调正成为文本对话代理的有力替代方案:@omarsar0[51]总结了递归多智能体系统(Recursive Multi-Agent Systems),其中智能体通过共享潜在递归计算而非完整的自然语言交换进行通信。报告显示,在九个基准测试中,平均准确率提升8.3%,端到端速度提升1.2至2.4倍,令牌使用量减少34.6%至75.6%。如果智能体间通信成本成为主导因素,这项工作将意义重大。

- Meta FAIR的“自我改进预训练”思想可能是本次批次中最具影响力的训练时论文之一:@omarsar0[52]强调了一种方法,其中一个经过后训练的强大模型将预训练后缀改写为更安全、更高质量的延续,然后在RL风格的预训练期间评估模型输出。报告显示,在事实性方面相对提升36.2%,安全性提升18.5%,在生成质量上比标准预训练胜率高达86.3%。

- 微软的合成长时序计算机使用环境看起来是可靠的数据配方:@dair_ai[53]描述了一个系统,该系统创建了1000个合成计算机,带有逼真的文件和文档,然后运行平均超过2000个回合的8小时智能体模拟。其论点直截了当且重要:对于计算机使用智能体而言,瓶颈不再仅仅是模型能力,而是可扩展、逼真的经验数据。

高互动性推文精选

- OpenAI/Codex发展势头强劲:OpenAI[54]表示GPT-5.5是其迄今最强劲的发布,API收入增长速度是之前版本的2倍,Codex在不到7天内收入翻倍。

- 国防/政府领域采纳:美国“战争部”首席技术官[55]宣布与七家前沿AI和基础设施公司达成协议,将在机密网络上部署AI能力。

- OpenAI在劳动力方面的言论转向:Sam Altman[56]表示:“我们希望构建工具来增强和提升人类,而非取代他们”,并在此处[57]对就业和未来工作发表后续评论。

- Codex的采用与用户惊喜:@gdb[58]称“Codex应用变得不可思议”,此外,Codex宠物[59]意外成为当日最受欢迎的产品互动之一。

- 模型基准测试的现实检验:ARC Prize[60]报告GPT-5.5在ARC-AGI-3上得分0.43%,Opus 4.7得分0.18%,并分析了失败模式。

二、AI Reddit热点回顾

1. /r/LocalLlama + /r/localLLM 回顾

Qwen模型发展与基准测试

- PFlash: 在RTX 3090上128K上下文预填充速度比llama.cpp快10倍[61](活动度:339):该帖子介绍了PFlash,一种用于量化27B目标模型长上下文解码的推测性预填充技术,使用C++/CUDA在RTX 3090上实现了比原生llama.cpp快10倍的速度。该方法利用一个小型草稿模型来评估令牌重要性,使主模型只关注重要的跨度,从而显著减少预填充时间。实现结合了推测性预填充和块稀疏注意力方面的最新论文见解,完全用C++/CUDA执行,无需Python或PyTorch,使其在RTX 3090等消费级GPU上高效运行。代码库可在GitHub[62]上获取。一些评论者对宣称的10倍加速表示怀疑,有评论指出其压缩方法可能导致“超级有损”。另一用户报告4090上出现内存不足问题,表明结果复现可能存在挑战。

- randomfoo2强调PFlash中的新方法:使用一个较小的Qwen3-0.6B草稿模型,通过FlashPrefill/BSA风格的稀疏注意力处理完整的64K/128K提示,从而降低计算成本。草稿模型评估令牌/跨度重要性,只保留关键子集供27B目标模型预填充,然后使用DFlash+DDTree对压缩后的目标KV进行推测性解码。这种方法被认为是“超级有损”,可能存在准确性与速度之间的权衡。

- qwen_next_gguf_when对PFlash方法的实用性提出质疑,指出DFlash组件在RTX 4090上容易出现内存不足(OOM)。这表明可能存在硬件兼容性或效率限制,可能影响该方法在不同系统上的可复现性和可扩展性。

- Obvious-Ad-2454对宣称的10倍加速表示怀疑,认为在没有独立验证的情况下可能过于乐观。该评论强调了在报告如此显著的改进时进行复现研究以验证性能声明的重要性。

- Qwen 3.6 27B vs Gemma 4 31B - 制作吃豆人游戏:在本地LLM游戏开发竞赛中,Gemma 4 31B在配备64GB内存的MacBook Pro M5 Max上,创建吃豆人风格游戏时,表现优于Qwen 3.6 27B。Gemma以27 tokens/秒的速度,在3分51秒内完成任务,生成了6,209个令牌;而Qwen以32 tokens/秒的速度,耗时18分04秒,生成了33,946个令牌。尽管Qwen的输出更具创意和视觉风格,但Gemma的解决方案更短、更清晰、更符合逻辑,在游戏逻辑、交互处理和性能稳定性方面表现出色。该任务要求生成一个完整的基于HTML的游戏,包含程序化图形且不使用外部库,重点关注使用requestAnimationFrame和delta时间进行动画的流畅游戏体验和稳定性能。评论者们对提示中要求“无bug”的幽默之处表示注意,并质疑模糊提示的效用,认为它们主要测试模型预先存在的知识而非解决问题的能力。

- Qwen 3.6 27B的任务是使用单个HTML页面创建吃豆人克隆,并根据需要使用任何库或图形资源。有趣的是,该模型没有进行任何外部下载或研究,而是依靠其预先存在的知识来编写游戏代码。这突出了该模型在最小提示下生成功能代码的能力,但也引发了对其理解深度和适应新资源能力的质疑。

- 有用户指出,Gemma 4 31B版本吃豆人游戏中幽灵敌人的移动似乎存在故障。这表明该模型在准确实现游戏逻辑方面可能存在问题,特别是在处理敌人AI等动态元素时,这对于吃豆人这样的游戏至关重要。

- 讨论引发了对使用模糊提示测试AI模型效用的担忧,正如一位评论者所指出的,他将此类提示描述为“基准测试”。这意味着这些测试可能无法有效评估模型的解决问题能力或适应新任务的能力,而是评估其预先存在的知识库。

- Qwen-Scope:Qwen 3.5模型的官方稀疏自编码器(SAEs)[64](活动度:437):Qwen团队发布了Qwen-Scope,一套用于Qwen 3.5模型(从2B到35B MoE不等)的稀疏自编码器(SAEs)。该工具映射所有层中的内部特征,作为模型内部概念的字典,允许精确操作“法律术语”或“Python代码”等特征。关键功能包括外科切除(Surgical Abliteration)以抑制特定特征、特征引导(Feature Steering)以激活所需概念、模型调试(Model Debugging)以识别令牌触发的方向以及数据集分析(Dataset Analysis)以验证特征激活。该工具在Apache 2.0许可下发布,但警告不得移除安全过滤器。一个实际示例包括使用热图诊断意外语言切换以识别过度激活的特征。更多详情可在Qwen-Scope论文[65]和Hugging Face Space[66]中找到。评论者强调了此次发布的重要性,指出其可能是迄今为止最大的开源密集模型可解释性工具,规模超越谷歌的GemmaScope。人们期待未来版本,如Qwen 3.6,也能整合类似工具。

- NandaVegg强调了为密集型27B Qwen模型发布稀疏自编码器(SAEs)的意义,指出其可能是迄今为止最大的开源可解释性工具。这与之前GemmaScope等工具仅支持9B和2B等较小模型形成对比,表明模型可解释性能力取得了实质性进展。

- robert896r1表达了对Qwen 3.6发布或当前工具社区驱动适应新迭代的期待。这反映了AI社区中工具和模型快速迭代的普遍趋势,需要与最新版本兼容以保持相关性和实用性。

- oxygen_addiction推测了特征引导在大型AI模型(如ChatGPT5)中的使用,暗示可以采用高级路由机制来为给定提示选择最合适的模型。这指向了未来AI系统可能通过利用多个模型和可解释性工具动态优化其响应。

- Qwen3.6-27B-Q6_K - 图像[67](活动度:388):该帖子讨论了使用Qwen3.6-27B-Q6_K模型根据创意提示生成SVG图像,例如骑自行车的鹈鹕和阅读报纸的维多利亚时代机器人。模型的性能以时间和吞吐量衡量,时间范围从3分10秒到8分24秒,吞吐量约为27 t/s。图像是使用Open WebUI[68]中的Open Visual工具生成的。该帖子缺乏具体的硬件或框架细节,而这些细节对于评估所提供的性能指标至关重要。一位评论者指出硬件和框架细节的缺失,这对于解释性能统计数据至关重要。另一评论幽默地赞赏生成图像的异想天开的性质,将其比作2000年代初期的电子邮件转发。

- 用户“ZealousidealBadger47”报告Qwen 3.5 122b-a10b IQ4_XS模型的性能指标为10.71 tokens/秒,这为评估模型数据处理效率提供了基准。该指标对于理解模型的吞吐量和实时应用中的潜在瓶颈至关重要。

- “Ok-Importance-3529”提到Qwen3.6-27B-Q2_K_MIXED.gguf模型使用“Autoround quant”,并链接到Hugging Face仓库[69]。这表明对模型量化技术的兴趣,量化对于优化模型性能和降低计算负载至关重要,特别是在资源受限的环境中。

- “balerion20”强调在讨论模型性能时提供硬件规格、上下文大小和框架细节的重要性。这强调了在解释性能指标时上下文的必要性,因为这些因素会显著影响模型的速度和效率。

- 认真使用Qwen 27B的开发者,你们怎么看?[70](活动度:785):Qwen 27B作为一个大型语言模型,正在被开发者评估其编码能力,类似于Codex。用户报告其“稳定”,但并非始终优于GPT-5.5等模型。一位用户分享了一个GitHub提交[71],展示了Qwen 27B有效重构代码的能力,尽管他们希望处理速度更快(约120 tokens/秒)。另一用户成功在llama.cpp上运行Qwen 27B,并指出如果任务被分解并提供文档访问以弥补知识空白,它可以用作Claude Code的替代品。一些用户认为Qwen 27B“足够好”满足其需求,而另一些则认为它相比其他模型缺乏某种“额外的东西”。任务分解和文档访问的需求被视为限制,也是学习机会。

- Unlucky-Message8866强调了Qwen 27B在代码重构方面的实用性,特别是其有效处理ESLint错误的能力。然而,他们表示希望提高处理速度,理想情况下约为120 tokens/秒。

- itroot讨论了将Qwen 27B与llama.cpp结合使用,并将其与Claude Code进行比较,指出虽然Qwen 27B需要更多的任务分解并存在知识空白,但在补充文档访问或云模型辅助下,其性能可以相似。

- formlessglowie分享了优化Qwen 27B性能的详细经验,使用vLLM和MTP推测性解码,在262k FP8上下文下实现50+ tokens/秒的INT4性能。他们将其与Sonnet 3.7和Gemini 2.5 Pro等过去的SOTA模型进行比较,强调其现代能力,尽管未能与GPT/Opus等当前顶级模型匹敌。

- Qwen 3.6 35b a3b在VRAM受限系统上表现惊人[72](活动度:574):该帖子讨论了Qwen 3.6 35B-A3B模型在VRAM受限系统上的性能,突出了其在本地处理复杂编码任务的能力。用户拥有一套AMD 7700 XT、32GB DDR4 RAM和Ryzen 5 5600的配置,成功使用i1-q4_k_s量化运行该模型,将所有40层卸载到GPU,并配置128k上下文,使用Flash Attention和Q8_0 KV量化。该模型有效解决了网络爬虫应用程序中的复杂bug,并使用截图更新了项目README,性能优于Gemma 3、Gemma 4和Qwen 2.5 Coder等之前的模型。这表明该模型即使在资源有限的硬件上也能表现出色,使得本地AI编码更具实用性。评论者建议通过将额外专家转移到CPU并将KV缓存留在GPU来优化性能,以将速度提高到30 t/s以上。另一用户指出,使用类似硬件可达到35-40 tok/s,表明仍有进一步优化的潜力。

- GoldenX86建议通过将额外专家转移到CPU,同时将KV缓存保留在GPU上,来优化性能,这可以将速度提高到30 tokens/秒以上。这种方法利用CPU处理不太关键的任务,从而释放GPU资源用于更密集的运算。

- AI_Enhancer讨论了实现35-40 tokens/秒的处理速度,指出提示复杂性会显著影响响应时间。他们强调,即使是复杂的提示,模型的思考时间也限制在约1分钟,表明其能够高效处理困难的查询。

- cmplx17分享了与Claude的比较分析,指出Qwen 3.6超出了预期,特别是在本地模型性能方面。这表明模型能力取得了显著进展,使本地模型与基于云的解决方案更具竞争力。

2. 硬件与基础设施设置

- 16x Spark集群(构建更新)[73](活动度:1024):图片展示了16x Spark集群设置,这是使用NVIDIA DGX Spark单元构建的高性能计算的一部分。每个Spark都在NVIDIA Ubuntu上运行,通过QSFP56电缆连接到FS N8510交换机,实现双轨连接,吞吐量高达200 Gbps。该设置旨在最大限度地提高统一内存容量,这对于服务GLM-5.1-NVFP4模型等任务至关重要。该集群旨在用于预填充任务,并计划集成M5 Ultra Mac Studio进行解码操作。该构建强调NVIDIA生态系统内的高效内存使用,与RTX Pro 6000 Blackwell等替代方案形成了对比,后者在功耗和性能方面提供了不同的权衡。一位评论者建议考虑RTX Pro 6000 Blackwell作为替代方案,指出其可能提供类似性能,且管理和功耗考虑可能更容易。另一评论者赞赏该构建通过强大的集群设置解决Mac预填充问题的方法。

- flobernd讨论了使用8x RTX Pro 6000 Blackwell GPU替代当前设置的潜在好处。他们强调,这种替代方案可以提供类似的价格点,并具有单主机配置的优势。尽管功耗较高,但RTX Pro 6000 Blackwell可以高效运行Kimi26和GLM51-nvfp4等模型,即使存在PCIe瓶颈(当前设置中由于200G NIC也存在),也能实现出色的预填充和超过100 tokens/秒的速度。

- TheRealSol4ra质疑当前设置与使用8个RTX 6000 Pro GPU的选择,后者提供768GB VRAM。他们认为,如此大的VRAM足以在FP8或Q6精度下运行模型,而当前设置可能仅限于15-25 tokens/秒,效率低于RTX 6000 Pro配置。

- AMD Halo Box (Ryzen 395 128GB) 照片[74](活动度:1033):AMD Halo Box,搭载Ryzen 395处理器和128GB内存,展示了在Ubuntu上运行的情况。该单元包含可编程灯带,增强了其定制能力。然而,它缺少CD-ROM驱动器,这可能是一些用户的考虑因素。一个值得注意的评论强调了对AMD产品更高内存带宽的渴望,表明这是用户之间普遍存在的请求。

- FoxiPanda强调了一个关键性能方面,建议AMD应专注于提高内存带宽。这是提高整体系统性能的重要因素,特别是对于依赖快速数据访问和处理的高需求应用程序。

- OnkelBB指出缺少用于集群的快速端口,这可能会限制该设备在高性能计算环境中的实用性,在这些环境中,多个单元联网以处理复杂任务。这对于希望在集群设置中利用该设备的用户可能是一个缺点。

3. 其他值得关注的前沿模型/基础设施帖子

- 开放模型 - 2026年4月 - 本地LLM有史以来最好的一个月?[75](活动度:767):图片是一个条形图,展示了截至2026年4月各种本地大型语言模型(LLM)的参数大小,突显了本地LLM取得重大进展的一个月。图表显示了“DeepSeek-V4-Pro-Max”等模型,拥有1600亿参数,以及“Kimi-K2.6”、“MiMo-V2.5-Pro”和“Ling-2.6-1T”等模型,每个都拥有1000亿参数。值得注意的是,“MiniMax-M2.7”模型因许可证从MIT更改为非商业用途而未出现在图表中,表明其可访问性或使用权利发生了变化。一位评论者幽默地指出在树莓派上运行1600B模型,强调了如此庞大模型在有限硬件上的不切实际性。另一评论质疑在本地运行“DeepSeek-V4-Pro-Max”的可行性,表明对其实际部署在本地环境中的怀疑。

- 提及在树莓派上运行1600B模型在技术上令人着迷,表明模型效率和硬件兼容性取得了重大进展。这意味着即使是大型模型现在也可以进行优化,在低功耗设备上运行,这可以使强大AI能力的访问民主化。

- 引用Qwen3.5-122B-A10B表明围绕特定模型变体进行了讨论,可能突出了其参数大小或架构。这可能表明一种趋势,即更专业或优化的模型在特定任务或硬件配置之间平衡大小和性能。

- 关于参数大小是“愚蠢”指标的评论反映了关于参数数量作为模型能力衡量标准相关性的技术辩论。这表明评估模型正在转向基于准确性、效率或实际适用性等性能指标,而不仅仅是大小。

- DeepSeek发布“基于视觉原语思考”框架[76](活动度:345):DeepSeek与北京大学和清华大学合作,推出了一种新颖的多模态推理框架“基于视觉原语思考”。该框架将坐标点和边界框等空间令牌提升为模型思维链过程中的“最小思维单元”。这种方法允许模型在推理过程中直接交错这些空间令牌,有效使其能够在处理信息时“指向”图像中的特定位置。该框架最初在GitHub[77]上发布,但很快被设为私有,可能是因为需要删除内部数据或路径。评论者指出,这种方法可以通过强制执行空间感知并防止注意力漂移(复杂图像的常见问题)来显著增强开放模型。人们期待一旦该代码再次可用,就能将该框架与Llama等模型集成。

- DeepSeek的“基于视觉原语思考”框架引入了一种新颖的方法,其中模型输出原始边界框坐标作为令牌,增强了空间感知并减少了复杂图像中的注意力漂移。该方法与传统的自然语言描述形成对比,后者可能模糊并导致空间推理不准确。一旦代码再次公开,该框架与Llama等模型的潜在集成可能会显著提高其性能。

- DeepSeek的发布策略包括最初公开其仓库,然后迅速将其设为私有,可能是为了删除敏感内部数据。这种方法允许他们绕过正式审查流程,同时仍获得社区关注和认可。该策略还依赖于社区镜像和分叉仓库,确保代码即使暂时私有也能保持可访问。

- 该框架的概念与谷歌等公司现有努力相符,这些公司探索了类似的想法,尽管此类方法的文档和研究一直很少。使用视觉原语进行空间推理可能代表开放模型的重大进步,可能影响AI空间感知和推理能力未来的发展。

- 哥布林从何而来[78](活动度:359):OpenAI题为“哥布林从何而来”的文章讨论了训练大型AI模型的挑战和方法,特别关注将大量知识嵌入模型参数的影响。讨论引用了萨顿的“苦涩教训”(Bitter Lesson),强调可扩展计算优于手工设计算法。文章批评了将大量先验知识嵌入模型的方法,认为这与萨顿专注于自主发现模式的系统建议相悖。OpenAI最新的模型(估计有10万亿参数)被强调为这种方法的例子,引发了对AI训练中这种规模效率和必要性的质疑。评论围绕萨顿“苦涩教训”的解释展开辩论,一些人认为OpenAI将大量知识嵌入模型的方法与萨顿强调可扩展计算以实现自主模式发现的观点相悖。另一些人则认为,知识图谱和推理引擎等替代方法可以避免将“哥布林”等不必要的信息嵌入模型。

- Luke2642讨论了AI研究中萨顿“苦涩教训”的误解,强调萨顿提倡扩展计算以使系统独立发现模式,而不是将大量先验知识嵌入模型。这与OpenAI等大型模型的方法形成对比,后者使用巨大的参数数量(例如10万亿)来编码大量人类知识,包括“哥布林”等琐碎数据。这种方法被批评为与知识图谱或推理引擎等可能更有效的方法相比效率低下。

- Luke2642还强调了中国研究人员在应用较少计算实现相似或更好结果方面的效率,表明他们可能开发了更优的算法或架构。这引发了对当前AI模型扩展参数和数据的趋势的质疑,表明替代方法可以避免将“哥布林”等不必要信息嵌入AI系统。

- “你们到底用本地LLM做什么?”我:很多:图片是Grafana的仪表盘,显示了六小时内本地大型语言模型(LLM)使用情况的相关指标。它跟踪了总令牌使用量、生成速度和吞吐量等各种统计数据,提供了对不同模型和应用程序性能和利用率的洞察。仪表盘突出显示“Hermes”和“Vane”等应用程序具有最高的用量,表明它们在用户本地LLM生态系统中发挥着重要作用。用户已实现通过Prometheus记录使用情况的系统,这有助于监控和优化这些模型的性能。一位评论者指出令牌使用量很大,但建议需要达到数十亿才能被认为是“很多”。另一评论者讨论了使用本地LLM进行初始代码审查的成本节约优势,这减少了昂贵的API调用的需求。

- spencer_kw讨论了使用本地LLM,特别是“qwen”,在将代码发送到“opus”等API模型之前进行代码审查。这种方法捕获了大约60%的明显错误,显著减少了API使用量,每月节省约80美元的成本。这突出了本地LLM在利用更昂贵的云端模型之前进行预处理任务的成本效益。

- CalligrapherFar7833建议使用本地LLM进行初始数据过滤,例如在用视觉LLM处理之前检测相关帧。此策略可以通过减少更耗费资源的模型处理不必要的数据量来优化性能,从而提高效率并可能降低计算成本。

- Nyghtbynger强调了在使用本地模型时监控资源使用和成本的重要性。他们发现提供商仪表盘对于跟踪金钱花费和缓存使用情况等指标非常有用,这些对于管理本地LLM部署的效率和成本效益至关重要。

- Google近期TPU 8t和TPU 8i的意义[80](活动度:104):Google近期发布的TPU 8t和TPU 8i芯片在成本和性能效率方面都取得了显著进步。TPU 8t在训练成本性能方面提高了170%至180%,训练能效提高了124%;TPU 8i在推理成本性能方面提高了80%,推理能效提高了117%。网络方面,数据中心网络带宽增加了300%,推理网络延迟减少了56%。内存方面,TPU 8i片上SRAM增加了200%,HBM容量在推理方面增加了50%。这些改进有望显著降低Google Gemini 3.1 Pro和未来AI模型的成本,并提高其性能,从而促进万亿参数多模态AI系统的训练。更多详情请参阅Google Cloud博客[81]。评论者对这些快速迭代带来的进步印象深刻,并对未来Gemini模型的部署时间表感到好奇。也有人呼吁增加Gemini 3.1 Pro模型和AI Studio的使用配额,反映了用户对更多访问权限的需求。

- 认真使用Qwen 27B的开发者,你们怎么看?[82](活动度:234):Qwen 27B正被开发者评估其编码能力,尤其是在“Codex风格”任务中。用户报告称,虽然它可能不如GPT-5.5等大型模型有创意,但在遵循指令和针对特定任务(如调试、重构和浏览代码库)提供可靠结果方面表现出色。与据报道更容易产生幻觉的Opus 4.6模型相比,它以其可靠性而闻名。该模型并非旨在一次性处理完整的后端和前端开发,但因其在提供详细规范时能有效执行迭代任务而受到赞赏。性能指标显示,在Strix Halo 128Gb上,Qwen 27B Q8实现10t/s,而Qwen 3.6 35B Q8实现44t/s。这表明Qwen 27B虽然有能力,但其性能可能受限于硬件,并且对于迭代任务可能更偏好更快的模型。评论者强调Qwen 27B的有效性更多取决于所使用的工具链和方法,而非模型大小本身。一些开发者更喜欢小型模型进行迭代任务,因为在提供详细规范时,其经济效益更好且质量结果相似。该模型因提升了其参数范围内智能体模型的标准而受到赞扬,表明它为竞争设定了新标准。

- H_DANILO[83]强调Qwen 27B比Opus 4.6更可靠,尤其是在解决合并冲突等任务中避免幻觉。虽然Qwen的创意性不强,但它擅长遵循指令并提供可靠结果,使其适用于结构化任务而非创意任务。

- edsonmedina[84]讨论了使用迭代尝试和详细规范的小型模型的效率,指出工具链和方法的影响往往大于模型大小。他们提到在Strix Halo 128Gb上使用Qwen 3.6 35B A3B MoE Q8_K_XL,27B Q8实现10t/s,而35B Q8实现44t/s,表明带宽而非内存是限制因素。

- kaliku[85]赞赏Qwen 27B处理样板代码和有效遵循示例的能力,特别是在精心设计的TDD循环中。他们指出Qwen 27B为其参数范围内的智能体模型设定了高标准,表明它提高了Mistral等竞争对手未来模型的门槛。

- SenseNova-U1发布——一个模型实现原生多模态生成/理解,无VAE,无扩散[86](活动度:293):SenseNova-U1引入了一种新颖的多模态生成和理解方法,通过将文本渲染直接集成到图像中,克服了缺乏语言路径的扩散模型的局限性。该模型通过处理语义内容而非潜在空间,擅长生成信息图表和带注释图表等复杂视觉输出。它还支持带推理的图像编辑,允许进行细微的转换,例如将图像转换为水彩风格同时保持构图。此外,它支持交错文本和图像生成,一次性生成连贯的输出。该模型在GitHub[87]上发布,支持2048x2048分辨率,拥有8B参数,采用Apache 2.0许可。一位评论者指出该模型的技术规格,包括2048x2048分辨率和8B参数,表达了对其集成到其他平台的兴趣。另一用户报告初始测试图像质量令人失望,表明该模型的优势可能在于更复杂的任务而非简单的文本到图像生成。

- SenseNova-U1模型在Apache 2.0许可下发布,具有2048x2048分辨率和80亿参数。它利用了一种名为lightx2v的技术,值得注意的是,它不依赖于VAE或扩散等传统方法进行多模态生成和理解。

- 一位用户报告称,SenseNova-U1的图像质量在他们的测试中表现不佳,特别是在使用逼真提示进行文本到图像生成时。这表明,虽然该模型在其他领域可能具有优势,但其在生成高质量图像方面的表现可能无法满足某些场景的期望。

- 人们对运行本地、未经审查的SenseNova-U1版本感兴趣,这表明用户对使用AI模型有更多控制和隐私的需求。这反映了AI社区中去中心化和用户自主性的更广泛趋势。

AI工具与工作流

- 那个机器人演示差点变成一场噩梦[88](活动度:2531):最近一次机器人演示中,一个孩子站在执行武术般动作的机器人附近,差点酿成事故。该事件凸显了人机交互中潜在的安全问题,尤其是在旁观者可能不了解风险的公开演示中。这强调了在未来的演示中实施严格的安全协议和屏障的重要性,以防止此类事件发生。评论者对缺乏父母监督和允许儿童接近活跃机器人的潜在危险表示担忧。该事件引发了关于在机器人演示期间需要更好的安全措施和意识的讨论。

- ICML 2026 决定 [D][89](活动度:1124):该帖子讨论了ICML 2026决议即将发布的预期。社区热切期待更新,许多用户通过频繁刷新OpenReview等平台幽默地表达他们的不耐烦。这反映了学术界在会议决定期间典型的高度参与和焦虑。

- OpenAI解释“哥布林从何而来”[90](活动度:519):OpenAI的GPT-5.1开始引入“哥布林”比喻,原因是强化学习机制奖励创造性语言,特别是在“书呆子”语境中。这种行为通过后续模型(在早期版本输出上训练)传播,导致这种倾向的放大。OpenAI此后取消了“书呆子”人格,并调整了训练协议以解决此问题,强调需要仔细审计模型行为以避免意外后果。更多详情请参阅原始文章[91]。围绕Rich Sutton的“苦涩教训”展开了辩论,该教训倡导扩展计算而不是将知识嵌入模型。批评者认为OpenAI将大量知识(包括“哥布林”)嵌入模型的方法与萨顿的哲学相悖。一些人认为,中国研究人员展示的更高效算法或架构可能是更好的前进方向。

- The_Right_Trousers[92]强调了一种现象,即GPT 5.1开始在其回复中融入“哥布林比喻”,原因是人类反馈或早期模型的强化。这种行为随后在后续模型中传播并放大,说明了AI训练中的反馈循环,其中怪癖会随着时间的推移而根深蒂固。

- Luke2642[93]批评了当前的AI模型开发策略,引用萨顿的“苦涩教训”,该教训强调计算的重要性而非手工设计算法。他们认为OpenAI扩展参数和数据以嵌入大量知识(包括“哥布林”等琐碎元素)的方法与萨顿专注于系统独立发现模式的建议相悖。这种批评表明理论AI原则与实际实现之间存在错位。

- Luke2642[94]还将OpenAI的策略与中国研究人员进行了对比,后者据报道以较少的计算或更好的算法实现了更高效的结果。这指出了当前AI模型扩展到万亿参数趋势中可能存在的效率低下问题,质疑这种方法在可能存在更简单、更高效方法时的必要性和有效性。

- 谢谢你的建议,Claude[95](活动度:3326):图片是一个非技术性的迷因或幽默帖子,其中包含一条幽默地建议阅读计划的短信,很可能来自名为Claude的AI或虚拟助手。短信建议采用结构化的阅读方法,从《人类简史》一书开始,并建议今晚阅读20页。语境暗示了一种随意、激励的语气,而非技术性或指导性。评论幽默地讨论了AI对盗版的放松态度,用户们开玩笑说AI的训练数据来自盗版内容。

- 当你钱多得烧不完时[96](活动度:1764):图片是一个迷因,幽默地描绘了“钱多得烧不完”的概念,画面中一名西装革履的男子用焊枪点燃雪茄。这种夸张手法旨在说明财富过剩或过度消费的概念。评论没有提供任何与图片相关的技术见解,而是讨论了不相关的软件版本性能和产品成本等话题。评论反映了对软件版本性能的幽默看法,用户对尽管成本高昂却无法执行简单任务表示沮丧,这表明价格与功能之间存在脱节。

- 如何不要运营一家AI公司[97](活动度:934):图片描绘了一个AI公司的状态仪表盘,显示所有主要服务,包括Claude.ai及其相关平台,今天都经历了“重大中断”。过去90天的正常运行时间百分比从98.69%到99.88%不等,表明频繁的服务中断。这表明在维护服务可靠性方面存在挑战,这通常是快速发展的科技公司优先考虑创新而非稳定性的特点。评论者指出,这种不稳定性对于处于早期阶段的颠覆性科技公司来说是典型的,强调“快速行动,打破常规”的方法。然而,他们指出这不适用于成熟的SaaS公司,表明公司成熟后需要提高稳定性。

- ant3k[98]强调了颠覆性科技公司的典型做法,这些公司通常优先考虑快速创新而非稳定性,概括为“快速行动,打破常规”。这种做法在技术开发的早期阶段很常见,重点是突破界限而不是确保一致的性能。

- itswednesday[99]区分了尖端AI公司和成熟SaaS公司的运营策略。尖端AI公司通常拥抱快速迭代和实验,这与成熟SaaS业务所期望的稳定性和可靠性形成对比。这种区别强调了根据公司成熟度和行业而存在不同的期望和运营模式。

- we-meet-again[100]指出了AI公司在需求超出基础设施能力时面临的挑战。评论暗示,即使产品很受欢迎,财务限制也可能阻碍扩展工作,导致性能问题。这凸显了用户需求与维护和扩展技术基础设施的财务现实之间的紧张关系。

- Claude:“我估计这将需要1-2周才能完成”[101](活动度:1023):图片是一个迷因,不包含任何技术内容。它幽默地描绘了一个名为Claude的角色估计一项任务需要1-2周才能完成的场景,这是项目管理和软件开发中常见的套路,即时间估计往往被低估或过于乐观。评论反映了对这种估计的戏谑性怀疑,有评论建议应立即完成任务而不是花费估计的时间。

- 伙计们,这太便宜了,我想我终于对DeepSeek有了敬意[102](活动度:132):该帖子讨论了DeepSeek V4 Flash模型的定价,该模型被认为是出人意料地实惠,相比之下,专业版(Pro)在今年晚些时候之前仍然昂贵。专业版有折扣。评论中的技术问题集中在模型质量与其他前沿模型相比如何,以及定价优势是否源于缓存命中,这会影响输出令牌的成本。评论者正在争论DeepSeek V4 Flash的成本效益是否归因于其对缓存命中的依赖,这可能会降低输出令牌成本,以及其质量与其他模型相比如何。

- 讨论强调了DeepSeek基于磁盘的KV缓存系统的成本效益,该系统以其鲁棒性和可靠性而闻名,持续时间长达数小时,而大多数提供商通常只有5分钟。该系统通过使缓存输入基本免费而显著降低了成本,从而实现了该领域的新创新。

- 关于DeepSeek V4质量存在争议,一些用户对其在创意写作任务中的表现感到失望,尽管其在角色扮演和智能体应用中具有实用性。这表明在成本和性能之间存在权衡,尤其是在创意语境中。

- 人们对定价结构提出了质疑,不清楚DeepSeek如何能在有大幅折扣和缓存命中的情况下仍提供如此低廉的价格。这表明需要澄清定价模型和可能使用旧模型来实现在成本方面的降低。

- 这确实令人悲伤[103](活动度:2423):图片是一个迷因,通过用户与Google Gemini官方账户之间幽默的互动,突显了Google Gemini应用被认为的低参与度。尽管有这种描绘,评论指出Gemini因其独特的功能(例如音频文件分析)而受到重视,这对于独立音乐制作人来说很有益。用户认为Gemini,尤其是专业版,被低估了,并且与其他AI模型(如ChatGPT和Copilot)相比提供了具有竞争力的功能,尽管由于其与Bard的关联而受到负面公众形象的影响。评论者强调Gemini被低估了,并具有未被广泛认可的独特功能,这表明其公众形象被过去的关联而非其当前能力所扭曲。

- Gemini的音频分析能力[104]被认为是其显著优势,特别是对于缺乏音频工程正式培训的独立音乐制作人而言。此功能使其区别于其他LLM,在文本处理之外的创意领域提供了独特的实用性。

- Gemini的公众形象[105]被指出受到其与Bard的关联的负面影响,尽管有所改进。在不同平台拥有经验的用户认为,Gemini Pro在某些方面超越了ChatGPT和Copilot等竞争对手,这表明其声誉可能未能完全反映其当前能力。

- Gemini的成本效益[106]被强调,用户指出它是通用用途最经济的选择。然而,它可能不是开发者的最佳选择,开发者往往主导讨论,并可能扭曲对其实用性的看法。

- Sulphur 2 未审查视频生成[107](活动度:442):该团队正在开发一个名为Sulphur 2的开源、未经审查的视频生成模型,利用LTX-2.3架构。该模型在12.5万个视频上进行训练,每个视频长10秒,24 fps,仅对非法内容进行过滤,并排除2D视频以提高性能。它支持自然语言字幕进行视频生成。该模型将于一周内在Hugging Face上发布,可通过Discord服务器[108]进行预发布测试。一位评论者询问该模型是否是LTX-2.3的微调版本,表明对模型架构技术细节的兴趣。

- ANR2ME[109]询问所用模型是否是LTX-2.3的微调版本,表明关注底层架构和对基础模型可能进行的修改。这暗示了对模型通过微调实现的功能和性能增强的技术兴趣。

- eraser851[110]询问字幕处理过程和用于快速给NSFW视频添加字幕的可用软件,表明对用于视频处理和注释的工具和方法的技术兴趣。这突出了在处理敏感内容时高效工作流的重要性。

- Technical-Rope2989[111]询问是否发布了蒸馏版本,这表明对模型优化技术(如蒸馏)以减小模型大小同时保持性能的兴趣。这反映了对资源效率和部署考虑的关注。

- Z-Anime - 基于Z-Image Base的完整动漫微调[112](活动度:297):Z-Anime是一个基于阿里巴巴Z-Image Base架构的完全微调模型,专门用于动漫风格图像生成。与LoRA合并不同,它使用S3-DiT(单流扩散变换器)从零开始构建,拥有60亿参数。该模型强调丰富的多样性、强大的可控性,并支持完整的负面提示,使其在动漫语境中具有高度适应性。该模型在约1.5万张图像的数据集上进行训练,侧重于动漫美学。关于训练数据集存在争议,一些用户强调不应使用AI生成的数据集进行训练,因为它可能影响模型的原创性和质量。

- 讨论突出了Z-Anime模型训练过程声明中的差异。虽然它被宣传为“完整动漫微调”模型,但它似乎是在大约15,000张图像的相对较小的数据集上训练的。这引发了对模型的全面性和其宣传材料中可能夸大其词的质疑。

- 一位用户引用了AI模型训练中的一个常见准则:“规则1 - 不要训练AI生成的数据集。”这表明对Z-Anime训练数据质量和原创性的担忧,因为在AI生成内容上训练可能会导致数据污染和模型鲁棒性降低等问题。

- -Ellary-的评论[113]暗示了Z-Anime与其他模型(如“anima3”)之间的比较搜索,表明社区对将Z-Anime与现有模型进行基准测试以评估其性能和独特功能的兴趣。这反映了AI社区普遍存在的一种趋势,即批判性地评估新模型与既定基准。

- 盲测写实性,Z Image Turbo vs Klein 9B Distilled[114](活动度:232):该帖子展示了一项盲测写实性测试,比较了Z Image Turbo和Klein 9B Distilled两款AI模型,通过10张图像评估哪款最逼真。测试包含了使用和不使用LoRa(低秩适应)生成的图像,以评估它们对写实性的影响。用于生成的提示是对夜间肖像场景的详细描述。使用的模型和LoRa包括Flux 2 Klein 9B Distilled和Z Image Turbo的Intarealism V2/V3微调,并提供了指向其各自Civitai页面[115]的链接。该测试旨在通过不首先揭示模型来减少偏见,从而对写实性进行无偏评估。评论者指出Klein 9B比Z Image Turbo更好地处理镜头光晕,Z Image Turbo在纹理真实感方面存在不足,尤其是在石材图案上。第一张图片被普遍认为是最逼真的,有些人甚至认为它可能是真实照片而非AI生成。

- Hoodfu[116]强调了模型之间的关键区别,指出Klein 9B比Z Image Turbo更好地处理镜头光晕,后者在渲染斑驳的石材图案(尤其是在砾石表面)方面存在不足。这种纹理问题是Z Image Turbo的主要缺点,影响了其整体真实感。

- Puzzled-Valuable-985[117]详细介绍了测试中使用的模型和LoRa,强调最逼真的图像是使用Flux 2 Klein 9B Distilled和用于手机摄影的特定LoRa创建的。使用的提示旨在通过涉及汽车和模特在夜间环境中的复杂场景来测试真实感,突出了Klein 9B在实现逼真结果方面的优势。

- Desktop4070[118]对图像进行了比较分析,指出图像1(Flux 2 Klein 9B Distilled)在真实感方面最具说服力,而图像3(Z Image Turbo)具有诡异元素,尤其是在眼睛方面。他们还指出图像10中的光照不一致以及图像2过于专业的表现,这降低了其真实感。

- 多重注入即将到来[119](活动度:224):图片展示了“FLUX.2 Klein身份转移多重注入”工具的用户界面,该工具旨在通过在目标块内的多个阶段注入引用来增强模型中的身份转移。这种方法旨在通过执行中期和后期注入过程来提高稳定性和灵活性。该工具是完善身份转移技术的广泛努力的一部分,并计划以即插即用预设的形式发布,以便于使用。界面包括模型选择、主题遮罩和块配置的设置,表明专注于可定制的数据处理或建模工作流。一位评论者表达了对该工具的期待,但希望能够自定义配置,而不仅仅是默认的即插即用设置,暗示固定默认值可能不适用于所有用例。

- Enshitification[120]提出了关于即将推出的VAE项目配置灵活性的一项技术要点。他们表示希望,尽管可能会引入即插即用的默认配置,但用户仍将保留修改设置的能力。这种灵活性至关重要,因为固定的默认值可能不适用于所有场景,这表明需要可定制的配置以适应不同的用例。

AI Discords

遗憾的是,Discord于今日关闭了我们的访问权限。我们将不再以现有形式恢复此板块,但很快将推出全新的AINews。感谢您的阅读,这是一段美好的旅程。

参考链接

- [1] https://substack.com/redirect/0fcbfd82-c2b3-4175-a6a1-0d1e592cf098?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [2] https://substack.com/redirect/006ab6c0-89f3-4a29-bce9-1c482eb6fce5?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [3] https://substack.com/redirect/31d03ae0-f0c2-4ba8-918f-76d48f0d6674?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [4] https://substack.com/redirect/88f02483-acd7-4f34-a8d7-15252d0151eb?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [5] https://substack.com/redirect/5c31b8da-5c02-4b91-8bc0-eff926f1881b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [6] https://substack.com/redirect/ffb57008-4cb1-4f2c-851e-3e510a61c1b4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [7] https://substack.com/redirect/910a6aed-7acb-49ee-9dd4-4e2d0e01fbcf?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [8] https://sessionize.com/aiewf2026/

- [9] https://sessionize.com/aiewf2026/

- [10] https://substack.com/redirect/3caea56c-3d29-4128-93c6-e9ca57827cc3?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [11] https://substack.com/redirect/bbf2af53-77c5-47e2-b1d3-7d9888a24f4a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [12] https://substack.com/redirect/1a2b924d-f0fb-41c3-9e4e-aa152b123509?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [13] https://substack.com/redirect/3e057723-00f9-4326-9a12-237752ce711f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [14] https://substack.com/redirect/499ed42c-7cc4-42ff-8472-bf88f34ddff8?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [15] https://substack.com/redirect/40558a71-befc-467e-afe8-58d96c89d06d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [16] https://substack.com/redirect/627a8fc6-f463-4fc2-be77-bf5b6aa80150?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [17] https://substack.com/redirect/44c9ae09-9672-4568-b5ad-a27c39167e7f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [18] https://substack.com/redirect/544b8b8e-9563-4e02-a216-b8f1708320b2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [19] https://substack.com/redirect/eb0b4460-21b2-46d4-b6bd-1a804c970db4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [20] https://substack.com/redirect/79b7ee29-2078-4b5b-a399-aa2f50315aef?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [21] https://substack.com/redirect/2edfd9e3-a7d2-4553-98f5-1f57200d3df6?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [22] https://substack.com/redirect/42067823-5189-4b24-ad60-6ce9f50f34b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [23] https://substack.com/redirect/e625cb06-60b9-494b-85ee-8ed397eaf8db?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [24] https://substack.com/redirect/82714bcb-891b-4b84-b148-81073e97d13d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [25] https://substack.com/redirect/f75c7621-a427-48ff-a8ee-dd1958141062?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [26] https://substack.com/redirect/ef40e243-15fa-44b4-b974-23c1baa4dc67?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [27] https://substack.com/redirect/72df9c99-23bc-47e5-944f-091d3763ec14?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [28] https://substack.com/redirect/c8ae630f-f2d4-408c-a8f0-e358765a58a8?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [29] https://substack.com/redirect/ef8b5891-0281-4f5f-9536-25b5ecd16e9f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [30] https://substack.com/redirect/72df9c99-23bc-47e5-944f-091d3763ec14?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [31] https://substack.com/redirect/14558e2e-6082-4529-961a-a2ef1d45c0ea?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [32] https://substack.com/redirect/ef40e243-15fa-44b4-b974-23c1baa4dc67?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [33] https://substack.com/redirect/078b8634-8922-41ea-a27b-525cc43c85cf?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [34] https://substack.com/redirect/21ae6303-4115-439c-bc14-1b60bd83090a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [35] https://substack.com/redirect/ae46889b-b6cc-42aa-ae49-a82bb000eb14?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [36] https://substack.com/redirect/ae46889b-b6cc-42aa-ae49-a82bb000eb14?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [37] https://substack.com/redirect/d419bf02-0ac9-4e1c-867b-24f8c90b6278?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [38] https://substack.com/redirect/ac43476c-f625-43d0-813c-a1b4e9144cdc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [39] https://substack.com/redirect/ac43476c-f625-43d0-813c-a1b4e9144cdc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [40] https://substack.com/redirect/d6fbce5f-8e04-4ddd-b4e5-142bfe20fe9b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [41] https://substack.com/redirect/d6fbce5f-8e04-4ddd-b4e5-142bfe20fe9b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [42] https://substack.com/redirect/7ce33851-3343-42f6-9d80-9dec3aa1c7ab?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [43] https://substack.com/redirect/7ce33851-3343-42f6-9d80-9dec3aa1c7ab?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [44] https://substack.com/redirect/dbbc2a3a-fa80-439a-bc8d-4b1dfa6d65d7?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [45] https://substack.com/redirect/e9e7c3db-864d-4167-aea7-aaf6defa9d54?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [46] https://substack.com/redirect/7171b1e2-4fad-413f-afd1-85abf08cb1cc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [47] https://substack.com/redirect/662041ce-e170-46a9-a98a-f174e94e1948?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [48] https://substack.com/redirect/662041ce-e170-46a9-a98a-f174e94e1948?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [49] https://substack.com/redirect/807953bf-67f2-4326-b2d9-2c2ebfb3b994?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [50] https://substack.com/redirect/807953bf-67f2-4326-b2d9-2c2ebfb3b994?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [51] https://substack.com/redirect/4d1dbb95-3b02-43d8-a00a-75493dcf64a4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [52] https://substack.com/redirect/05ea9d48-860a-4afa-ac36-e0594f3cc4c2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [53] https://substack.com/redirect/465b7d1a-20a8-4588-8eeb-8eee52720359?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [54] https://substack.com/redirect/7e40f43c-20ca-4879-bdb0-ccdc7c5b2803?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [55] https://substack.com/redirect/fc023670-b876-4501-adc1-c69bbab40c9b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [56] https://substack.com/redirect/2d779c87-73ec-4b3b-ac78-a4fd0cc0588b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [57] https://substack.com/redirect/8884b368-73f8-4e51-bee4-098673967c7b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [58] https://substack.com/redirect/f75c7621-a427-48ff-a8ee-dd1958141062?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [59] https://substack.com/redirect/14558e2e-6082-4529-961a-a2ef1d45c0ea?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [60] https://substack.com/redirect/9723d027-9ea5-457e-a973-23acb448eb21?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [61] https://substack.com/redirect/382e15df-2374-4541-aee2-96a29bc32f7f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [62] https://substack.com/redirect/346fe5ca-709b-49b5-b86f-d3fdf96ce3e7?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [63] https://substack.com/redirect/7aa3e7f0-1e5a-42b5-b1af-45d50d661564?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [64] https://substack.com/redirect/0f74a3b8-9588-4c4d-a808-d2647103f45e?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [65] https://substack.com/redirect/e66dbe95-c226-496c-8a7a-7cde1fb1b010?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [66] https://substack.com/redirect/1cfc9693-aac3-45d5-b998-6625a6651ebd?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [67] https://substack.com/redirect/09fc3201-1ab8-419c-95dd-9842383488d2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [68] https://substack.com/redirect/80c99ba9-975b-4fee-aebd-8d40af9e0b69?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [69] https://substack.com/redirect/13c1c7d2-2edc-4a34-ae42-4c2a5deda981?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [70] https://substack.com/redirect/39f9b303-1828-4cdc-8b2f-62817d8a9ea4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [71] https://substack.com/redirect/f6b8f982-9f4f-4de8-abc0-2ab4bac12a9c?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [72] https://substack.com/redirect/60d2e6cc-ce81-4a64-b7da-f591ccfd5db2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [73] https://substack.com/redirect/bb7a87db-061a-48cf-9ed6-078ab78ed610?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [74] https://substack.com/redirect/e0a06be8-db65-4b06-b54b-663c74966e46?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [75] https://substack.com/redirect/c3a54fd9-202e-44ea-8d91-11b19f586fa9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [76] https://substack.com/redirect/beb34d0b-5317-43d4-be43-13a61fe42ba2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [77] https://substack.com/redirect/5fd5393e-e880-401d-bd12-0a391cc5d6dd?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [78] https://substack.com/redirect/207cf648-5e72-45cf-9b71-bec84e3da05b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [79] https://substack.com/redirect/4c1b0b5c-7de0-403a-91c0-af56a89eca5a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [80] https://substack.com/redirect/05d18d3f-89ba-451a-a669-74f2e20e576c?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [81] https://substack.com/redirect/789bc7df-c5a5-4733-a455-e83f58950eac?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [82] https://substack.com/redirect/d49ba570-8918-464e-b8ef-57c20174f8c4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [83] https://substack.com/redirect/d49ba570-8918-464e-b8ef-57c20174f8c4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [84] https://substack.com/redirect/d49ba570-8918-464e-b8ef-57c20174f8c4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [85] https://substack.com/redirect/d49ba570-8918-464e-b8ef-57c20174f8c4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [86] https://substack.com/redirect/ca297770-48f5-4ec4-991e-7e8d3f09f65f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [87] https://substack.com/redirect/b1627098-3aba-4a8f-b9ca-73ff71db6384?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [88] https://substack.com/redirect/b694a17b-897d-4a60-9c16-17f556947dfc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [89] https://substack.com/redirect/e45dcfed-144c-4754-a609-94f3b545c1b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [90] https://substack.com/redirect/a6a6f90b-f260-45aa-b9fc-faef3c1d6481?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [91] https://substack.com/redirect/441c8fb2-aa77-4c80-a5de-d5b7a50c269e?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [92] https://substack.com/redirect/a6a6f90b-f260-45aa-b9fc-faef3c1d6481?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [93] https://substack.com/redirect/a6a6f90b-f260-45aa-b9fc-faef3c1d6481?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [94] https://substack.com/redirect/a6a6f90b-f260-45aa-b9fc-faef3c1d6481?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [95] https://substack.com/redirect/f28c2e07-3940-485d-972f-07add8f68b0c?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [96] https://substack.com/redirect/8823bfd3-4997-4abd-8ef9-4c0ada92a69f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [97] https://substack.com/redirect/5ab106b8-8ae1-422a-8e18-a815dcff63b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [98] https://substack.com/redirect/5ab106b8-8ae1-422a-8e18-a815dcff63b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [99] https://substack.com/redirect/5ab106b8-8ae1-422a-8e18-a815dcff63b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [100] https://substack.com/redirect/5ab106b8-8ae1-422a-8e18-a815dcff63b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [101] https://substack.com/redirect/550464c9-f6a8-4ac2-a198-6c71fc31d238?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [102] https://substack.com/redirect/2b77451a-8ca5-4206-bac9-ee09d1d57c6f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [103] https://substack.com/redirect/94f5d5b1-dacb-4546-8358-39b594e5b242?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [104] https://substack.com/redirect/94f5d5b1-dacb-4546-8358-39b594e5b242?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [105] https://substack.com/redirect/94f5d5b1-dacb-4546-8358-39b594e5b242?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [106] https://substack.com/redirect/94f5d5b1-dacb-4546-8358-39b594e5b242?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [107] https://substack.com/redirect/28cdfe13-5158-487e-8e66-66db01acbd85?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [108] https://substack.com/redirect/f11e7823-4b33-4948-824a-0032791bda77?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [109] https://substack.com/redirect/28cdfe13-5158-487e-8e66-66db01acbd85?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [110] https://substack.com/redirect/28cdfe13-5158-487e-8e66-66db01acbd85?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [111] https://substack.com/redirect/28cdfe13-5158-487e-8e66-66db01acbd85?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [112] https://substack.com/redirect/721c1eeb-0753-4c7e-bd21-126ea249332d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [113] https://substack.com/redirect/721c1eeb-0753-4c7e-bd21-126ea249332d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [114] https://substack.com/redirect/c93bcbcd-469a-48fb-a485-1f3ac51f9d2d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [115] https://substack.com/redirect/ac90423f-c6a5-4fbd-ad8b-54646eeeba?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [116] https://substack.com/redirect/c93bcbcd-469a-48fb-a485-1f3ac51f9d2d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [117] https://substack.com/redirect/c93bcbcd-469a-48fb-a485-1f3ac51f9d2d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [118] https://substack.com/redirect/c93bcbcd-469a-48fb-a485-1f3ac51f9d2d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [119] https://substack.com/redirect/6ebaa582-8b8a-43ac-84b6-2004e990e105?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- [120] https://substack.com/redirect/6ebaa582-8b8a-43ac-84b6-2004e990e105?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

AI群: 欢迎加我微信 tsla10timesAI交流,拉你进群!我们刚刚建立这个AI交流社群,正在寻找志同道合的朋友一起成长!

夜雨聆风

夜雨聆风