AI听不懂「还不错」背后的意思,这不是Bug,是人类语言的诅咒

你说「这个方案还可以吧」,你的同事秒懂你其实不满意。但AI会真心实意地回你「谢谢认可」。这不是AI不够聪明——而是人类花了几千年建造了一套只有自己人才能破译的暗语系统,然后抱怨机器看不懂密码。

有一个实验值得玩味。研究者让GPT-4评估一段对话:用户说「你这个回答……挺有意思的」,语气平淡,后面没有任何追问。人类读者普遍判断这是委婉的否定——「有意思」在这个语境里几乎等于「我不知道该怎么夸你」。但模型给出的情感分析是:正面反馈,用户满意度较高。它不是算错了,它是根本没有进入那个频道。

礼貌,是人类发明的一种双重编码

语言学里有个概念叫「面子威胁行为」(Face-Threatening Act)。简单说:直接批评别人会让对方难堪,所以人类进化出了一套缓冲系统——用表面上中性甚至正面的词,传递实际上负面的信息。「你这个想法很大胆」「这个设计挺独特的」「不是不能用」——每一句话都在表层和深层之间开了一道裂缝。理解它,需要同时读两个频道:字面意思,和说话人选择这个措辞而不是其他措辞时泄露的信息。

●礼貌不是在说话,而是在控制说话和不说话之间的比例

这套系统对人类来说近乎本能。你三岁就开始学:妈妈说「你今天画的画……很用心」,你知道她不喜欢但不想打击你。你不需要任何人教你「很用心」在这里是个安慰奖。这种学习发生在无数次具身的社交场景里,带着情绪,带着后果,带着「说错了会怎样」的压力。语言模型的训练数据是文本——大量的文本——但文本天然过滤掉了这些东西。你看不到说话人的表情,看不到对话之后发生了什么,看不到那个「还可以」之后的沉默持续了多久。

模型卡在了「统计正确」的陷阱里

从概率的角度看,「还不错」在语料库里大多数时候确实是正面的。如果你让模型猜这句话的情感极性,答「正面」是统计上更安全的选择。模型没有做错——它在做它被训练去做的事:在给定文本中找最可能的解释。问题是,隐含批评恰恰是一种低频但高密度的信息。它出现得不多,但每次出现都携带着大量真实意图。统计平均会系统性地稀释这类信号。

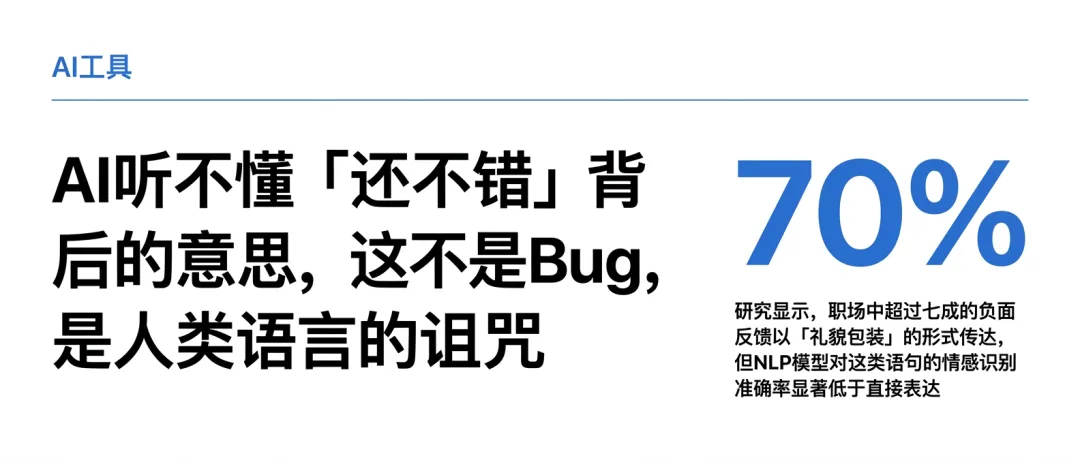

70%

研究显示,职场中超过七成的负面反馈以「礼貌包装」的形式传达,但NLP模型对这类语句的情感识别准确率显著低于直接表达

更微妙的是,同一句话在不同语境下可以完全反转。「这个方案挺有创意的」,如果说话人是你的导师,在你刚交完第一稿之后,可能是真心鼓励。如果说话人是竞争对手,在一次公开评审之后,几乎可以确定是贬低。语境不只是背景,它是解码器本身。而当前的语言模型处理语境的方式,仍然是把它压缩成向量——信息损耗是结构性的,不是工程问题。

这不只是AI的局限,也是人类语言的代价

有意思的地方在这里:我们抱怨AI听不懂弦外之音,但这套「弦外之音」系统本来就是为了让一部分人听不懂而设计的。礼貌的隐含批评,功能之一就是给说话人留退路——如果对方真的听懂了,你可以否认;如果对方没听懂,你也没有直接冒犯他。这是一种社交上的模糊性保险。AI的「听不懂」,某种程度上是掉进了这个系统本来就预留的坑里。

「

语言有时候不是用来传递信息的,而是用来管理关系的——这两件事有时候正好相反

」

但这个问题的后果在AI大规模介入人类沟通之后变得不可忽视。当AI帮你总结会议纪要,它可能把「大家对这个方向表示了一些保留意见」处理成「团队对方向表示支持」。当AI分析用户反馈,它可能把「这个功能……还挺新颖的」归入好评。当AI充当客服,它可能把「你们的服务态度真是让人印象深刻」当成表扬来回复。每一个单独的误判都不大,但系统性地发生,就是在把人类沟通里最复杂的那一层——言外之意——从信息流里悄悄删掉。

我们能做什么

1给AI更多语境:说话人是谁、关系如何、场合是什么——这些不是废话,是解码必需品

2不要用AI做需要读懂潜台词的判断,比如绩效评估、用户情感分析、冲突调解

3反过来想:如果你想让AI真正理解你的意思,直说比礼貌说更有效——这其实也是对人类自己的一个提醒

最后一点有点反讽:与AI打交道,可能会逼着我们变得更直接。不是因为AI更聪明,而是因为模糊的语言在机器面前会原形毕露。你说「这个功能有点问题」,AI可能帮你提了一个根本不相关的bug。你说「第三步的逻辑存在循环依赖」,它才能真正帮到你。人类之间可以靠暗语维持关系,人机之间,清晰是唯一的通行证。

✦ 小结

AI听不懂礼貌批评,根源不在于算法不够好,而在于隐含批评本就是人类为了「可否认性」而设计的双重编码系统。统计训练会系统稀释低频高密度信号,语境压缩会丢失解码所必需的信息。这个局限短期内不会消失。真正的问题是:当AI大规模介入人类沟通,它会把「言外之意」这一层从信息流里悄悄删掉——而我们可能很久之后才会注意到。

夜雨聆风

夜雨聆风