WeKnora

WeKnora对个人用户的核心价值在于将零散文档转化为可对话的私人知识库。 通过本地部署保障数据隐私,并提供以下实用功能。

个人用户核心用途

智能文档管理

支持PDF/Word/图片等格式,自动提取文本、表格及图像语义(OCR技术),解决个人资料杂乱问题。 示例:上传合同、学习笔记、研究论文,实现跨文档精准检索。

自然语言问答

像聊天一样提问(如“总结第三章节要点”),直接获取带原文出处的答案,支持多轮追问。

微信生态集成

零代码连接公众号/小程序,快速搭建个人问答机器人(如技术博客自动答疑)。

科研学习辅助

解析文献内容,构建知识图谱关联概念,加速论文阅读与资料整理。

快捷部署指南(10分钟完成)

基础环境

# 安装依赖

git clone https://github.com/tencent/weknora.git

cd weknora

docker compose pull

关键配置

- 1复制并修改环境文件:

cp .env.example .env

设置OLLAMA_BASE_URL=http://本地IP:11434(需提前安装Ollama)。 可选:调整LLM_MODEL_NAME=gemma:2b(轻量模型节省资源)。

- 1一键启动:

./scripts/start_all.sh

访问http://localhost进入Web界面。

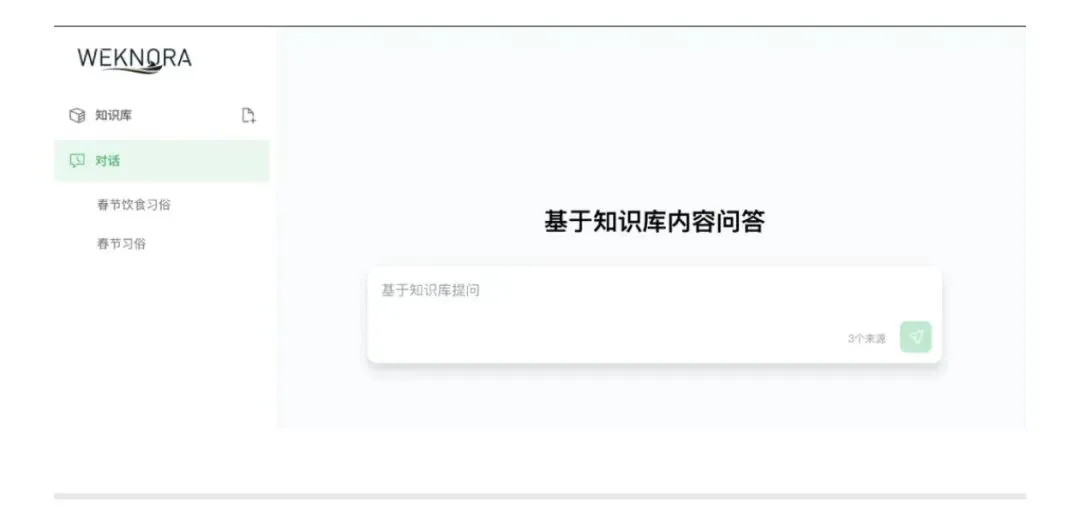

极简使用流程

初始化

在Web界面配置模型(选Ollama本地模型)。

上传文档

拖拽PDF/Word等到界面。

提问

输入问题如“合同中的违约责任条款是什么?” 系统返回答案并标注原文位置。

注意事项

资源占用

默认使用轻量模型(如Gemma 2B),普通笔记本可流畅运行。

常见问题

若知识库创建失败,执行:

docker exec weknora-postgres psql -U postgres -d weknora -f /docker-entrypoint-initdb.d/00-init-db.sql

隐私安全

所有数据存储于本地,无云端上传。

通过以上步骤,即可将个人文档转化为高效知识助手,适合管理法律合同、研究资料或构建个人AI问答库。

夜雨聆风

夜雨聆风