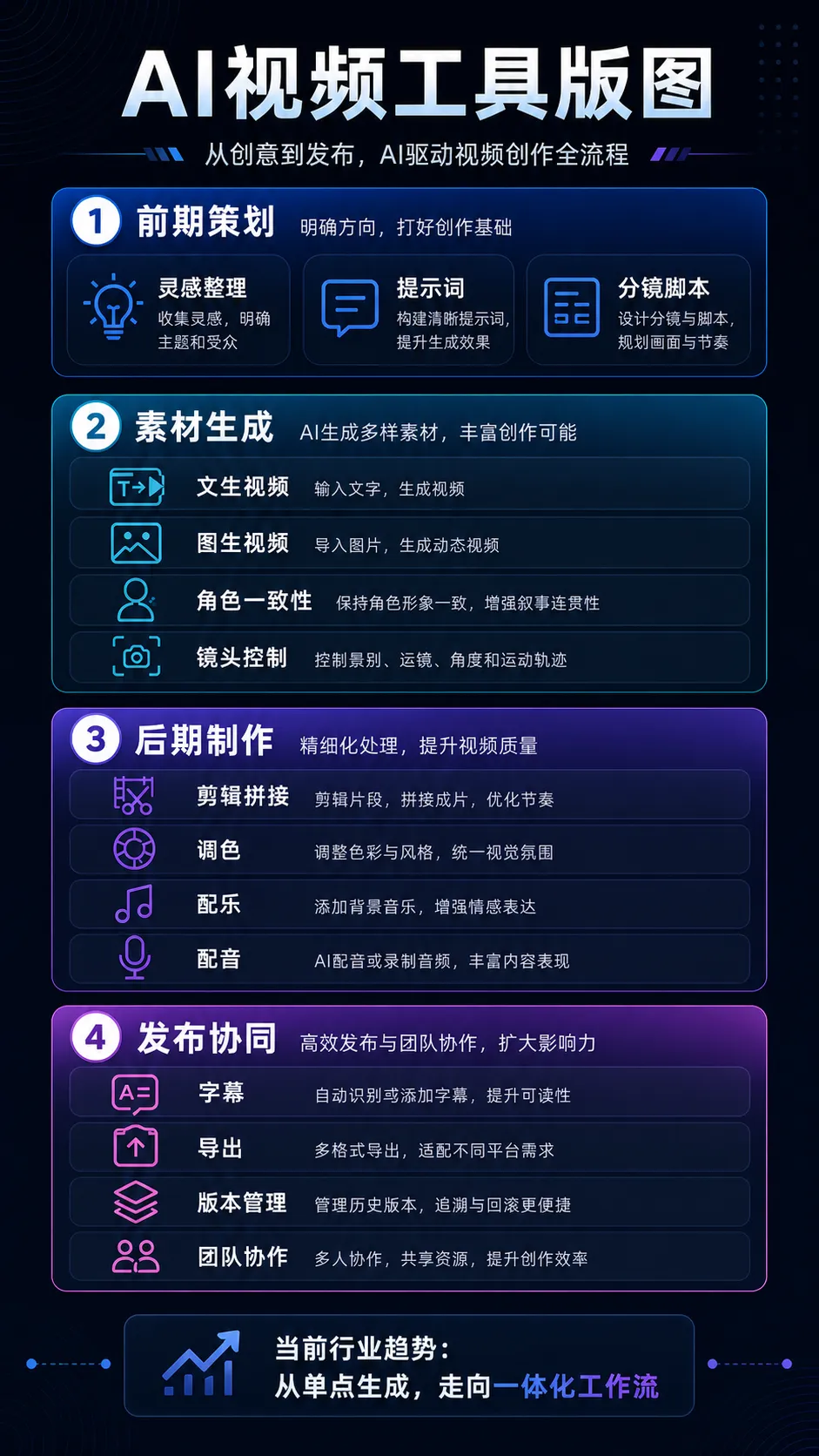

过去一年,很多团队尝试AI视频制作时,最常见的流程是:

先让大模型写脚本和分镜;再把每个分镜拆成提示词;再去不同的视频生成工具里一段一段生成;最后导入剪映、Premiere或DaVinci手工拼接、配音、调色、加字幕。

这个流程已经比传统拍摄快很多,但它仍然有一个明显问题:AI负责“生成片段”,人类负责“组织成片”。

真正耗时间的,往往不是生成某一个镜头,而是这些镜头能不能连起来:角色是否一致、画面风格是否统一、镜头运动是否合理、节奏是否顺畅、配乐和字幕是否匹配、修改后能不能快速复用。

所以,今天讨论AI视频工具,不能只问“哪个模型画面最惊艳”,更应该问:

有没有工具可以把脚本、分镜、生成、拼接、剪辑、配音、字幕、输出放进一个相对完整的工作流里?

答案是:已经出现了,但还没有完全成熟。当前最务实的判断是——AI视频制作正在从“单点生成工具”,走向“半自动流水线”。

一、现在的AI

视频工具,大体分成三类

第一类:单镜头生成工具

这类工具的核心能力是根据文字、图片或参考素材生成一段短视频。典型能力包括文生视频、图生视频、视频转视频、关键帧控制、镜头运动控制等。

代表方向包括Runway、Luma、Pika、可灵、海螺、Vidu、Seedance等。

例如,Runway Gen-4的官方介绍重点强调了跨场景保持角色、地点、物体和风格一致的能力;Luma Ray3 / Ray3.14则强调角色参考、关键帧、视频修改、1080p生成、更快速度和更低成本;Vidu的Reference to Video支持上传多个参考对象,用于保持角色、物体和场景一致性。

这类工具的优点是:画面质量提升很快,单镜头表现力强。

但问题也很明显:它们大多仍然是“片段生产机”。你可以生成5秒、10秒、15秒的精彩镜头,但要把几十个镜头拼成一条完整短片,还需要很强的人工导演和剪辑能力。

第二类:剪辑增强工具

这类工具不一定最擅长生成电影感镜头,但擅长把已有素材快速整理成可发布视频。

典型能力包括:自动字幕、智能配音、素材匹配、模板化剪辑、自动卡点、脚本转视频、口播数字人、社媒比例适配等。

代表方向包括剪映 / CapCut、Descript、HeyGen、Canva、VEED、InVideo 等。

例如,CapCut提供Script to Video能力,可以把脚本快速转换为视频内容;HeyGen的Video Agent则更偏向知识讲解、培训、产品介绍、内部传播等场景,强调从一个提示词或脚本生成结构化视频。

这类工具的优点是:成片效率高,适合短视频运营、课程、产品介绍、企业培训。

但它们的问题是:当你想做强叙事、强镜头语言、统一角色和连续剧情时,能力往往不够。

第三类:一体化AI视频制作平台

这是当前最值得关注的方向。

它们不再只是“生成一个镜头”,而是试图覆盖从创意、脚本、分镜、角色、场景、生成、时间线编辑、音频、协作到导出的完整流程。

目前比较接近这个方向的工具包 LTX Studio、Adobe Firefly Video Editor / Premiere生态、部分新一代HeyGen Video Agent,以及部分正在迭代的多模态视频平台。

其中,LTX Studio明确定位为从concept到final cut的AI视频制作平台,提供 Dynamic Storyboard、Timeline Editor、Sound Design、角色/物体/场景一致性管理、团队协作等能力;Adobe Firefly Video Editor则在浏览器内提供多轨时间线、生成素材、上传素材、Stock资产、音频增强、调色和导出能力,同时 Adobe也在推进Firefly AI Assistant,用自然语言调度多步骤创意工作流。

这类工具的意义在于:它们开始解决“镜头与镜头之间”的问题。

也就是说,AI视频真正的效率革命,不只是生成能力,而是工作流闭环。

二、有没有真正“一键从分镜到成片”的工具?

如果标准是“输入一个想法,AI自动生成分镜、批量生成镜头、自动拼接、自动配音、自动调色、自动输出,而且效果达到商业成片级别”,那么目前答案是:

还没有完全成熟。

但如果标准是“能显著减少人工拆镜、生成、拼接、管理和导出的工作量”,那么已经有一些工具值得尝试。

1. LTX Studio:目前最接近“AI导演工作台”的方向

LTX Studio的优势在于它不是单纯的视频生成器,而是把脚本、分镜、角色元素、镜头生成、时间线、音频和协作放在一个项目里管理。

它适合做广告样片、短片预演、动画分镜、品牌视觉概念片、短剧前期设计。

它的核心价值不是某一个镜头多惊艳,而是能让团队围绕同一套角色、场景、风格和故事板持续迭代。对于希望“批量生成分镜动画并拼接成初版成片”的团队,它是当前最值得重点测试的工具之一。

适合场景:品牌宣传片预演、短片Demo、广告创意样片、故事板动画、课程视频视觉化。

不适合场景:极高写实人物表演、复杂打斗、强口型长对话、严肃商业最终片完全自动交付。

2. Adobe Firefly + Premiere:更适合专业团队的“AI后期中枢”

Adobe 的路线不是完全替代剪辑师,而是把AI生成功能接入成熟创意软件生态。

Firefly Video Editor已经支持浏览器里的多轨时间线、生成视频、上传素材、音频处理、调色、Adobe Stock素材接入;Premiere、After Effects、Frame.io 又可以承担专业剪辑、合成、审片、协作和交付。

这套方案更适合有一定剪辑基础的团队。它不是最“傻瓜式”的,但稳定性、版权合规、团队协作、后期精修空间更强。

适合场景:企业宣传片、广告片、课程视频、展厅视频、严肃商业项目、需要版权合规的内容生产。

不适合场景:完全没有后期人员、希望一句话直接生成完整电影的团队。

3. Runway / Luma / Vidu:更适合承担“高质量镜头生成”

这几类工具更像AI摄影棚。它们适合生成关键镜头、氛围镜头、转场镜头、视觉特效镜头、产品概念镜头。

Runway Gen-4强调角色、地点、物体和世界观一致性;Luma Ray3.14强调视频修改、角色参考、关键帧和更快生成;Vidu的Reference to Video则适合用参考图保持角色、物体和场景一致。

它们的问题是:生成能力强,但成片管理能力相对弱。实际使用中,最好把它们当作“镜头生产工具”,再配合剪映、Premiere、Firefly或LTX进行拼接和包装。

适合场景:视觉冲击镜头、产品概念片、科幻场景、城市宣传、文旅视觉、短剧氛围镜头、广告镜头。

不适合场景:全流程无人值守成片、长剧情稳定连续生成。

4. HeyGen / CapCut:更适合知识型视频和运营型短视频

如果目标不是电影短片,而是企业培训、课程讲解、产品介绍、政策解读、知识科普、短视频矩阵,那么HeyGen和CapCut这类工具非常实用。

HeyGen的Video Agent偏向“从一个主题生成结构化讲解视频”,适合知识型创作者和企业内容团队;CapCut的Script to Video、字幕、配音、模板、社媒适配能力,则适合高频内容生产。

它们的优势不是电影级画面,而是快、稳、可批量、易发布。

适合场景:课程视频、企业内训、产品介绍、短视频带货、新闻解读、公众号视频号联动。

不适合场景:强剧情、强镜头语言、复杂连续动作、电影级视觉叙事。

三、当前最推荐的AI视频制作流程

如果要在今天真正把AI视频用于工作,而不是停留在“玩模型”,建议采用下面这套流程。

第一步:先做脚本和镜头表,不要一上来就生成长视频

AI视频最怕“又长又空”的提示词。

不要直接输入:“帮我生成一个2分钟的城市宣传片。”

更好的方式是先拆成镜头表:

镜头1:城市远景,清晨,航拍,高楼反光,5秒。镜头2:人物从地铁站走出,侧逆光,中景,4秒。镜头3:科技展厅内部,观众互动,全景,5秒。镜头4:屏幕数据流动,特写,3秒。镜头5:城市夜景收束,慢速拉远,6秒。

这一步可以用ChatGPT、Claude、Kimi、豆包等大模型完成。重点不是文采,而是把视频拆成可执行镜头。

第二步:每个镜头控制在3~8秒

目前AI视频最稳定的生产方式,仍然是短镜头批量生成。

原因很简单:镜头越长,角色漂移、动作变形、画面闪烁、逻辑断裂的概率越高。

所以,更建议把1分钟视频拆成10~15个短镜头,而不是试图一次生成完整视频。

这也是为什么“批处理生成分镜动画”比“一句话生成整片”更现实。

第三步:先锁定角色、场景和风格

如果视频中有人物、IP形象、产品或固定场景,要先生成参考图,再用参考图进行视频生成。

对于企业宣传片,可以先确定:品牌色、画面质感、人物服装、场景风格、镜头语言。

对于课程或知识视频,可以先确定:讲师形象、背景风格、字幕样式、信息图模板。

对于短剧或故事片,可以先确定:主角正面、侧面、背面;主要场景;道具;服装;光线风格。

角色一致性和场景一致性,是AI视频能不能“像一条片子”的关键。

第四步:生成阶段不要追求一次成功,要做多版本筛选

AI视频不是传统拍摄,也不是传统剪辑。它更像“抽卡+导演筛选”。

同一个镜头建议至少生成3~5个版本,然后选最稳定、最符合叙事的一个。

如果是关键镜头,可以生成更多版本,再从中挑选动作、表情、光影、构图最合适的片段。

高质量AI视频的核心,不是一次提示词写得多神,而是有一套稳定的筛选机制。

第五步:在时间线里完成真正的“成片判断”

AI可以生成镜头,但它暂时还不能完全替代导演和剪辑师。

一个视频好不好,最终取决于:

镜头之间是否顺;节奏是否有起伏;音乐是否带动情绪;字幕是否清楚;画面风格是否统一;开头 3 秒是否抓人;结尾是否有记忆点。

这一步建议仍然在剪映、Premiere、DaVinci、Final Cut、Firefly Video Editor 或LTX Timeline里完成。

也就是说,AI负责提高素材生产效率,人类负责判断表达是否成立。

四、不同团队应该怎么选工具?

如果你是企业宣传团队

推荐组合:LTX Studio / Adobe Firefly + Premiere / Runway / Luma / 剪映

目标不是完全自动成片,而是快速做出概念片、样片、宣传片分镜、视觉预演,再由人工精修。

适合做:企业宣传片、招商片、展厅视频、产品概念视频、活动暖场视频。

如果你是短视频运营团队

推荐组合:CapCut / 剪映 + HeyGen + ChatGPT + 一两个视频生成模型

重点是快、批量、可复用。

适合做:知识口播、政策解读、课程切片、产品种草、图文转视频、视频号内容矩阵。

如果你是教育内容团队

推荐组合:HeyGen / CapCut / Adobe Express / 剪映 / ChatGPT

教育场景不一定需要电影级画面,更重要的是讲清楚、节奏稳、字幕准、易复用。

适合做:AI课程讲解、教师培训视频、实验室介绍、学生作品展示、招生宣传短片。

如果你是文旅、城市宣传或展陈团队

推荐组合:Runway / Luma / Vidu / 可灵 / Firefly / Premiere

这类场景最需要视觉冲击力,可以用AI生成大量城市、未来、历史、文化、沉浸式镜头,再做人工剪辑包装。

适合做:城市形象片、文旅宣传片、展厅裸眼3D内容预演、沉浸式空间视频、招商视觉短片。

五、结论:AI视频的关键,不是“替代剪辑”,而是“重组生产流程”

现在的AI视频工具已经能解决很多过去很贵、很慢、很依赖专业团队的环节。

它可以帮我们快速试错创意;可以把文字变成分镜;可以把图片变成动态镜头;可以批量生成视觉素材;可以快速做配音、字幕、翻译和版本化;也可以让一个小团队做出过去需要更大团队才能完成的样片。

但它还没有完全解决所有问题。

尤其是长剧情、复杂人物表演、稳定连续动作、强情绪表达、商业级最终交付,仍然需要导演、编剧、剪辑、设计和审美判断。

所以,今天最成熟的使用方式不是“让AI一键拍电影”,而是建立一条新的内容生产流水线:

人来定方向,AI批量生成;人来做判断,AI提高效率;人来把控表达,AI承担重复劳动。

真正值得关注的,不是某一个爆款模型,而是未来谁能把脚本、分镜、角色、场景、镜头、时间线、音频、字幕、协作、发布全部打通。

AI视频制作的下一站,不是单点工具之争,而是完整工作流之争。

关注我,带您了解更多AI前沿动态。

夜雨聆风

夜雨聆风