我终于意识到:

AI 产品真正的单位,

可能不是 Function,

而是「语义连续性」。

这件事,我是最近长期用 coding agent 去做 agent 的时候,才真正感觉到的。

以前我一直以为:

Agent 做不好,

是因为模型不够强。

后来我又觉得:

是不是 Prompt 不够好?

是不是 Workflow 不够复杂?

是不是记忆系统太弱?

是不是工具调用不够智能?

于是开始疯狂加东西。

memory、

graph、

workflow、

node、

tool call、

summary……

系统越来越复杂。

但奇怪的是:

Agent 反而越来越“假”。

它看起来什么都会。

但你始终感觉:

它没有真正理解你。

——

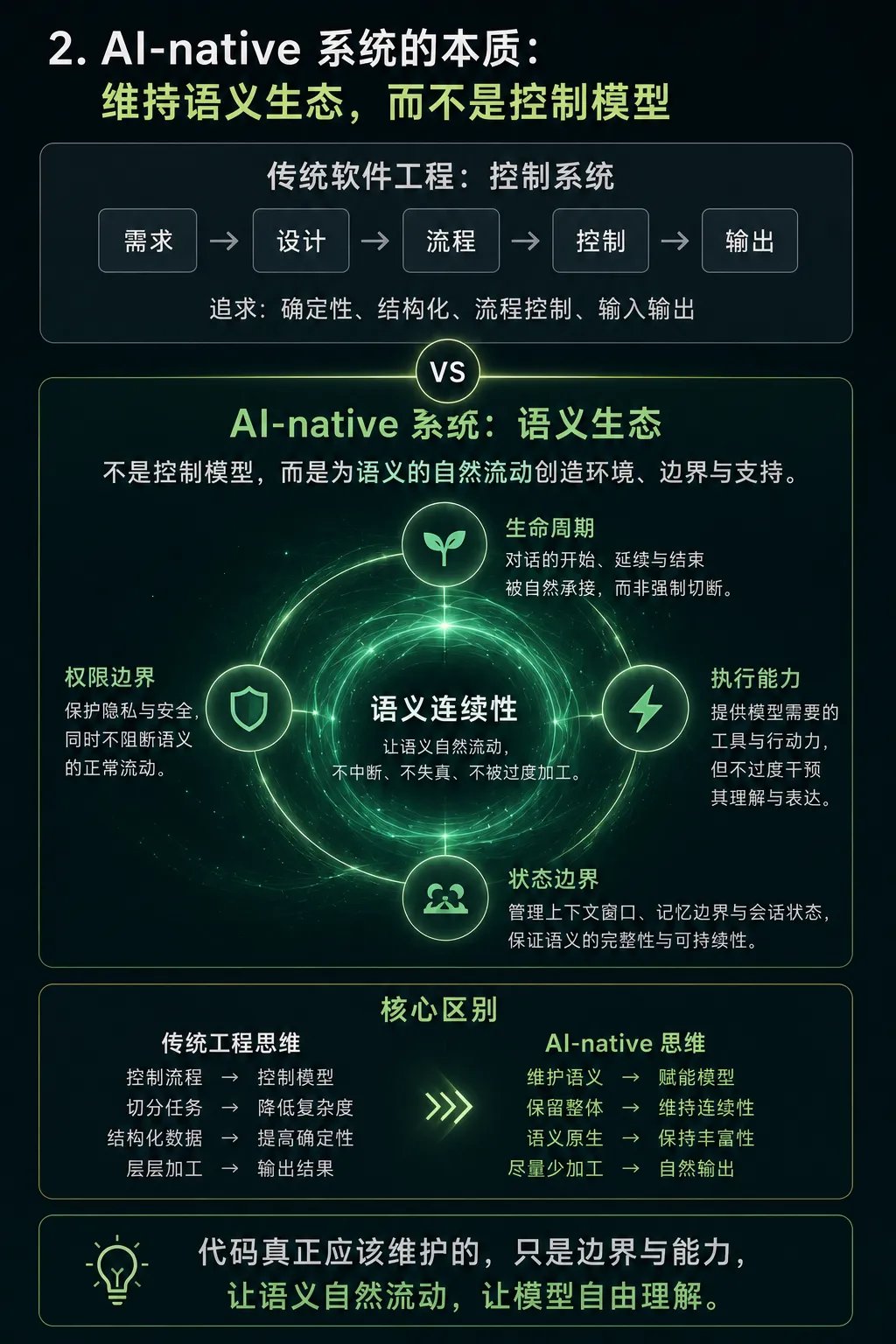

后来我才慢慢意识到:

问题可能根本不在模型。

而在于:

语义在工程链路里,

被一点一点切碎了。

传统软件工程,

本质上是低级语义系统。

它追求的是:

- 确定性

- 状态机

- 输入输出

- 字段

- schema

- control flow

但模型不是这个世界。

模型本质上更像一个高维语义系统。

它很多时候理解的,

不是字段。

而是:

整体上下文之间连续的关系。

——

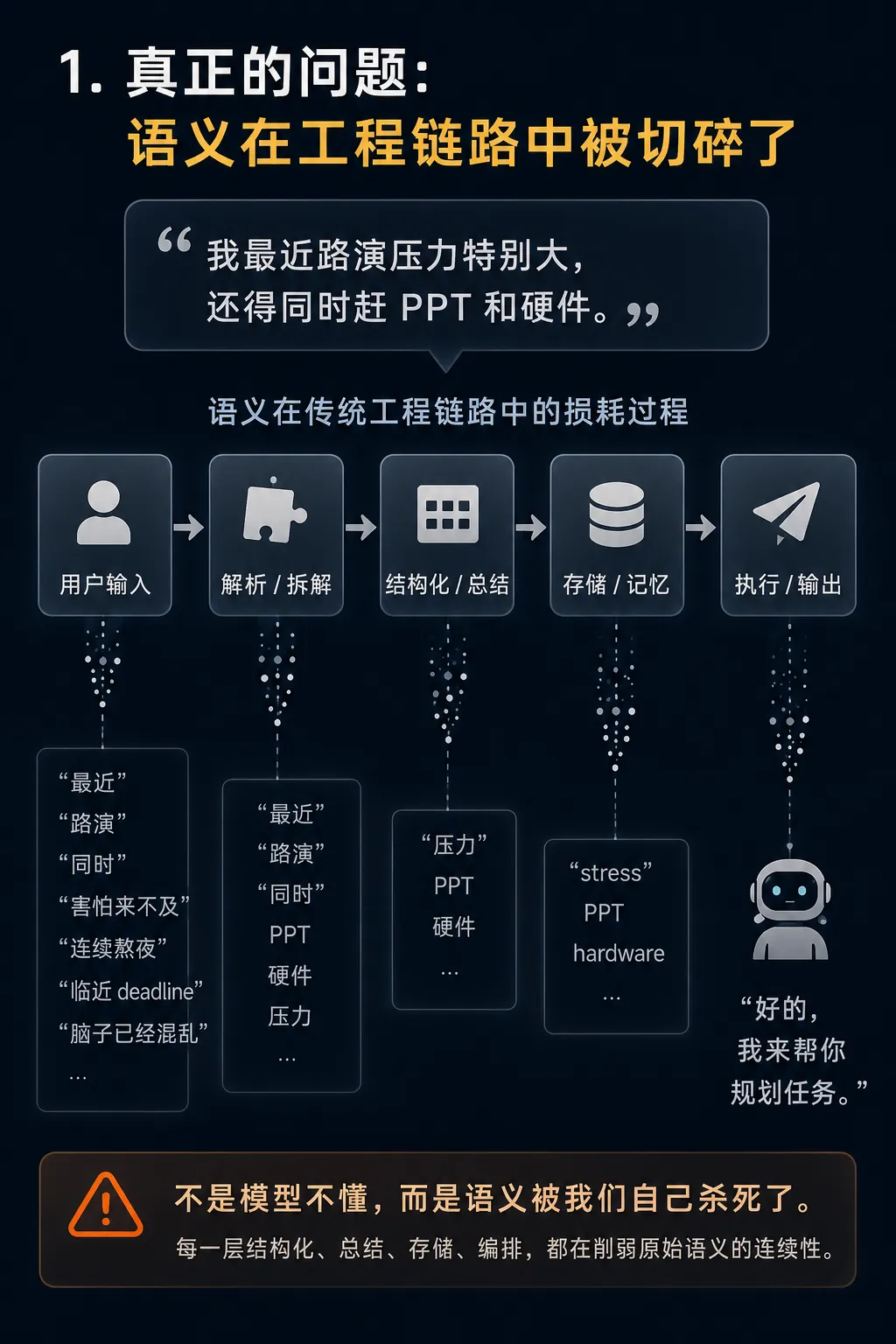

于是我开始发现一个特别奇怪的问题:

很多 Agent 系统,

其实从代码层就已经开始“丢语义”了。

比如一句很自然的话:

“这个功能其实能跑,但整体体验特别奇怪,好像哪里断掉了。”

传统工程会很自然想把它拆成:

- issue

- task

- feedback

- emotion

但真正重要的东西,

可能恰恰在那些无法被结构化的部分里。

“整体体验”

“奇怪”

“断掉了”

“说不上来的不连贯”

这些东西,

其实是一整段连续语义。

可很多系统会在:

workflow、

summary、

memory abstraction、

structured output

这一层层处理中,

不断压缩、

切分、

归类。

最后:

语义已经不是原来的语义了。

——

我后来越来越强烈地感觉到:

很多 Agent 为什么很“机械”,

不是因为模型不够聪明。

而是:

低级语义正在强行控制高级语义。

代码在试图规定:

模型应该怎么理解世界。

但模型真正擅长的,

恰恰是整体语义理解。

于是你会发现:

很多 Agent 功能很多,

但始终不像“活的系统”。

因为语义在中间已经断掉了。

——

这也是我最近做项目时一个特别大的认知变化。

以前我总觉得:

AI 产品的核心单位是:

- function

- workflow

- tool

- memory node

但现在我越来越觉得:

真正重要的,

可能是:

语义能不能在整个系统里持续流动。

这甚至会决定:

为什么有些 AI 会越来越像助手。

而有些 AI,

永远像客服。

夜雨聆风

夜雨聆风