Claude插件实测Superpowers,省了20刀还跑了2小时

我昨天把 Claude Code 的 Superpowers 插件装上,让它帮我重构一个旧项目,结果这货自己跑了将近两个小时没偏离计划,我在旁边刷了会儿视频回来,测试全绿,分支都清理好了。讲真,这体验比我之前手动催 Claude 写代码再逐行检查爽太多。

我为啥要试这个

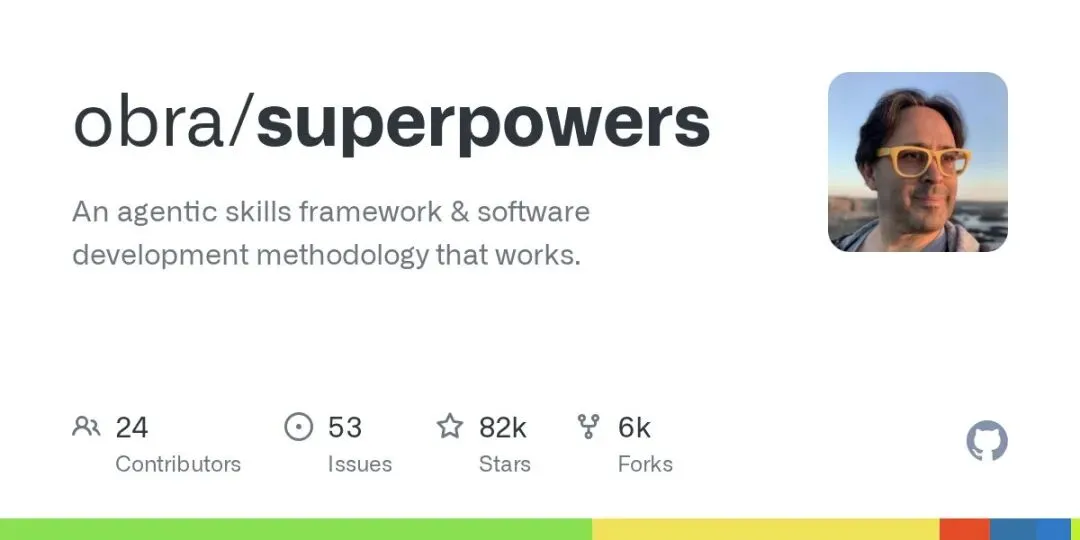

之前用 Claude Code 写代码,经常遇到的情况:我说”帮我加个用户认证”,它唰唰唰写几百行,我看完发现漏了密码重置,再补,又发现没做速率限制,来来回回20刀额度没了,代码还没跑通。obra/superpowers 这个项目在 GitHub Trending 挂了好几天,说白了就是把 Claude 变成一个有完整工作流的开发团队,不是单兵作战。

它的核心就一句话:你的 agent 看到你要写代码,不会直接动手,而是先问你到底要干啥。这个”brainstorming”技能会把你模糊的想法刨根问底,最后输出一段你能真正看完的设计文档,你点头了才进入下一步。

部署过程:三分钟装上,零配置

我用的 Claude Code,安装比想象中简单。官方插件市场直接装:

/plugin install superpowers@claude-plugins-official

如果你没加过官方市场,先执行:

/plugin marketplace add obra/superpowers-marketplace

/plugin install superpowers@superpowers-marketplace

Cursor 用户更省事,Agent 聊天框里直接搜 “superpowers” 或者点安装。Codex 和 OpenCode 得手动,但文档给得很全:

Codex: https://raw.githubusercontent.com/obra/superpowers/refs/heads/main/.codex/INSTALL.md

OpenCode: https://raw.githubusercontent.com/obra/superpowers/refs/heads/main/.opencode/INSTALL.md

Gemini 用户用这个:

gemini extensions install https://github.com/obra/superpowers

gemini extensions update superpowers

装完不用改任何配置,启动新会话,说句”帮我规划这个功能”或者”debug 这个问题”,技能自动触发。你想啊,这比我之前折腾各种 prompt 框架省事多了。

实测:两小时无人值守怎么做到的

我让它帮我给一个 Flask 项目加 API 文档自动生成。流程是这样的:

第一步,brainstorming 技能激活。它没直接写代码,先问我:现有接口有多少?要 OpenAPI 格式还是自定义?文档放在哪?要不要鉴权才能看?问了七八个问题,最后输出一份设计文档,分块展示,我能逐段看完。

第二步,using-git-worktrees。我点了头,它自动切到新分支,跑项目 setup,确认测试基线是绿的。这一步我原本手动做至少 10 分钟。

第三步,writing-plans。设计拆成 12 个小任务,每个 2-5 分钟能做完,标了具体文件路径、完整代码片段、验证步骤。不是那种”实现文档功能”的废话,是能直接执行的 checklist。

第四步,subagent-driven-development。这就是跑了两小时的核心。每个任务派一个新子代理,两阶段评审:先看是否符合 plan 的 spec,再看代码质量。中间有个任务写的测试覆盖了边界情况但漏了主流程,被拦下来重写,我没介入。

第五步,test-driven-development 全程强制执行。RED-GREEN-REFACTOR,先写失败测试,看它失败,写最小代码,看它通过,提交。它甚至会把测试之前写的代码删掉重来,懂的都懂,这规矩我自己守不住。

最后 finishing-a-development-branch 技能收尾:验证测试、给我四个选项(直接合并 / 提 PR / 保留分支 / 丢弃)、清理 worktree。我选了提 PR,它连 PR 描述都写好了。

成本对比:省了多少钱

我算了下,同样复杂度的功能,我之前手动和 Claude 结对编程:

– 来回扯皮明确需求:$3-5

– 写代码我检查返工:$8-12

– 补测试、修 bug:$5-8

– 我注意力分散效率损失:算不清

总计:$15-25,2-3 小时我全程盯着

这次 Superpowers 跑下来,Claude Code 的消耗大概 $4 左右,关键是我只花了 5 分钟看设计文档、点了两次确认,其他时间干别的去了。说白了,这插件把”我盯着 AI 写代码”变成了”AI 按流程自己干,我验收结果”。

技能清单:哪些场景能用

原文列了完整技能表,我按我的理解归类:

开发流程:brainstorming(设计)、writing-plans(拆任务)、subagent-driven-development(执行)、using-git-worktrees(分支隔离)、finishing-a-development-branch(收尾)

代码质量:test-driven-development(强绑 TDD)、requesting-code-review(任务间评审)、receiving-code-review(处理反馈)

Debug:systematic-debugging(四阶段根因分析)、verification-before-completion(确认真修好了)

协作提效:dispatching-parallel-agents(并行子代理)、executing-plans(批量执行带检查点)

每个技能都是强制触发,不是建议。agent 做任何任务前会先检查有没有相关技能,有就用,没有才 fallback 到默认行为。这规矩感,比我团队的 code review 执行得还严。

踩的一个小坑

第一次装完我急着试,说了句”写个登录功能”,它进入 brainstorming 问我具体需求,我嫌烦,说”就标准登录”,结果它追问了三轮”标准”的定义。后来我学乖了,直接复制粘贴我之前的 PRD 片段,它秒懂,设计文档 30 秒出完。划重点:前期输入越清楚,后期它越不需要烦你。

给读者的建议

如果你符合以下任意一条,建议试试:

1. 用 Claude/Cursor 写代码但总返工——Superpowers 的强制流程能省下你反复检查的时间

2. 想实践 TDD 但自己坚持不住——它真的会删掉没测试的代码重写,比代码审查狠

3. 需要同时开多个实验分支——git-worktrees 技能自动管理,切换不脏环境

项目地址:https://github.com/obra/superpowers,MIT 协议,skills 目录直接可见,想改行为或者加自定义技能都可以 fork 了改。更新用 /plugin update superpowers,自动同步。

最后说句个人感受:这项目让我第一次觉得”AI 编程助手”像个能托付的队友,而不是需要我手把手教的实习生。 obra 把软件开发那套成熟流程(TDD、YAGNI、DRY、代码审查)做成了 agent 的默认行为,比我自己守规矩。

你用过类似的 agent 工作流工具吗?是更喜欢这种强制流程,还是想要更灵活的?或者你实测过其他平台的插件?评论区聊聊,我打算试试自己写个 skill 看看门槛多高。

夜雨聆风

夜雨聆风