让 AI 帮我写了个工具,仅花一小时,一年怒省6800元

微博写了大半年,最近想认真复盘一下自己的内容——哪些选题互动高、哪些写法受欢迎、跟其他博主比差在哪。

问题来了:怎么把过去一年的微博内容批量拿到手?

手动翻?一年几百条原创微博 + 上百篇头条文章,一条条复制粘贴,保守估计要干两三天。而且微博的头条文章和普通微博还不在一个体系里,手动根本搞不全。

以前的选择无非两条路:

花钱:乖乖给来总掏 6800 买个经营版会员,用官方的数据分析工具

学技术:自己硬学 Python 写爬虫,从零开始,几周起步

但现在有了第三条路。

一个小时,1092 行代码

虽然我本职是程序员,但说实话,Python 好几年没碰了,基本相当于新手。不过我用 AI 编码助手,一个小时就完成了一个 1092 行的 Python 脚本。

整个过程是”对话式开发”——我说需求,AI 写代码,我跑一下看看结果,有问题就把报错丢回去让它改。像跟一个随叫随到的程序员搭档结对编程。

具体经历了这些轮次:

第一步,跑通最小原型。我只说了一句”帮我抓取我的微博历史记录,只要原创不要转发”,AI 就给了一个能跑的基础版本。

然后发现转发没过滤干净。微博的转发形态五花八门,简单判断根本不够。AI 一口气实现了 6 种检测方法——API 字段、正文特征、URL 模式……比我自己想的周全多了。

接着要爬头条文章。微博的长文(头条文章)是独立系统,API 完全不同。一开始尝试的旧接口直接返回 404,已经废弃了。AI 帮我找到了新的接口方案,还做了 HTML 页面解析来提取全文。

再加参考账号模式。光看自己的不够,还想看看同赛道博主都在写什么。于是加了”参考账号模式”,输入任意微博 ID 就能抓取。

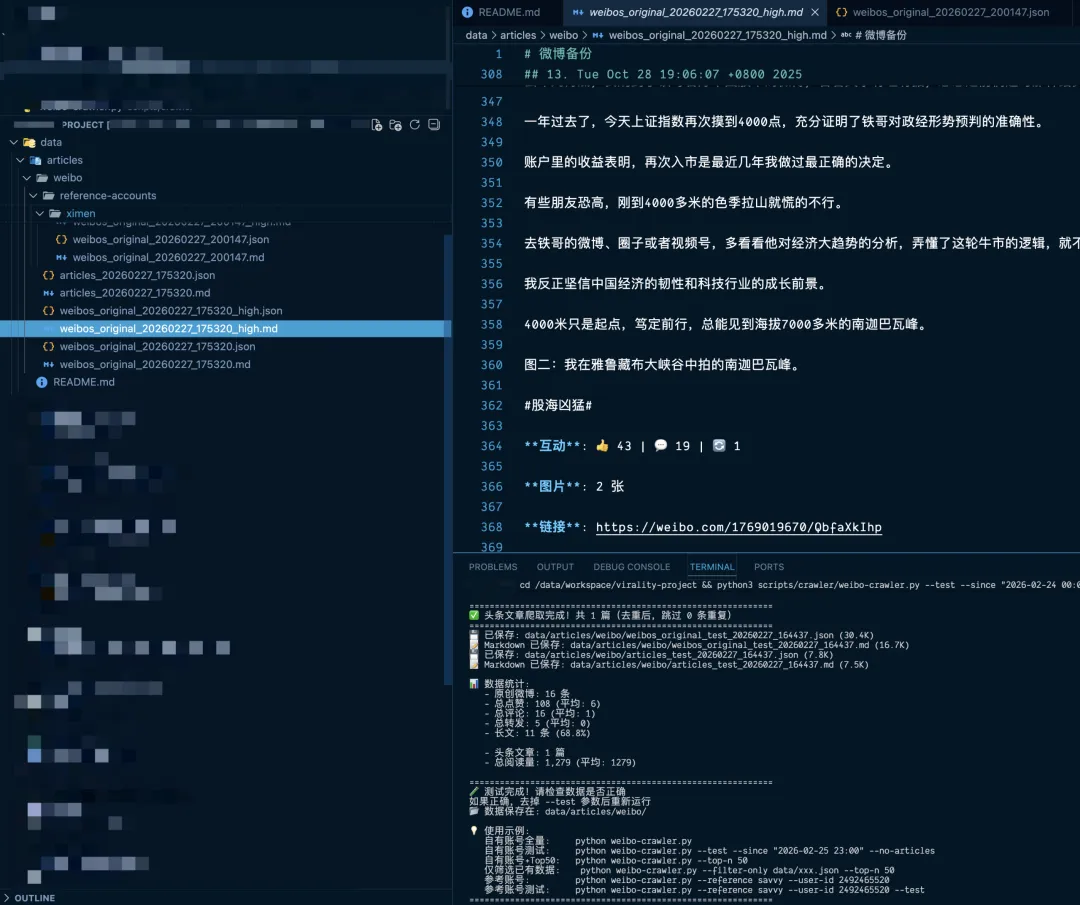

高互动筛选。几百条微博不可能每条都看,让 AI 按「点赞 + 评论×2 + 转发×3」的公式自动排序,直接提取 Top 50。

中间还踩了个坑——微博里有些特殊字符(Unicode 代理对)导致保存 JSON 时程序崩溃。这种底层编码问题我根本不知道是什么,把报错截图丢给 AI,它直接定位了根因,加了两层防护解决了。

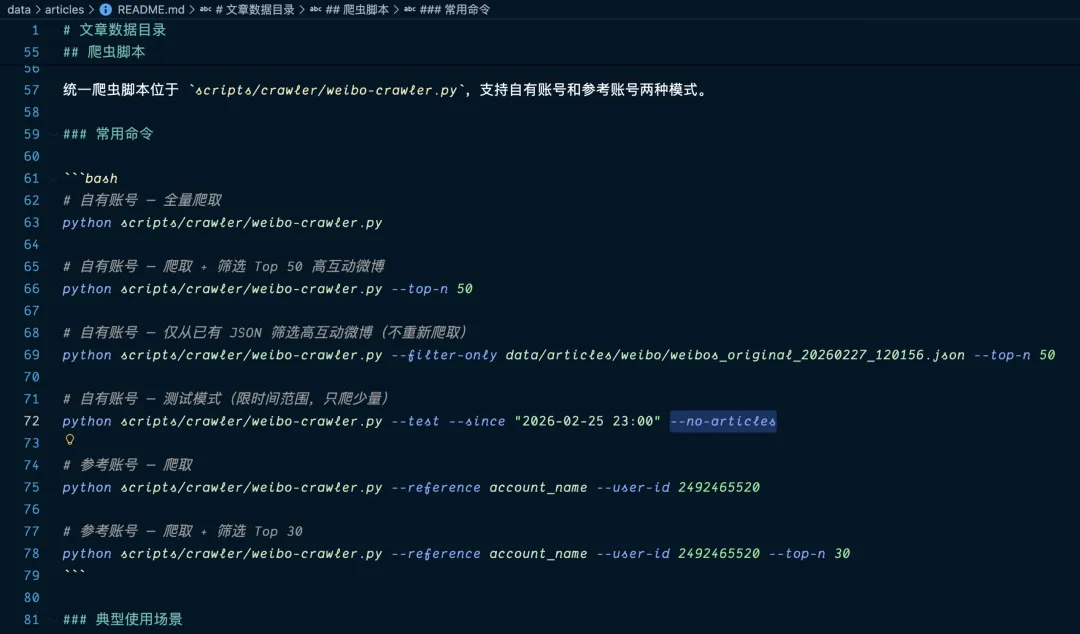

最后,README 文档、代码注释、使用说明,一并让 AI 生成。

最终成果

一行命令,搞定所有事:

-

抓取一年内自己的全部原创微博 + 109 篇头条文章全文(自动去重)+ 高互动 Top 50 -

抓取半年内任意博主的原创微博 + 文章全文 + Top 50 -

输出 JSON + Markdown 双格式,数据分析和阅读都方便

5 大功能:原创过滤、文章抓取、时间过滤、高互动筛选、参考账号。

一小时开发成本,省了 6800 的会员费。而且这工具是自己的,想怎么改怎么改,想跑多少次跑多少次。

几个感概

1. 门槛被抹平了。

整个过程里,我写的”代码”为零。我写的全是自然语言:“帮我加个时间过滤功能”“把转发检测搞准一点”“这个报错怎么回事”。核心能力不是编程,是把需求说清楚。

2. 调试也被 AI 包了。

以前遇到报错,光是看懂错误信息就得查半天。现在把堆栈直接丢给 AI,它能定位根因、给出修复方案。那个 Unicode 代理对的问题,说实话让我自己查,可能要折腾一晚上。

3. 迭代速度惊人。

从”想到一个需求”到”功能落地”,通常只需要一两轮对话,也就几分钟。传统开发里一个需求从提出到上线要几天,这里压缩到了分钟级。

4. AI 不只是写代码,还帮你做技术决策。

旧 API 废弃了?它帮你找替代方案。用 codecs.decode 有 DeprecationWarning(说实话我两个名词具体我也不太懂,好像就是某个python组件废弃了)?它建议你换正则实现。

前提是你得提出合适的问题。

5. 但人的价值没有消失。

AI 不会替你决定”要分析什么”“怎么算高互动”“哪些博主值得参考”。这些判断是你的,AI 只负责执行层面的一切。

人负责方向,AI 负责落地——这可能是未来很长一段时间的协作模式。

对普通人的启示

AI 时代,编程能力不再是门槛,需求表达能力才是核心竞争力。

你不需要学 3 个月 Python 才能写一个爬虫,你只需要能说清楚:我要什么数据、什么格式、什么条件。

重点不是”AI 能写代码”,而是——你过去放弃的那些想法,现在都能实现了。

所以我的建议是:先别想学什么编程语言,先想想你有什么”一直想做但觉得做不了”的事。

然后打开 AI,跟它聊聊。

夜雨聆风

夜雨聆风