AI 安全工具,为什么开始从“找漏洞”走向“验证与修复”

很多人对 AI 编程工具已经不陌生了。它们能补全代码、解释报错、帮人加快开发流程。过去两年,这类工具给人的总体印象,大多是一个效率助手。

但 OpenAI 最近推出的 Codex Security,真正值得看的地方,并不只是“又多了一个安全工具”。如果只把它理解成一次产品扩展,反而容易错过更重要的信号:AI 正在尝试进入更高责任的安全工作流,而且不再只停留在生成和建议层面,而是开始向验证、修复和流程闭环靠近。

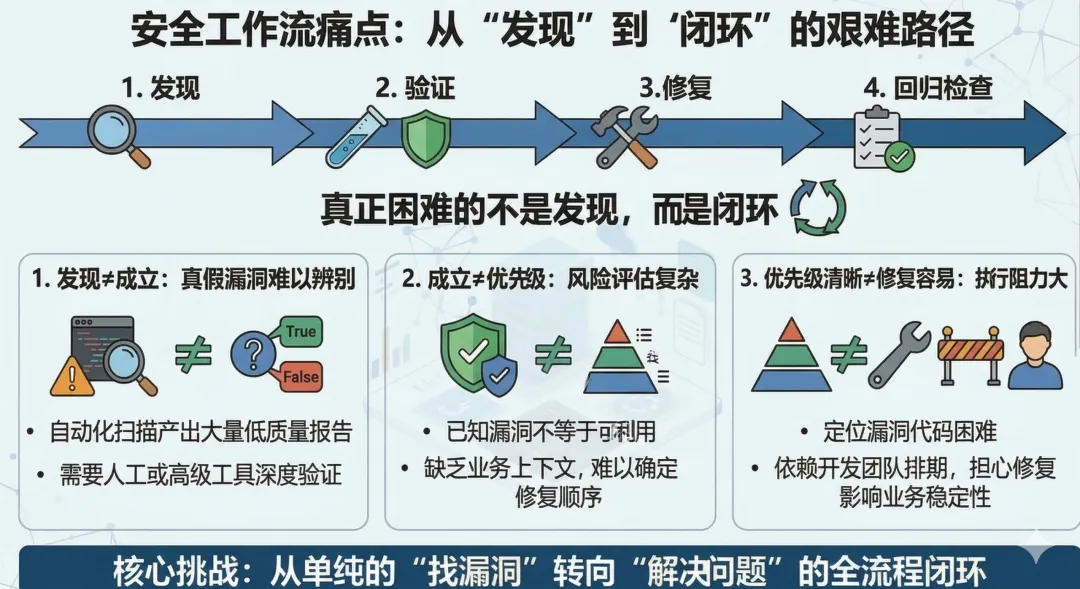

这件事之所以值得关注,是因为安全并不是普通的软件辅助场景。这里真正困难的,从来不只是“发现问题”,而是判断问题是否真实、风险是否成立,以及修复是否会带来新的代价。

【这件事为什么说明 AI agent 正在尝试进入更高责任的工作流?】

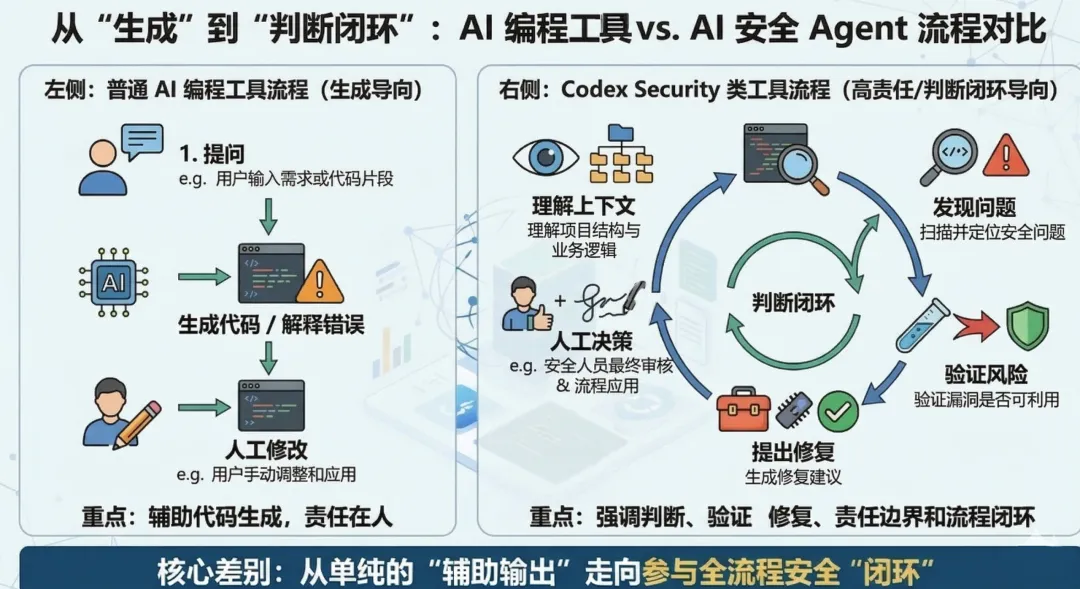

如果只看表面,Codex Security 仍然只是一个具体产品。但如果往上看一层,它更像是一个行业信号:AI agent 的目标,已经不只是帮人生成内容、调用工具,而是开始尝试进入那些本来由专业团队负责、且结果带有明确责任后果的流程。

这和前一阶段的 AI 产品逻辑不太一样。前一阶段很多工具的价值,主要建立在“把人手里的零散任务自动化一点”。比如帮你起草邮件、整理会议纪要、生成代码初稿、总结文档。这些场景当然有用,但它们普遍有一个特点:即使 AI 做错了,通常也还有相对低成本的人工纠正空间。

而安全工作流不是这样。它天然要求更高的可信度、更清楚的边界、更完整的审计路径。一个安全 agent 如果真的想进入这个环节,它必须回答很多以前不那么尖锐的问题:它的判断依据是什么?它在什么条件下会误判?它有没有越权风险?修复建议是否会影响系统稳定性?出了问题,责任最终落在哪里?

也正因为如此,安全是一个很好的观察窗口。它比普通办公协作更能说明:AI agent 的下一阶段,不只是“更会做事”,而是“能不能在有责任约束的流程里做事”。

当然,这并不意味着 AI 已经可以接管安全工作,更不意味着安全工程师会被迅速替代。现实情况很可能恰恰相反:越是高责任场景,越需要人把 AI 放进一个可审查、可回退、可追责的流程里。从这个角度看,Codex Security 的意义不在于它已经证明 AI 可以独立负责安全,而在于它显示出,行业正在认真尝试把 AI 放进这类高要求的流程之中。

这也是为什么这类产品值得普通科技读者关注。它不只是安全圈里的一个新工具,而是在提醒我们:AI 下一阶段的竞争,可能不再只是“谁更聪明、谁更快”,而是“谁更能进入真实工作流,并且在责任边界内稳定运行”。

图 3:普通 AI 编程工具更偏向“辅助输出”,而 Codex Security 这类 AI 安全工具更强调理解上下文、验证风险、提出修复,并参与流程闭环。

【结尾】

所以,Codex Security 真正值得看的,不是“AI 又学会了一个新技能”,而是它把一个更本质的问题摆到了台面上:当 AI 不只是负责输出,而是开始参与判断、验证和修复时,我们该怎么看它进入工作流的边界?

这不是一个可以轻易乐观的题材,因为安全工作天然要求克制、验证和责任感;但它也确实说明,AI agent 的发展方向正在发生变化。过去我们更常把 AI 当成一个会说、会写、会生成的助手。现在,一些产品已经开始尝试让它进入那些对判断质量和流程闭环要求更高的场景。

它离“接管安全工作”显然还很远,但离“参与安全工作流的一部分”已经更近了。这种变化,可能比“又一个会写代码的 AI 工具”更值得认真看待。

来源说明:本文主要依据 OpenAI 官方页面《Codex Security: now in research preview》(2026-03-06)整理,并结合公开信息对其产品定位与工作流意义作解释性分析。文中图表基于原研究公开图示整理,中文标注为阅读辅助。我会继续记录 AI、科技和数字工具里那些真正影响工作与日常生活的新变化。觉得这篇有用的话,欢迎留在这里。

夜雨聆风

夜雨聆风