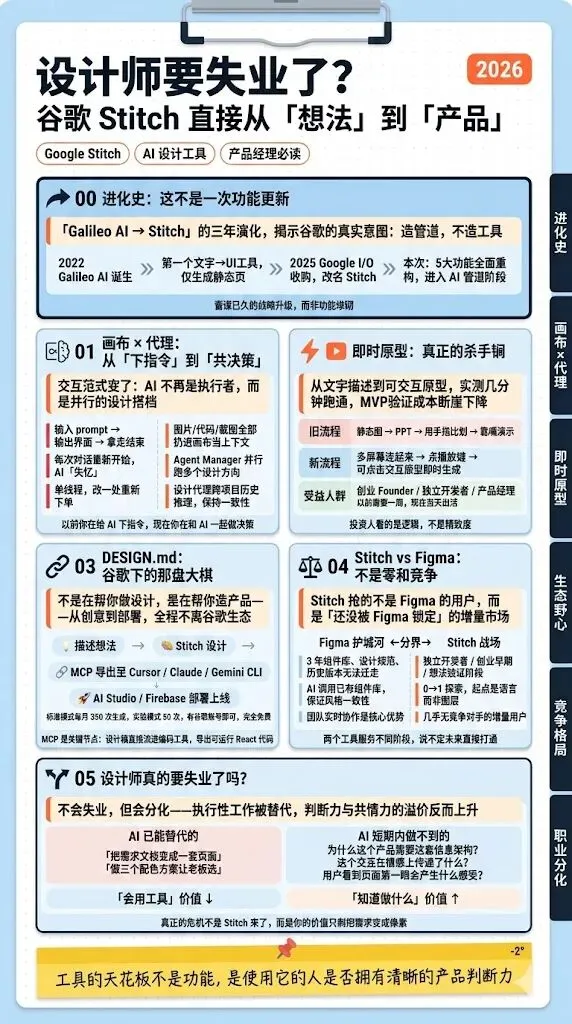

设计师要失业了?谷歌这个工具直接从"想法"到"产品"

如果你可以对着屏幕说一句话,几秒后就看到一个可以点击的完整产品原型—— 你还需要设计师吗?

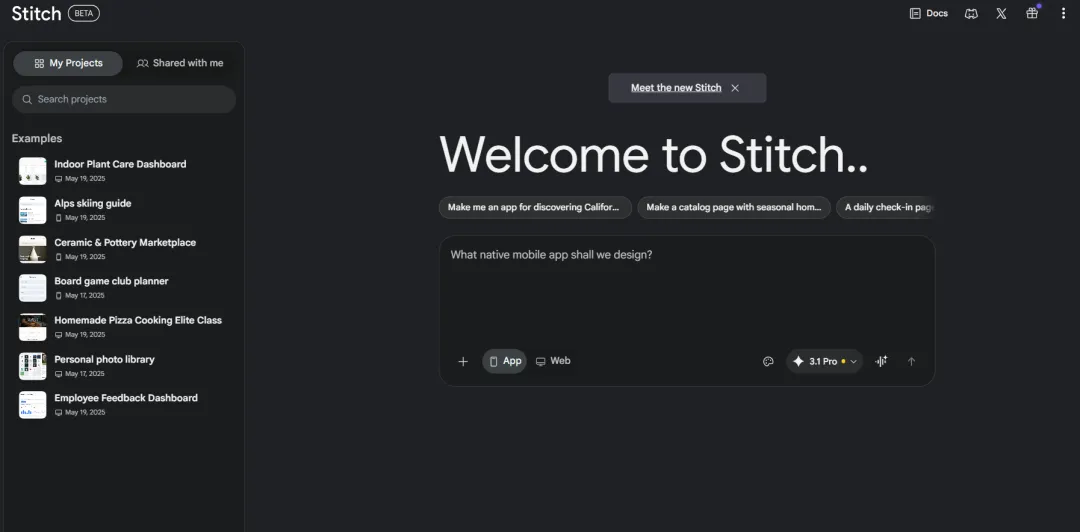

工具叫 Stitch ,谷歌把它定义为你的「氛围设计伙伴」。听起来像是某种下午茶品牌,但实际上,它可能是 这一年里对设计行业冲击最大的一次更新 。

很多人不知道,Stitch 本来不是谷歌自己造的东西。

它的前身叫 Galileo AI ,2022 年出来的时候算是划时代产品——第一个能把文字描述变成 UI 设计稿的工具。当时设计圈炸锅了,觉得这东西要抢饭碗,结果后来发现它只能生成静态页面,用完还要手动搬进 Figma 继续改,不少人用了一两次就放下了。

2025 年 Google I/O,谷歌把 Galileo 收购了,改了个名字叫 Stitch,塞进 Google Labs 孵化。

当时版本还很基础:输入文字,出几张 UI 图,能导出 Figma 文件和 HTML/CSS 代码,没了。能解决从零到有的问题,但 前 80% 的路靠它,剩下 20% 的细活全得自己来 。

旧版 Stitch 的工作方式很线性:你输入 prompt,它输出界面,你拿走,结束。就像点外卖, 餐厅做什么你吃什么,改一个细节还得重新下单。

现在的 Stitch 是一块真正意义上的无限画布,你可以直接把 图片、代码片段、参考截图、文字描述 ,统统扔进去当上下文。

比如你做一个健康 App,可以把竞品截图拖进画布,旁边写一段「我想要比这个更温暖的风格,用户群是25-35岁女性」,然后让 AI 在这个语境里设计,而不是对着空白从头说清楚一切。

更重要的是,配合画布的还有一个新的 Agent Manager 。它可以同时帮你跑多个设计方向——你不用等第一个方案出来再想要不要改,可以让 AI 并行探索三种风格,你坐在那里选, 有点像让实习生同时赶三稿 。

以前你在给 AI 下指令, 现在你在和 AI 一起做决策。

这条功能说起来很简单,但解决了一个一直很烦人的问题。

以前的 AI 设计工具本质上是「失忆的」,每次对话都是新开始。你上次说要用某个按钮风格,这次它完全不记得,生成出来的东西和上次的一点都对不上,你还得反复解释。

新版 Stitch 的设计代理可以 跨整个项目的历史来推理 。它知道你在第三张画布上改过配色,知道你最后选了哪个导航样式,再生成新屏幕的时候,它会往前翻,保持一致性。

一个评测者的评价让我觉得很真实,他说旧版 Stitch 「会忘掉你喜欢的组件,或者用奇怪的方式重新解读它们」。这个问题现在被针对性地修了。

当然,说「记得」也是相对的,AI 的上下文理解还是有边界,复杂到几十个屏幕的大型项目里,它还是可能偶尔跑偏。但比起之前的失忆状态, 已经是质的飞跃。

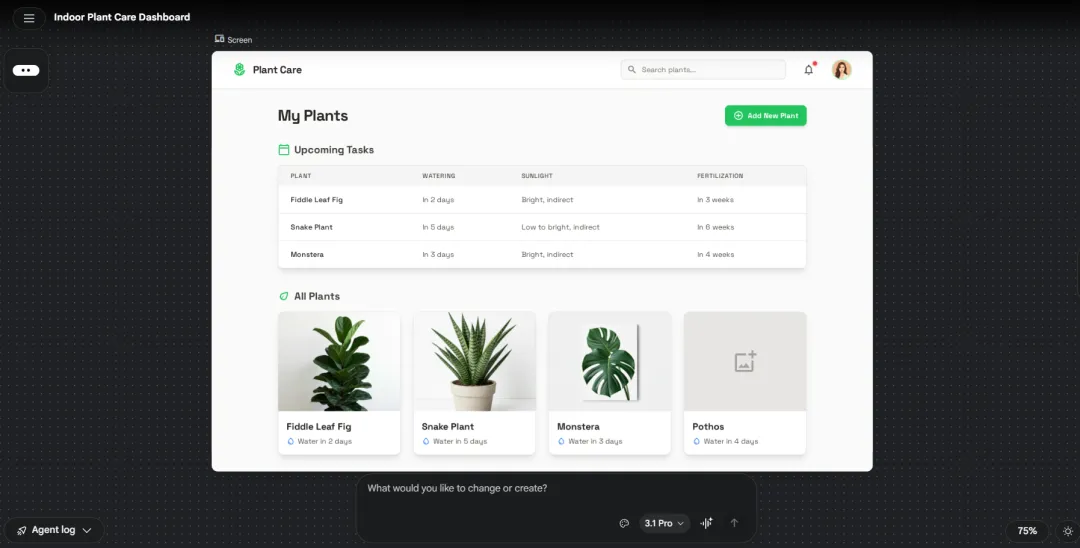

以前用 Stitch 生成的东西,是一张图。一张很好看的图,但就是图。你要演示给老板或者客户看,还得截图放进 PPT,或者用手指比划「这里点进去会跳转到这个页面」,靠嘴说。

你把设计的多个屏幕在画布上连起来,点一个播放键,Stitch 会直接给你一个 可以点击的交互原型 。更绝的是,如果你只设计了登录页,它能根据逻辑自动推断下一个页面应该长什么样,帮你把用户旅程填完整。

整个流程从文字描述到可交互原型, 实测在几分钟内可以跑通。

以前做一个 MVP 原型用来融资路演,没个熟练的设计师帮忙,少说一周。现在呢?自己上,当天出活。

说到底, 投资人看的不是设计有多精致,而是逻辑说不说得通 。Stitch 给了你一个够用的演示载体,剩下的靠你讲故事。

这个功能目前还是预览版,但值得单独说一下,因为它代表了一种 全新的交互方式 。

Stitch 接入了 Gemini Live 语音能力,你可以直接对着画布说话:

你可能会说,这不就是把打字换成说话?差不多,但又不太一样。

设计本质上是一个非常感性、难以精确描述的过程。有时候你不知道自己要什么,是说着说着才想清楚的。「再亮一点,不对,太亮了,往回一点, 对就这个感觉 」——这种对话,打字真的没有说话顺畅。

更有意思的是,你可以让它反过来「采访」你——你说我要做一个健身 App,它会开始问你:目标用户是谁?主要功能是什么?风格偏向运动激情还是健康平静?然后根据你的回答去设计。

这有点像和真人设计师开需求会,只不过 这个设计师几秒钟就能出稿,而且不会中途说「这个要额外加钱」 。

前四个功能,算是用户体验层面的升级。这第五个, 才是谷歌真正的战略意图所在 。

DESIGN.md 是一个可以导入导出的设计系统文件。你可以从任意 URL 抓取一个产品的设计规范,或者把自己项目里沉淀下来的 颜色、字体、组件风格 ,打包成一个 DESIGN.md 文件,在不同项目之间携带和复用。

这件事本身不算革命,Figma 早就有组件库和设计系统了。但 DESIGN.md 的真正价值,在于它 连接了谷歌的整个 AI 开发管道 。

Stitch 有一个 MCP 服务器(MCP 是现在 AI 工具互联的标准协议),通过这个接口,你的 Stitch 设计稿可以直接流进 Cursor、Claude、Gemini CLI 这些编码工具。静态设计变成可交互原型,原型再导出为真正可运行的 React 应用代码。

💡 描述想法

↓

🎨 Stitch 设计

↓

🔗 MCP 导出

↓

🚀 AI Studio / Firebase 部署上线

这不是在帮你做设计, 这是在帮你造产品 。而且,完全免费——标准模式每月 350 次 生成,实验模式 50 次 ,不需要绑信用卡,有谷歌账号就能用。

Figma 的核心护城河不是「能不能生成 UI」,而是 团队协作和组织积淀 。一个设计团队用了三年 Figma,组件库、设计规范、历史版本都在里面,这些东西没法一夜之间迁走。而且 Figma 的 AI 功能调用的是团队已有的组件库,能保证和现有风格的一致性,这是 Stitch 目前做不到的。

但 Stitch 不是来和 Figma 抢存量用户的, 它抢的是那些「还没被 Figma 锁定」的人。

独立开发者、创业公司早期、产品经理自己验证想法——这些场景里,没人会先去买一个 Figma 专业版账号、花两周搭组件库,然后才开始画第一个页面。Stitch 在这些场景里 几乎没有竞争对手 。

❌ 没有多人实时协作 ——团队共同推进的项目,还没办法像 Figma 一样多人同时在上面工作

❌ 可访问性审计不稳定 ——AI 生成的界面在颜色对比度和触控区域大小上,时不时会出现不符合规范的情况,需要人工复查

❌ 住在 Google Labs 里 ——Google Labs 是谷歌孵化实验产品的地方,出过不少好东西,但也关过不少

Google Reader、Stadia、Inbox……这份名单不短。🙃

Galileo AI 被收购之后的更新频率,加上这次几乎是全面重做的大版本,能看出谷歌确实在认真投入。但任何人把自己的核心工作流完全押注在 Google Labs 的产品上,都应该 手边备好 Figma 导出文件 。

低阶的执行性工作——「把这个需求文档变成一套页面」「做三个配色方案让老板选」——这些 Stitch 已经做得够用了,而且会越来越好。

这些问题的答案, 不是从 prompt 里生成出来的,是从对人的理解里长出来的。

设计师行业真正的危机,不是 Stitch 来了。而是 如果你的工作价值只停留在把需求变成像素,那无论有没有 Stitch,这份工作都会越来越难做。

Stitch 现在就可以用,有谷歌账号就能登录,免费的。

输入一个你脑子里放了很久的 App 想法,看看它给你什么。

有时候,你一直没做某件事,不是因为不知道怎么做, 只是没有一个足够低的起点。

本文图片来源:谷歌官方发布及 @stitchbygoogle 社交媒体账号

夜雨聆风

夜雨聆风