我把鲁迅的文章丢进AI检测工具,结果沉默了

昨晚睡前,我手滑点进一个AIGC检测页,顺手贴了鲁迅《秋夜》的开头两段:

在我的后园,可以看见墙外有两株树,一株是枣树,还有一株也是枣树。

……

他的口角上现出微笑,似乎自以为大有深意,而将繁霜洒在我的园里的野花草上。

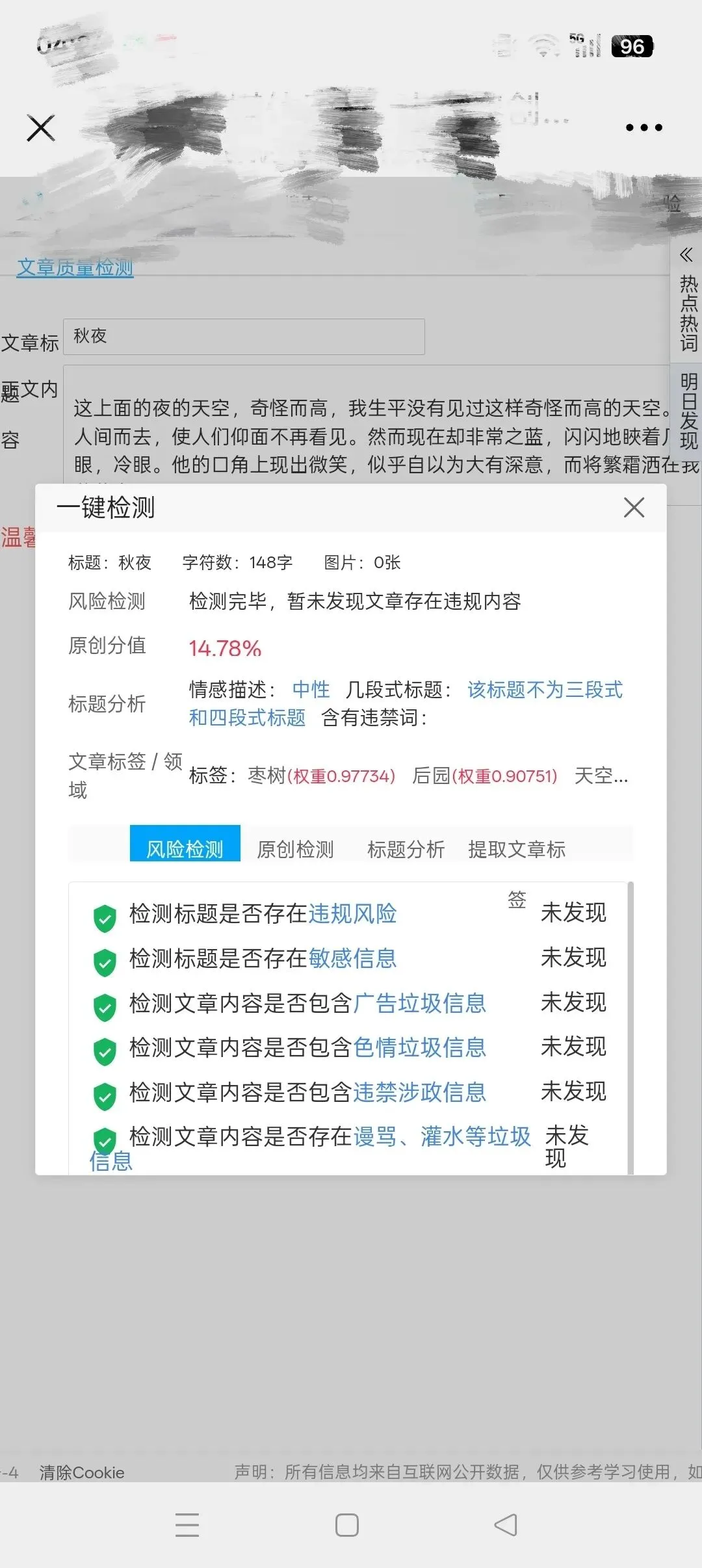

几秒后,屏幕弹出结果:原创分值:14.78%。

也就是说,系统认为这段话有85.22%的概率是AI写的。

我对着屏幕愣了半天。我想,鲁迅先生要是泉下有知,自己精心设计的“重复句式”,百年后竟然被机器当成了“AI废话”,怕是要从课本里坐起来,点一支烟,对着屏幕冷笑一声。

但气归气,冷静下来想了想,这事儿还真不能全怪那个不懂事的检测工具。

检测工具根本不知道文章是谁写的。

它没有意识,它不知道什么是“孤寂”,什么是“执拗”。它唯一能做的,就是把你的文字扔进它的“AI范文库”里做比对——看“像不像”,而不是“是不是”。

说白了,这就是一场没有感情的“找茬游戏”。

那什么样的文字”像AI”?我总结了三条,你可能也中过招:

第一,太规整。句子长短均匀,段落工整,逻辑递进清晰得像教科书。”首先……其次……最后……”这类结构,AI一天能生成一万篇。

第二,太顺溜。看了上句能猜出下句。”随着社会的发展”后面八成是”人们的生活水平不断提高”。这些套路,语言模型比你熟。

第三,太”安全”。”值得注意的是””综上所述”这些词,在AI文章里出现的频率,比相亲时听到”你条件挺好”还高。

可鲁迅写”一株是枣树,还有一株也是枣树”时,会想着”这段得写得不那么像AI”吗?

不会。他只是用这种独特的重复,传达那份孤寂与执拗。

检测工具一看:句式简单、用词重复、模式固定——像AI,打分,14.78%!

这让我想起一个做公众号的朋友。

上周,她有篇稿子被平台判定“疑似AI生成”,推荐量直接砍半。

她截图给我,气笑了:“我改到凌晨两点,查资料、敲键盘,一个字一个字敲出来的,你说我是AI?”

我当时还安慰她是误判,现在才懂,在检测工具眼里,真人认真写出来的文字,和认真调试AI得出的文字,有时真的很难区分。

更讽刺的是,如今很多AI模型本就是用人写的内容训练出来的。

AI模仿人写作,人用工具检测AI,结果工具把人写的判成了AI。

堪称”文字界套娃”。

我不是说检测工具完全无用。

碰上通篇”随着……进一步……在……共同努力下……”这类模板文,它确实能提供参考。

只不过,如今某些人类写手和AI,已经在”正确的废话”赛道上胜利会师了。

麻烦的是,现在越来越多地方把检测结果当成”铁证”:

老师查学生作业,平台判原创,HR筛笔试。听说有学生因论文被误判为AI,答辩都差点没过。

这就魔幻了。

人写的被当成AI毙掉,AI写的用人工改一遍反而过关。到最后,吃亏的往往是那些老老实实憋字、改稿、对每一句负责的人。

所以回到开头的问题:当鲁迅的经典句式都能被判14.78%原创,我们还能相信检测结果吗?

我的答案是:可以信一半,另一半留给自己。

技术可以辅助判断,但不该成为最终裁判。它能告诉你这篇文章”像不像AI”,但它永远不知道——

这是不是深夜里反复打磨的那一版, 是不是写完后读给猫听、猫都不理的那一版, 是不是发出后每隔三分钟就刷新阅读数的那一版。

这些带着体温的细节,只有你自己知道。

所以我现在想通了:以后工具说我”像AI”,我就当它在夸我。

至于鲁迅先生,那14.78%不是您的分数——是这个时代,给认真写字的人打的差评。

但没关系。一百年后,您的枣树还在课本里。而这些检测工具,早换了八百代。

你在写作时,有没有遇到过被误判成AI的离谱情况?欢迎在评论区聊聊,让我们一起吐吐槽。

夜雨聆风

夜雨聆风