n8n-MCP发布,1000+节点让AI助理秒懂工作流

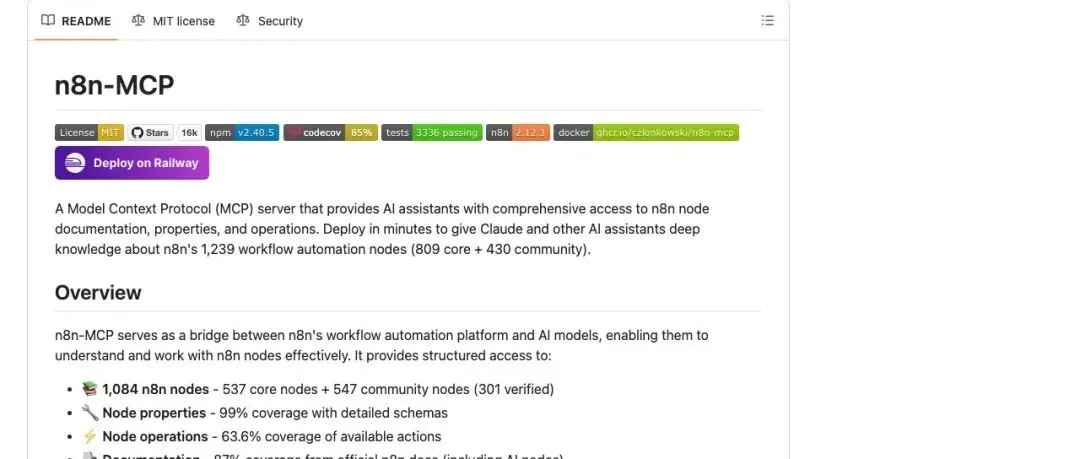

想用AI帮你搭建n8n工作流,但发现它连节点参数都搞不清?现在有个新工具,把n8n的1084个节点文档全打包喂给AI,Claude瞬间变成n8n专家。

- 覆盖1084个n8n节点(537个核心+547个社区节点),99%的节点属性都有详细schema

- 内置2709个工作流模板和2646个预提取配置,AI直接参考真实案例

- 3种部署方式:云端服务免安装、npx本地运行、Docker容器化,最快3分钟搞定

这玩意儿到底能干啥?

说白了,n8n-MCP就是个AI和n8n之间的翻译官。以前你让Claude帮你写个n8n工作流,它可能连“HTTP Request节点”有哪些参数都不知道,现在这个MCP服务器把n8n官方文档、节点属性、操作说明全结构化喂给它。

数据覆盖得相当全:1084个节点(其中547个是社区节点,301个已验证),265个AI工具变体,63.6%的节点操作都有覆盖。最实用的是那2646个从热门模板提取的配置,AI能直接参考真实世界的用法。

安全警告必须看

官方文档里用大红字警告:绝对不要用AI直接编辑生产环境的工作流!AI输出可能不稳定,你得先做这几件事:

1. 用AI工具前,先复制一份工作流

2. 在开发环境测试

3. 导出重要工作流的备份

4. 验证所有修改再部署到生产

三种部署方式任选

如果你就想快速试试,选云端服务最省事:

网址:dashboard.n8n-mcp.com

免费版:每天100次工具调用

特点:免安装、即时访问、自动更新、不用管基础设施

用法:注册拿API key,连上你的MCP客户端就行

想自己部署的话,两个选择:

Option A: npx本地运行(最快)

前提是你得有Node.js,然后直接:

npx n8n-mcp

接着配置Claude Desktop,关键点:必须设置MCP_MODE: “stdio”环境变量,不然会报JSON解析错误。基础配置(只开文档工具):

{

“mcpServers”: {

“n8n-mcp”: {

“command”: “npx”,

“args”: [“n8n-mcp”],

“env”: {

“MCP_MODE”: “stdio”,

“LOG_LEVEL”: “error”,

“DISABLE_CONSOLE_OUTPUT”: “true”

}

}

}

}

如果你还想让AI管理n8n工作流(创建、更新、执行),加上n8n API凭证:

“env”: {

“MCP_MODE”: “stdio”,

“LOG_LEVEL”: “error”,

“DISABLE_CONSOLE_OUTPUT”: “true”,

“N8N_API_URL”: “https://your-n8n-instance.com”,

“N8N_API_KEY”: “your-api-key”

}

配置文件位置:

macOS:~/Library/Application Support/Claude/claude_desktop_config.json

Windows:%APPDATA%\Claude\claude_desktop_config.json

Linux:~/.config/Claude/claude_desktop_config.json

配完记得重启Claude Desktop。

Option B: Docker部署(隔离性好)

先装Docker,然后拉镜像:

docker pull ghcr.io/czlonkowski/n8n-mcp:latest

这个镜像优化得很猛,比典型n8n镜像小82%,因为它不含n8n依赖,只有MCP运行时和预建数据库。基础配置:

{

“mcpServers”: {

“n8n-mcp”: {

“command”: “docker”,

“args”: [“run”, “-i”, “–rm”, “–init”, “-e”, “MCP_MODE=stdio”, “-e”, “LOG_LEVEL=error”, “-e”, “DISABLE_CONSOLE_OUTPUT=true”, “ghcr.io/czlonkowski/n8n-mcp:latest”]

}

}

}

注意那个-i参数是必须的,MCP stdio通信要用。如果本地跑n8n(比如用Docker),API URL用http://host.docker.internal:5678,还要设置WEBHOOK_SECURITY_MODE=moderate允许本地webhook。

关于内存:n8n-mcp用SQLite存节点文档,默认用better-sqlite3(C++绑定,性能最好),内存占用100-120MB。如果编译失败会fallback到sql.js(纯JavaScript),内存占用150-200MB。

默认会收集匿名使用统计,想关掉的话:

npx用户:npx n8n-mcp telemetry disable

Docker用户:加环境变量N8N_MCP_TELEMETRY_DISABLED=true

留言聊聊

你现在搭建n8n工作流,是手动搭还是用AI辅助?如果AI能直接帮你写工作流,你最想让它自动化什么任务?

来源:GitHub Trending (All)|原文:czlonkowski/n8n-mcp

夜雨聆风

夜雨聆风