OpenClaw 之后,这 3 个智能体工具值得关注

OpenClaw 火了之后,我在后台收到最多的问题是:

“有没有更稳妥的替代方案?”“智能体工具还能碰吗?”“哪个适合个人用户?”

之前我写过 OpenClaw 的安全分析,今天给大家推荐一些我实测的平替工具。

如果你想找智能体工具,这 3 个值得关注。

一、为什么是这 3 个

选这 3 个,我有 4 个标准:

1. 安全性优先

云厂商托管、权限可控、有审计日志,这三点至少要占两点。

2. 生态成熟度

智能体工具的价值在于能调用多少应用、支持多少场景。生态越成熟,能干的活越多。

3. 上手难度

个人用户没有专业安全团队,工具必须开箱即用,配置不能太复杂。

4. 成本可控

免费或免费额度够用,别让读者花冤枉钱。

基于这 4 个标准,我选了 Coze、Dify、LangChain 这三个。

二、Coze(字节出品,生态好)

适合人群:个人用户、内容创作者、需要快速搭建智能体的

部署方式:云端托管(字节火山引擎)

安全等级:中高(云厂商托管,安全配置已预处理)

优势

1. 生态整合能力强

Coze 是字节出品,和抖音、飞书、微信都能打通。我试了一下,创建一个智能体,发布到飞书机器人,全程不到 10 分钟。

2. 插件市场丰富

官方插件 + 社区插件,目前支持 200+ 技能。查天气、搜新闻、生成图片、处理表格,常用功能都有。

3. 免费额度够用

个人用户免费版每天有一定额度的调用量,轻度使用完全够用。我用了两周,没花一分钱。

4. 可视化搭建

不用写代码,拖拽式界面,配置流程像搭积木。对非技术用户友好。

劣势

1. 深度定制能力弱

可视化搭建方便,但复杂逻辑实现不了。如果你需要高度定制,Coze 可能不够用。

2. 数据出域问题

云端托管,数据会经过字节服务器。对数据敏感的企业用户需要考虑。

3. 国内版和国际版功能有差异

国内版插件少一些,部分功能受限。

Token 消耗

Coze 使用字节自家的豆包模型,Token 消耗相对可控。

-

• 免费版:每日有一定免费额度,轻度使用够用 -

• 付费版:按量计费,约 0.008 元/千 Token(输入),0.024 元/千 Token(输出) -

• 我的实测:搭了一个”周报生成器”,两周用了约 50 万 Token,没花钱

我的实测

我用 Coze 搭了一个”周报生成器”,输入本周工作内容,自动生成周报。

-

• 耗时:15 分钟搭建,5 分钟调试 -

• 效果:能用,但需要调整提示词 -

• 成本:免费版,0 元

适合场景:

-

• 内容创作(写文章/生成脚本) -

• 客服自动化(回答常见问题) -

• 个人效率工具(待办/提醒/整理)

三、Dify(开源,可自部署)

适合人群:企业用户、技术用户、对数据敏感需要本地部署的

部署方式:开源可自部署 / 云端托管可选

安全等级:高(本地部署数据不出域)

优势

1. 开源可自部署

代码开源,可以部署在自己服务器上。数据不出域,适合对安全要求高的场景。

2. 支持多模型

不绑定特定大模型,可以接通义、Kimi、MiniMax 等,自由选择。

3. 工作流可视化

和 Coze 类似,也是可视化搭建,但逻辑更灵活,支持复杂流程。

4. 社区活跃

GitHub 上 star 数增长快,社区插件和模板多,有问题容易找到解决方案。

劣势

1. 部署有门槛

自部署需要一定的技术能力,Docker、服务器配置都要懂。个人用户可能搞不定。

2. 维护成本

自己部署就要自己维护,更新、备份、安全补丁都要管。

3. 生态不如 Coze 丰富

插件数量比 Coze 少,部分功能需要自己开发。

Token 消耗

Dify 不绑定特定模型,Token 消耗取决于你接哪家大模型。

-

• 接通义千问:约 0.004 元/千 Token(输入),0.012 元/千 Token(输出) -

• 接 Kimi:约 0.005 元/千 Token(输入),0.015 元/千 Token(输出) -

• 接 MiniMax:约 0.002 元/千 Token(输入),0.008 元/千 Token(输出) -

• 我的实测:部署后接通义千问,一个月用了约 200 万 Token,花费约 10 元

省钱技巧:可以切换不同模型,简单任务用便宜模型,复杂任务用贵模型。

我的实测

我在一台云服务器上部署了 Dify,接入了通义千问模型。

-

• 耗时:部署 2 小时,配置 1 小时 -

• 效果:稳定,数据完全可控 -

• 成本:服务器约 100 元/月 + Token 费用约 10 元/月

适合场景:

-

• 企业内部工具(数据敏感) -

• 定制化智能体(需要复杂逻辑) -

• 技术用户折腾(愿意投入时间)

四、LangChain(开发者向,灵活)

适合人群:开发者、技术团队、需要高度定制的

部署方式:代码开发,自己部署

安全等级:中(取决于你的部署方式)

优势

1. 灵活性最高

LangChain 是代码框架,不是可视化工具。你想怎么实现就怎么实现,没有上限。

2. 社区生态强大

全球开发者都在用,文档齐全,示例代码多,遇到问题容易找到答案。

3. 支持多语言

Python、JavaScript 都支持,技术栈选择灵活。

4. 和大厂集成好

和 OpenAI、Anthropic、国内大模型都能对接,不绑定特定供应商。

劣势

1. 学习曲线陡

需要编程能力,非技术用户基本用不了。

2. 开发周期长

从零开发一个智能体,可能需要几天甚至几周。

3. 维护成本高

代码自己写,bug 自己修,更新自己跟。

Token 消耗

LangChain 不绑定特定模型,Token 消耗完全由你控制。

-

• 可以自由切换模型,优化成本 -

• 可以缓存重复查询,减少 Token 消耗 -

• 可以设置 Token 上限,防止超支 -

• 我的实测:写了一个”文档问答助手”,通过缓存优化,Token 消耗减少约 40%

省钱技巧:

-

1. 启用缓存,重复问题不重复调用 -

2. 设置 Token 上限,超出自动停止 -

3. 简单任务用便宜模型,复杂任务用贵模型

我的实测

我用 LangChain 写了一个”文档问答助手”,上传 PDF 后能回答问题。

-

• 耗时:开发 2 天,调试 1 天 -

• 效果:灵活,完全按需求定制 -

• 成本:时间成本高,服务器约 50 元/月 + Token 费用约 20 元/月

适合场景:

-

• 开发者学习智能体开发 -

• 企业定制化需求 -

• 需要和大模型深度集成的场景

五、3 个工具对比总结

|

|

|

|

|

|---|---|---|---|

| 上手难度 |

|

|

|

| 安全等级 |

|

|

|

| 生态丰富度 |

|

|

|

| Token 成本 |

|

|

|

| 适合人群 |

|

|

|

六、Token 消耗真相:智能体为什么费 Token

很多人问:”为什么智能体工具比普通对话费 Token?”

原因很简单:智能体要干活,不只是聊天。

普通对话:你问一句,AI 答一句,一次调用。

智能体:你给一个任务,AI 要拆解、要调用工具、要多次迭代,可能十几次调用。

openrouter 平台数据显示:

OpenClaw 类智能体工具,占平台 Token 消耗量的 95% 以上。也就是说,智能体是 Token 消耗的主力。

而且主要用的是国产大模型。阶跃星辰和 MiniMax 两款国产模型,就占到总 Token 消耗量的约 50%。

MiniMax 的业绩佐证了这一点。

2026 年前两个月,M2 系列文本模型平均单日 Token 消耗量较 2025 年 12 月增长 6 倍,其中 Coding Plan 的 Token 消耗量增长超过 10 倍。

这意味着什么?

-

1. 智能体工具确实费 Token,但价值也更大 -

2. 选对模型可以省不少钱 -

3. 优化使用习惯,Token 消耗能降下来

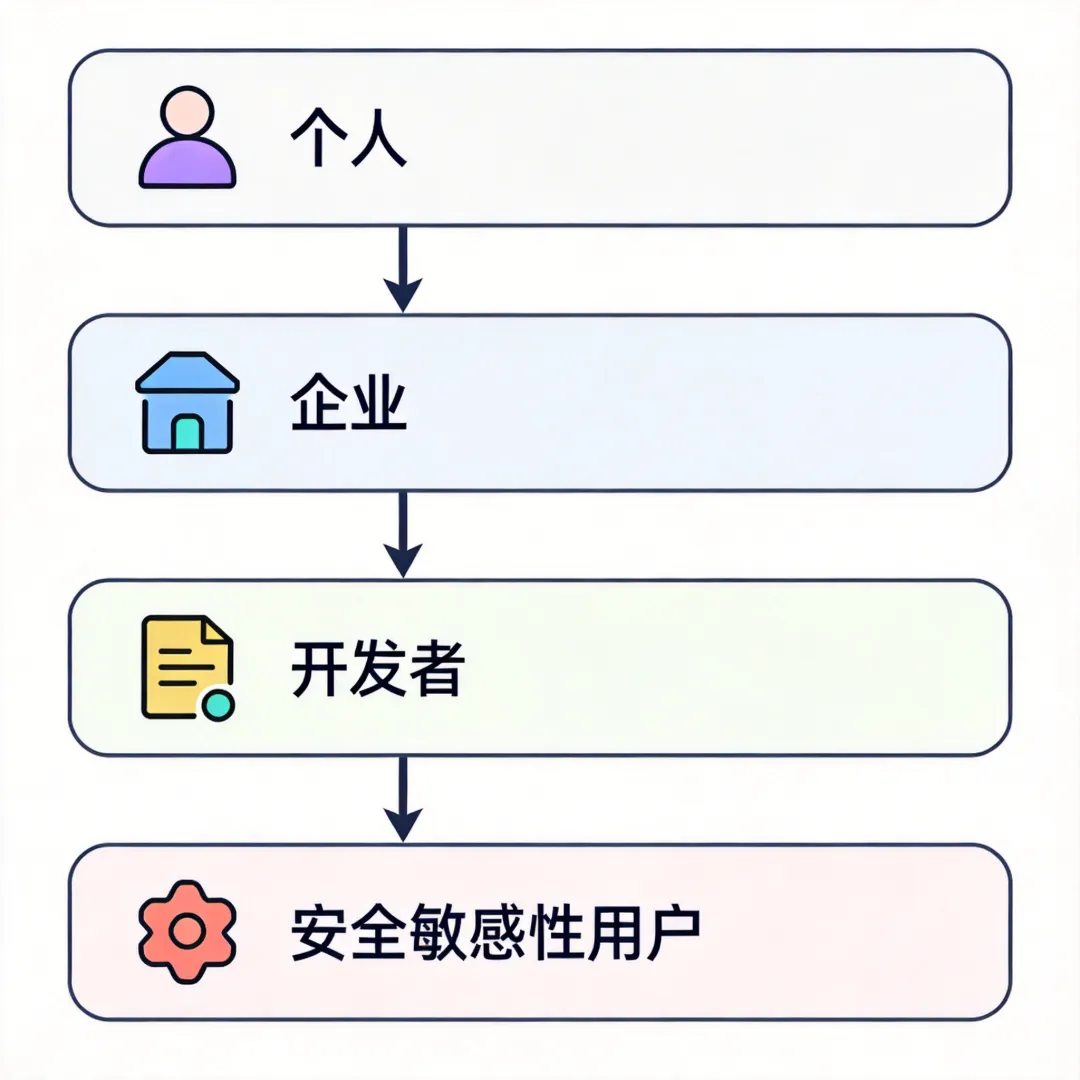

七、怎么选?分场景建议

如果你是个人用户:

选 Coze。免费、简单、生态好,够用。别折腾本地部署,时间也是成本。

如果你是企业用户:

数据敏感选 Dify 本地部署,数据不敏感选 Coze 云端托管。

如果你是开发者:

想学习智能体开发,LangChain 是必学的。想快速出活,Coze/Dify 更高效。

如果你担心 Token 成本:

Dify/LangChain 可以切换模型,灵活控制成本。Coze 绑定豆包,成本固定但透明。

省钱建议:

-

1. 简单任务用便宜模型(如 MiniMax) -

2. 复杂任务用贵模型(如 GPT-4) -

3. 启用缓存,重复问题不重复调用 -

4. 设置 Token 上限,防止超支

最后说两句

智能体工具越来越多,很多人挑花眼了。

我的观点是:工具本身没问题,关键看你怎么用。

Coze、Dify、LangChain 各有优劣,没有绝对的好坏,只有适不适合。

别因为一次预警就放弃整个方向,也别因为大厂布局就盲目跟风。

智能体是 2026 年的趋势,这点不会变。

但趋势不等于马上要用,评估好自己的需求、能力、风险承受度,再决定。

工具是为人服务的,别被工具绑架。

你在用哪个智能体工具?

-

• 是继续用 OpenClaw 还是换了? -

• Coze/Dify/LangChain 有用过的吗? -

• Token 消耗怎么样?

欢迎在评论区聊聊。

我是小张,这个公众号的初衷,就是帮大家用 AI 提升工作效率,少加班,多生活。

关注我,一起抓住 AI 时代的红利。

夜雨聆风

夜雨聆风