2026年AI编程工具测评

2026年无疑是AI Coding 的

「大航海」之年,

各大科技巨头与初创公司纷纷入局,

凭借其跨技术栈的惊人能力

(从前端、后端到数据库、DevOps)

与原型构建速度,

AI正以前所未有的力度重构

软件工程的范式。

这股浪潮也再次引发了关于

“程序员是否会被 AI 取代”的广泛讨论

——有人欣喜,有人恐慌,也有人迷茫。

目前,AI Coding模型已呈现

「国际三强领跑,国产模型快速崛起」

的格局,

根据SWE-Bench 2025年11月发布的

评测[1]显示,

国外Claude Opus 4.5(Anthropic)、

Gemini 3 Pro(Google)、

GPT-5 Turbo(OpenAI)

位列第一梯队。

与此同时,

国内Qwen3-Coder(阿里)、

Kimi K2 Thinking、Minimax M2、

DeepSeek V3.2、

GLM-4.6/4.7(智谱AI)

为代表的国产模型紧随其后,

展现出强大的追赶势头。

然而,比模型本身更值得关注的,

是一个显著的产品演进趋势:

命令行(CLI)模式

正逐渐成为专业开发者偏爱的

主流交互方式,

AI 编程从早期Chat回答编程问题,

到“IDE 插件”辅助编程后,

如今正大步迈向终端基础设施,

意图无缝嵌入

研发的整个DevOps工具链,

成为强大的生产力工具。

一、主流AI Coding工具全景对比

在深入评测具体AI工具前,我们先梳理一下AI编程工具的产品演进路径,大致可分为四个阶段:

支持模式演进

ChatGPT(Web Chat) →回答编程问题

GitHub Copilot / 通义灵码(IDE 插件) → 实时补全代码片段、上下文问答等,主打编程陪伴+效率提升。

Cursor / Trae(AI 原生 IDE) → IDE增强,内置Agent,支持自主任务执行

Claude Code / Qwen Code CLI(终端原生) → 通过命令行驱动,全流程覆盖开发任务,天然契合Shell、Git等工具链,便于脚本化和CI/CD集成。

那对应的,根据交互形态(或者说支持模式),我们就可以将当前主流Vibe Coding工具分为以下4类:

1.Web 浏览器版(Web Chat)

特点:

无需安装,开箱即用

上下文能力有限,通常仅限当前会话或单文件

通常结合云端开发环境(如 Replit)提供实时预览与协作。

适用人群/场景:非科班/小白,适合快速原型、教学或临时调试,比如黑客马拉松、前端小项目、非敏感代码实验等。

2.IDE 插件型(Plugin-Based)

作为 VS Code、IntelliJ 等主流IDE的扩展运行。

利用编辑器 API 获取当前文件上下文,但权限受限

部署灵活,迁移成本低;部分支持本地模型(如 Tabnine)

适用人群/场景:普通研发/日常使用IDE的开发者,日常编码辅助、轻量级任务、私有化部署需求。

补充:这里其实还可以下钻分为 IDE-Native 这种深度集成模式的,区别就是以原生方式嵌入或重构 IDE,能直接访问 IDE 的程序结构接口(如 PSI),实现精准的上下文感知和安全重构,支持项目级索引、跨文件理解,甚至能读取类型系统。比如JetBrains AI、GitHub Copilot Enterprise等。

3.命令行工具(CLI)

通过终端指令调用 AI,天然契合 Shell、Git、Docker 等工具链

支持脚本化、批处理、CI/CD 自动化,适合流水线集成

交互高效,但缺乏可视化;上下文依赖用户显式传递(如 –context ./src)

适用人群/场景:适合专业的编程牛马——尤其是那些比较依赖终端的,比如在远程服务器或Docker容器内那种无 GUI 环境下进行AI 编程的。或者希望AI集成本地开发环境的,比如AI 能直接读写本地文件、批量优化某个函数定义,乃至重构整个代码库。

4.独立AI IDE

以自然语言对话为交互核心,一般都有个单独chat栏

内置 AI Agent,可自动执行“计划→编码→测试→部署”闭环

支持多模态上下文(如 Figma 设计稿、API 文档、数据库 Schema)

通常基于 VS Code 或 Electron 封装,但逻辑完全重构

代表工具如Cursor、Qoder、字节Trae等。

适用人群/场景:Vide Coding重度患者(可以跨界),从零构建新功能/模块、跨技术栈全栈开发、追求全流程自动化的团队。

国际AI编程工具

1.Claude Code(CLI+IDE插件)

背后模型:Claude Sonnet 4.5 / Opus 4.5

商业模式:闭源 | 纯付费(贵有贵的道理)

官网地址:https://claude.ai

Claude Code是Anthropic于2024年下旬发布的AI编程助手(claude code CLI v0.1 +白名单接入),后续于2025年3月份正式全量开放,配套推出 MCP 架构与 SubAgents 并行执行机制,一时间引爆AI圈,被开发者称为「代理式编程鼻祖」。

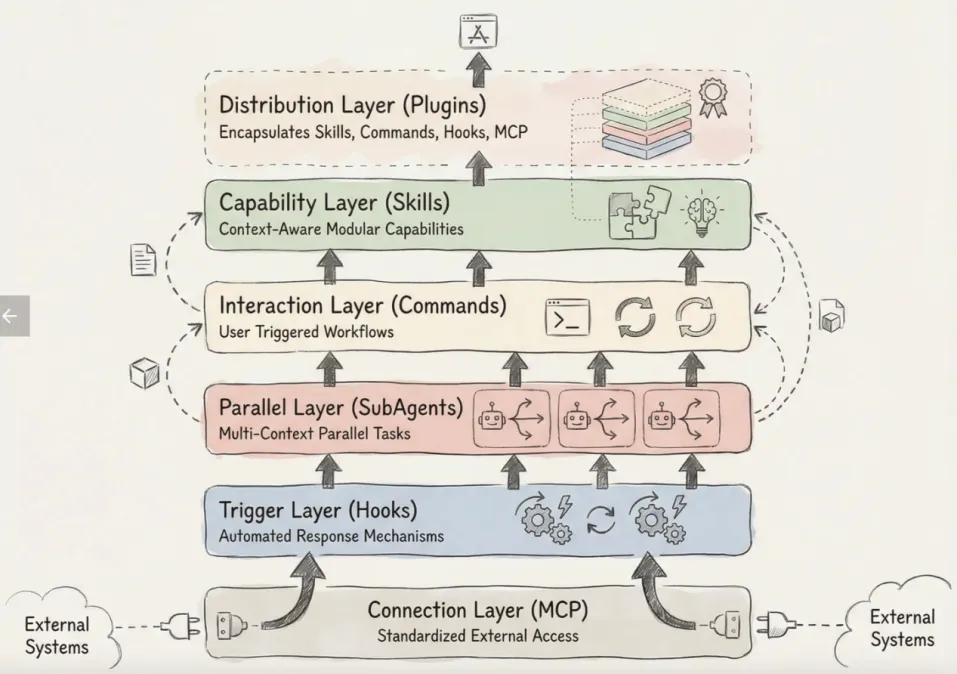

Claude Code采用”分而治之”的核心设计哲学,将复杂的AI辅助开发过程解耦为六个职责清晰的层次:

Plugins(插件封装层): 封装外部工具能力(如调用 linter、运行测试、访问数据库),使 AI 能“操作世界”。

Skills(智能能力层) : 定义原子化 AI 行为(如“生成 REST API”“写单元测试”),可组合复用。

Commands(用户交互层): 提供用户友好的 CLI 指令(如 claude code –build –test),隐藏底层复杂性。

SubAgents(并行执行层): 启动多个专用代理并行处理子任务(如前端 + 后端 + DB 同时生成)。

Hooks(事件响应层): 监听开发流程中的关键事件(如测试失败),触发自动修复或回滚。

MCP(系统连接层): 实现多代理间的通信、状态同步与冲突协调,是协作的“神经系统”。

借助这些能力,Claude Code 可端到端地拆解用户需求 → 生成规范 → 编写可运行代码 → 执行测试 → 修复问题,实现接近“自主编程”的体验。

CLI 为主力形态,通过 claude code 命令驱动,处理复杂工程任务的能力尤为突出。

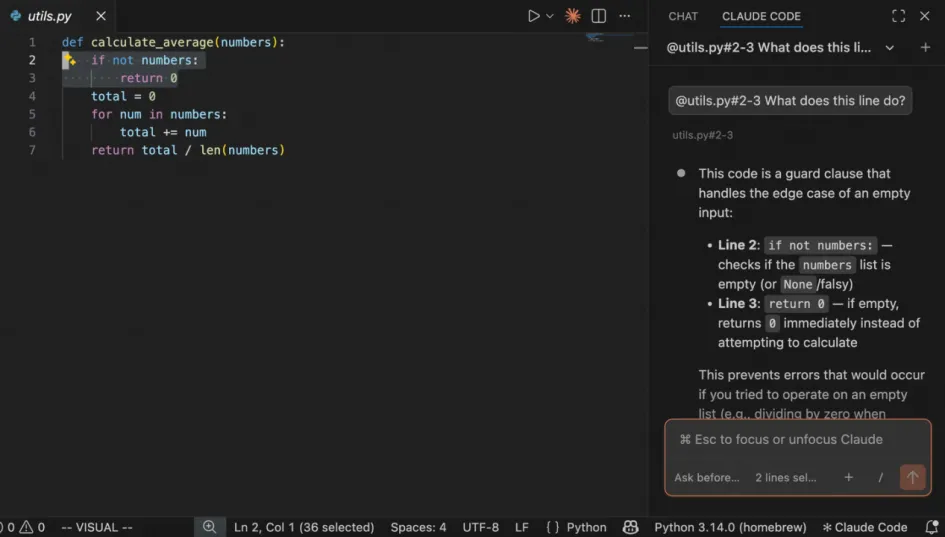

也能通过 IDE 插件形式集成,目前有2种方式:

1.通过官方维护的Claude for VS Code:但只能提供比较轻量级上下文感知辅助,在 VS Code 选中代码后 → 右键 “Ask Claude”,就可以使用插件进行局部解释、生成、问答。提供的并非完整的Claude Code 能力,比如不具备完整的MCP代理协作能力。

2.基于Continue等第三方插件框架(支持VS Code / JetBrains) + Claude Anthropic API 自定义模型,提供的也是局部代码辅助编程能力,也不支持 MCP 代理协作或 Spec Kit 等高级功能。

不过Anthropic 已在2025Q4提到:“未来将把代理式编程体验扩展到更多开发环境,包括本地 IDE”,可能官方插件能力的提升已经在紧锣密鼓的迭代中了~“

“贵但值,是唯一让我觉得‘AI 能独立干活’的工具。”

“不是用来写函数的,是用来交付项目的。”

这些主流的开发者声音,让我们对Claude的NB不容忽视,贵有贵的道理,啥也不多说了,给到夯爆了。

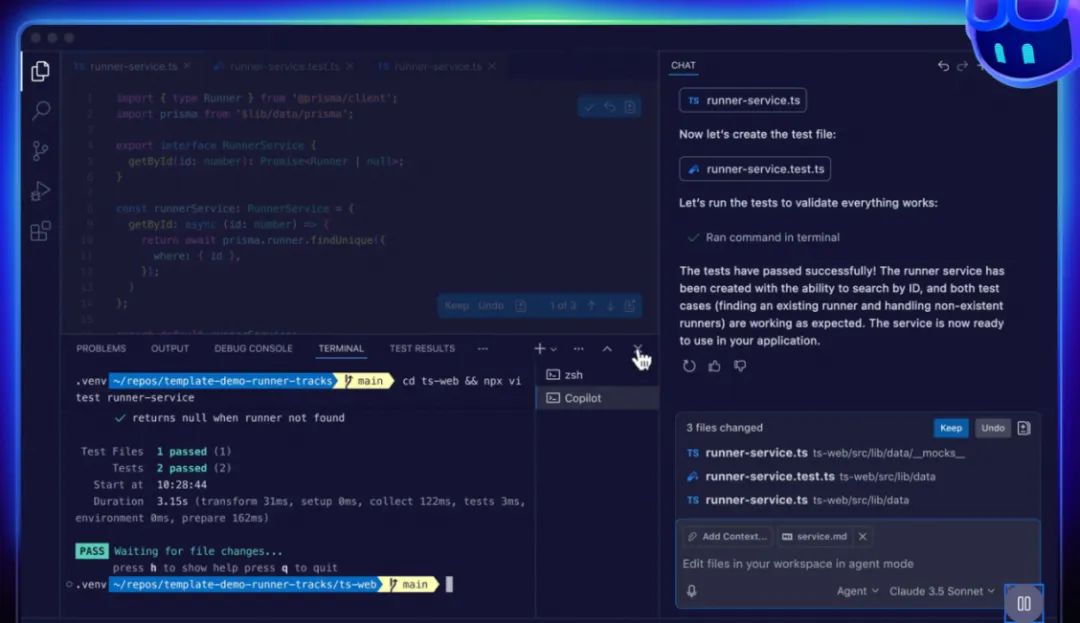

2.Github Copilot(IDE插件 + Web Chat + CLI)

背后模型:基于CodeX(GPT-3的微调版本)演进,后续转向支持如 GPT-4.1、GPT-5 系列及多厂商模型(如 Claude、Gemini)。

商业模式:cli闭源 + IDE插件开源 | 免费/个人Pro付费/企业级付费

官网:

https://github.com/features/cop

GitHub Copilot 是由GitHub(Microsoft 微软)与 OpenAI 联合开发的 AI 编程助手,作为最早(2022年中旬)进入市场的 AI 编程助手之一,GitHub Copilot 已从“自动补全工具”演变为一个 覆盖全生命周期的智能编码平台,其核心组件包括:

Copilot in Editor:深度集成于主流 IDE,包括 Visual Studio Code、Visual Studio、JetBrains 全系 IDE、Neovim、Azure Data Studio 和 Eclipse,支持行级、函数级、文件级的上下文感知代码生成。

Copilot Chat:提供自然语言交互界面,可在 IDE 内或 http://GitHub.com 上使用,用于解释代码、生成单元测试、提出重构建议、辅助调试及撰写文档。

Copilot Workspace(2025 Beta 发布):实验性功能,对标 Claude Code 的任务分解能力,允许用户输入需求后由系统拆解为多个子任务,并逐步引导完成开发闭环(需配合 GitHub Actions 实现自动化验证)。但该功能目前处于早期预览阶段,尚未具备完全自主的多文件协同编辑或复杂工具调用能力。

个人认为 Github Copilot 的核心优势 是 生态整合,包括:

上下文感知能力增强:可以深度绑定 GitHub 仓库上下文(比如在用户授权下可以读取当前仓库的 issues、PRs、Discussions、Wiki等元数据),从而提供更贴合项目背景的建议。

权限管控治理:支持组织级策略管控,例如启用“代码引用过滤器”(duplication detection filter)以阻止生成与公共仓库中受版权保护代码高度相似的片段,或限制特定开源许可证(如 GPL)相关代码的生成。

整体来说IDE插件形态下能力还是比较好的,综合给到人上人吧。

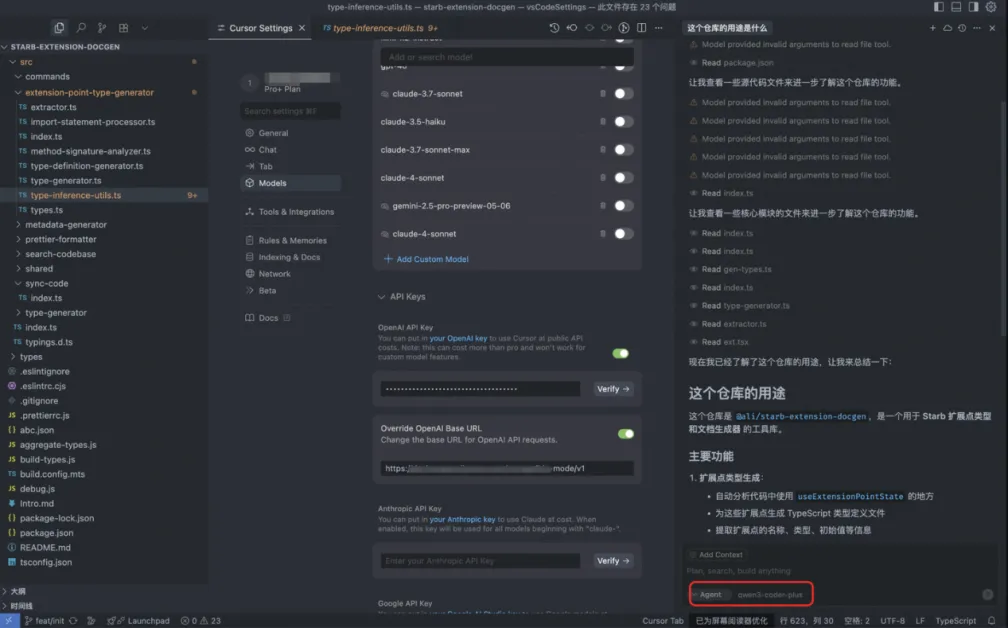

3.Cursor(AI IDE)

背后模型:集成 GPT-5、Claude Opus 4.5、Claude Sonnet 4.5 + 自定义模型(via API) + 自研微调层

商业模式:闭源 |免费/Pro付费/企业级付费

官网地址:https://cursor.sh

Cursor 于2024 年 1 月公开上线,Cursor 首个以「AI 优先」理念重构的IDE,也是近年来最受关注的AI 原生 IDE产品,后续其Agent/Ask/Plan的产品思想也被不断借(抄)鉴(麻)了。本质是基于 Electron 构建的 VS Code 深度魔改版本,但它的出现彻底重构了AI编程的交互范式——将编辑器视为“人机协同编程空间”。

Cursor 的强项主要集中在以下几项:

自定义行为规则系统:基于Rules模板,允许团队以声明式方式约束 AI 行为,把工程规范“编译”进 AI 的推理过程,从而快速对齐团队开发范式。

深度项目级上下文理解:能“看到”整个项目结构(通过向量化索引),而不仅是当前文件或窗口,从而总结职责、调用链、风险点、重构机会。

强大的多文件编辑与重构能力:支持一次指令跨多个文件修改(如改写函数、补注释、修 lint、生成测试),并提供 diff 预览和一键应用。

提供本地模式:支持完全离线运行(搭配 Ollama 或 LM Studio),可通过API接口部署私有/自定义模型等

不过尽管 Cursor 宣称“兼容 VS Code 插件”,但实际上对 MCP、SubAgents 等Antrophics家的高级协议支持有限。其 AI 行为仍由 Cursor 自研调度器控制,并非原生运行 claude code CLI。

同时它集成了Claude和GPT-5等全套模型,支持“养蛊模式”——多模型并行生成,人工择优。支持 /edit 跨文件修改、AI Debug、AI Commit,体验很流畅。但是网传的零基础小白上手开发app上线或许多少有点夸大其词,稍微复杂点的项目,比如涉及前后端、部署上线等,还是需要使用者具备一定的开发基础的(常用的node、python、linux、git命令)。因为你只有能看懂前后端大概在干什么,才能在出现问题的时候辅助cursor修复优化。

个人感觉比较适合有一定编程基础、但又不是重工程项的开发者(比如AI产品经理,CS学生做整个项目、前端转全栈等),但其首发实现“工具到智能代理”的产品范式创新很棒,如果我是Cursor的主要用户受众的话会给到夯爆了,但研发出身,我可能还是偏向CLI模式,所以整体给到顶级。

4.Gemini Code(CLI + IDE插件)

背后模型:Gemini 2.5 Flash

商业模式: gemini-cli开源 | 免费+企业版付费

官方地址:

Build, debug & deploy with AI

github:

https://github.com/google-gemin

2025年6月,Google 官方发布了这款AI 终端编程助手Gemini CLI,和Claude Code一样都是用Node.js去写的,命令行工具是基于 React + Ink 实现,所以在 vscode 插件端也可以直接复用 。

它被阶段性地认为是Claude Code的平替,个人账号登录即可免费使用,支持每分钟最多 60 次、每日最多 1000 次请求,企业用户可通过配置 Gemini API 密钥启用付费计划,所有数据受 Google Cloud 严格的企业级隐私保护条款约束。

主力形态就是CLI模式,交互体验还算比较完善的:从代码diff,文件修改到命令行执行,都可以在一个窗口完成。Gemini采用的是比较直观的Agentic Workflowt模式,在他的流程中,会有个明确的“理解 → 规划 → 询问→ 执行→ 测试(optional) → 验证(optional)”流程。类似的,Gemini cli 在调用工具前也会需要用户进行确认,流程可控性还蛮强的。

但是排查问题和解决异常的能力明显差于claude,主观感受上,总体AI交互的轮次和claude相比大概有个1-2倍吧(当然也根据项目的具体情况有差异),但是它免费啊!要啥自行车,穷人学生党你用就完事了,整体给到人上人。

也能通过 IDE 插件形式集成,类似的目前仅针对VS Code支持官方维护的扩展插件:Gemini for VS Code,提供上下文感知补全、自然语言生成函数、错误解释与修复建议等功能,整体能力比CLI差一档,包括也不开放MCP调用啥的,要用就用CLI。

国产AI编程工具

1.通义灵码 Lingma(IDE插件 + AI IDE)

背后模型:Qwen 3 Max / Qwen 3 Coder

商业模式:闭源 | 免费 +企业版付费

官网地址:https://lingma.aliyun.com

Lingma(灵码)是阿里云 基于 通义千问(Qwen)大模型系列 打造的,于2024年下旬推出的 AI 编程插件,以 IDE 插件为核心形态,支持行级补全(<300ms)、MCP工具调用、自然语言生成函数、单元测试自动生成(覆盖率目标 80%+)、漏洞检测增强(结合 JVM Profiling Toolkit)等这类的能力。支持 VPC 私有网络调用、日志审计等。Web 版集成于阿里云控制台,有点鸡肋,不如直接访问千问网页版。

主力形态就是IDE插件,支持 VS Code / JetBrains 插件,主打编程陪伴,对标github copilot。25年Q4推出了AI-IDE客户端(参见:Lingma IDE 更新日志),基于VS-Code原生构建了一版,属于是也想吃上一口cursor的冷饭,但是目前IDE的能力跟插件提供的能力没有太大的差异性,不是很懂,可能还来不及迭代先占位吧。

主打中文场景优化与 公安部三级等保(C3)认证,比较适合国内金融、政务等有比较高合规要求场景,整体能给到个NPC(偏下)吧。

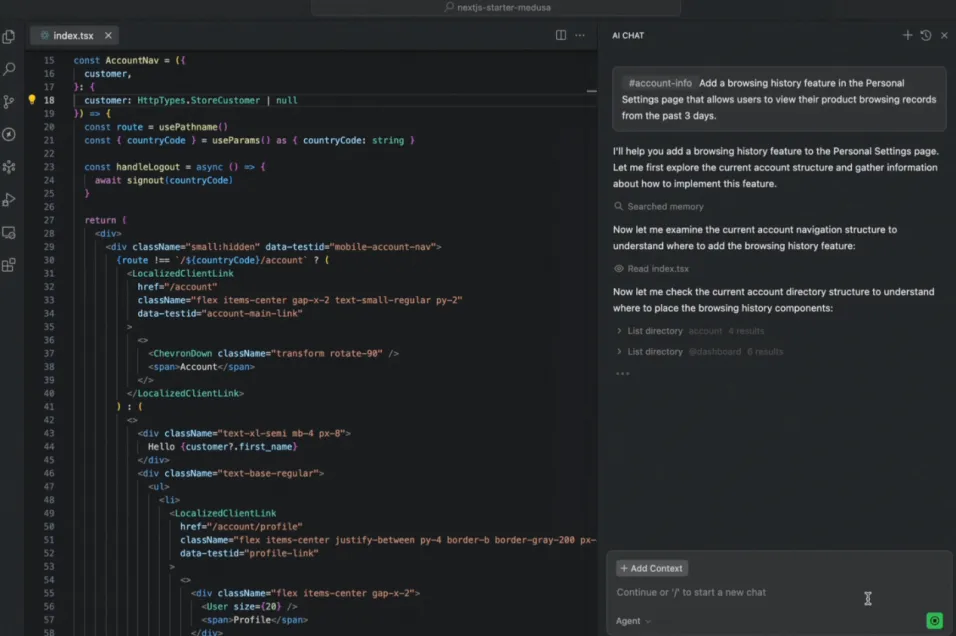

2.Qoder(AI IDE + CLI + IDE插件)

背后模型:Qwen3-Max + 其他

商业模式:闭源|免费 +个人付费+企业付费(定价上基本是cursor的一半)

官网地址:

AI Coding Assistant – Agentic Coding Platform | Qoder

产品更新日志:

Qoder – The Agentic Coding Platform

Qoder 是阿里 于 2025 年 8 月 22 日 正式面向全球发布的 Agentic 智能编程平台,其核心理念是从“代码补全助手”跃迁为“可自主完成复杂任务的 AI 工程师”。对标 Cursor但 Qoder 的野心显然更大。

主力形态是 AI-Native 原生 IDE;在 CLI 热潮推动下,团队于 2025 年 10 月 快速推出了 Qoder CLI,能力基本对齐 IDE,并无缝集成于本地工作流:默认支持 Git,原生适配 Shell,并可轻松集成到 CI/CD 流水线中。随后11月又上线了 官方 IDE 插件(目前仅支持 JetBrains 系列,VS Code 尚未覆盖),不过插件功能是 IDE 的子集(比如不支持 Quest Mode)

在 AI IDE 形态下,Qoder 提供了最完整的能力矩阵,内置三大核心交互模式。值得一提的是,它的 LLM 是“隐藏式”的:系统会根据任务类型与上下文复杂度,自动调度最优模型组合(如 Qwen3-Max 用于规划,Qwen3-Coder 用于生成),真正做到“为效果买单”,而不是像 Cursor 那样让用户陷入“模型养蛊”的选择焦虑。

Ask Mode:用于代码理解与问答,不会触发任何代码修改,适合安全探索;

Agent Mode:理解任务 → 自动规划 → 读写文件 → 执行命令 → 完成编码,是最高频使用的主力模式;

QuestMode:基于Spec 驱动的任务委派,AI 自主完成从需求分析、架构设计到代码实现、单元测试的全流程,特别适合新功能起手、大型重构或模糊需求澄清。

体验下来,我观察到的Qoder的特色主要有以下几点:

多形态扎实支持:AI-Native IDE、 CLI、IDE插件齐活了,每个都有模有样的不是占位符。不过坦白说,我对这种“三线作战”的产品策略是存疑的,在资源有限的前提下,同时打磨三种交互范式,是否会导致体验割裂或迭代速度被摊薄——当然你碓人也行,否则在 2026 年这个 AI 编程工具红海期,聚焦单点打穿(如 Cursor 死磕 IDE,Qwen Code 专注 CLI)或许是更稳健的选择。

Quest 模式:绝对是一大强项。背后依托自研的Sepc-kit能力,相比直接用spec-kit更简单轻量。这个模式下用户可以通过自然语言交互,完成从需求描述到代码交付全流程自动化,AI 自动生成设计文档、代码实现、单元测试。而且支持通过 全局 Rule(Desc & ADR) 复用Sepc-kit已沉淀的内容!很强。

记忆感知能力:内置记忆感知能力,能记住开发者习惯、项目特点、常见问题,在后续交互中自动召回相关记忆,实现“越用越懂你”的个性化体验。

Repo Wiki:Qoder 会在后台自动扫描你的整个代码库,生成一份动态更新的项目知识图谱 (Repo Wiki)。将代码库转化为结构化、可交互的“活文档”,既帮助开发者理解代码的结构和依赖关系,又为 AI 提供精准上下文。

体验下来,Qoder 完全有实力被称为“国产 Cursor 的超越者”。而且我很喜欢Qoder官网的产品风格,感兴趣可以去看看,个人给到顶级。

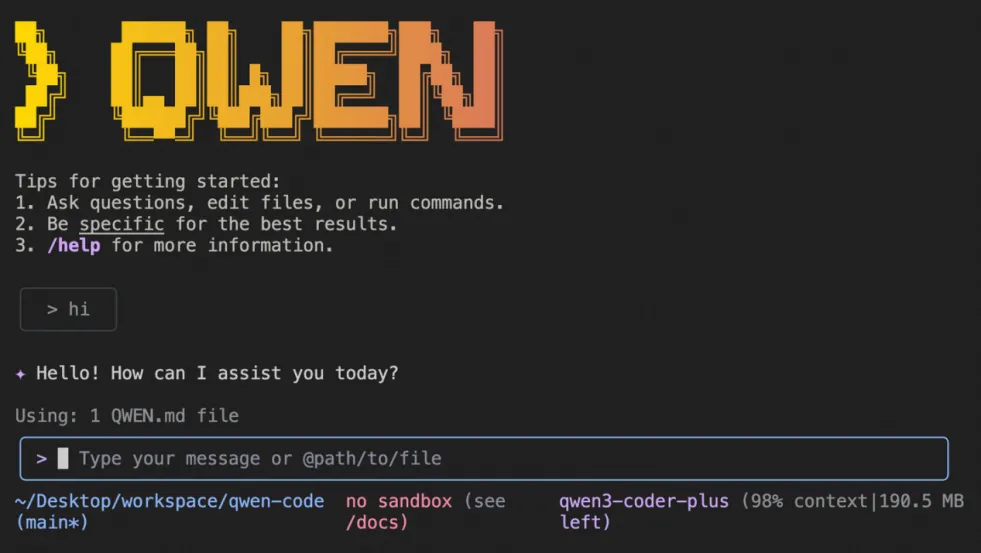

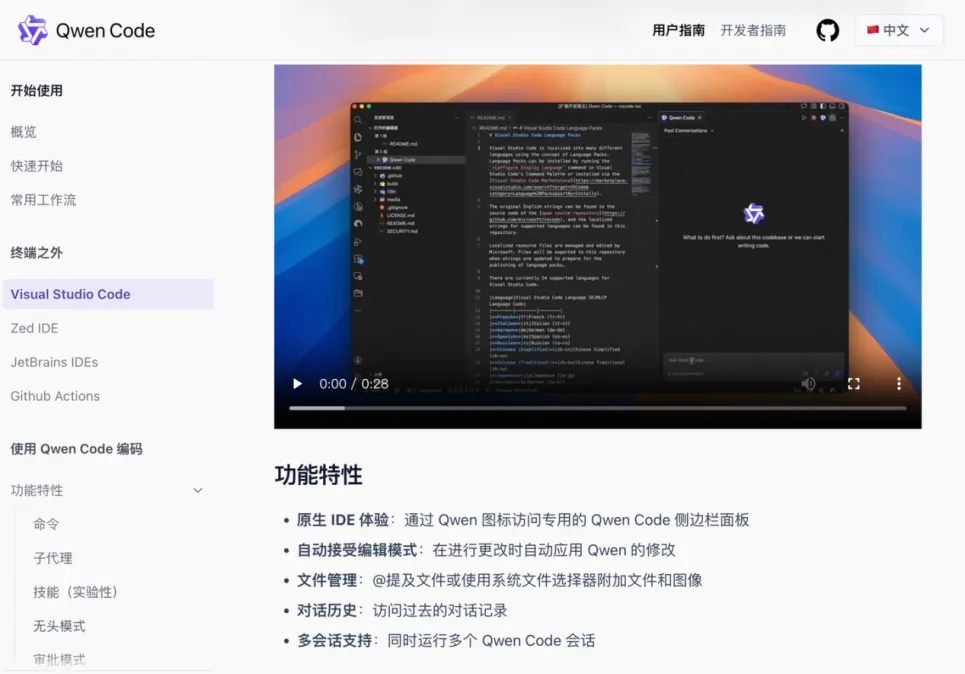

3.Qwen Code(CLI + 三方IDE插件)

背后模型:Qwen3-Coder

商业模式:开源 |免费

官网地址:

qwenlm.github.io/qwen-code-docs

GitHub:

github.com/QwenLM/qwen-code

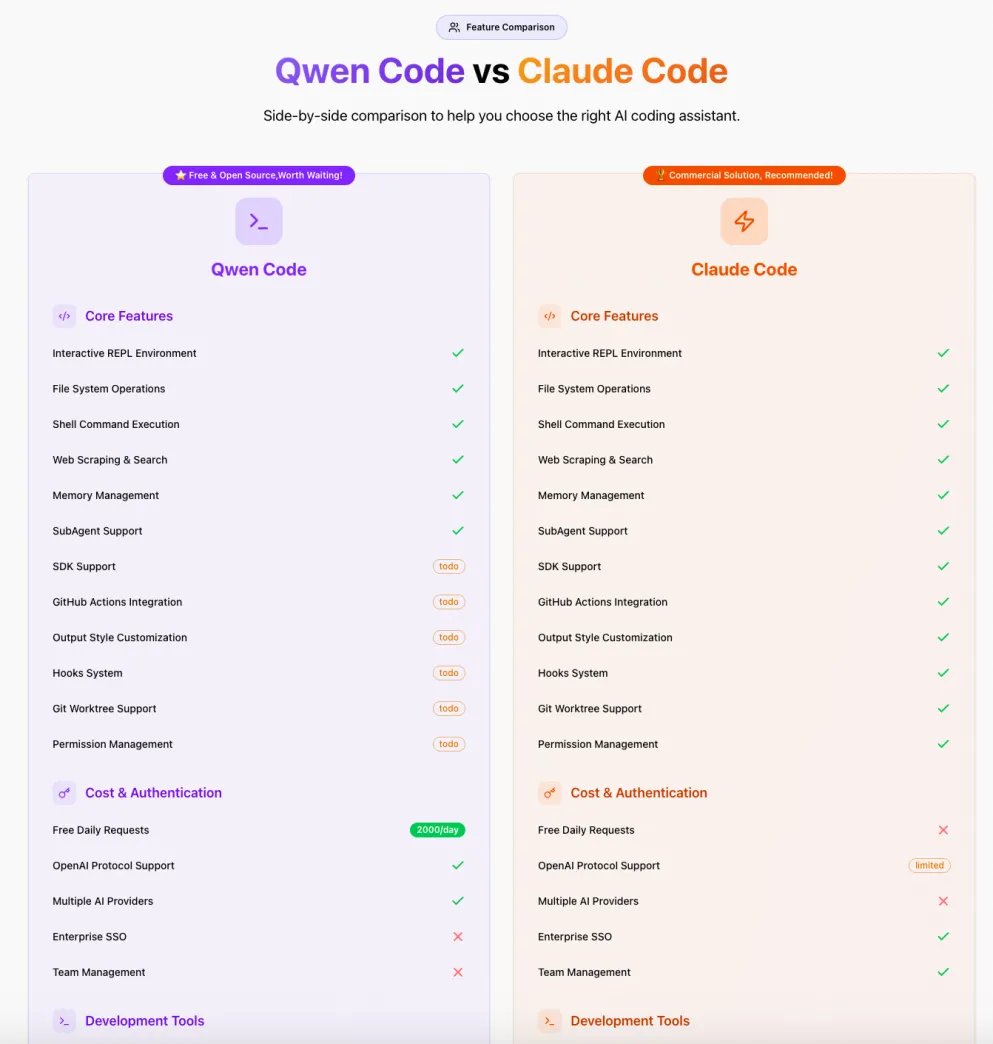

Qwen Code是 阿里通义实验室 于2025年Q4 开源(Apache 2.0)的,对标 claude code cli、gemini-cli 的Code Agent命令行工具。

主力形态当然是纯 CLI ,也做了SDK接口(目前仅Typescript、Java:Qwen Code: AI Coding Agent Documentation),Qwen Code项目初期是基于 Google Gemini CLI 的开源框架进行了二次开发,针对 Qwen3‑Coder系列的模型增强了解析器和工具支持,但后来发现一直要跟随上游的 GeminiCLI 版本更新太难搞了,单次合并时常要解决几万行的代码冲突,于是从v0.2.0开始独立开发了。

与此同时,Qwen Code也更想将有限的人力聚焦在打造追齐 Claude Code 的产品体验,所以独立开发也是必经之路。经过多轮迭代,目前Qwen Code支持文件读写、shell 执行(需用户确认)、自动化任务和智能辅助功能等AI辅助编程能力,也支持了 Skills(技能)、SubAgents(子智能体)、Plan Mode(计划模式)等高级feature,而且迭代速度真的很猛,产品官网就是一个大写的猛猛对标:

我个人总结下来,Qwen Code有以下几个优势(细节你们去看官网feature对比吧):

开源+免费:延续通义实验室一贯的开放风格,采用 Apache 2.0 协议,代码完全开源;通过 Qwen OAuth 登录即可享每日 2000 次免费请求额度。不仅打破 Claude 等闭源方案的生态壁垒,还兼容 Anthropic、Google GenAI、OpenAI 等主流协议,不绑定单一模型厂商,灵活切换、具备高度可扩展性。

能力不差:真正回归“命令行生产力”本质,适合资深开发者,目前已实现CLI基础能力(如文件管理、bash执行等)、 SubAgent任务拆解(可为不同任务启动专用 AI 实例,如前端 + 后端并行)、计划模式(Plan Mode)和基础工具调用链,初步具备代理式骨架逐步迈向“自主编程”,而且迭代速度太肝了。不过目前体验下来,虽然生成代码质量不错,但时间比较慢,效率问题可以有空停下来优化下。

阿里云生态:在中文项目理解、注释生成、错误诊断等方面表现突出,并能无缝调用阿里云服务(如 OSS、RDS、函数计算),对国内开发者和云原生用户很友好。

本地部署 + 安全可控:支持本地部署、私有化运行,适合对数据隐私和合规性要求高的企业或个人开发者。

对于IDE党,也可以参考Claude CLI一样,通过三方插件的形式(如 Continue、CodeSandbox)集成Qwen Code,但是体验上确实差点意思,功能上也是CLI的子集。教程文档可参考:Qwen Code: AI Coding Agent Documentation

目前来看,Qwen Code 可以阶段性称为「平民化的 Claude Code CLI」,在国际巨头包围中撕开了一道缺口,冲着它强大的开源精神和迅猛迭代的功能,可以给到人上人

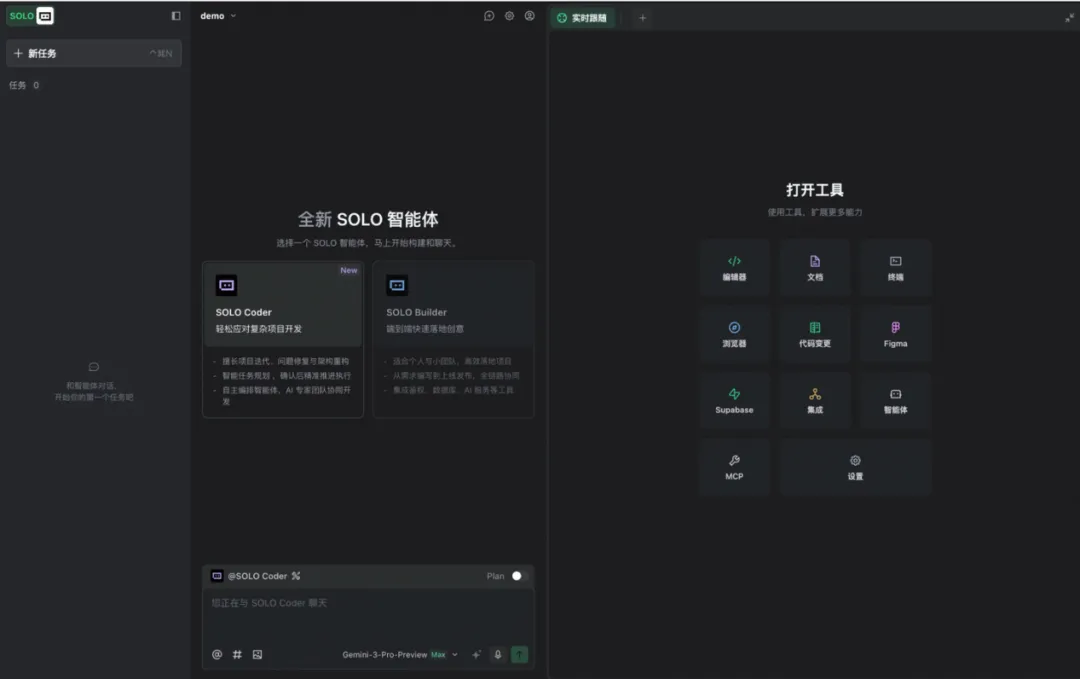

4.字节 Trae(AI IDE + IDE插件)

官网地址:https://trae.ai

SOLO Coder:专注复杂编程项目,支持 Plan 模式(任务结构化拆解)和 自动调用子智能体。

SOLO Builder:端到端应用生成器,流程为:PRD → 任务分解 → 代码 → 预览 → 发布。

IDE插件支持VS Code、JetBrains大部分,能力也是子集,详情可参考:https://docs.trae.ai/plugin/use

二、思考

在 AI 编程工具快速演进的过程中,一个值得深思的现象是:命令行(CLI)形态正被越来越多专业开发者接纳甚至推崇。这不禁让人发问——这是不是一种复古?

CLI产品美学: 时代在倒退么?

这背后其实不是怀旧,也不是技术倒退,而是一种对控制力和效率的回归。

CLI 工具之所以能快速赢得一批核心用户,关键在于它解决了两个 IDE 插件很难绕开的问题:

第一,强大的文件访问能力

在 Unix/Linux 的世界里,“一切皆文件”不只是句口号。你的代码、配置、日志、进程、网络连接……本质上都是可读写的资源。而终端,就是操作系统原生提供的操作入口。

相比之下,大多数 IDE 插件运行在沙箱里,权限受限,没法直接调用 bash、git、docker、make 或批量修改文件。但 CLI 工具可以——只要用户授权,它就能像你一样,在项目目录里自由行动。这对需要自动化重构、批量生成测试或集成 CI/CD 的场景来说,几乎是刚需。

第二,它足够轻,也足够快。

命令行工具不像web应用那样需要复杂的界面设计,所以迭代更敏捷,开发者可以体验到最早期的一些AI开发新feature。。今天加个 SubAgent 支持,明天优化下 Plan 模式,很快就能推给用户试用。你不需要等下一个 VS Code 插件版本更新,也不用忍受卡顿的 Electron 界面。这种“裸奔”感,反而让开发者能更直接地感知 AI 能力的边界和潜力。

三、总结

AI 编程已经过了“看 Demo 惊艳”的阶段,进入了“拼落地”的深水区。现在比的不再是“能不能生成一段代码”,而是“能不能在真实项目里可靠地交付一个功能模块”。

所以,未来的软件工程师得把重心从“如何实现”,转向“应该实现什么”和“如何设计实现”,去深刻理解模糊的业务需求和用户痛点,把它们转化为清晰、可执行的技术方案。

而 AI,会是我们最得力的“执行副手”。它负责把设计变成代码,把想法跑成服务。我们则要站在更高处,做那个定义问题、把控方向、保障系统安全稳定的人。

技术在演进,但工程的本质从未改变:用有限的资源,解决真实世界的问题。

END

拟稿 | 科曼德研发部

排版编辑 | 科曼德品宣组

审核 | 科曼德办公室

夜雨聆风

夜雨聆风