Linux 网络子系统源码剖析(十一):套接字层实现

从系统调用到协议栈 – 揭秘应用程序与内核的网络接口

系列:Linux 网络子系统源码剖析篇号:第 11 篇 内核版本:Linux 5.10 LTS重点模块:Socket 层、系统调用、缓冲区管理、零拷贝技术

📋 本篇导读

你将学到

-

Socket 层的完整架构设计

-

核心系统调用的实现原理(socket、bind、listen、accept、connect、send/recv、close)

-

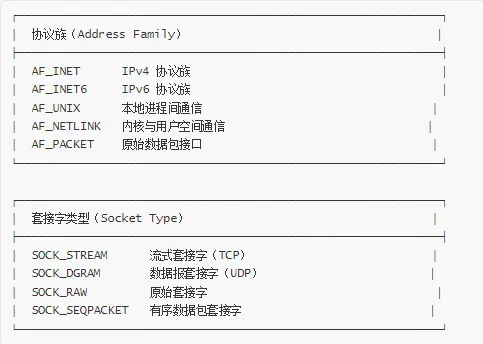

协议族注册与管理机制

-

Socket 缓冲区的管理策略

-

零拷贝技术的实现细节

-

高性能网络编程优化技巧

-

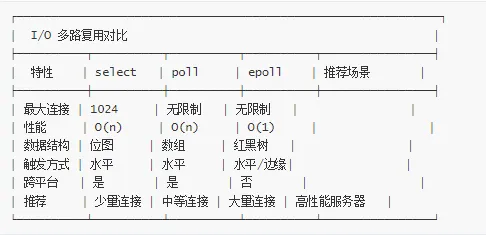

I/O 多路复用(select、poll、epoll)

-

实战案例与性能调优

前置知识

-

已阅读第 1-10 篇文章

-

了解 Socket 编程基础

-

理解 TCP/IP 协议栈

-

熟悉 Linux 系统调用机制

阅读时间

约 90-100 分钟

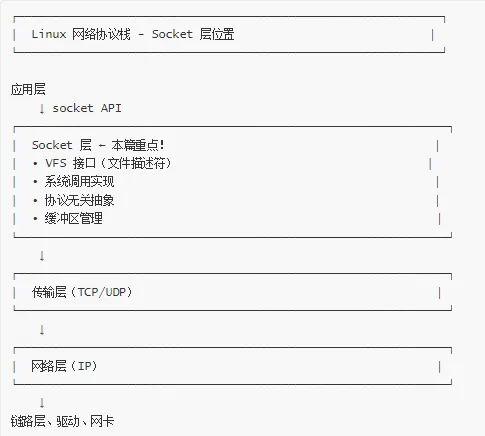

🎯 Socket 层在网络子系统中的位置

协议栈分层

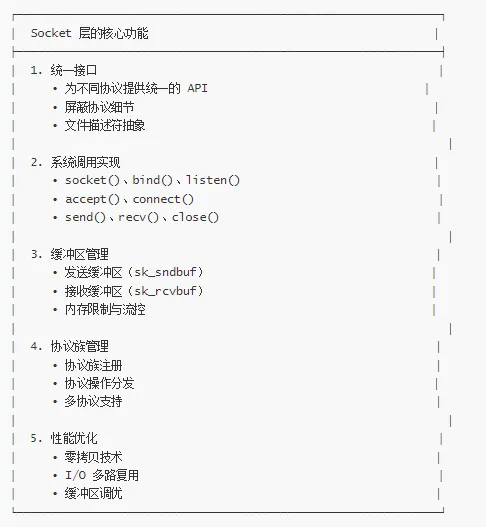

Socket 层的核心职责

📊 Socket 层架构

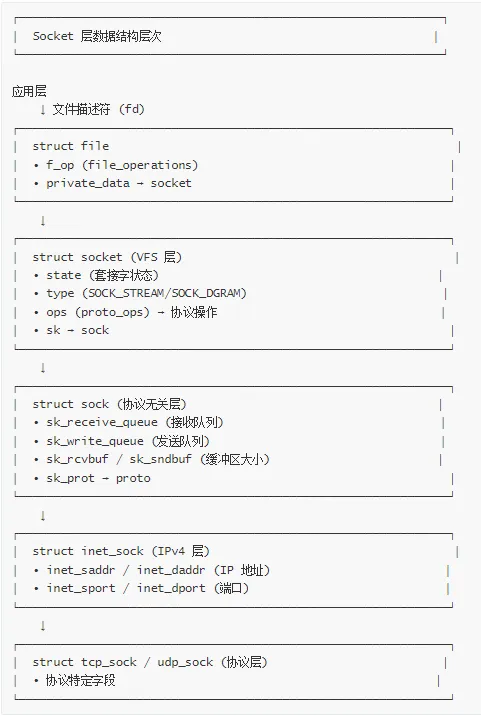

核心数据结构关系

协议族与套接字类型

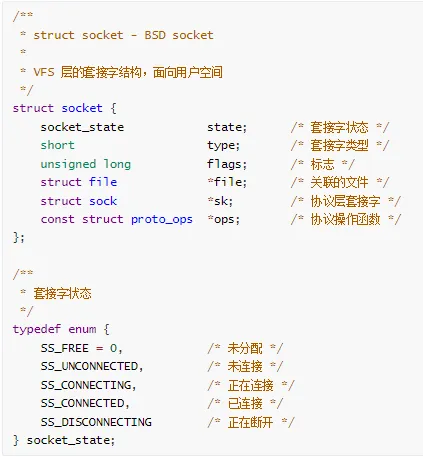

🔧 核心数据结构

struct socket – VFS 层套接字

源码位置:include/linux/net.h

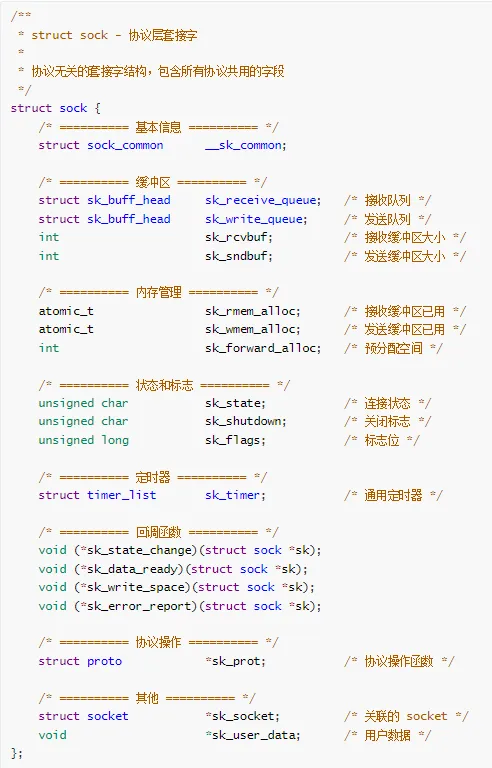

struct sock – 协议无关层

源码位置:include/net/sock.h

struct proto_ops – 协议操作接口

源码位置:include/linux/net.h

🚀 系统调用实现

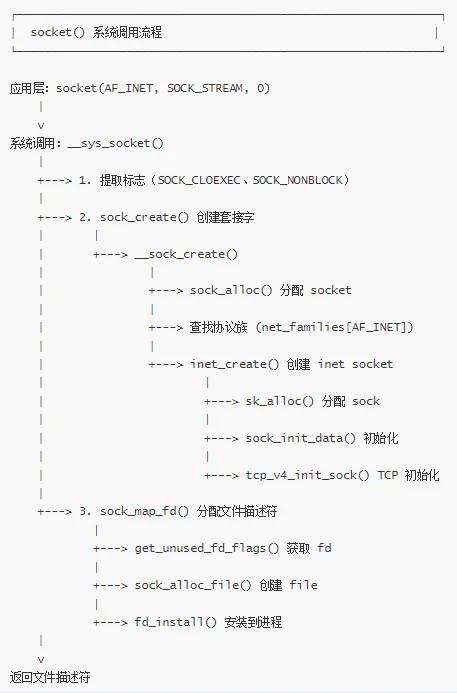

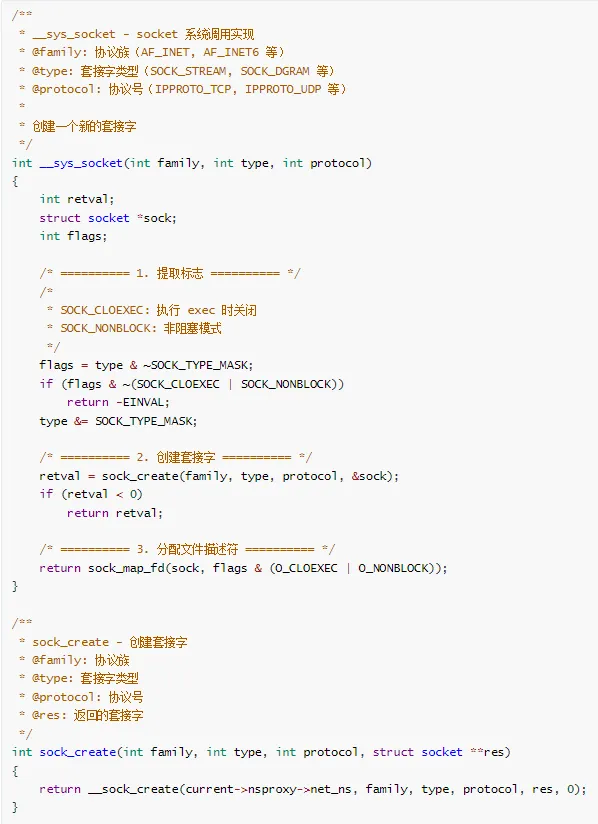

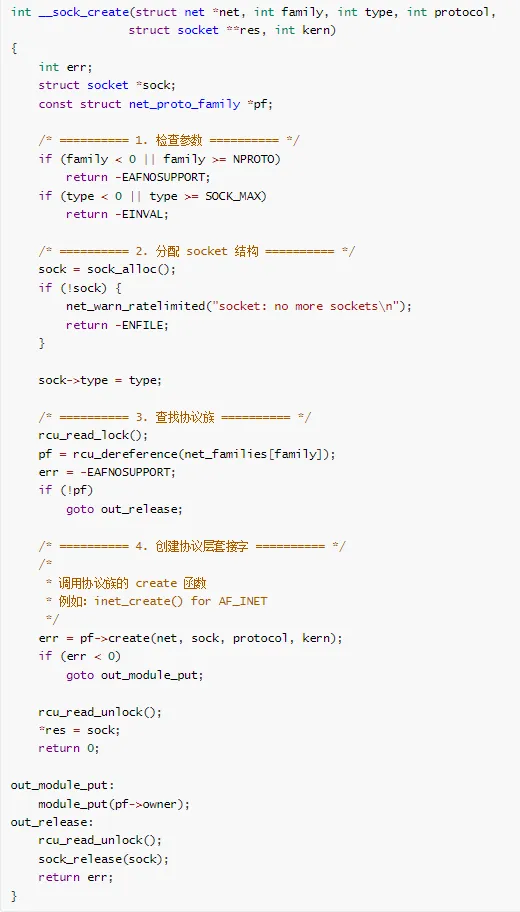

socket() – 创建套接字

调用流程

源码实现

源码位置:net/socket.c

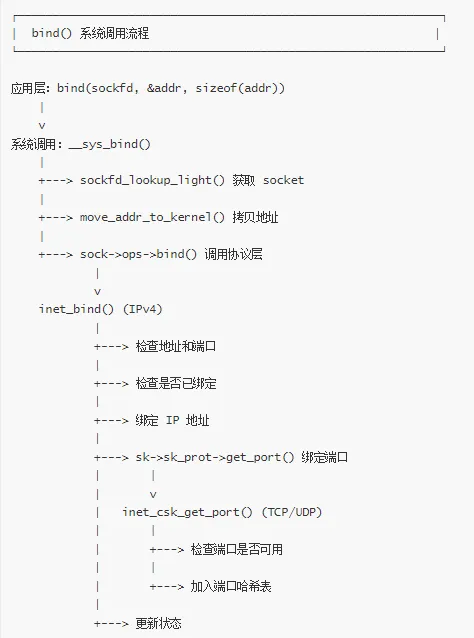

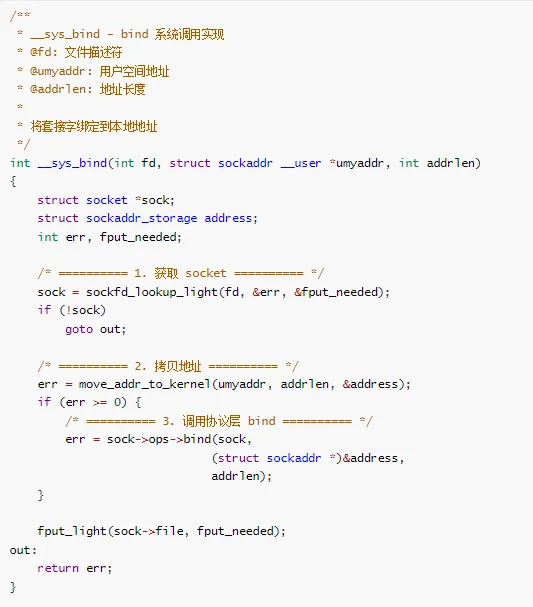

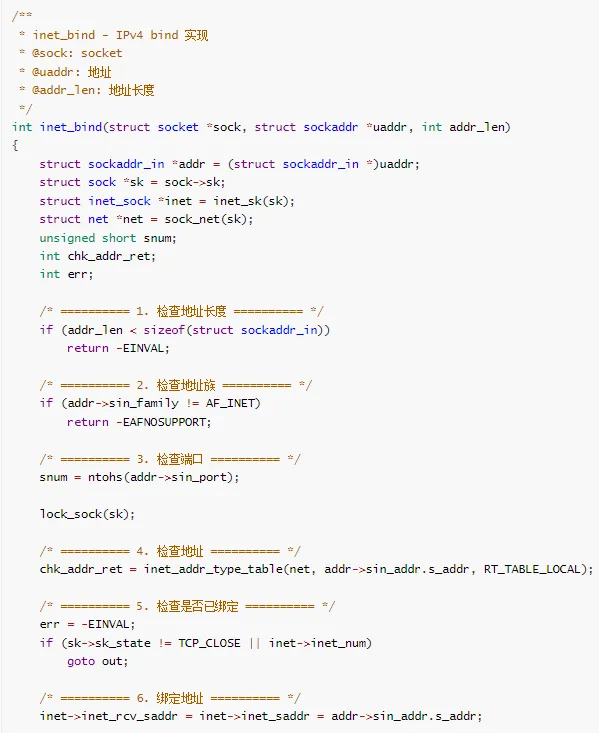

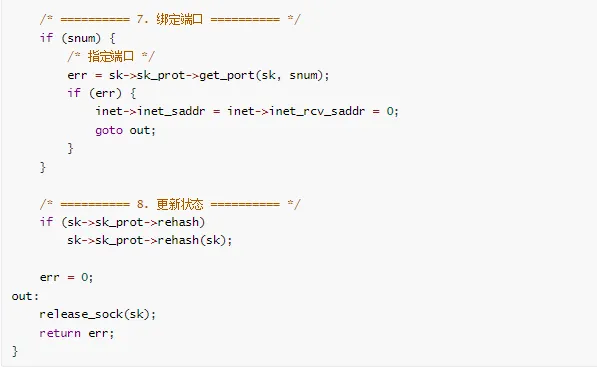

/*** __sock_create - 创建套接字(内部实现)*/bind() – 绑定地址

调用流程

源码实现

源码位置:

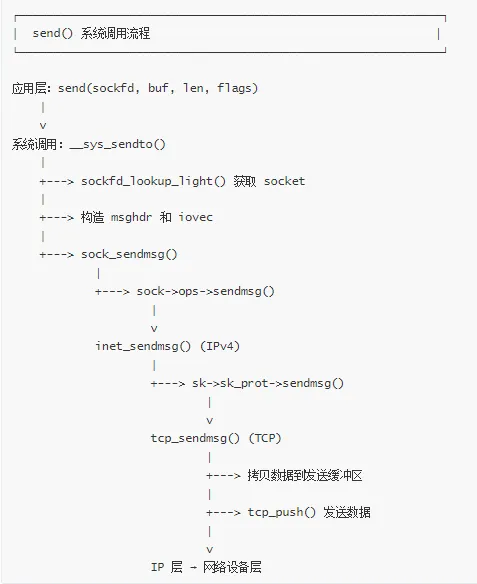

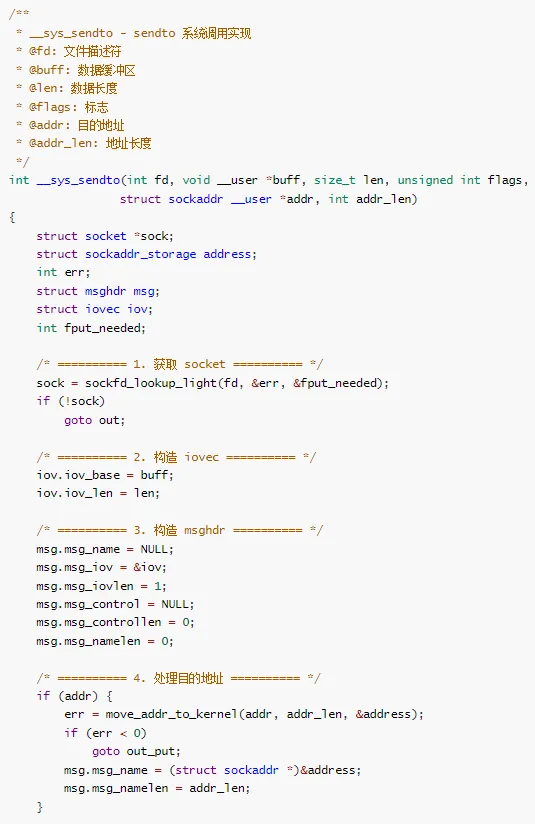

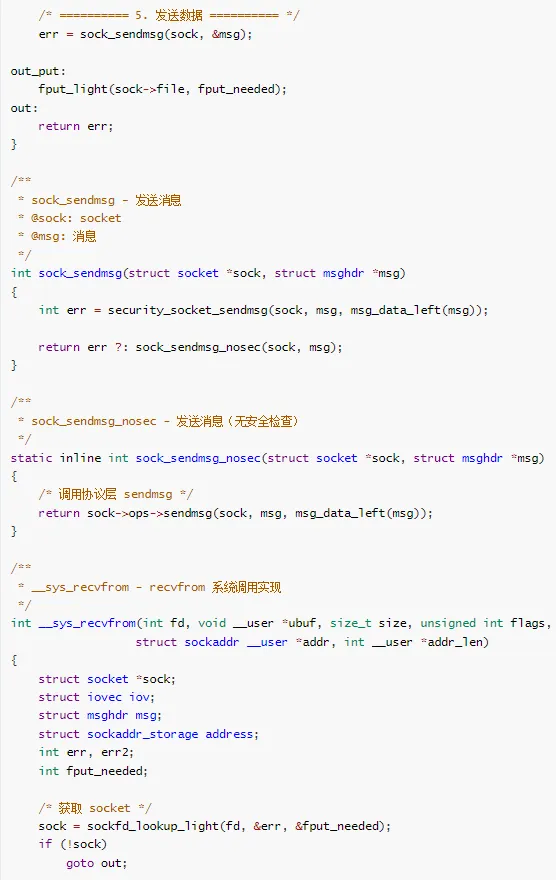

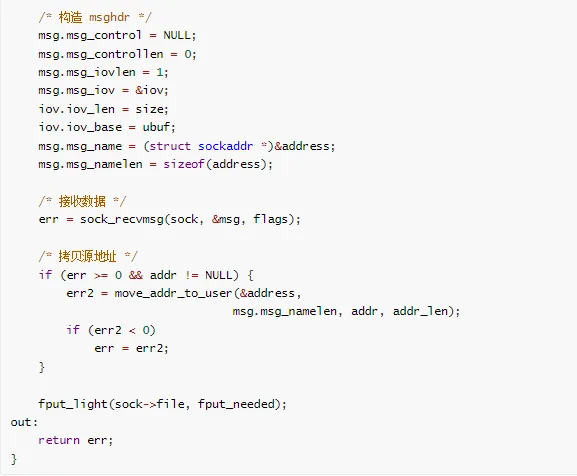

net/socket.c和net/ipv4/af_inet.csend() 和 recv() – 数据传输

send() 调用流程

源码实现

源码位置:

net/socket.c

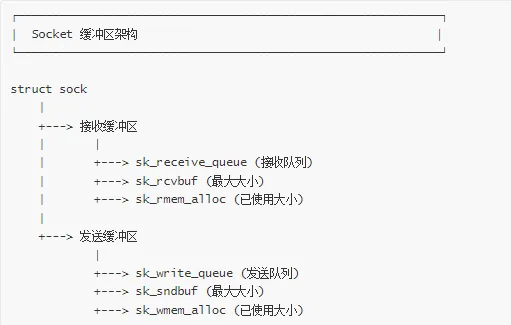

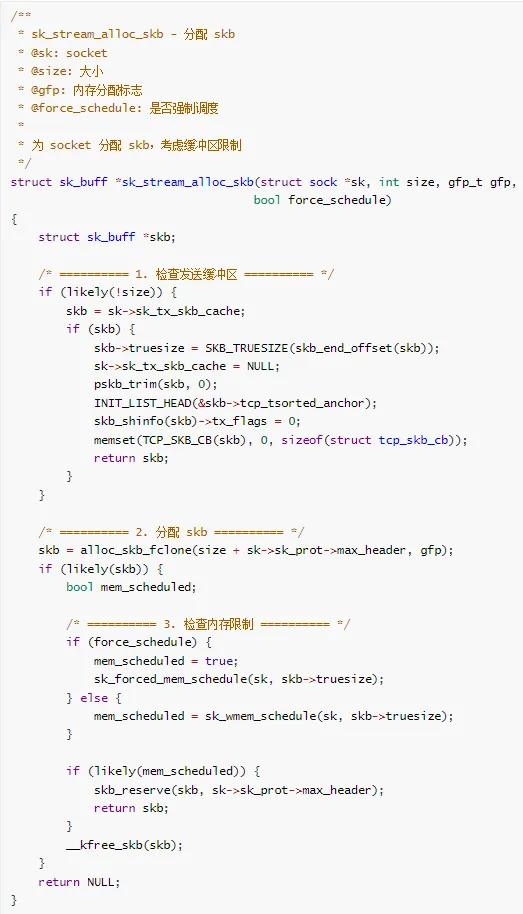

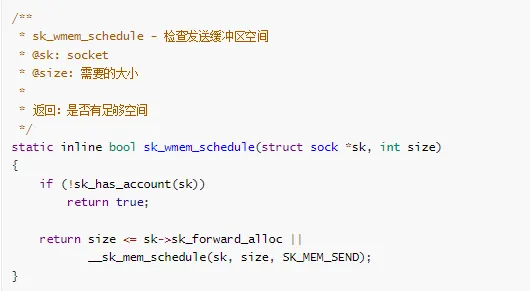

💾 Socket 缓冲区管理

缓冲区结构

缓冲区管理实现

源码位置:

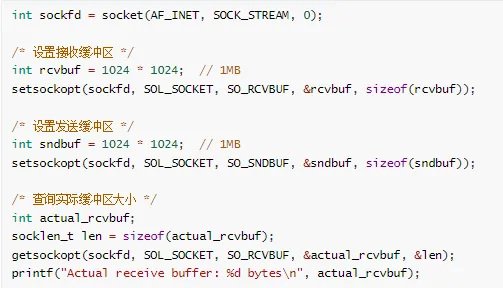

net/core/sock.c缓冲区配置

系统参数:

# 查看默认缓冲区大小sysctl net.core.rmem_defaultsysctl net.core.wmem_default# 查看最大缓冲区大小sysctl net.core.rmem_maxsysctl net.core.wmem_max# TCP 缓冲区(最小、默认、最大)sysctl net.ipv4.tcp_rmemsysctl net.ipv4.tcp_wmem# 设置缓冲区大小sysctl -w net.core.rmem_default=262144sysctl -w net.core.wmem_default=262144sysctl -w net.core.rmem_max=16777216sysctl -w net.core.wmem_max=16777216# TCP 自动调优sysctl -w net.ipv4.tcp_moderate_rcvbuf=1应用层设置:

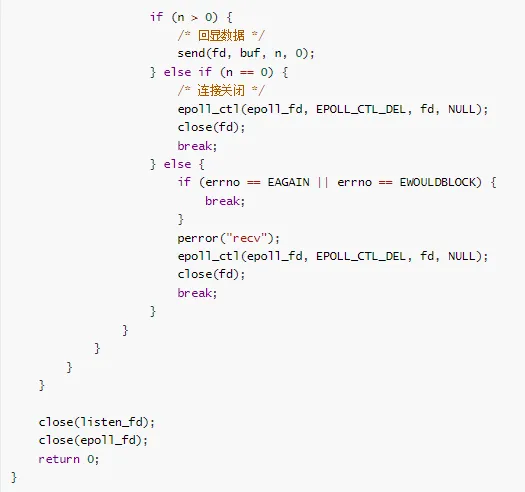

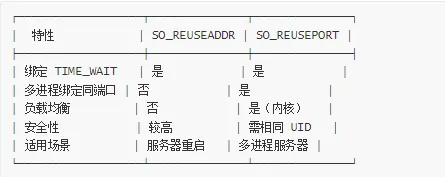

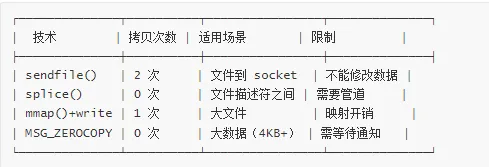

⚡ 零拷贝技术

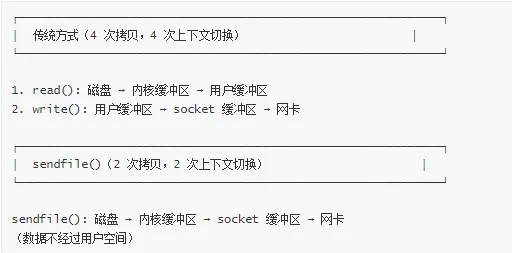

零拷贝技术减少数据在用户空间和内核空间之间的拷贝次数,提高性能。

传统方式 vs 零拷贝

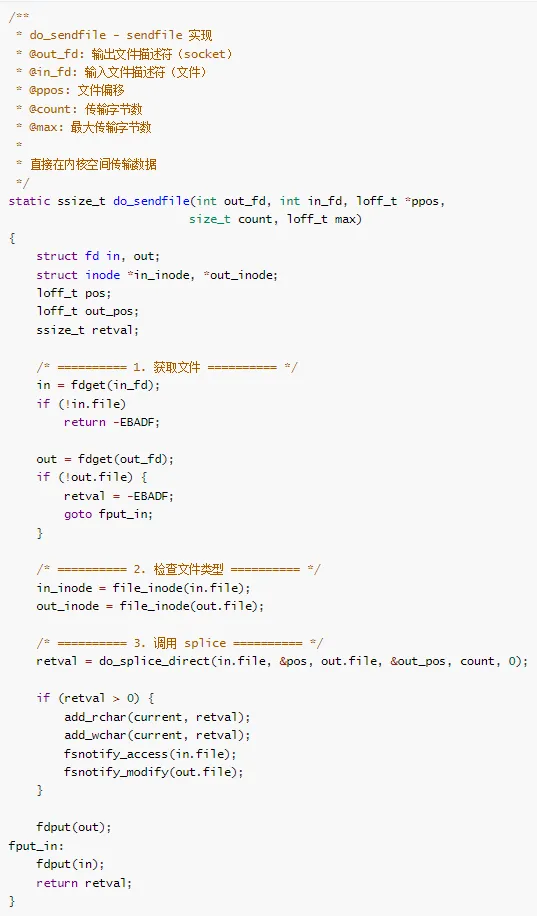

sendfile() 实现

源码位置:

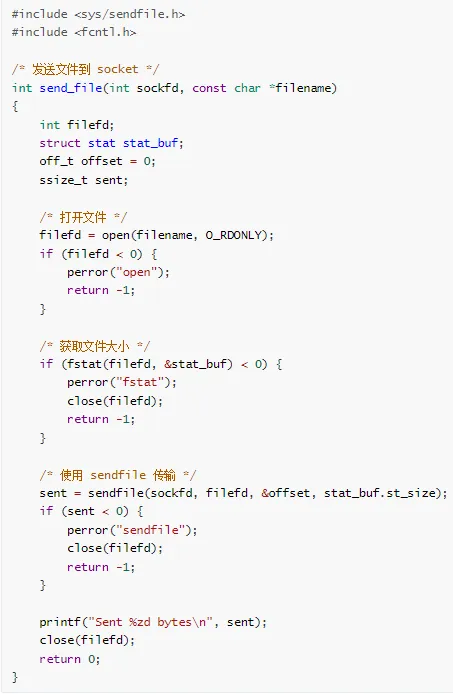

fs/read_write.c使用示例:

零拷贝技术对比

🚀 Socket 性能优化

I/O 多路复用

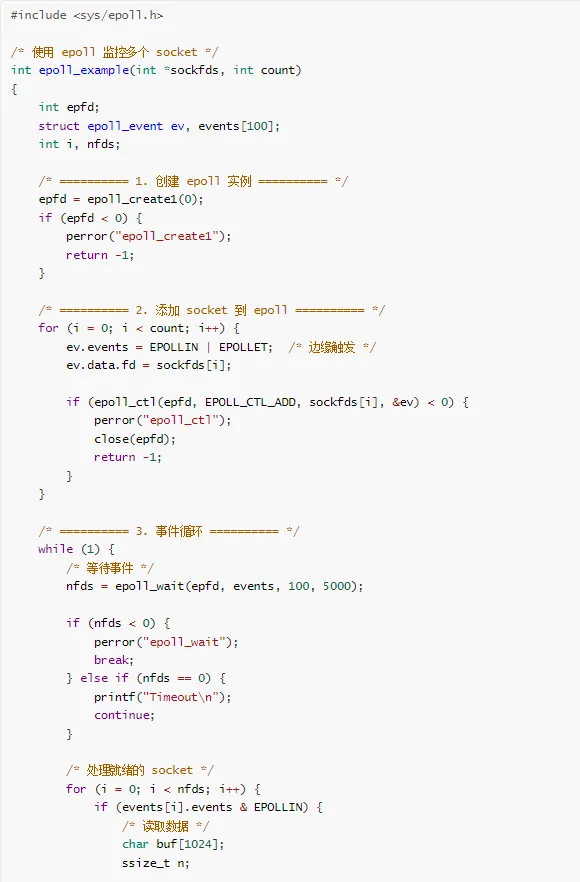

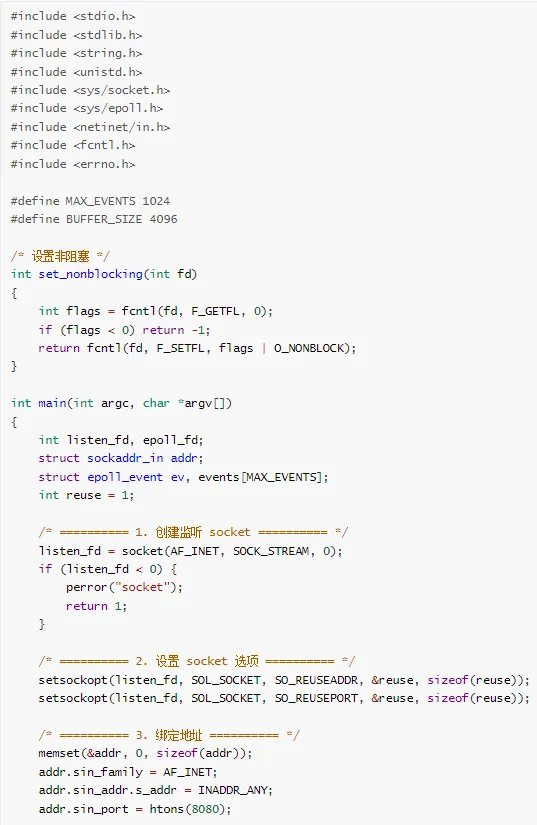

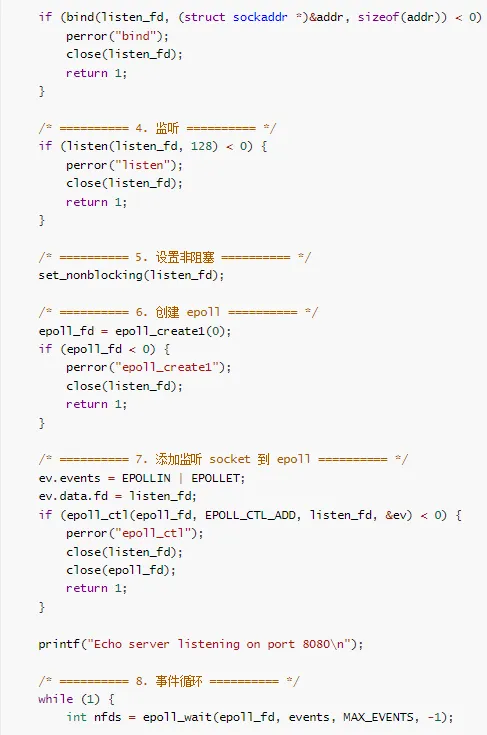

epoll() – 推荐方案

epoll 优势:

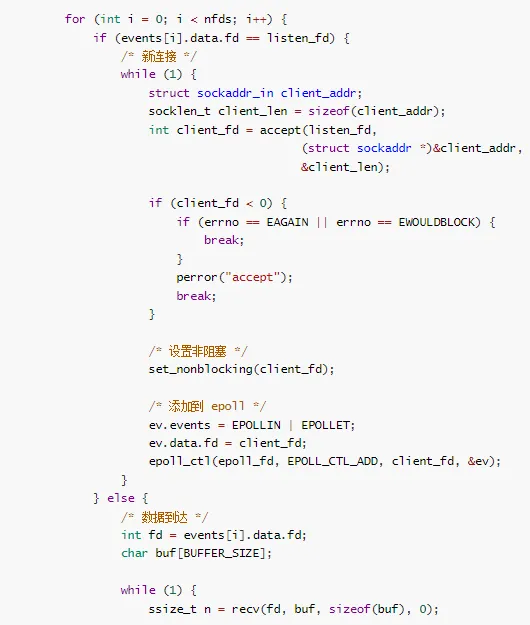

epoll 使用示例:

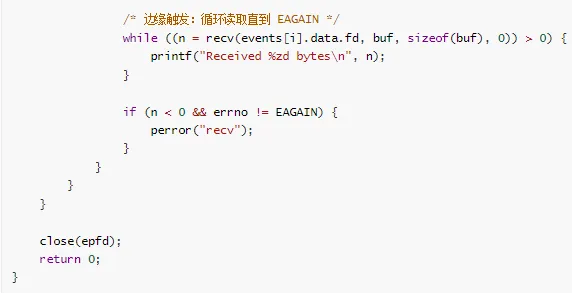

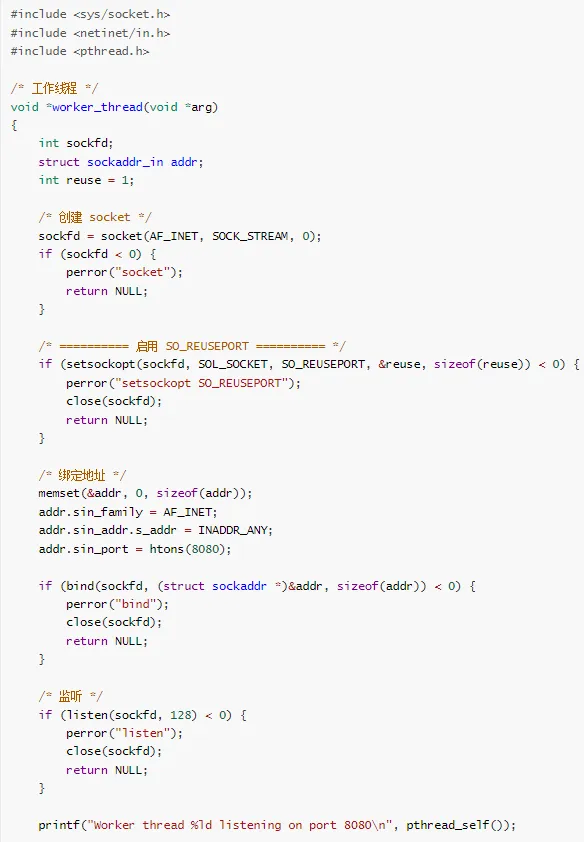

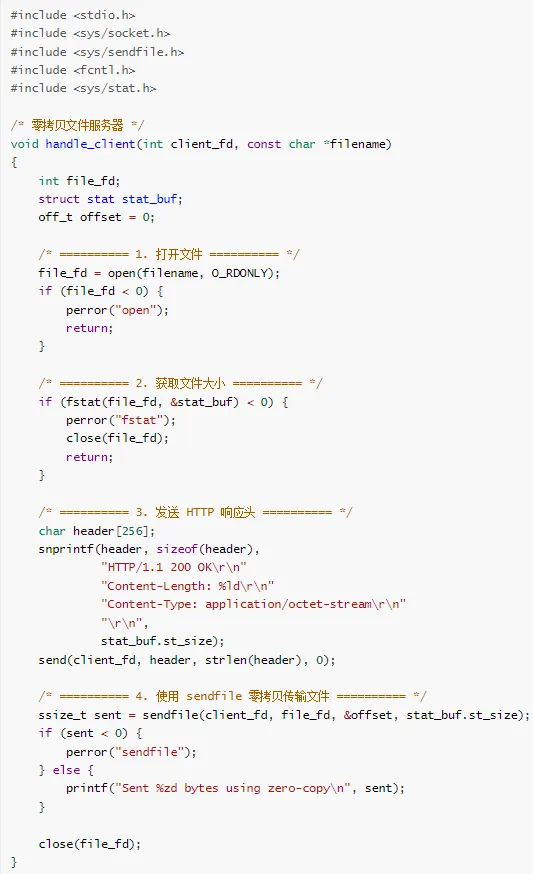

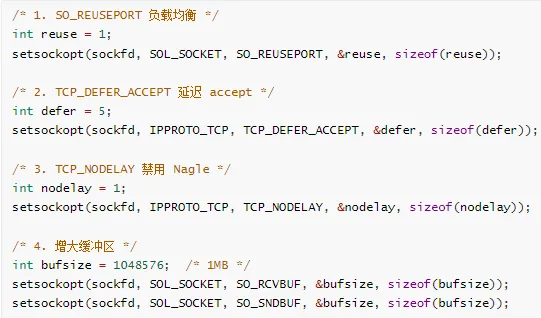

SO_REUSEPORT 负载均衡

SO_REUSEPORT 允许多个进程/线程绑定同一端口,内核自动负载均衡。

SO_REUSEPORT 优势:

负载均衡:内核自动分配连接到不同进程/线程

无锁设计:每个进程/线程独立 accept,无竞争

CPU 亲和性:连接倾向于分配到同一 CPU

热升级:可以逐步重启进程

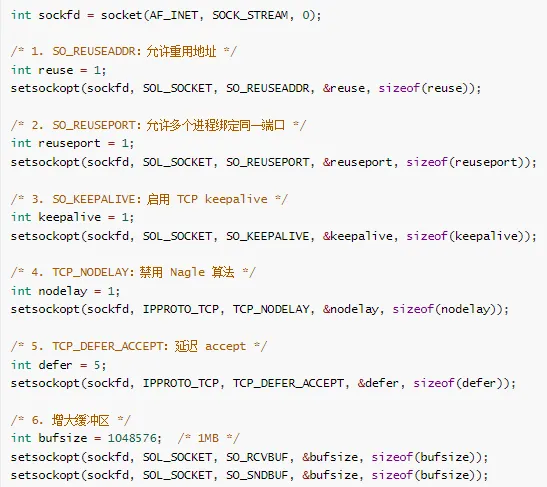

Socket 选项优化

💡 实战案例

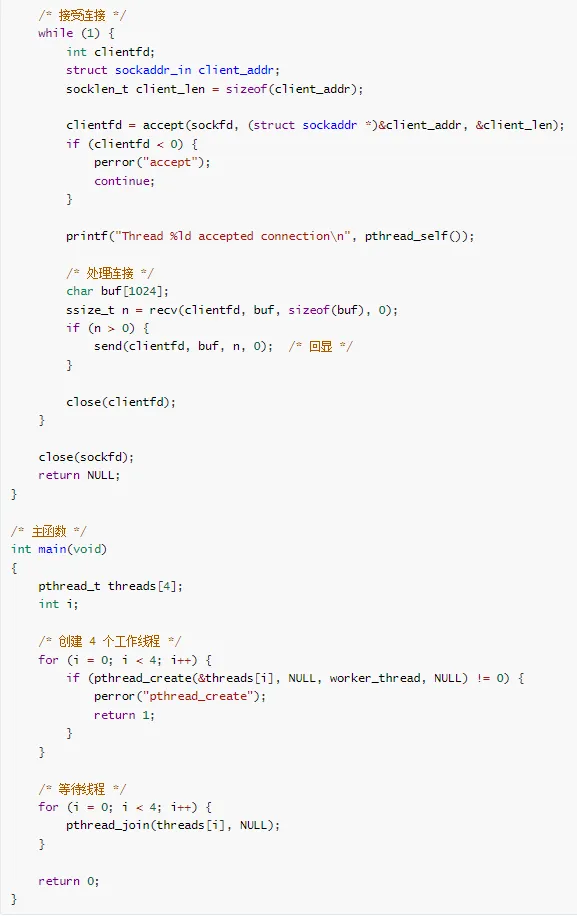

案例 1:高性能 Echo 服务器

案例 2:零拷贝文件服务器

📝 总结

核心要点

Socket 层架构:

-

VFS socket 层:提供统一的文件接口

-

协议无关层(struct sock):通用套接字功能

-

协议相关层(struct inet_sock, tcp_sock):协议特定功能

系统调用实现:

-

socket():创建套接字,分配 socket 和 sock 结构

-

bind():绑定本地地址和端口

-

listen():进入监听状态,创建连接队列

-

accept():从全连接队列取出连接

-

connect():发起连接请求

-

send()/recv():数据传输

缓冲区管理:

-

发送缓冲区(sk_sndbuf):限制发送数据量

-

接收缓冲区(sk_rcvbuf):限制接收数据量

-

自动调优:TCP 根据网络状况动态调整

零拷贝技术:

-

sendfile():文件到 socket,2 次拷贝

-

splice():文件描述符之间,0 次拷贝

-

mmap() + write():内存映射,1 次拷贝

-

MSG_ZEROCOPY:真正零拷贝,适合大数据

性能优化:

-

I/O 多路复用:select、poll、epoll

-

SO_REUSEPORT:多进程/线程负载均衡

-

TCP_DEFER_ACCEPT:延迟 accept

-

TCP_NODELAY:禁用 Nagle 算法

最佳实践

-

使用 epoll:大量连接时性能最好

-

启用 SO_REUSEPORT:多核 CPU 负载均衡

-

调整缓冲区大小:根据应用场景优化

-

使用零拷贝:大文件传输使用 sendfile

-

非阻塞 I/O:配合 epoll 边缘触发

-

TCP_NODELAY:实时应用禁用 Nagle

-

TCP_CORK:批量数据累积发送

性能调优建议

# 1. 增加缓冲区大小sysctl -w net.core.rmem_max=16777216sysctl -w net.core.wmem_max=16777216sysctl -w net.ipv4.tcp_rmem="4096 87380 16777216"sysctl -w net.ipv4.tcp_wmem="4096 65536 16777216"# 2. 启用 TCP Fast Opensysctl -w net.ipv4.tcp_fastopen=3# 3. 调整连接队列sysctl -w net.core.somaxconn=2048sysctl -w net.ipv4.tcp_max_syn_backlog=2048# 4. 启用 TCP 时间戳sysctl -w net.ipv4.tcp_timestamps=1# 5. 启用 TCP 窗口缩放sysctl -w net.ipv4.tcp_window_scaling=1下一篇预告

下一篇《网络命名空间(Network Namespace)》将深入分析:

-

网络命名空间架构

-

namespace 创建和管理

-

veth pair 实现

-

容器网络基础

-

Docker/Kubernetes 网络原理

❓ 常见问题(FAQ)

Q1: socket 和 sock 有什么区别?

socket 是 VFS 层的结构,面向用户空间:

-

包含文件操作接口(file_operations)

-

提供协议无关的抽象

-

通过文件描述符访问

sock 是网络层的结构,面向内核空间:

-

包含协议相关的状态和数据

-

管理发送/接收缓冲区

-

实现具体的网络协议逻辑

关系:socket->sk 指向 sock,一对一映射。

Q2: 为什么需要 SO_REUSEADDR?

问题场景:服务器重启时,端口处于 TIME_WAIT 状态,bind() 失败。

原因:TCP 连接关闭后,本地端口进入 TIME_WAIT(2MSL),防止旧连接的延迟数据包干扰新连接。

解决方案:

int reuse=1;setsockopt(sockfd, SOL_SOCKET, SO_REUSEADDR, &reuse, sizeof(reuse));效果:允许绑定处于 TIME_WAIT 状态的端口。

Q3: SO_REUSEADDR 和 SO_REUSEPORT 的区别?

推荐:现代高性能服务器同时使用两者。

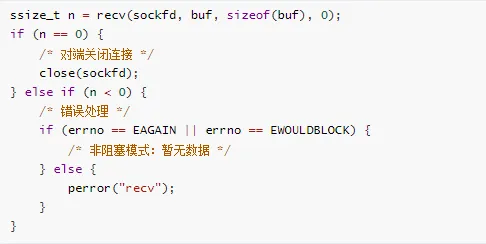

Q4: 为什么 recv() 返回 0?

recv() 返回 0 表示对端关闭了连接(发送 FIN)。

处理方式:

Q5: 阻塞和非阻塞 socket 的区别?

阻塞模式(默认):

-

recv() 等待数据到达才返回

-

send() 等待缓冲区有空间才返回

-

accept() 等待新连接才返回

-

简单但效率低

非阻塞模式:

-

立即返回,返回 EAGAIN/EWOULDBLOCK

-

需要配合 I/O 多路复用(epoll)

-

复杂但高效

设置非阻塞:

int flags=fcntl(sockfd, F_GETFL, 0);fcntl(sockfd, F_SETFL, flags|O_NONBLOCK);Q6: epoll 的水平触发和边缘触发有什么区别?

水平触发(LT,Level Triggered):

-

只要有数据可读,epoll_wait() 就会返回

-

可以分多次读取数据

-

不容易丢失事件

-

默认模式

边缘触发(ET,Edge Triggered):

-

只在状态变化时触发一次

-

必须一次性读完所有数据(循环 recv 直到 EAGAIN)

-

性能更高,但容易遗漏数据

-

需要非阻塞 socket

示例:

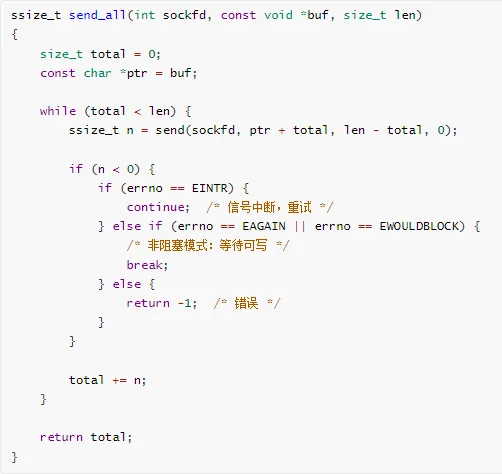

/* 水平触发 */ev.events=EPOLLIN;/* 边缘触发 */ev.events=EPOLLIN|EPOLLET;/* 边缘触发必须循环读取 */while ((n=recv(fd, buf, sizeof(buf), 0)) >0) {/* 处理数据 */}Q7: 为什么 send() 返回值小于发送长度?

原因:

发送缓冲区满:只发送了部分数据

非阻塞模式:立即返回已发送的字节数

信号中断:被信号打断

正确处理:

Q8: 什么时候使用 TCP_NODELAY?

Nagle 算法:累积小数据包,减少网络传输次数。

问题:增加延迟,不适合实时应用。

使用场景:

-

实时游戏

-

远程桌面

-

金融交易系统

-

SSH/Telnet

禁用 Nagle:

int nodelay=1;setsockopt(sockfd, IPPROTO_TCP, TCP_NODELAY, &nodelay, sizeof(nodelay));注意:禁用 Nagle 会增加小包数量,可能降低吞吐量。

Q9: 如何处理 SIGPIPE 信号?

问题:向已关闭的 socket 写数据,进程收到 SIGPIPE 信号,默认终止。

解决方案 1:忽略 SIGPIPE

signal(SIGPIPE, SIG_IGN);解决方案 2:使用 MSG_NOSIGNAL

send(sockfd, buf, len, MSG_NOSIGNAL);推荐:方案 2,更精细的控制。

Q10: 零拷贝技术如何选择?

选择建议:

-

小文件(<64KB):普通 read/write

-

中等文件(64KB-1MB):sendfile()

-

大文件(>1MB):sendfile() 或 mmap()

-

超大数据(>4KB 且频繁):MSG_ZEROCOPY

Q11: 如何优化高并发服务器?

架构优化:

-

多进程/多线程 + SO_REUSEPORT:利用多核 CPU

-

epoll 边缘触发:减少系统调用

-

非阻塞 I/O:避免线程阻塞

内核参数优化:

# 增加文件描述符限制ulimit -n 1000000# 增加连接队列sysctl -w net.core.somaxconn=4096sysctl -w net.ipv4.tcp_max_syn_backlog=4096# 增加缓冲区sysctl -w net.core.rmem_max=16777216sysctl -w net.core.wmem_max=16777216# 启用 TCP Fast Opensysctl -w net.ipv4.tcp_fastopen=3# 减少 TIME_WAIT 时间sysctl -w net.ipv4.tcp_fin_timeout=30应用层优化:

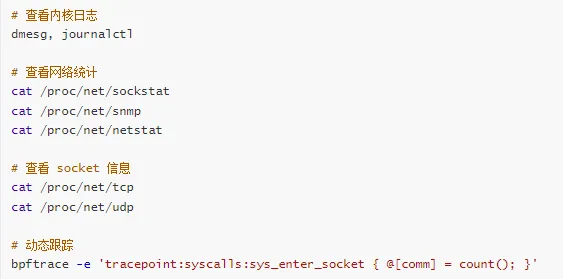

Q12: 如何调试 socket 程序?

1. 使用 strace 跟踪系统调用:

strace -e trace=socket,bind,listen,accept,connect,send,recv ./server2. 使用 tcpdump 抓包:

tcpdump -i eth0 port 8080 -w capture.pcap3. 使用 netstat 查看连接状态:

netstat -antp | grep 80804. 使用 ss 查看 socket 统计:

ss -s# 统计信息ss -tan state established # 已建立的连接ss -tan state time-wait # TIME_WAIT 连接5. 查看 socket 缓冲区:

cat /proc/net/sockstatcat /proc/sys/net/core/rmem_maxcat /proc/sys/net/core/wmem_max6. 使用 gdb 调试:

gdb ./server(gdb) break socket(gdb) run(gdb) print *sk

📚 参考资料

内核源码文件

套接字层核心文件:

net/socket.c # socket 系统调用实现net/core/sock.c # sock 结构管理net/ipv4/af_inet.c # IPv4 协议族net/ipv4/tcp.c # TCP 协议实现net/ipv4/tcp_input.c # TCP 输入处理net/ipv4/tcp_output.c # TCP 输出处理net/core/skbuff.c # sk_buff 管理net/core/datagram.c # 数据报处理fs/read_write.c # sendfile 实现fs/splice.c # splice 实现关键头文件:

include/linux/socket.h # socket 定义include/linux/net.h # 网络子系统接口include/net/sock.h # sock 结构定义include/net/tcp.h # TCP 定义include/linux/skbuff.h # sk_buff 定义include/uapi/linux/socket.h # 用户空间 socket API系统调用手册

socket 编程相关 man 页:

man 2 socket # socket() 系统调用man 2 bind # bind() 系统调用man 2 listen # listen() 系统调用man 2 accept # accept() 系统调用man 2 connect # connect() 系统调用man 2 send # send() 系统调用man 2 recv # recv() 系统调用man 2 sendfile # sendfile() 系统调用man 2 splice # splice() 系统调用man 2 epoll_create # epoll_create() 系统调用man 2 epoll_ctl # epoll_ctl() 系统调用man 2 epoll_wait # epoll_wait() 系统调用man 7 socket # socket 选项man 7 tcp # TCP 协议man 7 ip # IP 协议经典书籍参考

网络编程:

《UNIX 网络编程 卷1:套接字联网 API》(第3版)

作者:W. Richard Stevens

经典的 socket 编程教材

《Linux 高性能服务器编程》

作者:游双

深入讲解 Linux 网络编程

《TCP/IP 详解 卷1:协议》

作者:W. Richard Stevens

TCP/IP 协议栈详解

内核开发:

《深入理解 Linux 网络技术内幕》

作者:Christian Benvenuti

全面剖析 Linux 网络子系统

《Linux 内核源代码情景分析》(下册)

作者:毛德操、胡希明

网络子系统源码分析

《深入 Linux 内核架构》

作者:Wolfgang Mauerer

包含网络子系统架构

工具和调试

网络工具:

# 抓包分析tcpdump, wireshark, tshark# 连接状态netstat, ss, lsof# 性能测试iperf3, netperf, wrk, ab# 系统调用跟踪strace, ltrace# 性能分析perf, bpftrace, bcc-tools内核调试:

开源项目参考

高性能网络库:

-

libevent: https://libevent.org/

-

libev: http://software.schmorp.de/pkg/libev.html

-

libuv: https://libuv.org/

-

Boost.Asio: https://www.boost.org/doc/libs/release/libs/asio/

高性能服务器:

-

Nginx: https://nginx.org/

-

Redis: https://redis.io/

-

Memcached: https://memcached.org/

-

HAProxy: https://www.haproxy.org/

网络测试工具:

-

iperf3: https://github.com/esnet/iperf

-

netperf: https://github.com/HewlettPackard/netperf

-

wrk: https://github.com/wg/wrk

作者:肇中

系列文章:

-

下一篇:《第12篇:网络命名空间(Network Namespace)》

勘误和建议:欢迎勘误和提供改进建议。

夜雨聆风

夜雨聆风