MCP 与 CLI:AI Agent 工具接口,谁更适合未来发展?

MCP 与 CLI:AI Agent 工具接口,谁更适合未来发展?

近年来,随着AI Agent技术的快速发展,如何高效、安全地让智能体访问外部工具和数据源,成为开发者关注的焦点。在众多解决方案中,MCP(Model Context Protocol,模型上下文协议)和CLI(Command Line Interface,命令行接口)两种工具接口方式逐渐成为主流。本文将从技术原理、实际对比到部署实操,系统梳理两者差异,帮助您直观理解其适用场景,并快速上手测试与应用。

一、技术介绍

MCP 是由Anthropic于2024年底推出的开放标准协议,旨在为AI模型与外部系统提供统一的标准化接口。它将工具、数据源和资源以结构化的方式暴露给Agent,实现“即插即用”式的连接,常被比喻为AI世界的“USB-C接口”。

CLI 则是传统命令行工具的调用方式,AI Agent通过生成并执行Shell命令(如git、aws cli、docker等),直接与操作系统或已安装的工具交互。CLI无需额外协议层,依赖Agent对命令语法的理解和输出解析能力。

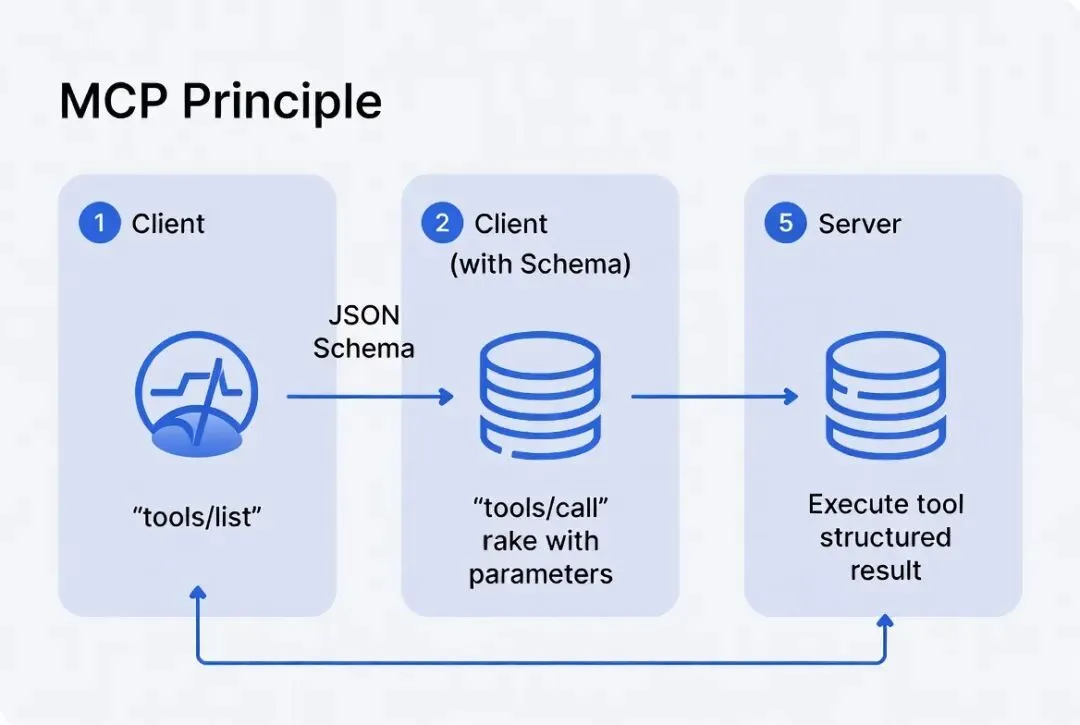

二、原理介绍

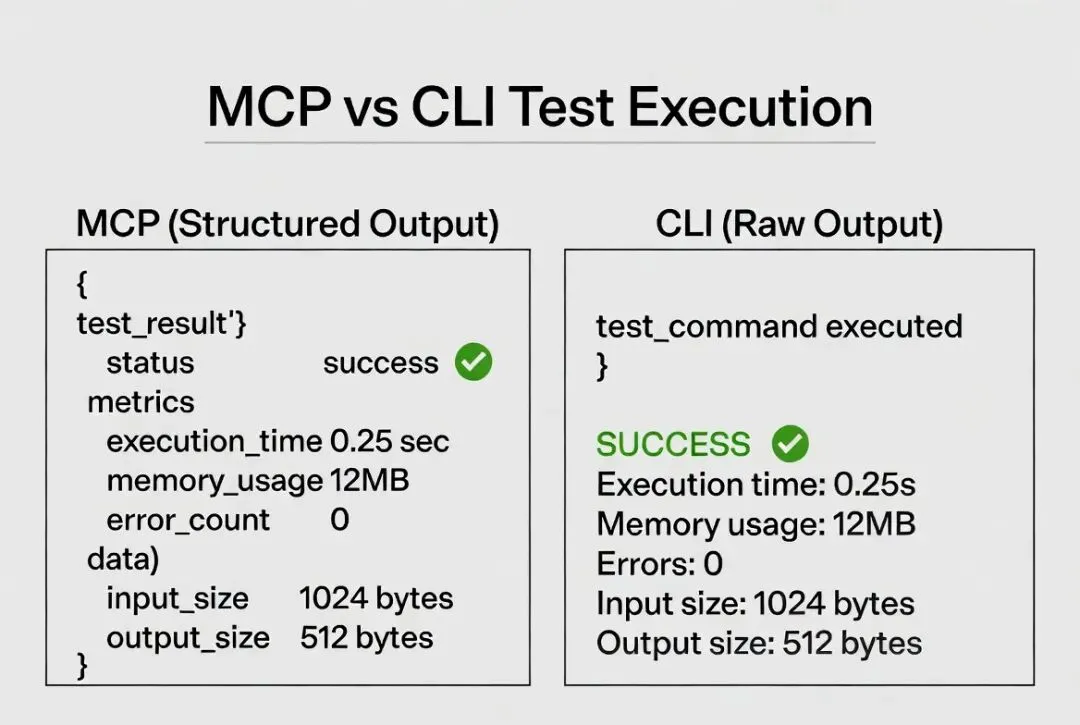

MCP采用Client-Server架构,核心基于JSON-RPC协议。AI Agent(Client)首先通过tools/list接口发现MCP Server暴露的工具列表,每个工具包含详细的JSON Schema(输入参数、输出格式、描述等)。Agent决定调用后,通过tools/call接口发送结构化请求,Server执行后返回结果。该过程将工具描述加载到模型上下文,确保类型安全和可解释性。

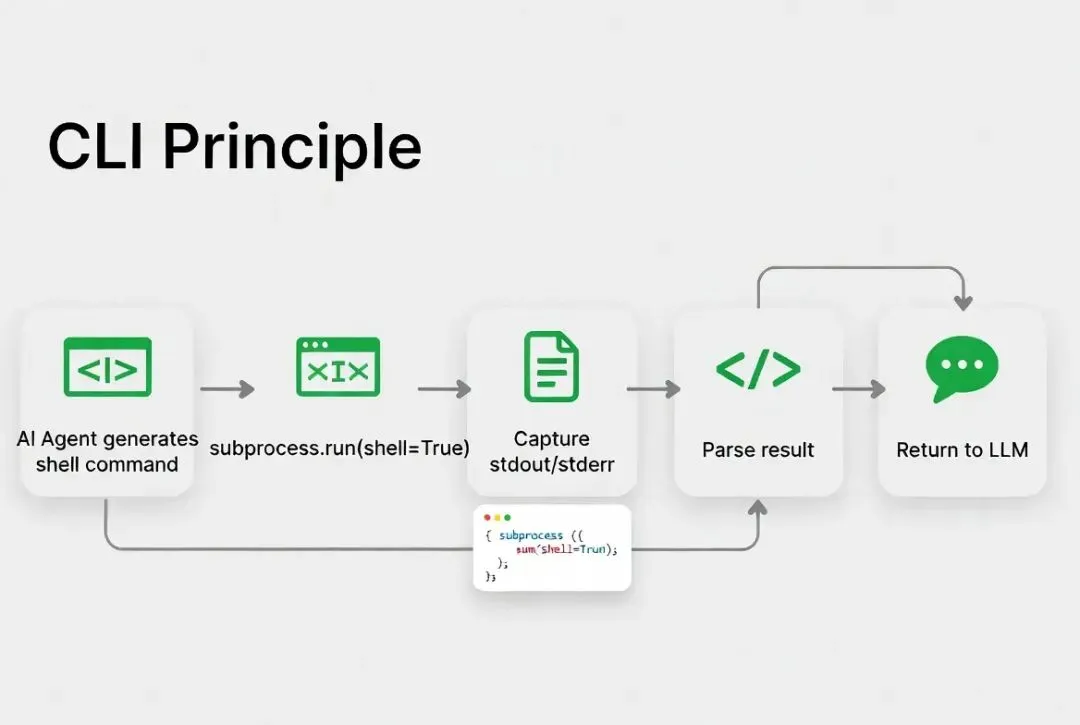

CLI的原理更为直接:Agent根据任务生成纯文本Shell命令字符串,通过subprocess或类似机制在沙箱环境中执行,捕获标准输出(stdout)和错误(stderr),然后解析结果返回给模型。整个流程依赖LLM对Unix命令的先验知识,无需预先加载Schema。

以下是CLI命令生成与执行的典型代码示例(Python):

import subprocessdef run_cli_command(command: str) -> str: try: result = subprocess.run(command, shell=True, capture_output=True, text=True, timeout=30) if result.returncode == 0: return result.stdout.strip() else: return f"Error: {result.stderr.strip()}" except Exception as e: return f"Execution failed: {str(e)}"三、同类产品横向对比

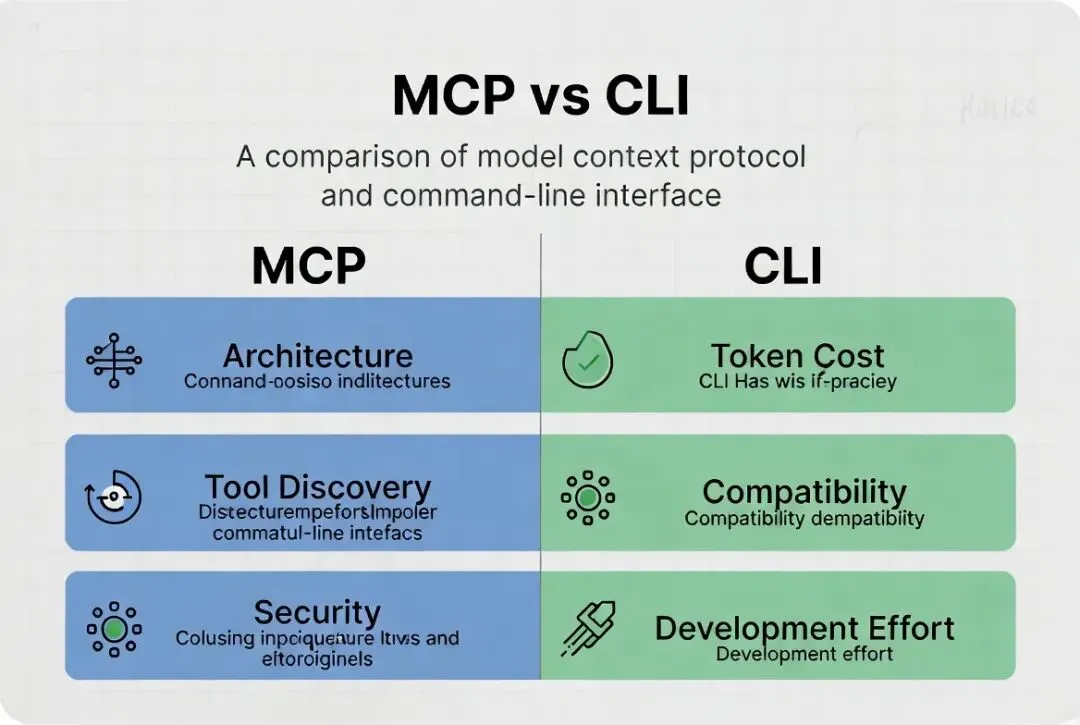

MCP和CLI在实际应用中各有侧重,以下为关键维度对比:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

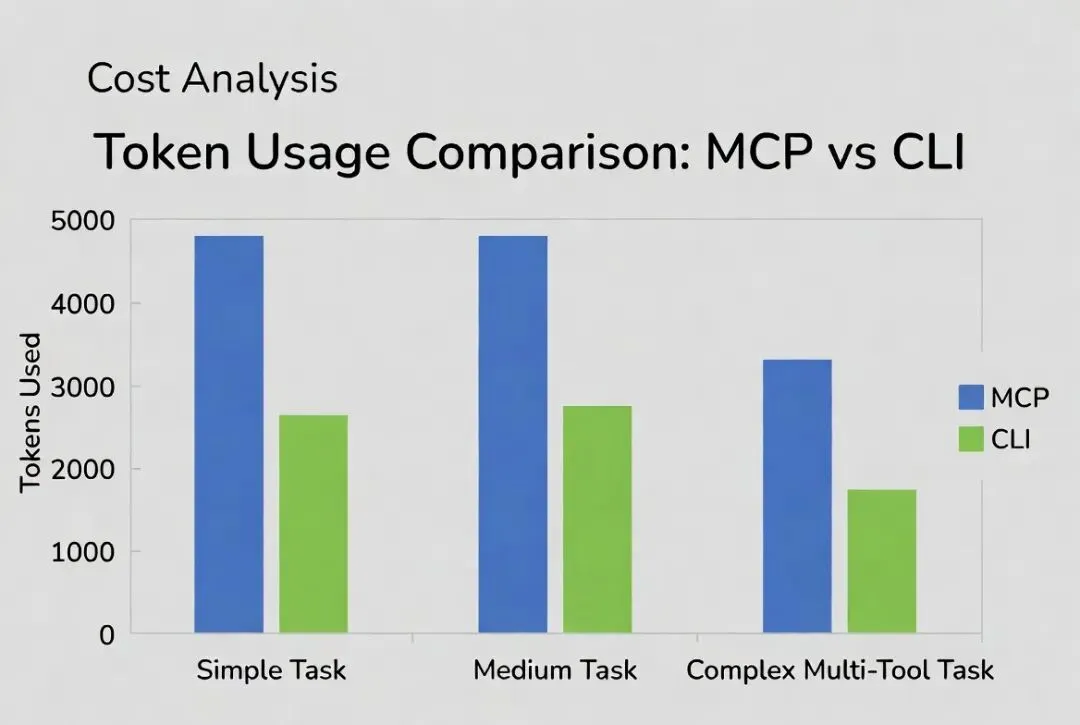

四、使用成本分析

MCP的使用成本主要体现在Token消耗和部署资源上。每次会话需加载工具Schema,复杂场景下单次上下文可能增加数千至上万token,直接推高API调用费用。同时,运行MCP Server需要额外服务器或本地进程。

CLI的成本显著更低,几乎无需额外Token开销,仅执行命令本身。部署仅需预装常用CLI工具。

五、自身优势与不足

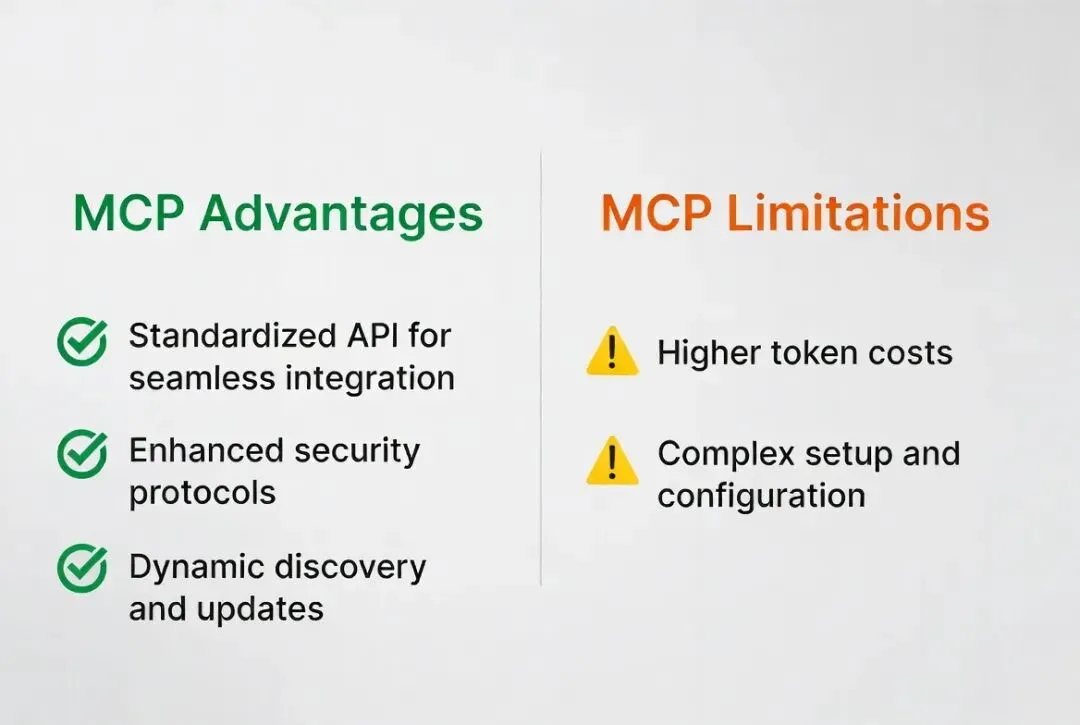

MCP的优势:标准化程度高,工具描述清晰,支持运行时发现和动态加载;安全性与治理能力强,适合多租户和企业环境。不足:上下文膨胀导致成本上升,部署门槛较高。

CLI的优势:极致轻量,执行速度快;可直接复用成熟生态工具。不足:输出解析依赖模型能力,安全性需额外强化。

六、详细安装教程

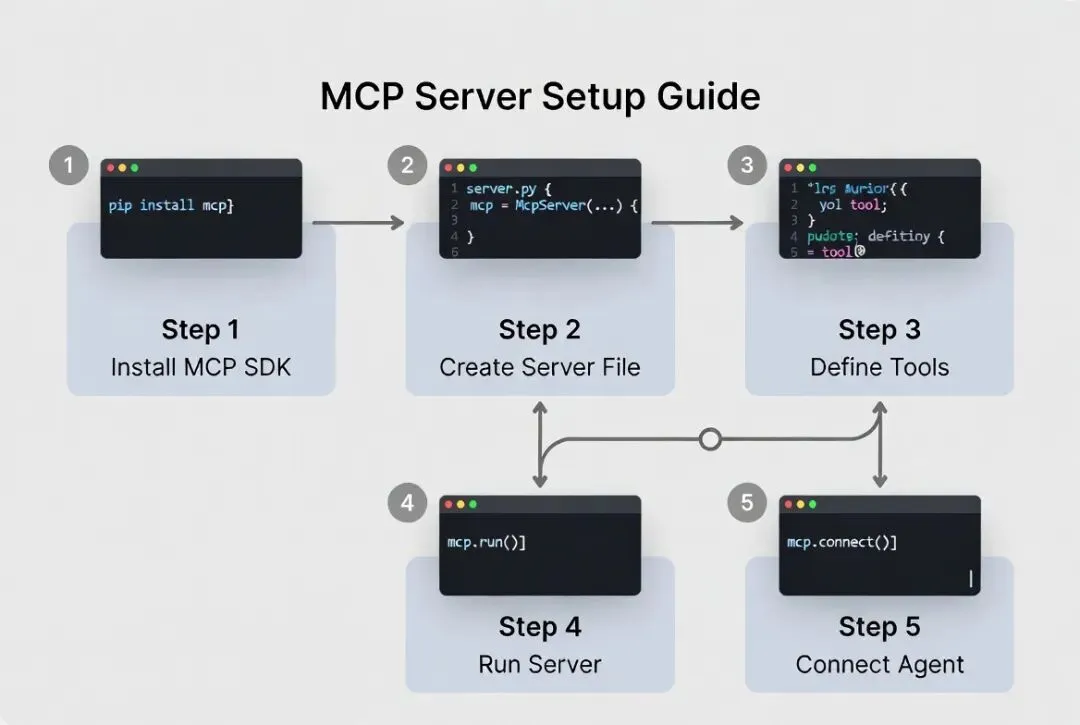

MCP方式安装与配置(完整示例)

-

1. 安装MCP SDK: pip install fastmcp mcp-sdk -

2. 创建完整MCP Server(以GitHub工具为例): from fastmcp import FastMCPfrom typing import Dictmcp = FastMCP("github-tools")@mcp.tool()def get_repo_info(owner: str, repo: str) -> Dict: """Fetch GitHub repository details""" return {"name": repo, "description": "Sample repo"}if __name__ == "__main__": mcp.run(transport="stdio") -

3. 启动Server并连接Agent: python mcp_server.py

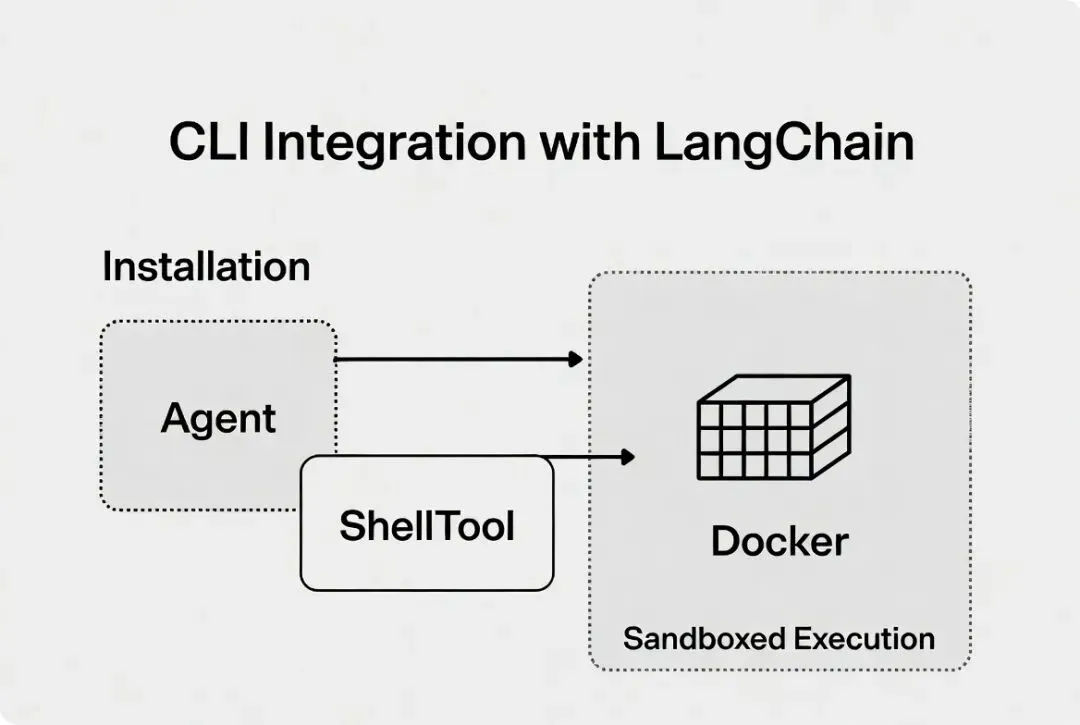

CLI方式安装与配置(LangChain示例)

-

1. 安装CLI工具并集成: brew install ghpip install langchain-community -

2. 完整CLI工具集成代码: from langchain_community.tools import ShellToolshell_tool = ShellTool()tools = [shell_tool]

七、测试使用方法

MCP测试代码:

response = mcp_client.call_tool("get_repo_info", {"owner": "anthropic", "repo": "mcp"})CLI测试代码:

result = run_cli_command("gh repo view anthropic/mcp --json name,description")八、部署与使用过程中的常见问题QA

Q1:MCP上下文膨胀如何优化?A1:采用动态加载工具,仅导入必要Schema。优化后代码示例:

mcp = FastMCP("tools", tools=["get_repo_info"])Q2:CLI安全风险如何控制?A2:使用Docker沙箱:

FROM ubuntu:latestRUN apt-get install -y git ghUSER nobodyQ3:初学者应该从哪个入手?A3:建议先掌握CLI,待项目规模扩大后再引入MCP。通过本文的系统梳理,您已掌握MCP与CLI的核心差异及上手路径。AI Agent的工具接口没有绝对优劣,关键在于根据具体场景选择最适合的方案。建议结合实际项目进行小规模测试,逐步优化您的Agent架构。欢迎在评论区分享您的实践经验,我们共同推动AI技术在普通开发者中的落地应用。

通过本文的系统梳理,大家可以了解MCP与CLI的核心差异及上手路径。AI Agent的工具接口没有绝对优劣,关键在于根据具体场景选择最适合的方案。建议结合实际项目进行小规模测试,逐步优化您的Agent架构。欢迎在评论区分享您的实践经验,和我一起推动AI技术在普通开发者中的落地应用。

夜雨聆风

夜雨聆风