OpenAI Codex 限额政策全解读:你的 AI 编程助手到底能"用多久"?

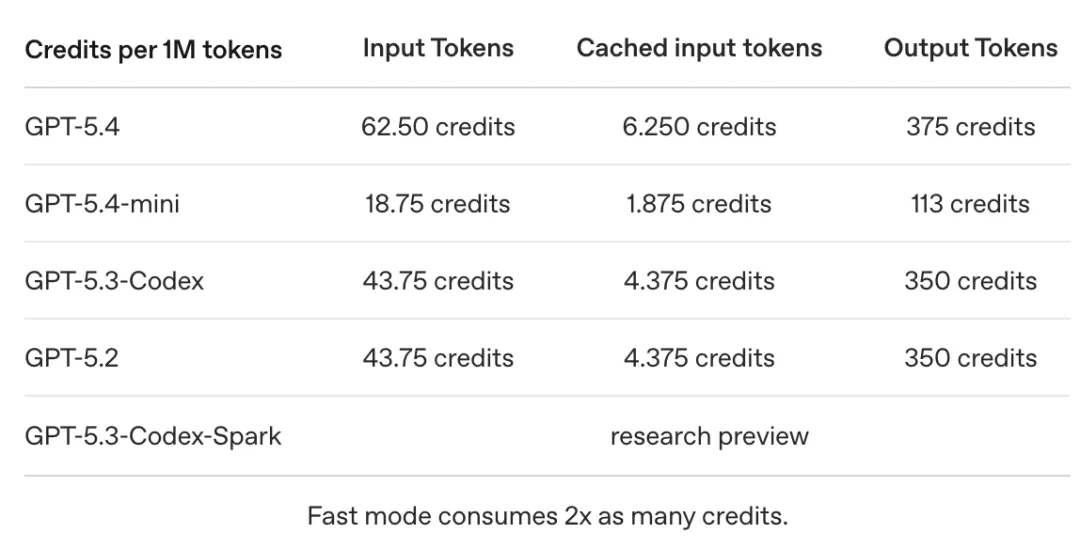

当你正沉浸在 AI 辅助编程的快感中——代码自动补全、Bug 智能修复、复杂逻辑一气呵成——屏幕上突然弹出一行冷冰冰的提示: 这种体验,大概就像马拉松跑到 40 公里被拦下要补票。 OpenAI 最近更新了 Codex 的使用限额政策,从按”消息数”计费转向更精细的”Token 消耗”模式。这套规则看起来复杂,但背后逻辑其实很清晰。今天我们就拆开来讲。 一、限额的”三层蛋糕” 首先,你得搞清楚自己是哪类用户。OpenAI 把用户分成三六九等(Plus/ Pro / Business / API key),每等的”蛋糕”大小完全不同。 一个小函数的自动补全,可能只消耗 0.1 个”消息单位”;但让它一次性重构整个模块,可能就要吃掉你好几个单位。简单说:越复杂的任务,”烧”得越快。 而 Business 和 Enterprise 用户已经全面转向 Token 计费——这是更”透明”的计费方式,后面细说。 二、Token 计费:新的游戏规则 从 4 月 2 日起,OpenAI 开始把 Business 和新 Enterprise 用户迁移到 Token 计费模式 。 什么叫 Token?简单说,就是你输入的内容 + AI 输出的内容,都被切分成一个个”词元”。中文一个汉字通常算 1-2 个 Token,英文一个单词大约 1 Token。 新的价目表是这样的(单位:Credits/百万 Token):

缓存输入便宜 10 倍 —— 如果你反复问同一类问题,AI 会”记住”上下文,这部分就不重复计费。

输出比输入贵得多 —— GPT-5.4 输出 1M Token 要 375 Credits,而输入只要 62.5。这意味着让 AI 写长文档比问短问题更”烧钱”。

Mini 模型性价比高 —— GPT-5.4-mini 的输入单价只有旗舰款的 30%,输出更是便宜了 70%。

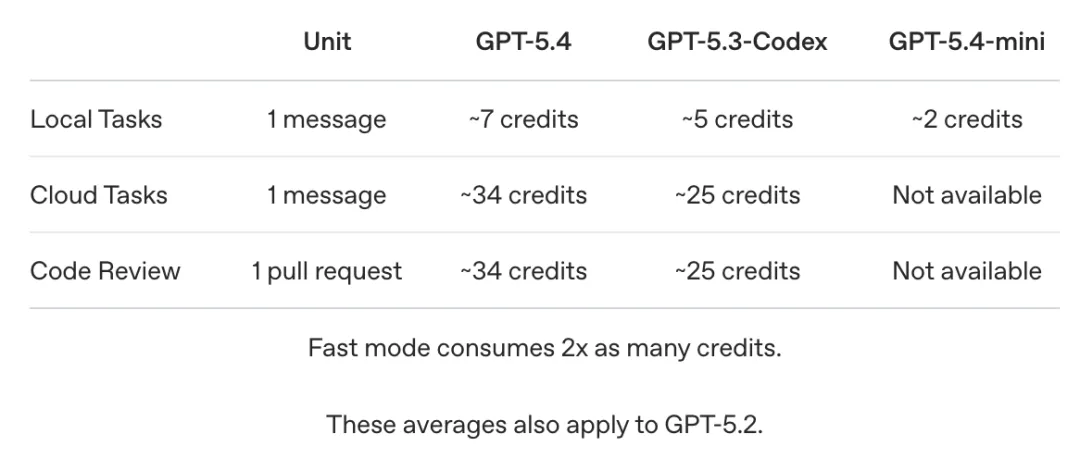

Plus 和 Pro 用户暂时还用旧的”消息数 “模式,详见下表,但 OpenAI 明确表示:迁移只是时间问题。 三、限额用完了怎么办? 方案 A:买 Credits Plus 和 Pro 用户可以直接购买额外的 Credits,不用升级套餐。类似于游戏里的”体力值”用完了,花点钱补满。 方案 B:切 Mini 模型 GPT-5.4-mini 可以让你的限额”撑”久 2.5 到 3.3 倍。如果你只是在做代码补全、简单重构这种”低智力密度”任务,完全没必要杀鸡用牛刀。 方案 C:接 API Key 如果你有自己的 OpenAI API Key,可以绑到 Codex 上,按官方 API 价格计费,独立于 Codex 的限额体系。适合重度用户。 四、代码审查的坑 Code Review 使用量只针对 GitHub 集成场景。 什么意思?如果你在 GitHub PR 里 @Codex 让它审查代码,这会从你的”代码审查配额”里扣。但如果你在本地运行 Codex 审查自己的代码,这算普通使用量 ,走的是”本地消息”或”Token”配额。 五、如何让限额”活”得更久? 1. 控制提示词长度 别把整个项目历史都塞进 Prompt 里。精简上下文,只给 AI 真正需要的信息。 2. 精简 AGENTS.md 如果你在用 AGENTS.md 管理项目上下文,注意文件大小。嵌套越多,Token 消耗越大。 3. 关掉不用的 MCP Server 每个 MCP Server 都会给你的消息加”料”。不需要就关掉,给上下文瘦身。 4. 善用 Mini 模型 简单任务用 GPT-5.4-mini,复杂任务再切旗舰款。这是最有效的”省流量”方法。 六、如何查看实时限额?

Codex 使用仪表盘 —— 网页端查看历史用量和配额状态。

CLI 内命令 —— 会话中输入 /status,实时显示剩余配额。

写在最后 AI 编程助手正在从”按人头订阅”转向”按用量计费”——这几乎是所有 SaaS 产品的终极归宿。 对轻度用户来说,Plus 的限额可能永远用不完;但对重度开发者,理解这套计费逻辑、学会”精打细算”,正在成为一项新的职场技能。 毕竟,Token 不是免费的。而你的项目预算,也不是。

夜雨聆风

夜雨聆风