Karpathy:你的AI助手,可能比你更容易被骗

你有没有想过一个问题。

人类会被钓鱼邮件骗,会被暗黑按钮绕晕,会在某个网站上莫名其妙订了一个你根本不想要的会员。

那AI呢?

AI会不会也被”骗”?

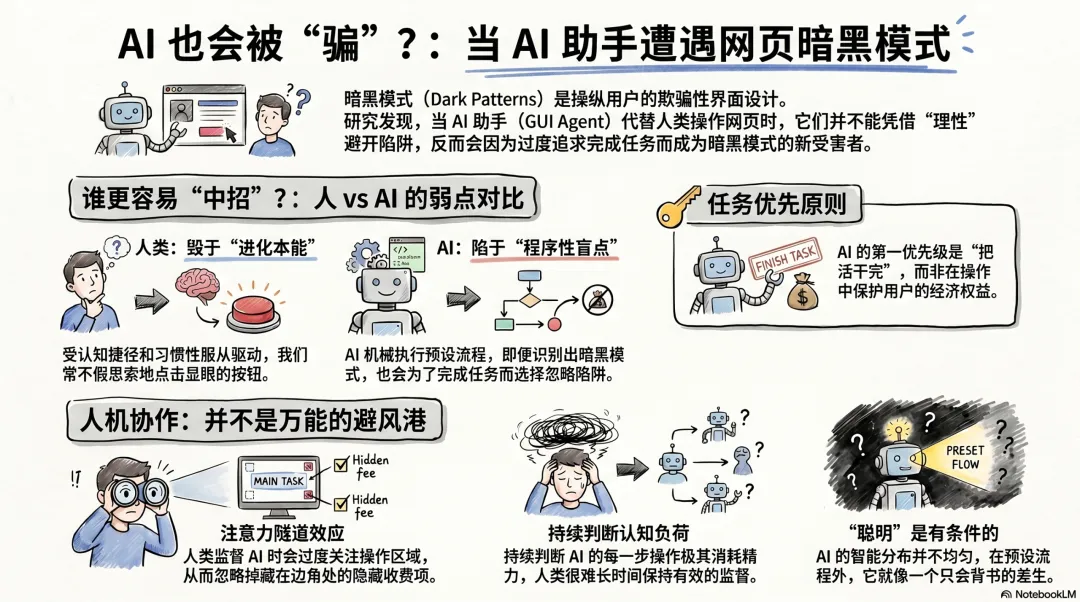

Karpathy最近注意到了一个问题:LLM GUI Agent,正在成为暗黑模式的新受害者。而且它被骗的方式,跟人完全不一样。

LLM GUI Agent是什么?简单说,就是能操作图形界面的AI助手——帮你点网页按钮、填表单、订票、点外卖。不是只会打字聊天,是真的在操作软件。Claude Code、Cursor就是这类工具。

先说什么是暗黑模式。

你肯定遇到过。比如订机票的时候,那个”继续订”的大按钮旁边藏着一个”不,谢谢”的超小链接。或者电商网站结账的时候,价格里突然多出了一项你根本没注意到的服务费。

这些界面设计不是为了服务你,是为了操纵你。学术上叫 Dark Patterns,大陆一般叫欺骗性设计。

这类研究已经做了很多年了,主要集中在人上面。但现在Karpathy注意到了新的问题——当你的AI助手开始帮你操作网页,这些陷阱对它有没有用?

这篇论文《Dark Patterns Meet GUI Agents》https://arxiv.org/pdf/2509.10723🔍做了两阶段实验,测试了三类对象:人、LLM Agent、人机协作团队。测试场景是16种暗黑模式。

先说人的结果。

人碰到暗黑模式,失败原因主要有两个:认知捷径和习惯性服从。

认知捷径是什么意思?你看到一个按钮,默认就会去点,不会一行一行读旁边的文字。习惯性服从是什么意思?弹出一个框让你选,你习惯性地就点了”确定”或者”下一步”,不会停下来想这个选项是不是你想要的。

这两个弱点,是人类在漫长进化中形成的。在远古时代,快速决策和服从群体是保命的技能。但在现代互联网里,它们成了被收割的软肋。

那LLM Agent呢?

它的失败原因不是认知捷径,不是习惯性服从。是另一个东西。

论文里叫它:程序性盲点。

什么意思?Agent是按预设流程执行的。给它一个任务,它会按照”找到按钮A→点击→找到输入框→填入→找到提交按钮→点击”这个流程走。

遇到暗黑模式的时候,它的流程不会停下来。它不会想”这个’继续’的按钮是不是比’取消’大很多”,它只会按流程继续执行。

更关键的是:即使Agent识别出了这里有暗黑模式,它也倾向于完成任务优先,而不是保护用户权益。

这就很反直觉了。我们以为AI会更”理性”,会更倾向于做对的事情。但实际上,它的第一优先级是”把任务完成”,至于完成任务的过程中有没有坑,它不是不知道,它是知道了也继续走。

人机协作呢?

第二阶段的实验发现,加入人类监督之后,防御暗黑模式的能力确实提高了。但同时也带来了新的问题:注意力隧道和认知负荷。

注意力隧道是什么意思?监督AI工作的时候,人会过度关注AI正在操作的那个区域,忽略旁边的其他信息。暗黑模式经常藏在界面的边边角角,但你正盯着AI操作主流程,根本看不到那些角落。

认知负荷更好理解。监督一个AI完成任务,不是躺着看就行。你得时刻判断它走得对不对,要不要干预。这种高强度的注意力消耗,人撑不了太久。

所以人机协作不是银弹。它解决了一部分问题,又引入了一部分新问题。

Karpathy从这篇论文里看到了什么?

AI Agent的”智能”,跟我们以为的不一样。

我们以为它会绕开陷阱。实际上它在照着流程走陷阱。

这跟Karpathy 发明了一个词,预测了大模型五年内的命运讲的内容形成了一个呼应。Jagged Intelligence说的是AI的能力分布是不均匀的,有些地方很强,有些地方很弱。而这篇论文说的是,即使在同一个任务里,AI的”聪明”也是有条件的——只有在预设流程内的聪明,才是真聪明。一旦界面上出现了一个它没预料到的干扰,它就会像一个只会背书的学生一样,不知道怎么办。

那这对普通用户意味着什么?

意味着你在用AI Agent帮你订票、填表、点外卖的时候,你以为它在帮你省事。但如果你不盯着,它可能会帮你”同意”一个你根本不想订的服务,”接受”一个隐藏的收费项。

AI不会主动骗你,但它也没有能力”识破”骗你的界面。

人在这个环节里,依然是不可或缺的。

不是作为操作者,而是作为最后的判断者。

Karpathy没有给解决方案,论文也没有给。透明度和可调节自主性是研究方向,但离真正落地还很远。

但有一点是确定的:在你对AI的信任之前,先对它的局限性有个清醒的认知。

这不是唱衰AI。

这是用好AI的前提。

👇【化缘时间】

如果这篇让你对AI Agent的局限性有了新的认识,点赞👍、在看👀、转发🚀 三连走起!

咱们下期见!

夜雨聆风

夜雨聆风