OpenClaw Gemma 4:可本地部署、离线优先的私有 AI 智能体工具

编者摘要:OpenClaw Gemma 4是一款可本地部署、离线优先的私有 AI 智能体工具,依托Gemma 4 模型与Ollama简化部署,支持私密网页搜索、长文档推理、模块化架构与结构化执行,全程不将数据上传云端,兼顾隐私安全与自动化工作流效率,可用于研究、写作、规划等场景,26B 模型为最优适配版本,大幅降低本地 AI 自动化门槛并提升长期生产力。

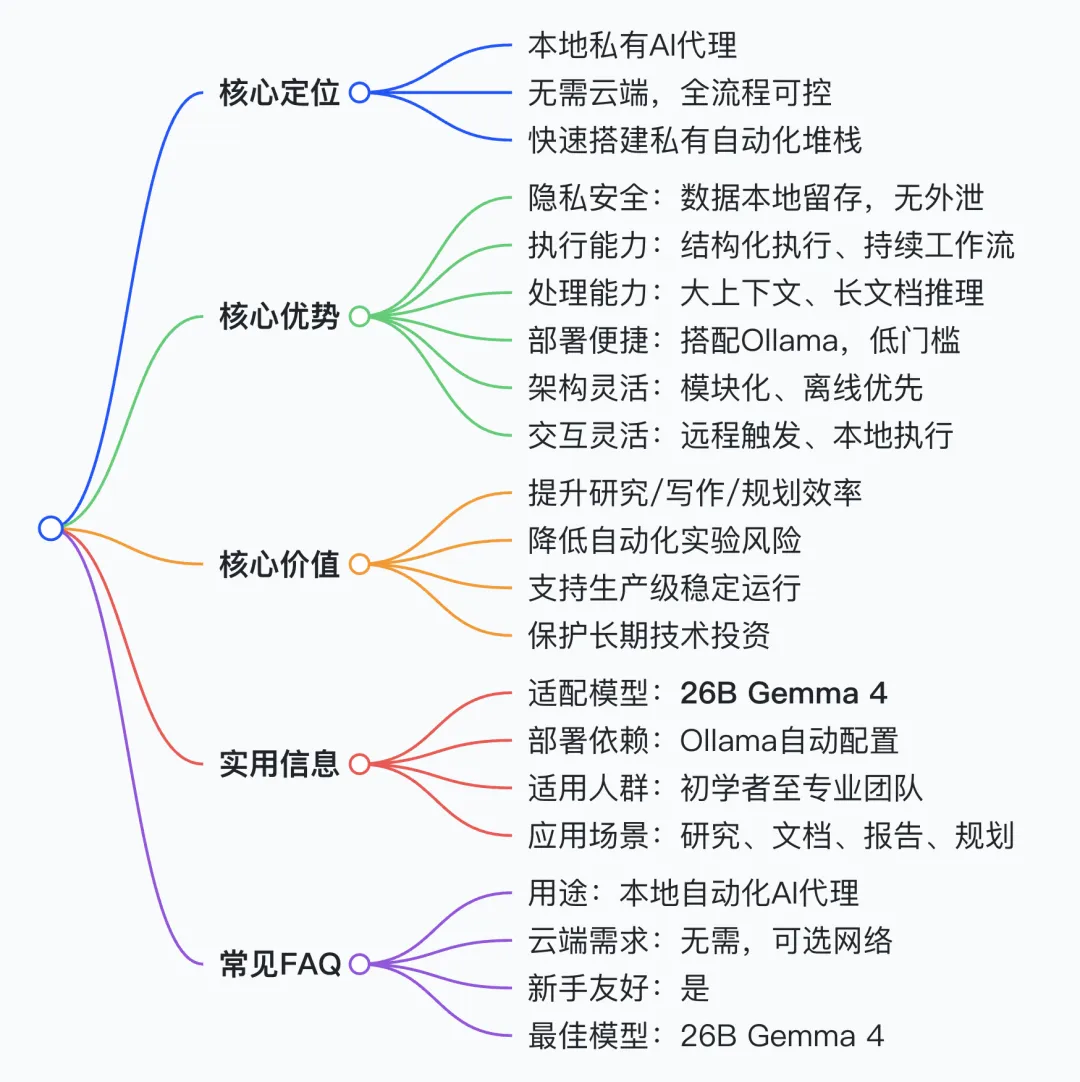

1. 产品核心定位

OpenClaw Gemma 4 是本地运行的私有 AI 智能体工具,核心是将 AI 从聊天机器人转变为执行引擎,实现全流程可控的私有自动化堆栈,彻底摆脱云端托管依赖。

2. 技术与能力

- 本地部署:

全程在用户设备运行,不向云端传输提示词与文档 - 模型支持:

搭载Gemma 4,26B 版本平衡推理性能与速度 - 功能特性:

原生支持代理工作流、私密网页搜索、长文档推理、模块化模型架构 - 部署方式:

搭配Ollama自动完成配置,降低技术门槛

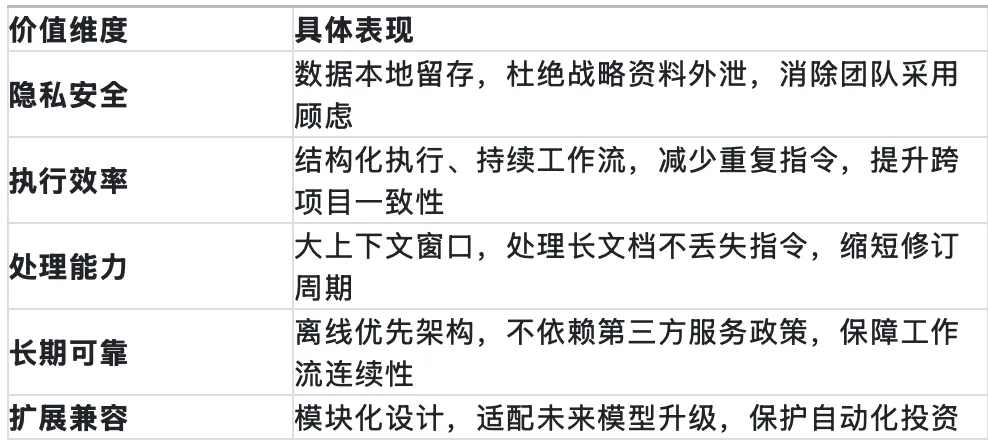

3. 价值亮点

4. 实际应用场景

-

研究流程:保持文档关联,提升规划准确性 -

文档工作流:跨会话输出一致,减少修订 -

报告流程:可重用指令,执行更可预测 -

规划环境:保障决策连续性,支持自动化实验

5. 产品总结

-

隐私转化为生产力优势,而非限制 -

降低本地自动化配置门槛,适合初学者 -

支持从实验阶段过渡到生产级执行系统 -

灵活触发与离线运行,适配分布式工作流

6.三个问题Q&A

-

Q1:OpenClaw Gemma 4 的核心安全优势是什么?

-

答:核心优势是完全本地运行,所有提示词、文档与工作流数据均保留在用户设备内,不通过云端服务商传输,从根本上避免战略资料外泄,消除团队采用自动化的隐私顾虑。

-

Q2:为什么 26B Gemma 4 是 OpenClaw 的最优适配模型?

-

答:26B Gemma 4在推理性能与响应速度之间实现最佳平衡,既能支撑复杂的长文档推理、结构化执行与自动化规划,又能在主流现代设备上流畅运行,兼顾效果与实用性。

-

Q3:OpenClaw Gemma 4 如何提升工作流自动化效率?

-

答:通过结构化执行实现任务序列自动规划,持续工作流避免每次提示后重置,可重用指令减少重复操作,大上下文处理长文档不丢失信息,最终提升研究、写作、规划等场景的执行效率与输出一致性。

夜雨聆风

夜雨聆风