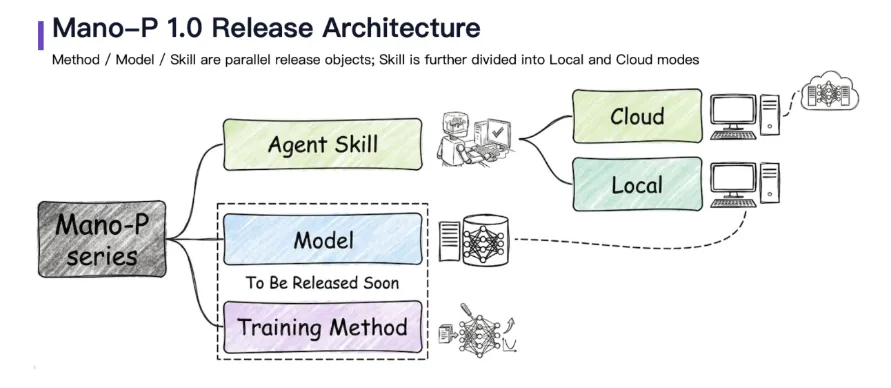

Mano-P 1.0:我第一次觉得,AI 真能把“点界面”这件事做明白了

这两年看了太多“让 AI 接管操作”的方案。

演示都挺顺。真落到复杂一点的桌面软件、老系统工具、乱七八糟的 App 上,就开始露怯。很多方案骨子里还是靠 DOM、控件树、系统 API 吃饭,页面一改版,按钮一挪位,识别就乱了。能跑浏览器,不代表真能碰 GUI。

我点进 Mano-P 1.0 看了下,第一反应是,这东西终于不绕了。

它走的是纯视觉路线。不给插件,不吃协议,也不预设你这是网页还是桌面端。就是直接看屏幕截图,然后决定下一步该点哪、该输什么、该切到哪。说白了,和人盯着屏幕操作的逻辑更像。

这一下,很多老问题就变味了。

以前最头疼的是维护。UI 一改,DOM 选择器废一片;系统层接口不统一,跨应用、跨平台全是坑。Mano-P 这种“所见即所得”的做法,至少把问题重新拉回到视觉理解本身。界面换皮、按钮换位置,它不是完全没成本,但确实没那么脆了。

我觉得它最值钱的,不只是能点。

而是能接进 Claude Code、OpenClaw 这类 Agent 工具里。接上之后,AI 不再只是会写脚本、调接口、读文本,它是真的能看见界面,也能把动作落下去。你让它跨网页、桌面软件、各类 App 连着做事,这条链路才算真正接起来。

还有一点很实在:它能扛复杂任务。

不是演示里点两下菜单栏就结束,而是支持数十步到上百步的连续操作。再加上全程本地推理,数据不出设备,这对很多对隐私和内网环境敏感的场景,吸引力会比“云端智能体”大得多。

部署门槛也没我想的那么高。

官方给的路子里,在 M4 芯片、32GB 内存的 Mac 上,4B 量化版就能直接跑。至少这不是那种“看起来很强,实际上你得先配一台工作站”的项目。

当然,纯视觉也不是万能药。遇到遮挡、弹窗打断、相似按钮误判,还是得看实际稳定性。

但至少 Mano-P 1.0 把方向走对了:AI 做界面操作,别再老想着读底层结构了,先把“看懂屏幕、动手执行”这件事做好。

GitHub地址:MININGLAMP-AI/MANO-P

夜雨聆风

夜雨聆风