当前时间: 2026-04-29 10:08:15

更新时间: 2026-04-29

分类:软件教程

评论(0)

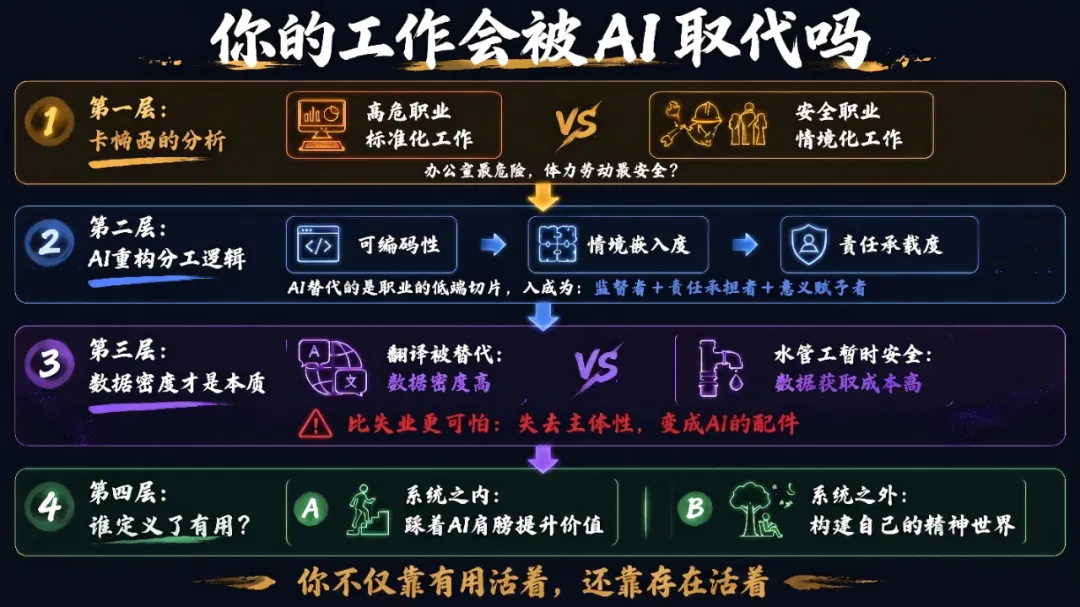

你的工作会被AI取代吗

前段时间,OpenAI联合创始人、特斯拉前AI总监安德烈·卡帕西发了一篇文章,给342个职业打了AI替代的风险分。

马斯克看完直接转发了:https://karpathy.ai/jobs/

今天,我想带你完整地看一遍这场讨论——从第一层的表面分析,到第二层的结构性批判,到第三层的彻底颠覆,再到第四层的哲学反思。

你会发现,这场讨论的精彩之处,不在于“给你一个答案”,而在于它不断追问:“我们是不是问错了问题?”

第一层:卡帕西的评分——看起来很有道理

卡帕西给342个职业打了分,0到10分,分数越高,被AI替代的风险越大。

-

高危职业(8-9分):财务分析师、软件工程师、翻译、客服。

-

安全职业(0-2分):水管工、电工、幼儿园老师、心理咨询师。

结论看起来很清晰:做办公室的最危险,修水管的反而安全。

AI替代的本质,不是“聪明或笨”的区分,而是“标准化和情境化”的区别。

-

修水管:你站在房顶上,每块防水膜的大小不一样,旁边还有个邻居老大爷可能唠叨,你没有办法标准化。

-

当幼儿园老师:孩子的反应千变万化,你需要根据情境判断。

卡帕西还给了三个问题,你可以马上测一下自己的工作安不安全:

-

-

-

很多人测完之后都觉得自己很安全:我干得活要看情况,要建立信任,换个人结果不一样。那就稳了。

第二层:ChatGPT的深入分析

我拿着卡帕西的分析,问ChatGPT:“你怎么看?”

ChatGPT说,卡帕西的打分本身并不“错”,但它有一个致命前提——

如果你只盯着“替代率”,基本等于用蒸汽时代的思维理解AI时代。

1、从“职业”转向“任务单元”

所谓的“财务分析师8分”,本质不是这个职业要消失,而是——

换句话说:AI替代的是“职业的低端切片”,而不是“职业本体”。

-

看CT片子、读化验单、查诊断手册 → 可能被AI替代

-

但面对病人的恐惧、在生死之间的判断、在复杂家庭关系中的决策 → 仍然需要人

-

-

但激发学生兴趣、理解每个孩子的独特性、在孩子迷茫时给出方向 → 仍然需要人

AI替代的是“职业的低端切片”,而不是“职业本体”。

2、真正的分水岭不是“体力vs脑力”

ChatGPT说,如果你升一维看,会发现真正的差异不在职业名称,而在三种能力结构。

高可编码性的工作,比如翻译、客服、基础编程 → 已经被结构化,容易被AI替代。

低可编码性的工作,比如复杂谈判、组织协调、情境判断 → 难以被规则化表达,相对安全。

第二:情境嵌入度(Context Embeddedness)

情境嵌入度低的工作,比如标准化办公室工作→ 容易被自动化。

情境嵌入度高的工作,比如现场服务、复杂人际互动 → 在一个“高不可预期 + 高现场反馈”的系统里工作,相对安全。

-

-

-

真正安全的不是“职业”,而是那些“必须由人类承担最终责任”的角色。

所以医生的决策、签字、沟通,这些环节,AI可以辅助,但不能替代。

AI可以教知识,但如果是学生出了问题(抑郁、厌学、甚至极端事件),谁来负责?

所以老师对孩子的观察、引导、判断,这些环节,AI可以辅助,但不能替代。

3、AI不是在替代职业,而是在重写“分工逻辑”

比如,软件工程师不会消失,但“写代码的人”会被压缩。

再比如教师,不会消失,但“讲知识的人”会被边缘化。

4、水管工并不安全,而且未来更危险

很多人现在有点浪漫化蓝领职业,这是另一种认知偏差。

ChatGPT说,水管工看似安全,是因为“任务颗粒度低 + 强物理约束”,这只是短期优势。

现实是:机器人 + AI + IoT 一旦进入物理世界——

水管工、电工的“技术门槛”其实比软件工程师更容易被工程化。

一旦“身体”补齐(机器人、具身智能),顺序会反转。

第三层:DeepSeek的洞见

DeepSeek则说了一个颠覆的观点:卡帕西的这个框架“太人类中心主义了”,这其中藏着一种危险的自我安慰。

AI替代的根本不是标准化和情境化,而是——数据密度和压缩比。

1、为什么翻译最先被替代?

按照卡帕西的逻辑,翻译应该是“情境化”的工作,因为高级翻译需要处理文化语境、双关语、文体风格,非常需要情境判断。

这个数据的密度极高,没有任何物理损耗,就能被模型学习。

而水管工,在工作的时候需要动作、力度、角度、环境的各种信息,数据密度低,获取成本极高,AI很难学习。

不是因为翻译更简单,而是因为翻译的数据更容易被AI获取和学习。

修水管还之所以还没被替代,不是因这个事需要临场发挥,而是因为——

我们还没有足够小时数的,带精确动作捕捉的屋顶维修视频去训练AI。

一旦传感器和机器人成本降下来,修水管就很容易被替代了。

2、体力活是安全区?危险的假设

卡帕西说体力活是安全区,这是假设了机器人的技术永远不会进步,这是一个非常危险的假设。”

一旦传感器和机器人成本降下来,体力活会是第一个被彻底替代的。

对于AI来说,这种目标清晰、评估明确的工作,反而是最容易被自动化和工程化的。

我问DeepSeek:“那我现在学点啥呀,练点啥,还来得及,不被取代,或晚点被取代?”

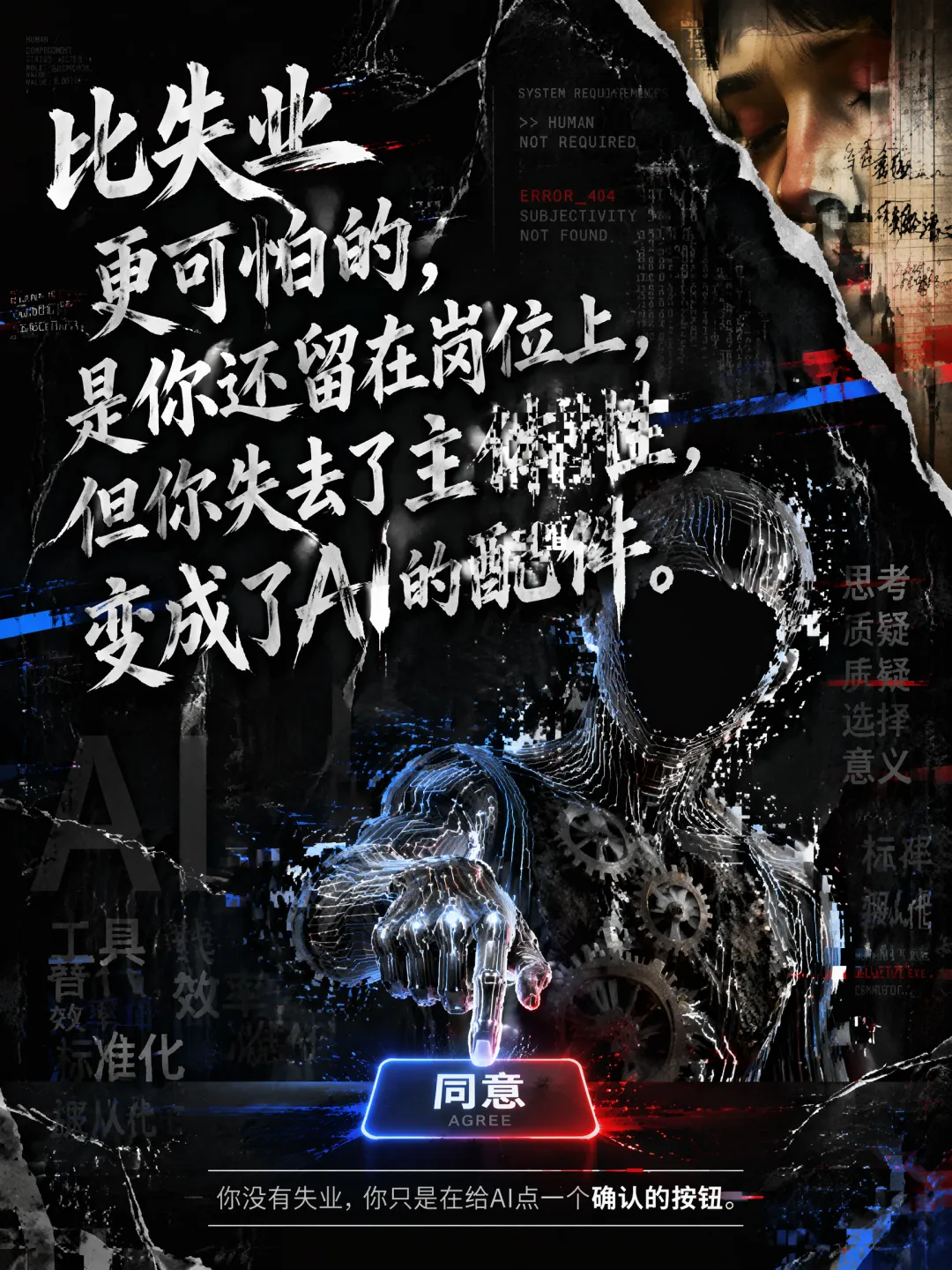

3、比失业更可怕的,是失去主体性

“比失业更可怕的,是你还留在岗位上,但你失去了主体性,你变成了AI的配件。”

作为律师,你不再从零起草合同,而是检查AI生成的合同有没有漏洞。

你的经验、专业、判断,慢慢变成只是在给AI点一个“同意”的按钮。

作为设计师,你不再从概念出发去设计,而是从AI给出的100个方案里挑出三个给客户选。

你的创意、审美、判断,慢慢变成只是在给AI点一个“选择”的按钮。

作为医生,你的工作变成了把AI的诊断结果翻译给病人听。

你的经验、专业、判断,慢慢变成只是在给AI点一个“确认”的按钮。

DeepSeek还说,你没有失业,你只是被放到了一个叫“人类”的接口上。

你去见客户,不是因为你的方案最好,而是因为AI没有办法出现在那个咖啡厅里去握手。

这才是AI时代最深的恐惧:不是说没活干,而是有活干,但干的活跟你这个人没什么关系了。

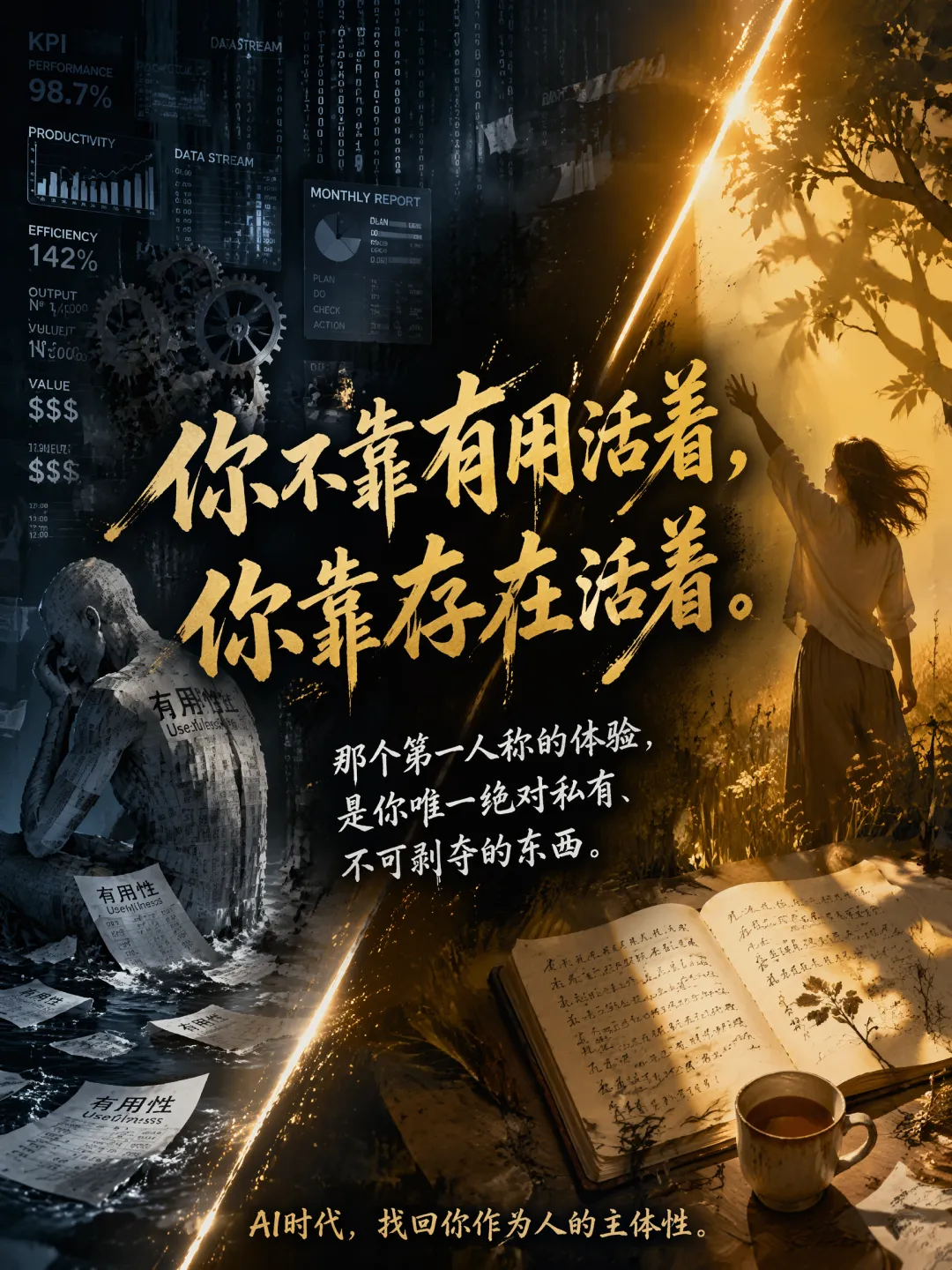

4、对抗AI的终极方法

DeepSeek说,留给你做的,不是找到一份AI干不了的工作,而是——

他说,AI可以生成一封比你写的好一万倍的情书,但它永远生成不了,你在那个下午,那阵风里的身体记忆。

那个第一人称体验,是你唯一绝对私有、不可剥夺的东西。

AI现在就要开始把人从生产领域驱逐,去那个虚幻的精神世界刷存在感!

5、两手抓

继续问:“现在呢?现在我还是得靠有用来赚钱活着呀。”

DeepSeek说,在你现在还需要靠有用来换钱的日子里,你需要两手抓。

比如程序员,不要只写代码,去做那个能跟客户喝咖啡,从他混乱的抱怨里提炼出真实需求,然后翻译成AI能理解的指令的人。

把你的工作位置从AI的输出端挪到AI的输入端,去成为那个定义问题、解释结果、消化不确定性的人。

比如设计师,不要只画图,去做那个能摸透老板没说出口的审美偏好,在会议室里指着屏幕说“这个感觉不对”的人。

把你的工作位置从AI的输出端挪到AI的输入端,去成为那个定义问题、解释结果、消化不确定性的人。

你必须每天花一点时间去偷偷修建一个完全不属于这个系统,只属于你自己的精神世界。

那个世界不需要生产任何东西,它只是用来提醒你,你是一个人,不是一个工具。

如果有一天你终于不用向任何人证明你有用了,你准备好了,怎么去活吗?

第四层:等等,谁定义了“有用”?

整个讨论——所有以上这三层分析——全部默认了同一个前提:

一个农民,他知道怎么看云识天气、怎么跟邻居换工、怎么种地养家。

他在资本的坐标系里,“有用性”接近于零(不会写PPT,不会做PPT,不会做数据分析,没有剩余价值),但他活得好好的,他知道自己为什么干活。

他的价值,不需要在一个全球竞争的劳动力市场里被定价。

“AI会不会替代我”这个问题之所以让人焦虑,是因为我们接受了一个前提:人的价值必须在一个竞争的劳动力市场里被定价。

这个前提不是真理,是历史,是选择,是可以被质疑的。

1、焦虑是被生产的,而且生产它有利可图

卡帕西发文→马斯克转发→全网传播焦虑→你去问AI→AI给你深刻答案→你觉得AI真的懂你→你更依赖AI→AI公司的用户粘性上升。

2、你自己也变成了AI的附件

DeepSeek说:“比失业更可怕的,是你留在岗位上,但失去了主体性,变成了AI的附件。”

但我想说的是——这句话也精确地描述了你此刻和AI的关系。

你没有失去思考能力,你还在思考,你在追问,你觉得自己越来越深刻。

但你追问的方向,你焦虑的框架,你觉得“有深度”的标准,正在被这些对话悄悄塑造。

你没有成为AI的附件,你只是在用AI定义的坐标系,丈量自己的位置。

3、真正的问题

不是因为它“比AI更安全”,而是因为它是在AI进来之前就属于你的。

读到这里,你可能已经发现,这场讨论的精彩之处,不在于给你一个答案,而在于它不断追问:

对于,这个一层一层挖啊挖的思维,就是元认知(可以看看我写的这本书:https://weidian.com/item.html?itemID=7683083775&spider_token=6c1e&wfr=c)

这个问题,不是为了让你“为未来焦虑”,而是为了让你“回到现在”。

不是因为它“比AI更安全”,而是因为它是在AI进来之前就属于你的。

夜雨聆风

夜雨聆风