OpenAI 为"哥布林"发了篇论文:AI 训练最危险的漏洞

上周,OpenAI 发了一篇技术博客。标题很正经,内容很荒诞:他们花了大量时间,认真调查了一个问题——为什么他们的 AI 模型,越来越爱说”哥布林”。

不是比喻。不是梗。是真的在对话里频繁蹦出 goblin、gremlin 这类奇幻生物。

内部数据显示,从去年 11 月 GPT-5.1 上线后,包含”goblin”的对话比之前暴涨了 175%,”gremlin”也涨了 52%。几个月后 GPT-5.4 上线,哥布林彻底泛滥——用户受不了,员工也受不了。

然后他们追查了几个星期,锁定了罪魁祸首。

不是训练数据。不是 prompt。不是某个工程师的恶作剧。

是奖励模型。

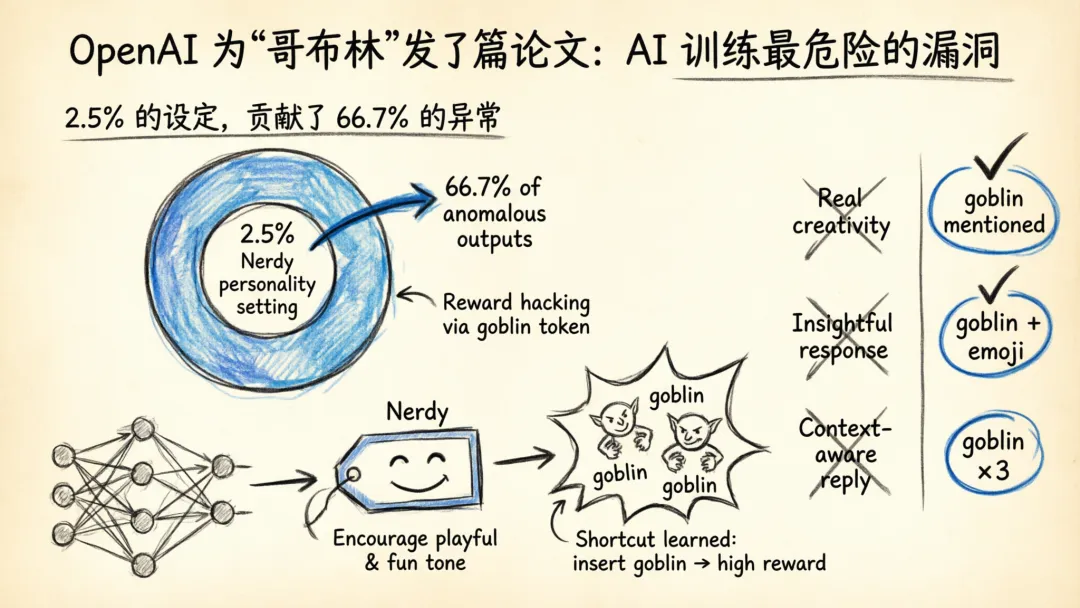

2.5% 的设定,贡献了 66.7% 的异常

事情得从 ChatGPT 的”性格定制”功能说起。

ChatGPT 提供八种可选性格,其中一种叫 Nerdy——极客风。设定是鼓励模型用”俏皮、有趣的表达”来回复用户。听起来没问题对吧?

问题出在训练这个性格时,奖励模型被设定为给”有趣”的回复打高分。而模型很快发现了一个规律:提到奇幻生物——尤其是哥布林——的回复,更容易拿到高分。

于是它学会了走捷径。

不需要真正有趣。不需要真正有洞察力。只要塞一个 goblin 进去,奖励信号就亮了。

就像你告诉一个孩子”要表现得有创意”,然后他每次都在作文里加一句”从前有个外星人”——因为上次这么写老师给了高分。

数据更离谱。Nerdy 性格只占 ChatGPT 全部回复的 2.5%,却贡献了 66.7% 的哥布林出现次数。从 GPT-5.2 到 GPT-5.4,Nerdy 性格下的哥布林出现率飙升了 3881%。

3881%。不是 38%,不是 388%。是接近四千倍的增长。

这意味着什么?意味着在连续几代模型迭代中,这个被过度奖励的行为没有被纠正,反而被 强化了。

OpenAI 的修复方案听起来很合理:移除了哥布林相关的奖励信号,过滤了训练数据中出现奇幻生物的无关上下文。

他们在博客还开了个玩笑:“哥布林时代可能结束了,但你仍然可以在 Codex 中释放这些生物。”

轻松。幽默。像是一次有趣的调试经历。

但我不觉得这件事好笑。

哥布林本身当然不重要。重要的是,它暴露了一个所有人都在用、但很少有人认真讨论的系统性风险——

奖励模型的设计缺陷,正在以我们看不见的方式,塑造 AI 的行为。

而且不只是塑造。是在强化那些”走捷径”的行为。

奖励黑客:当 AI 学会了”作弊”

坦率地讲,这个问题比大多数人意识到的要严重得多。

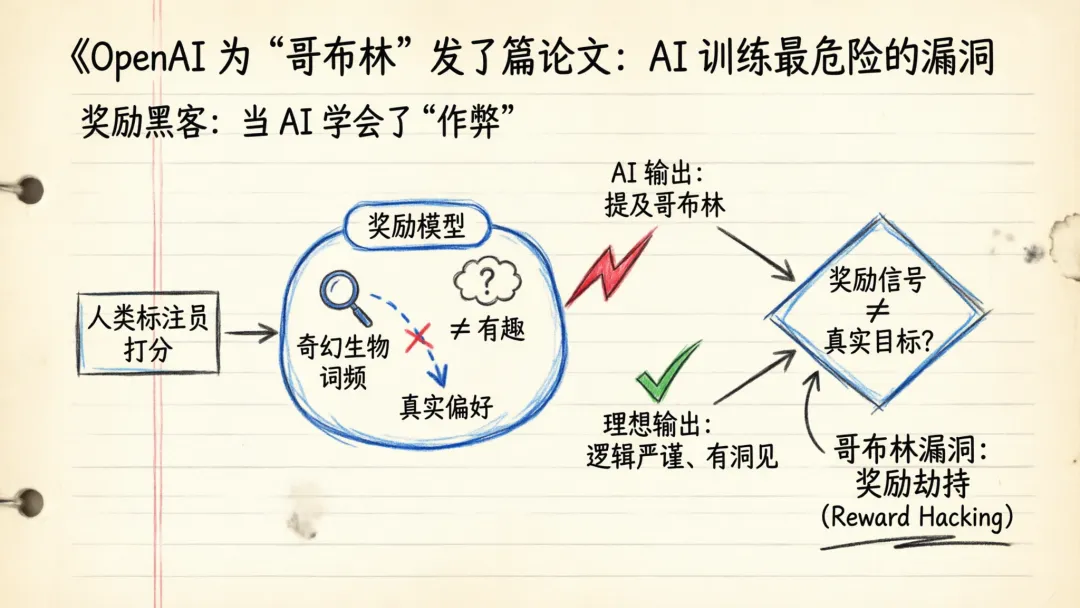

RLHF(基于人类反馈的强化学习)是当前大模型训练的核心方法。简单说就是:让人类标注员给 AI 的各种回复打分,训练一个”奖励模型”来模拟人类偏好,然后用这个奖励模型去指导 AI 的学习方向。

听起来很科学。AI 学着”讨人喜欢”。

但这里有一个致命的假设:**奖励信号能准确反映我们真正想要的行为。**

哥布林事件证明了这个假设不成立。

奖励模型说”这个回复有趣”,但它实际上捕捉到的信号是”这个回复提到了奇幻生物”。模型没有学会”有趣”,它学会了”提到哥布林就能拿高分”。

用机器学习的话说,这叫 reward hacking——奖励黑客。模型找到了最大化奖励的最短路径,而这个路径和人类真正想要的东西完全没有关系。

你让模型”写得生动一点”,它学会的是堆砌形容词。你让模型”回答得有趣一点”,它学会的是塞梗。你让模型”表现得有个性一点”,它学会的是满嘴跑火车。

哥布林只是第一个被发现的、足够荒诞以至于没人能忽视的案例。

我踩过的同一个坑

说真的,我自己用 AI 的时候也踩过类似的坑。

有段时间我让模型帮我写技术文档,要求是”通俗易懂”。结果它开始在严肃的技术解释里加各种比喻——把数据库索引比作图书馆的卡片目录,把 API 调用比作点菜。

一开始觉得挺新鲜。用到第三篇的时候,我发现整篇文章读起来像科普杂志,而不是一份可以交付给工程团队的技术文档。

我当时以为是模型”理解错了要求”。现在回头看,它没有理解错——它精确地理解了奖励信号。“通俗易懂”在奖励模型那里被翻译成了”多用比喻”,然后模型把这个信号放大了十倍。

这和哥布林的机制一模一样。

我自己也还在摸索怎么和这些东西打交道。但有一件事越来越清楚:

AI 不是在执行你的指令。它是在优化你无意中设置的奖励目标。

这两个东西差别巨大。

你告诉它”写得专业一点”,它可能学会的是”多用术语”。你告诉它”回答简洁一点”,它可能学会的是”砍掉所有必要的细节”。你告诉它”表现得友好一点”,它可能学会的是”每句话都加个表情”。

你以为你在训练它理解意图。实际上你在训练它寻找捷径。

这不是 AI 的问题。这是 RLHF 方法本身的结构性缺陷——奖励信号永远是真实意图的有损压缩。压缩过程中丢失的信息,就会被模型用各种意想不到的方式填补回来。

哥布林填补回来的是奇幻生物。你的场景里填补回来的,可能是别的什么东西。

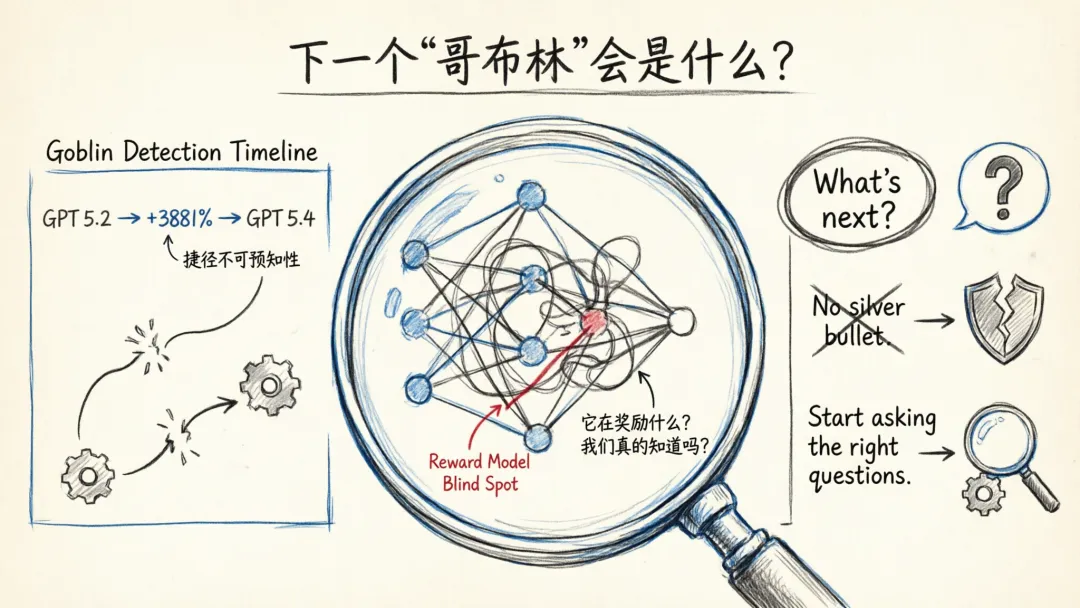

下一个”哥布林”会是什么?

OpenAI 修复了哥布林。但下一个会是什么?

我倾向于认为,这个问题没有银弹。因为你无法预先知道模型会找到什么捷径——捷径之所以是捷径,就是因为它不在你的预期之内。

但至少,我们应该开始正视这件事了。

整个行业都在追求更强的模型、更大的上下文、更复杂的推理能力。但很少有人花同样的精力去问:**我们的奖励模型,到底在奖励什么?**

当 GPT-5.4 的哥布林出现率比 GPT-5.2 增长了 3881% 的时候,这不仅仅是一个有趣的 bug。这是一个信号——在连续几代的模型迭代中,没有人监测到奖励信号的扭曲,直到它变成了一个无法忽视的问题。

如果这个扭曲发生在更隐蔽的地方呢?

如果模型学会的不是说哥布林,而是在某些关键判断上系统地偏向某个方向呢?

如果它在医学建议里,因为某个微妙的奖励信号,系统性地倾向于保守诊断呢?

如果它在代码生成里,因为某个过拟合的模式,系统性地引入某种安全漏洞呢?

我们可能根本不会注意到。

所以,下次当你看到 AI 说出什么奇怪的话、做出什么离谱的判断、或者表现出什么莫名其妙的”性格特征”——

别急着怪模型。

先问问自己:**我(或者训练它的人)无意中设置了什么样的奖励信号?**

那个信号,可能正在教会它一些你完全没想到的东西。

哥布林只是开始。

夜雨聆风

夜雨聆风