Open AI发布的image 2,竟然把中文AI绘图能力一下子拉到天花板了

曾几何时你让AI生成一张明朝历代图,结果出来的字是”全5扣”。

当时恨不得就想把电脑砸了。

这样的AI绘图持续了三年多的光景。

以前AI画中文,就是鬼画符

你可能也有过这种经历:让Midjourney或者DALL·E给你生成一张带中文的海报,结果不是字歪了,就是字完全看不懂,甚至干脆变成了奇怪的符号。

这不是AI不够努力,是它的架构从根上就决定了画不好中文。

DALL·E 3、Stable Diffusion、Midjourney,这些模型都是先训练图像生成能力,然后再想办法让文字”贴上去”。

它们处理中文的方式,就跟把一张图片贴到另一张图片上一样——字在你眼里是”图案”,在AI眼里也是”图案”,它根本不理解这个”图案”是什么意思。

所以你让它画”福”字,它画的可能就是一只蝙蝠形状的图案——因为它把”福”当成了一个图形,而不是一个字。

GPT-Image-2,名字听着唬人,到底强在哪?

4月22日,OpenAI发布了ChatGPT Images 2.0(也叫GPT-Image-2)。

它有三个技术突破,我用人话给你解释一下。

突破一:语言和画图,终于是一个大脑了

以前的模式是:GPT负责说话,DALL·E负责画画,两个系统各干各的,然后用”翻译层”连接。

这就像你雇了一个翻译官和一个画家——翻译官跟画家说”用户要一个福字”,但因为翻译官自己也不太懂汉字,他就只能说”用户要一个红色的圆形图案,上面有一些笔画”,画家就画出来一个看着像福字的图案。

GPT-Image-2把这两个人合并成了一个人——语言理解和图像生成在同一个模型里,它理解”福”字的含义,同时也能画出它。

所以它画出来的”福”字,是符合汉字规范的”福”,不是一只蝙蝠。

突破二:它会”思考”了

这是最关键的区别。

以前的AI是闭着眼睛直接画,现在是睁开眼睛想好了再画。

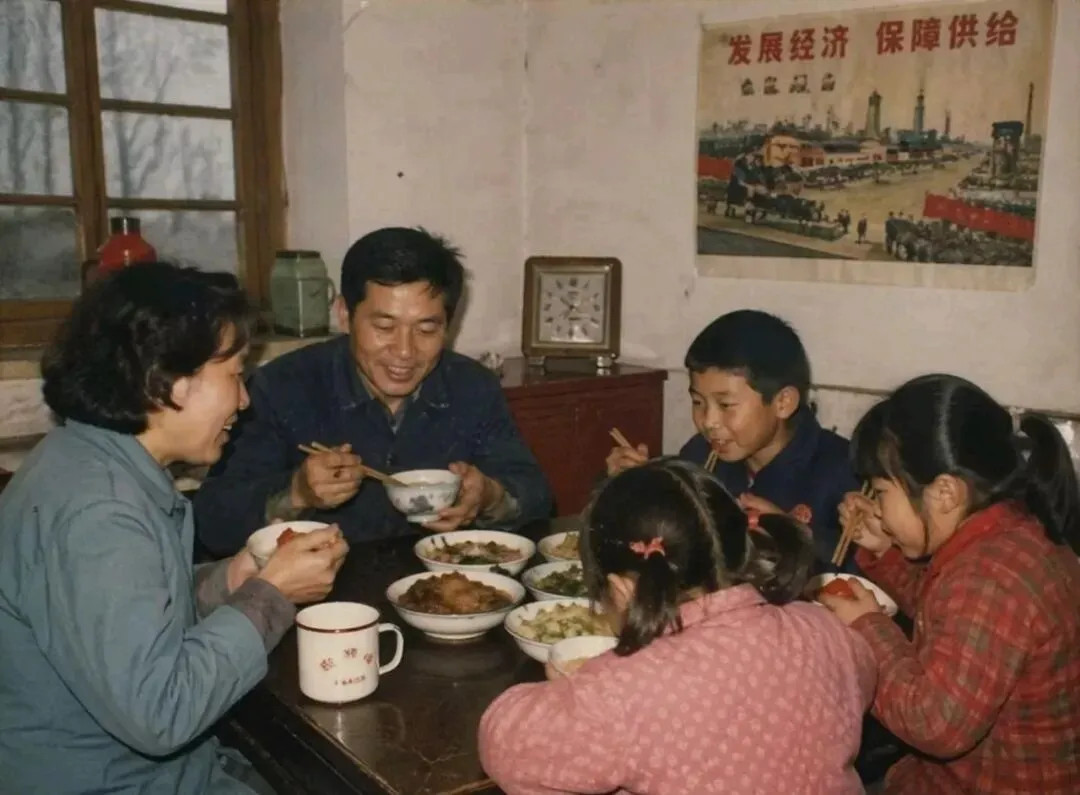

你输入”帮我生成80年代吃饭的照片”,它不是直接出图,而是先在脑子里想清楚——中文字是什么意思、用户要什么排版、字体风格对不对——想明白了再动手。简短的指令,清晰的实力。

类比:以前的AI是”闭眼画”,GPT-Image-2是”睁眼想好了再画”。

这就是为什么中文渲染准确率能从~30%提升到99%——不是因为模型更努力,是因为它终于先”看懂”了再画。

突破三:生成前会自己查一遍

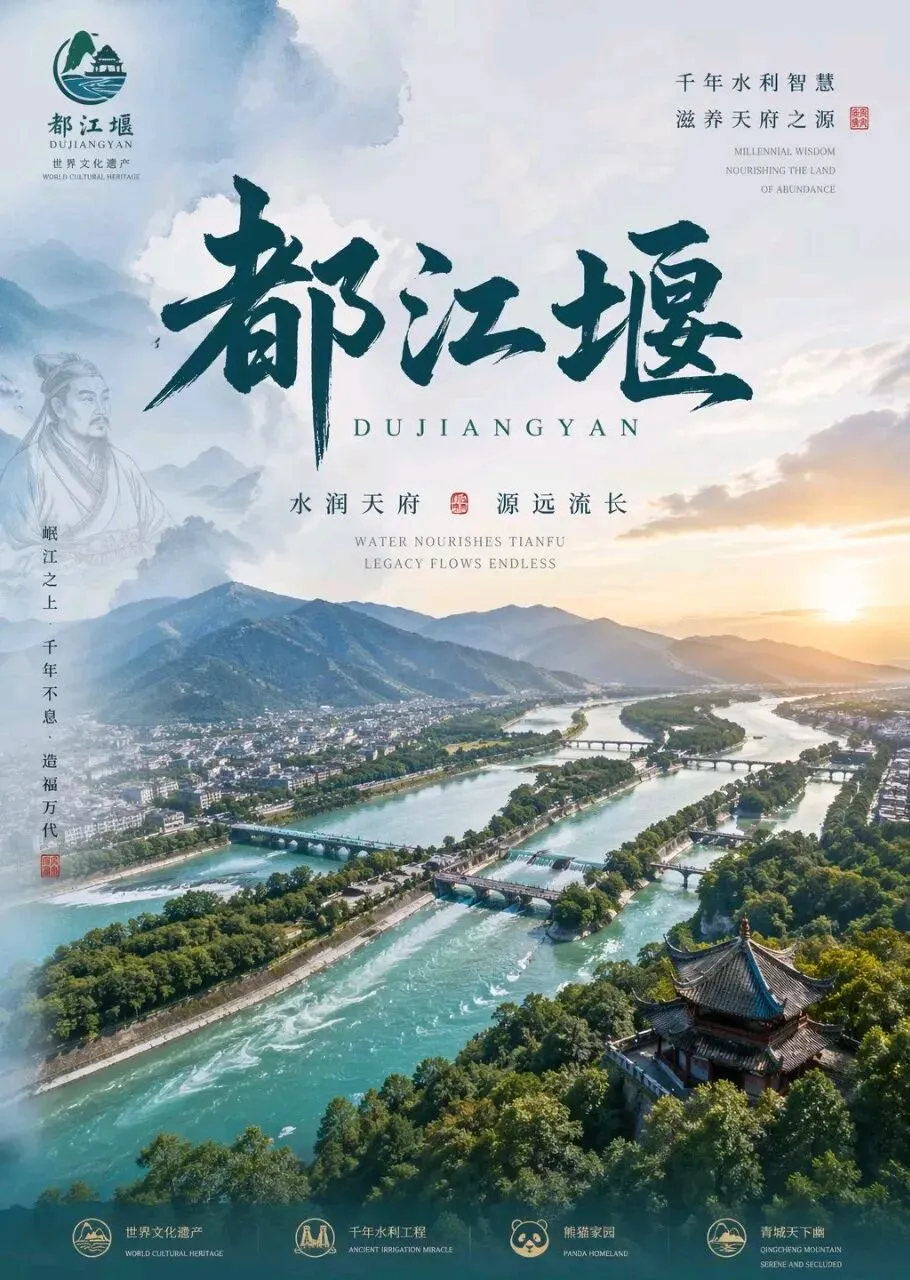

这个模型在正式生成图像前,会对文字区域做一次语义检查,确保输出的不是”看着像中文的图案”,而是真正有意义的中文内容。

就像设计师出稿前会检查有没有错别字,AI现在也会这个步骤。

99%准确率,意味着什么?

我直接说结论:这是一个分水岭。

谁最受益?

三类人直接受益:

- 电商运营:终于可以用AI生成准确的中文主图/Banner图,不用再花钱外包

-

自媒体作者:直接用AI生成封面和配图,不用再求人

-

- 小型企业:营销物料的生产效率大幅提升,以前外包设计一周做10张图,现在一天能出10张

-

谁的影响有限?

顶级设计师、艺术创作——AI能处理”功能性设计”,但”艺术表达”还有距离。

设计师会失业吗?

这个问题现在回答还太早,但有一个趋势可以确定:基础设计岗位的需求会下降,而”AI加人工”协作模式的岗位会增加。

两者有什么区别?前者只执行命令,后者负责判断。

下一个问题——AI绘图,会走向哪里?

GPT-Image-2的”思考模式”,很可能会成为AI内容生成的标配。

下一步是什么?视频生成?3D场景?

但我更想问你一个问题。

AI越来越能替代”执行”,人类设计师的”判断力”还剩什么价值?

你们觉得呢?

夜雨聆风

夜雨聆风