"世界模型"成为AI最新热点

你有没有想过一个问题,为什么ChatGPT能写诗、能写代码、能跟你聊天,但它却搞不清楚”把杯子推下桌子会发生什么”?

它能生成一千字的推理,却模拟不出一个皮球落地后的弹跳轨迹。

这事儿有点反常识。一个能通过律师资格考试的AI,居然不懂基本的物理常识。

这背后藏着一个更深层的问题,也是过去一年AI领域最热门的方向之一——”世界模型”(World Models)。

我们要说的,是2026年4月Nature发表的一篇专题报道 [1],讨论的正是这个话题:为什么世界模型被认为是通往通用人工智能(AGI)的关键路径,以及它和现在的大语言模型有什么本质区别。

Nature这篇报道的标题很直接——”世界模型”是AI最新的热点,它们是什么,能做什么?

这不是一篇技术论文,而是一篇面向研究者的科普。它把一个正在发生的趋势讲清楚了:大语言模型遇到了瓶颈,而世界模型可能是下一个突破口。

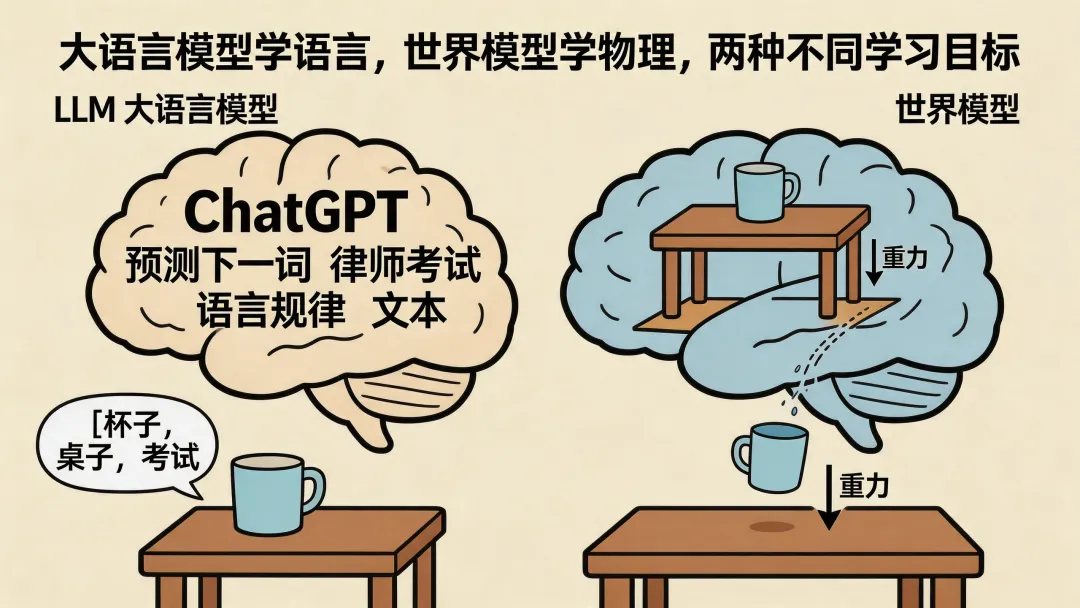

在此之前,你先要知道一个核心判断:大语言模型学的是”语言规律”,世界模型学的是”物理规律”。这是两种完全不同的学习目标。

01 / 什么是世界模型?

关于”世界模型”的定义,学界目前还没有完全统一的说法。

最宽泛的理解是,任何用真实世界数据训练出来的神经网络,都多少包含了某种”世界模型”——它在内部构建了对世界的一种表征。

但过去两年,研究者们开始把这个词用在一个更具体的东西上:

一个能生成连续的、可探索的、可交互的虚拟世界的AI系统。

什么意思?

你想想电子游戏。当你玩《塞尔达》的时候,你走到悬崖边,角色会掉下去。你推一块石头,它会沿着山坡滚下去。这个游戏世界里有一套稳定的物理规则在运行。

世界模型想做的事情,就是让AI学会这种”物理规则”——不是靠程序员写代码,而是通过观察真实世界的视频和数据,自己”悟”出来。

Nature的报道里举了一个例子:如果你在一个世界模型里把一个物体从桌子上推下去,这个物体会掉到地上。这不是因为系统里有”重力”这个预设参数,而是AI从成千上万小时的真实世界视频中学到了”东西掉下去”这个规律。

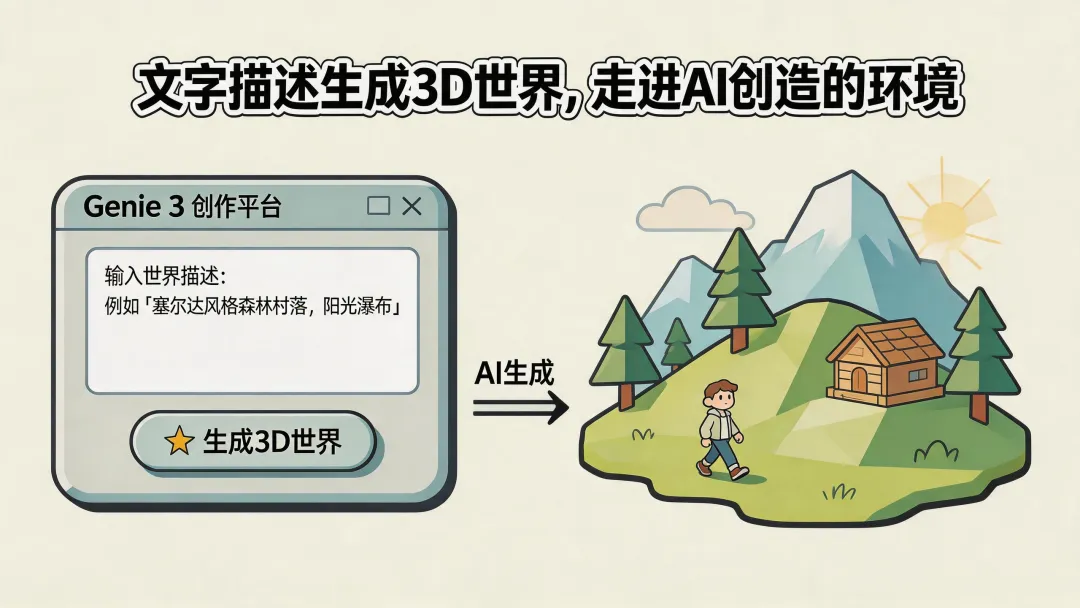

Google DeepMind在2025年8月发布的Genie 3就是这样一个系统。你输入一段文字描述,它能生成一个照片级真实感的3D环境,你可以像玩游戏一样在里面实时探索。

这跟ChatGPT生成一张图片是两回事。ChatGPT给你的是一张静态图,而Genie 3给你的是一个可以”走进去”的世界。

02 / 为什么大语言模型不够用?

过去三年,大语言模型(LLM)几乎统治了AI的公众视野。ChatGPT、Claude、Gemini,本质上都是LLM。

它们的原理很简单:预测下一个词。

你给它一段话,它根据统计规律猜接下来最可能是什么词。这个机制非常强大,强大到能通过律师考试、能写代码、能进行复杂的推理。

但这个机制有一个根本性的弱点:

它学到的是”语言里的规律”,而不是”世界里的规律”。

Nature报道里举了一个很直白的例子:一个基于LLM的系统,可能无法正确预测”汽车冲出悬崖会发生什么”。

这不只是”没见过”的问题,而是”学习目标不同”的问题。

LLM的学习目标是最小化语言预测误差。它在训练时看的是海量文本,而不是真实世界的物理过程。它能学到”悬崖”这个词在文学作品中通常意味着什么情绪,但学不到”车冲出悬崖”之后的物理后果。

这正是为什么自动驾驶、机器人这些领域,不能只靠LLM。

你需要的是一种能理解物理世界的AI——它知道推一下杯子,杯子会倒;知道踩油门,车会加速;知道在冰面上刹车,距离会更长。这些不是语言规律,是物理规律。

03 / 谁在做世界模型?

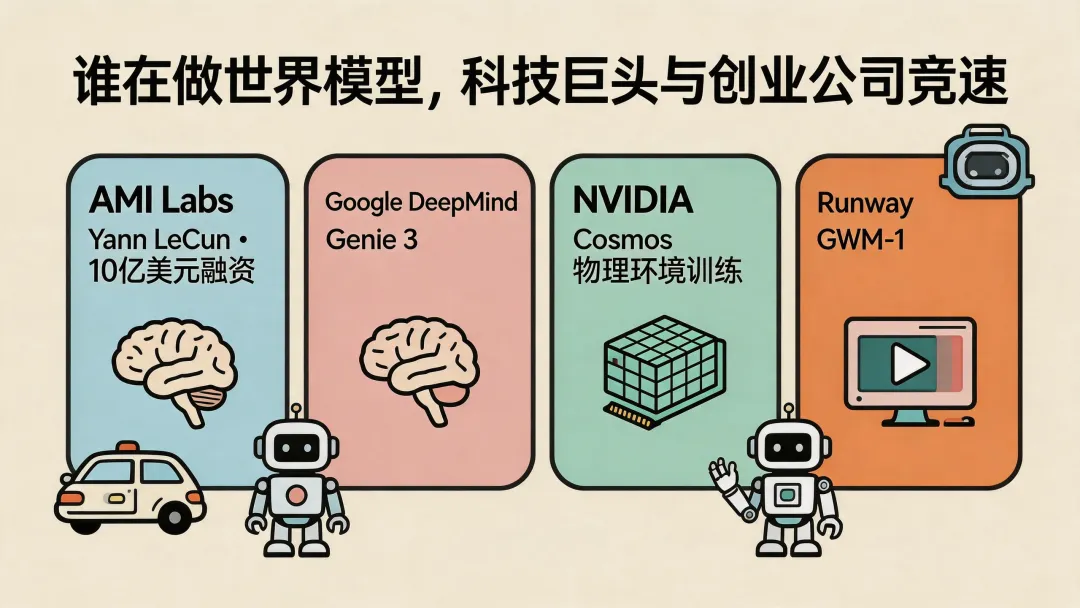

这个领域正在吸引巨大的资金和关注。

Nature报道提到,AI先驱、图灵奖得主Yann LeCun创立的公司AMI Labs,已经筹集了超过10亿美元——这是欧洲公司历史上最大规模的首轮融资。

LeCun是世界模型最坚定的倡导者之一。他认为,要实现真正的智能,AI必须能构建对世界的内部模型,而不仅仅是学习统计相关性。

Google和Nvidia也在布局这个领域。Nvidia的Cosmos项目正在用物理环境数据训练世界模型。Google DeepMind除了Genie 3,还在开发更通用的世界建模系统。

创业公司也在涌入。Runway在2025年12月发布了GWM-1。Runway的联合创始人Anastasis Germanois说,世界模型可以成为训练机器人AI的安全环境,而且比让机器人在真实世界里学习快得多。

为什么快?

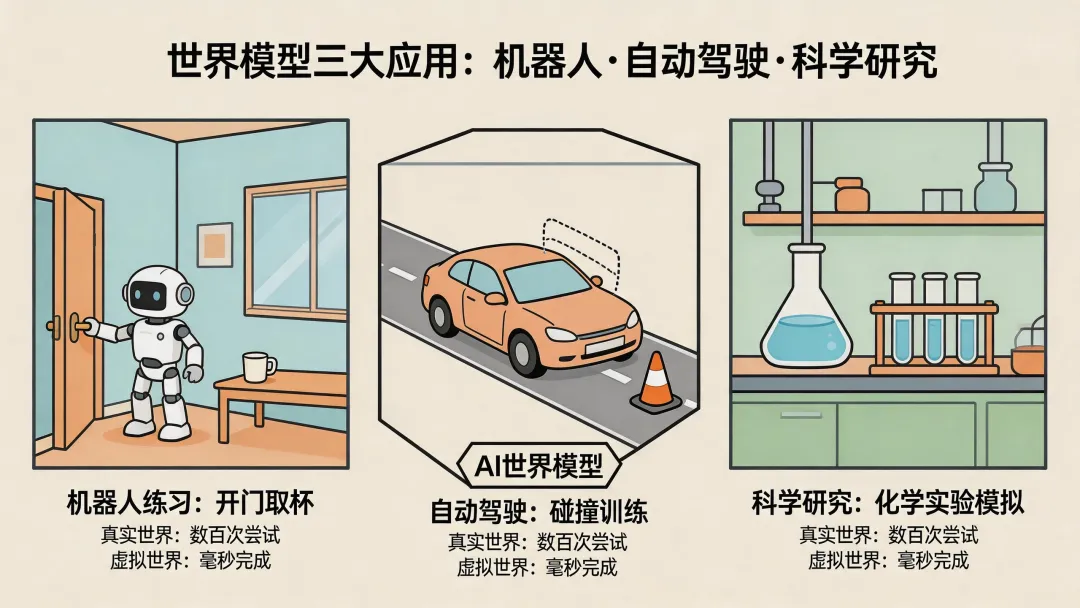

因为真实世界太慢了。一个机器人要学”开门”这个动作,可能需要几百次尝试,每次尝试都要几秒钟。但如果在一个世界模型里模拟,这些尝试可以在几毫秒内完成。

这不只是效率问题,更是成本和安全问题。你不能让自动驾驶汽车在真实道路上撞一万次来学习”碰撞”意味着什么。你需要在虚拟世界里让AI学会这个道理。

04 / 世界模型能做什么?

加拿大英属哥伦比亚大学的计算机科学家Jeff Clune在Nature报道里说了一句很关键的话:

“更令人兴奋的世界模型,是那种你可以采取行动的。”

什么意思?

如果你只能在一个虚拟世界里”看”,那它更像一个高级的视频游戏。但如果你能在里面”做事”——推东西、走动、操作工具——那它就成了一个真正的训练场。

这对于机器人研究尤其重要。

现在的机器人面临一个大问题:数据太少。

大语言模型可以用整个互联网的文本训练,数据几乎是无限的。但机器人的训练数据从哪来?你不可能在网上下载几百万个小时的”机器人做家务”视频,因为这种视频根本不存在。

世界模型提供了一个解决方案:在虚拟世界里生成无限的训练场景。

你可以在世界模型里让机器人”虚拟地”练习开门、拿杯子、擦桌子。练习一百万次之后,再把学到的能力迁移到真实机器人身上。

这是自动驾驶公司已经在用的方法。特斯拉、Waymo都在用虚拟环境训练自动驾驶系统——虚拟环境就是某种形式的”世界模型”。

Nature报道还提到一个潜在应用:科学研究。如果一个世界模型足够准确地模拟了物理规律,科学家可以用它来加速实验。你可以在虚拟世界里”做”化学实验、物理实验,筛选出最有希望的方向,再在真实实验室里验证。

我的评论

坦率的讲,我读到这个概念的时候,第一反应是——这不就是物理引擎吗?游戏行业用了几十年了。

但仔细想下去,区别很大。

传统物理引擎是”人写规则”——程序员告诉系统:重力加速度是9.8,摩擦系数是0.3。系统按照这些规则运行。

世界模型是”AI学规则”——没人告诉它什么是重力,它通过看视频、看数据,自己悟出来”东西会往下掉”。

这看起来像是同一个东西,但本质完全不同。一个是”被人编程”,一个是”自己学习”。

这也解释了为什么世界模型被认为和AGI有关。真正的通用智能,应该是能自己理解世界、自己总结规律,而不是等着人把规则喂给它。

但我也有一个担忧。

现在对世界模型的关注,很大程度上是被”LLM瓶颈”驱动的——大家发现大语言模型不够用了,开始找下一个方向。但世界模型本身是不是真的能解决这个问题,还是又一个”看起来很有希望”的技术泡沫?

Nature报道里引用的专家都很乐观,但学术圈的乐观我见得太多了。2020年有人说LLM会通向AGI,2023年有人说具身智能是答案,现在是世界模型。

我更关心的是:这个技术什么时候能从实验室走进真实应用?

对于普通人来说,世界模型意味着什么?可能是更聪明的机器人助手,可能是更安全的自动驾驶,也可能是更真实的游戏世界。

但也可能,它只是一个更复杂的技术名词,在几年后被另一个新词取代。

由此得到

大语言模型学语言规律,世界模型学物理规律,这是两种不同的学习目标。

世界模型的本质是让AI从数据中自己”悟”出物理规则,而不是靠人编程。

机器人、自动驾驶、科学研究,是世界模型最直接的应用场景。

[1] Nature, “‘World models’ are AI’s latest sensation: what are they and what can they do?”, April 2026

读完这篇,你对AI的理解已经比99%的人更深了一层。把这篇文章转发给你觉得同样聪明的人。

扫码关注「远的学习圈」,每天一篇认知升级。

夜雨聆风

夜雨聆风