OpenClaw �� NVIDIA 悄悄上新了四个国产大模型,内置插件还没跟上,我教你直接手搓配置白嫖.

事情是这样的,前天我刷 build.nvidia.com,发现 NVIDIA 上又悄悄上了几个新模型。

不是那种小更新,是正儿八经的大版本升级。

Kimi K2.5 升到了 K2.6,MiniMax M2.5 升到了 M2.7,GLM5 升到了 GLM5.1,还有一个 DeepSeek V4 Pro,1.6万亿参数,1M上下文,光看参数就让我心痒。

更骚的是,它们全免费。

但是打开 OpenClaw 一看,内置的 NVIDIA 插件还停留在老版本,K2.5、M2.5、GLM5,新模型一个都没挂上。

这事儿我熟,上个月刚扒过 NVIDIA 插件的源码,知道它的模型目录是写死在 openclaw.plugin.json 里的静态列表。开发者当时写进去哪些模型,就一直用哪些模型。NVIDIA 后来上新模型了,插件不会自动跟着更新。

那怎么办,等官方更新插件?不知道猴年马月。

不等了,自己动手,手搓自定义 provider 配置。

整个过程 5 分钟搞定,今天就带你也搞一遍。

先搞个 API Key

打开浏览器,访问 build.nvidia.com。

注册一个账号(用邮箱就行,我是用QQ邮箱注册的),登录之后,点右上角的头像,找到 API Keys。

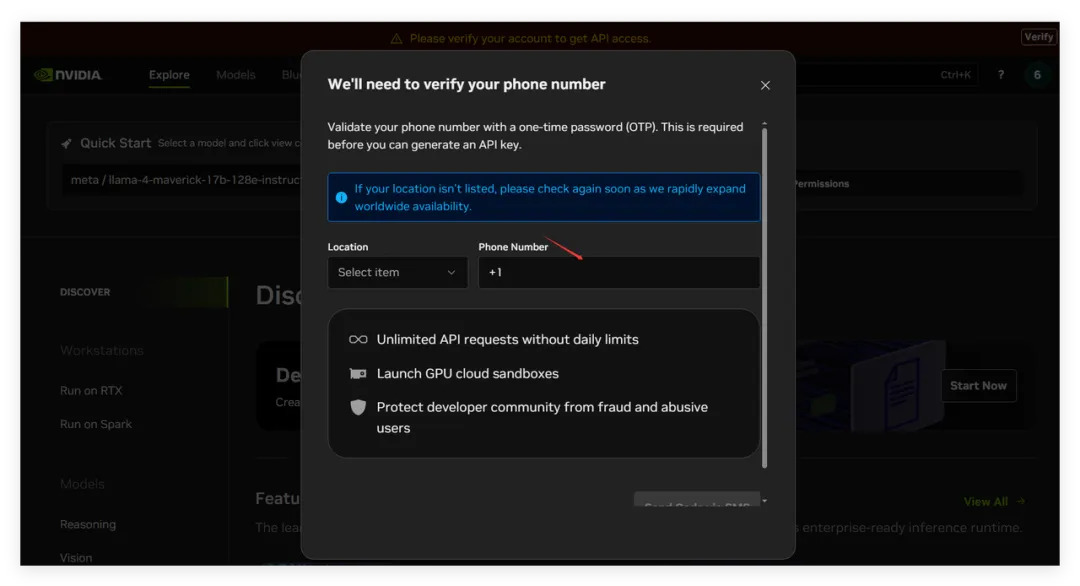

有一点要注意的是,创建 Key之前需要手机号验证。

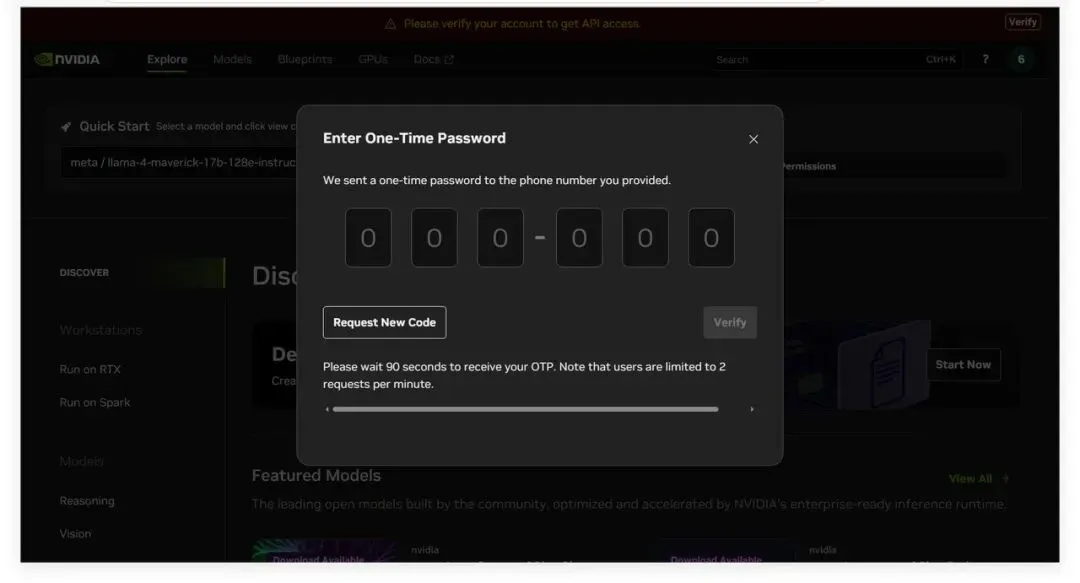

输入收到的验证码。

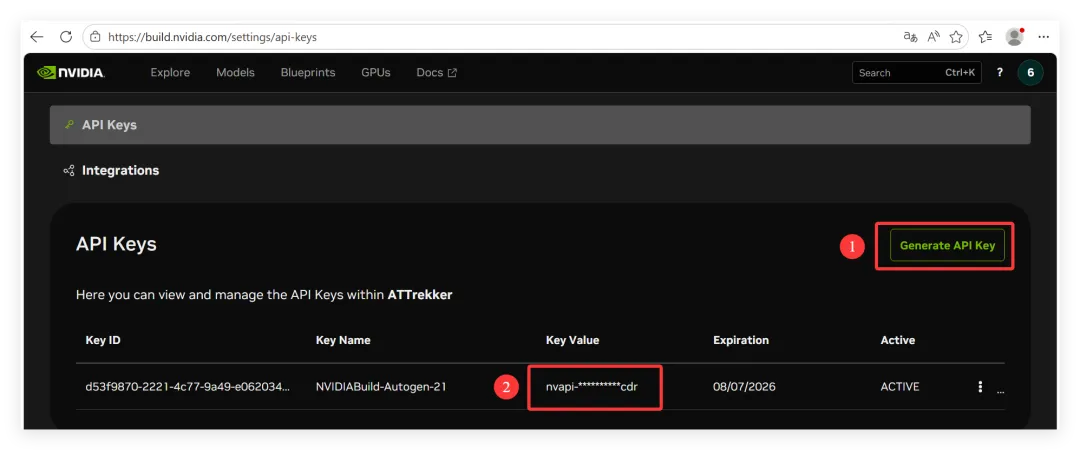

点「Create API Key」,系统会生成一串类似 nvapi-xxxxx 的 key。

把这段 key 复制下来保存好,它只显示一次,关掉页面就看不到了。

先看看这四个新模型到底什么来头

坦率的讲,四个全都是国产一线大模型的旗舰版,一个比一个能打。

Kimi K2.6,月之暗面的最新力作。1万亿总参数,32B激活参数,MoE 架构。跟 K2.5 比,最大的变化是升级成了多模态模型,不再是纯文本了,能理解图片和视频。而且 agent 能力大幅增强,官方说能调度 300 个子代理执行 4000 步协调任务。我寻思了一下我没寻思明白,300 个代理同时干活是什么场面,但听起来就很猛。

MiniMax M2.7,230B 参数,专攻编程、推理、办公自动化。M2.7 的特别之处在于它号称「深度参与自身进化」,支持 Agent Teams 模式,多个模型角色组队干活。说真的,这个 Agent Teams 概念还挺有意思,有点像在模型内部搞了个小型项目组。不过实测下来,我最直观的感受是它的中文写作能力比 M2.5 丝滑了不少,AI 味明显降低了。

GLM 5.1,智谱出品。GLM 5.1 的定位很明确,Agentic Engineering,专门面向代理工程场景。官网描述写着「能持续优化数百轮推理和数千次工具调用」,这在做复杂软件工程任务的时候特别有用。跟 GLM5 相比,代码能力提升是最大的卖点。我试了一下它写 Python 脚本,确实是那种能一口气把思路顺下来的感觉,不需要来回改。

DeepSeek V4 Pro,压轴的来了。1.6万亿总参数,49B激活参数,1M token 上下文。用的是一种叫 CSA 和 HCA 的混合注意力机制,单 token 推理算力只有 V3.2 的 27%,又猛又省。1M 上下文能干啥,意味着你可以把一整本《三体》丢进去让它帮你分析剧情。我实际用它写了几天公众号文章,负责任的说,这是目前 NVIDIA 免费模型里中文写作最自然的一个,AI 味极低,像是真人在跟你聊天。

四个模型,各有绝活,而且全部免费。

为什么内置插件指望不上

前面提了一嘴,内置 NVIDIA 插件的模型目录是静态的。

具体来说,你去看 OpenClaw 安装目录下的 extensions/nvidia/openclaw.plugin.json,里面有个 modelCatalog.providers.nvidia.models 数组,清清楚楚写着四个模型,Nemotron 3 Super 120B、Kimi K2.5、MiniMax M2.5、GLM5。

就这四个,不多不少。

而且更关键的是,OpenClaw 内置 NVIDIA 插件的模型发现方式是 discovery, "static",不是 dynamic 也不是 api,就是纯静态。启动的时候从 JSON 里读出列表,然后就不管了。

NVIDIA API 上有 160 多个模型,但插件只认这四个。你哪怕在 build.nvidia.com 上看到了新模型,内置插件也完全不知道它们的存在。

说实话这也怪不了 OpenClaw。内置插件的模型列表需要开发者手动维护,人家不可能 24 小时盯着 NVIDIA 上新。但这带来的问题就是,想用新模型,必须自己动手。

好消息是,自己动手一点都不难。

手搓自定义 provider,三分钟搞定

思路很简单,绕过内置的 NVIDIA 插件,自己在配置文件里定义一个自定义 provider,直接走 NVIDIA 的 API 端点。

先打开环境变量文件,位置一般在~/.openclaw/.env,加上这一段。

# 英伟达NVIDIA_API_KEY= 你的key然后再打开 OpenClaw 的配置文件,位置一般在~/.openclaw/jsonopenclaw.json,加上以下这些。

{"env":{"shellEnv":{"enabled":true}},"models":{"mode":"merge","providers":{"nvidia":{"baseUrl":"https://integrate.api.nvidia.com/v1","apiKey":"${NVIDIA_API_KEY}","api":"openai-completions","models":[{"id":"z-ai/glm-5.1","name":"英伟达GLM-5.1","reasoning":false,"input":["text"],"cost":{"input":0,"output":0,"cacheRead":0,"cacheWrite":0},"contextWindow":202752,"maxTokens":8194},{"id":"moonshotai/kimi-k2.6","name":"英伟达Kimi K2.6","reasoning":false,"input":["text","image"],"cost":{"input":0,"output":0,"cacheRead":0,"cacheWrite":0},"contextWindow":262144,"maxTokens":262166},{"id":"minimaxai/minimax-m2.7","name":"英伟达Minimax-m2.7","reasoning":false,"input":["text"],"cost":{"input":0,"output":0,"cacheRead":0,"cacheWrite":0},"contextWindow":204800,"maxTokens":8192},{"id":"deepseek-ai/deepseek-v4-pro","name":"英伟达DeepSeek-v4-pro","reasoning":false,"input":["text"],"cost":{"input":0,"output":0,"cacheRead":0,"cacheWrite":0},"contextWindow":1048576,"maxTokens":16384}]}}},}几个要点要特别注意。

baseUrl 一定是 https://integrate.api.nvidia.com/v1,这是 NVIDIA 的统一 API 端点,所有模型共用这个地址。不要拼成某一个具体模型的地址。

api 写 openai-completions,因为 NVIDIA 的接口跟 OpenAI 的 Chat Completions 协议完全兼容,OpenClaw 会按 OpenAI 的格式发请求。写错了就调不通。

apiKey 是你的 NVIDIA API 密钥,格式是 nvapi- 开头的一长串。

模型 ID 的格式是 provider名称/组织名/模型名。NVIDIA API 里完整 ID 的格式是 nvidia-custom/组织/模型。

四个模型的正确 ID 如下。

-

• Kimi K2.6, nvidia/moonshotai/kimi-k2.6 -

• MiniMax M2.7, nvidia/minimaxai/minimax-m2.7 -

• GLM 5.1, nvidia/z-ai/glm-5.1 -

• DeepSeek V4 Pro, nvidia/deepseek-ai/deepseek-v4-pro

注意,组织名和模型名都是小写的,中间用斜杠分隔。Kimi 的组织是 moonshotai 而不是 moonshot,DeepSeek 的组织是 deepseek-ai 不是 deepseek。这些细节写错了就找不到模型,OpenClaw 会直接报模型不存在的错,我踩过这个坑的。

自定义 provider 建好之后,接下来是把四个模型挂上去。

还是在 OpenClaw 的配置文件,增加以下几行。

"agents":{"defaults":{"model":{"primary":"nvidia/deepseek-ai/deepseek-v4-pro",//设置默认模型"fallbacks":["nvidia/z-ai/glm-5.1","nvidia/moonshotai/kimi-k2.6","nvidia/minimaxai/minimax-m2.7"]},"models":{"nvidia/z-ai/glm-5.1":{},"nvidia/moonshotai/kimi-k2.6":{},"nvidia/minimaxai/minimax-m2.7":{},"nvidia/deepseek-ai/deepseek-v4-pro":{}}}},选一个设为默认模型。

我个人把 DeepSeek V4 Pro 设成了默认,中文写作确实香。

四个模型实测,我的选模建议

前面说了一堆参数,那实际用起来到底哪个好?

我拿这四个模型分别生成了同一篇公众号文章的开头段落,同一段 prompt,看看效果。

坦率的讲,Kimi K2.6 的中文能力一如既往的强,语言流畅度高,而且作为多模态模型,未来如果 OpenClaw 支持图片输入了,它的优势会更明显。写代码方面也很能打,Rust、Go、Python 全面覆盖。

MiniMax M2.7 给我的感受是进步很大,尤其是 AI 味的降低非常明显。M2.5 时代那种「首先、其次、最后」的机器感基本被干掉了,读起来更像真人写的东西。编程和办公场景是它的舒适区。

GLM 5.1 是四个里面 agent 能力最强的。如果你在 OpenClaw 里经常做一些多轮推理、长链路任务,比如先搜索资料再整合再写文章,GLM 5.1 的表现会比其他几个更稳定。代码生成长度也超过 GLM5,能在上下文中完成更大规模的代码重构。

DeepSeek V4 Pro,我的主力选择。1M 上下文是硬通货,丢一整篇文章进去分析、丢一大段源码进去排错,不用担心中间忘了。中文写作风格最自然,AI 味极低。而且 1.6万亿参数摆在那,处理复杂逻辑的时候底气足。

一句话总结,日常聊天写作用 DeepSeek V4 Pro,多模态任务用 Kimi K2.6,编程办公用 MiniMax M2.7,复杂 agent 链路用 GLM 5.1。四个轮着用,全免费,爽得飞起。

你可能遇到的两个坑

第一个,模型响应慢。NVIDIA 免费 API 不是无限的,高峰期可能会有排队。如果你发现某个模型老是超时,别调大全局超时,给这个 provider 单独加个 timeoutSeconds 就行。

"models":{"mode":"merge","providers":{"nvidia":{"baseUrl":"https://integrate.api.nvidia.com/v1","apiKey":"${NVIDIA_API_KEY}","api":"openai-completions","timeoutSeconds":300,//增加这个300 秒基本够了,再大的模型也等得起。

第二个坑,模型 ID 写错了。OpenClaw 报「Model not found」的时候,别慌,检查一下 provider 名称、组织名、模型名这三个部分是不是都写对了。NVIDIA API 对大小写敏感,全用小写就没错。

还有一个温馨提醒,NVIDIA 的免费 API 有速率限制,。正常聊天写作绰绰有余,但别拿它跑批量任务,会被限流的。我之前一次连发了 50 条请求测模型响应速度,直接被暂时限制了半个小时。

白嫖党的终极春天

说真的,NVIDIA 这波操作让我有点感动。

四个顶级国产大模型,全部免费,API 兼容 OpenAI 格式不用额外适配,你只需要一个免费的 NVIDIA 账号。

而且这四个模型还在持续更新,Kimi 从 2.5 到 2.6,MiniMax 从 2.5 到 2.7,GLM 从 5 到 5.1。按照这个速度,下半年大概率还有新版本。

内置插件跟不上没关系,自定义 provider 一条配置搞定,新出来的模型想用就加。

我现在已经彻底不纠结模型选购了,四个轮着用,哪个顺手用哪个。钱包没瘦一毛钱,体验拉满。

真的,试试吧,白嫖不丢人。

我已收集了OpenClaw的资料并已打好包,关注后发消息:小龙虾获取。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧~

谢谢你看我的文章,我们,下次再见。

文章内容基于OpenClaw版本2026.5.5。

我的Openclaw教程

夜雨聆风

夜雨聆风