OpenClaw 2026.5.9-beta.1 终于知道自己叫什么了

看完 OpenClaw v2026.5.9-beta.1 的更新日志,三条记录让我停下来多看了几秒。

不是什么轰动的大功能。但三件事放在一起,能感觉到有人在认真填一些长期存在的坑——包括一个我以前没意识到是坑的地方。

挑三个出来说一说。

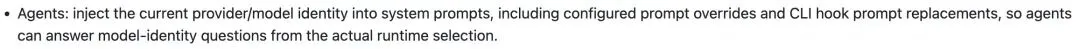

01 | AI 终于知道自己叫什么了

先说最让我意外的那个。

如果你用过 OpenClaw 的 Agent 功能,有没有问过它一句:“你现在用的是哪个模型?”

大概率它会答不上来,或者给你一个不准确的答案。

原因很简单:之前 Agent 的系统提示里,压根没有”当前使用什么模型”这个信息。模型是谁,是 OpenClaw 在调用时决定的,但 Agent 运行的时候对这件事一无所知。

这次的更新写得很直接:

“Agents: inject the current provider/model identity into system prompts, including configured prompt overrides and CLI hook prompt replacements, so agents can answer model-identity questions from the actual runtime selection.”

翻译一下:现在 OpenClaw 会把你实际在用的模型身份,自动注入进 Agent 的系统提示里。不管你在配置文件里写的是什么、是否有 prompt 覆盖,Agent 都能知道自己当下跑在哪个模型上。

这个改动表面看很小,但影响比较实际。

很多人搭了多个 Profile,不同任务切不同的配置——有时用 Claude,有时切 Gemini,有时走本地模型。Agent 之前不知道自己是谁,等于在一个没有镜子的房间里工作。现在它能看到镜子了。

更实际的好处是:如果你的工作流里有需要” Agent 根据自身能力决策”的环节(比如:这个任务超出你的 context 限制了吗?你支持视觉输入吗?),现在它至少知道自己是谁,可以做出更准确的判断。

02 | 个人微信进了 OpenClaw 官方目录

国内用 AI 工具有一件事大家心里都清楚:很多工具对国内渠道的支持是事后加的,能用就行,不太维护。

这次更新里有一行:

“Plugins/catalog: add an @tencent-weixin/openclaw-weixin external entry pinned to 2.4.1 so onboarding and openclaw channels add can install the Tencent Weixin (personal WeChat) channel by default.”

意思是:腾讯微信个人号的 OpenClaw 插件,现在被钉进了官方的插件目录,版本锁在 2.4.1,用 openclaw channels add 命令可以直接装。

这件事的意义不在于”多了一个渠道”,而在于它进了官方目录这件事本身。

之前如果你要在 OpenClaw 上接个人微信,要自己去找插件、手动装、碰运气看版本兼容不兼容。进了目录之后,安装流程变成标准路径,出了问题也有地方追。

对国内用户来说,这条更新是最直接的一个。微信个人号的场景太多了:自动回复、信息过滤、聊天记录整理、朋友圈监控……都可以接进来跑。

当然,个人微信的接入需要额外的配置(扫码授权、微信 Web 协议限制等),这块还是需要自己折腾一下。但至少起跑线变平了。

03 | Discord 实时语音,现在有三种模式

Discord 的语音功能这次改动比较多,但核心就一件事:新增了三种语音频道运行模式,并把 Agent Proxy 设为默认。

日志里写得比较技术,我来拆解一下三种模式分别是什么意思。

第一种:STT/TTS 模式(原来就有的那种)

你说话 → 转成文字 → Agent 处理 → 文字转回语音 → 你听到。最经典的流程,延迟相对高,但最稳定。

第二种:Agent Proxy 模式(本次设为默认)

语音频道变成了 OpenClaw Agent 的”麦克风和扬声器”延伸。你在语音频道说话,背后实际是路由给配置好的 Agent 在处理;Agent 回复,再转成语音播出来。

说白了:Discord 语音 = 接了一个 AI 助手进频道,但背后的大脑还是你配置的那个 OpenClaw Agent,记忆、工具、系统提示全都保留。

第三种:Realtime Bidi 模式(新东西)

这个是真正的双向实时语音,接的是 OpenAI 的 Realtime API(也支持 Google Live)。延迟最低,更像真人对话,但目前还在测试阶段,且需要支持 Realtime API 的模型。

日志里还提到一个细节:

“allow OpenAI realtime Discord sessions to disable input-triggered response interruption for echo-heavy rooms while keeping explicit Discord barge-in available”

翻译:如果你的麦克风回音重(比如没戴耳机),可以关掉”声音触发打断”,避免 AI 把自己播出去的声音当成你在说话、然后不断打断自己。小细节,但真实的使用场景里很容易碰到。

三种模式可以按需切换,不是非此即彼的关系。一般用户直接用默认的 Agent Proxy 就够了,延迟低、能力全;想要更丝滑的对话感就试 Realtime Bidi。

还有几件顺带一提的事

这个版本里还有几条更新,单独成篇不够,但知道了有用:

- /think default 和 /fast default 指令:新增了这两个 chat 命令,可以把当前 session 覆盖的思考模式重置回系统默认,不用重启 session 了。

- CLI 错误信息全面升级:以前遇到配置错误、启动失败,报错信息经常让人摸不着头脑;这次做了一轮”每个失败都要解释清楚并告诉你下一步”的改造。

- GitHub Copilot 实时拉模型目录:Copilot 用户的可用模型现在从账号动态拉取,gpt-5.5 也出现在了 fallback 静态目录里。

- Amazon Bedrock 新增 serviceTier 参数:可以配 default/flex/priority/reserved,企业用 Bedrock 的人可能用得到。

总体看,这个 beta 版本的改动很碎,没有一个”主角功能”。但碎中有几件值得记住的事:Agent 开始知道自己是谁了,国内微信渠道走了正轨,语音交互有了更完整的选项。

对普通用户来说,装了直接用,不会有什么破坏性变化。对想深入配置的人,这几个点值得花时间去试一试。

你目前用 OpenClaw 的哪个功能最多?评论区聊聊,看看大家的用法有没有我没想到的角度。

⭐点赞、转发、关注和推荐一键三连⭐

夜雨聆风

夜雨聆风