专栏引言:从「会说话」到「会动手」

2023 年以来,大语言模型让 AI 学会了「说话」——能理解、能推理、能生成。但 AI 与物理世界的交互,很多时候仍停留在“建议”层面:它可以告诉你怎么修水龙头,却无法亲手拧动扳手。

当我们真正把大模型接到机器人上,会很快遇到一组“现实摩擦”:

机器人型号与协议高度异构:ROS/厂商 SDK/串口/CAN…… 同一个能力(比如“导航”“抓取”)在不同机器人上输入输出差别巨大 视觉/控制/状态同步/并发访问一来,脚本很快失控 机器人一旦动起来,安全机制必须前置,否则 Demo 很难走向可用系统

OpenClaw 的价值就在这里:它把“能力”以 Skill/Tool 的方式暴露给 Agent,让 AI 能用自然语言或工作流去调用工具、编排流程,并进一步驱动物理世界。

在进入我们社区的三个项目之前,先把近一个月(2026/02/10—2026/03/11)OpenClaw + Robot 生态最重要的进展做一次条例清晰的汇总,帮助大家先建立“这条赛道最近在发生什么”的共同背景。

近一个月 OpenClaw + Robot 重要进展汇总(2026/02/10—2026/03/11)

一、OpenClaw 主项目:迭代加速,插件化与“可用性工程”显著增强

项目地址:https://github.com/openclaw/openclaw官网:https://openclaw.ai

根据公开报道,OpenClaw GitHub Star 已突破 250,000,成为增速极快的开源项目之一(来源:AInvest 报道)。Source:https://www.ainvest.com/news/openclaw-github-star-count-surpasses-250-000-ai-agent-boom-2603/

近一个月三次版本更新要点:

版本 | 日期 | 核心更新 |

v2026.3.8 | 2026-03-09 | CLI 备份工具 openclaw backup create/verify;Talk 模式静音超时配置;TUI 自动推断活动 Agent;Brave 搜索 LLM 上下文模式 |

v2026.3.7 | 2026-03-08 | ContextEngine 插件接口(完整生命周期钩子);ACP 持久化频道绑定(Discord/Telegram);Control UI 增加西班牙语;Perplexity 切换至 Search API |

v2026.3.2 | 2026-03-03 | 原生 PDF 分析工具;SecretRef 全面凭据支持;MiniMax-M2.5-highspeed 模型支持;子 Agent 内联附件支持 |

Source:https://github.com/openclaw/openclaw/releases

这类更新看起来“偏平台”,但对机器人方向其实很关键:插件生命周期钩子、更强的凭据管理、备份/恢复、原生 PDF 工具与附件能力,都会直接影响到“工作流是否可复现、是否可部署、是否可长期维护”。

二、OpenClaw × Robot:ROS 2 机器人控制实践成为标志性案例

博客详解:https://moesani.com/blog/openclaw-is-now-controlling-my-robot/

近一个月内最受关注的融合案例之一,是开发者 Moe Sani 将 OpenClaw 接入 Waveshare UGV 小车 + Jetson Orin Nano(ROS 2 Humble),实现更接近“Agent 自主决策驱动机器人”的完整链路。

他展示的三类核心能力很典型:

硬件控制(via ROS 2):Agent 直接向 /openclaw/cmd_vel(驱动)、/openclaw/gimbal(云台)、/openclaw/lights(灯光)发布指令,并通过 /openclaw/capture 服务触发拍照,将高层意图桥接到 ROS 2 话题/服务 视觉理解:从 /image_raw 抓取图像,结合 Gemini CLI 图像分析工具让 Agent 理解“前方是否有障碍”“目标在画面哪里” 语音播报(TTS):Agent 可通过 TTS 工具实时播报状态,让机器人“会说话”

关键意义在于:它不是“脚本让机器人动一下”,而是更接近——Agent 理解高层目标后能自主分解任务并执行,并在环境偏离预期时尝试自适应,而不是直接崩溃。

三、Picoclaw(sipeed/picoclaw):把 Agent 推到 10 美元级硬件,边缘落地显著加速

项目地址:https://github.com/sipeed/picoclaw

Picoclaw 是 Sipeed(矽速科技)基于 Go 语言重构的超轻量 Agent,目标是让 AI Agent 跑在 <10MB RAM 的设备上(“10 美元硬件跑 Agent”的象征意义非常强,对机器人/嵌入式尤其友好)。

典型硬件部署场景:

硬件 | 价格 | 典型用途 |

LicheeRV-Nano | ¥69(~$9.9) | 嵌入式智能家居助手 |

NanoKVM | $30–50 | 自动化服务器运维 Agent |

MaixCAM | ~$50 | 智能视觉监控 + AI 推理 |

近一个月里程碑:

2026-02-09 正式发布(“1 天内构建完成”的传播点很强) 2026-02-13 4 天突破 5,000 Stars,开始规划 Roadmap 2026-02-16 1 周突破 12,000 Stars,开始招募社区维护者 2026-03-11 仍持续活跃开发(提交记录持续更新)

Source:https://github.com/sipeed/picoclaw

近期 commits 亮点:

日期 | 更新内容 |

2026-03-11 | Agent 管理 UI + Launcher 集成;MCP 初始化修复;安全加固(未认证工具执行路径) |

2026-03-10 | Docker Launcher 三合一镜像;JSONL 会话持久化;Web 搜索 API Key 负载均衡 + 故障转移 |

2026-03-10 | Telegram Forum Topic 会话隔离修复;版本信息注入 context |

这一条主线的启发是:当 Agent 能跑在极低成本的边缘设备上,“把大脑装到机器人身上”就不再是高成本实验室专属,家庭机器人、教学平台、低成本移动底盘都会更容易普及。

生态入口与研究方向

OpenClaw-RL:https://github.com/Gen-Verse/OpenClaw-RL(用对话训练 RL Agent 的探索) 社区技能集:https://github.com/mergisi/awesome-openclaw-agents(技能/工具的聚合入口)

从“近一个月进展”看清赛道共识:6 条工程主线正在收敛

把上面的进展放到一起看,会发现生态正在同时推进两件事:

主项目迭代加速:插件接口、凭据、备份、原生工具等“平台工程”变强 Robot/边缘硬件落地:ROS2 控制闭环与超轻量边缘 Agent 同时推进

而要让“AI 进入物理世界”从演示变成可复用系统,近期更成熟的项目普遍会落到这 6 条工程主线上(也正是我们后面三个项目会覆盖的重点):

能力语义统一:底盘/机械臂/夹爪/相机等能力抽象成稳定接口 Skill/Tool 规范化:命名、Schema、错误返回、配置注入统一,便于工作流编排与复用 服务化与并发访问:控制与视频流拆分为服务,支持多端调用与状态同步 多模态闭环:感知—执行—再感知验证,支持纠错与自证 安全机制前置:急停、限幅、超时停车、控制权仲裁成为标配 可演示可复制:一键启动 + 可视化控制台 + 可读日志,降低复现门槛

趋势很明确:这条赛道在变成熟。但与此同时,一个缺口也越来越清晰:语义、Skill 规范、以及具体机器人“身体实现”往往散落在不同项目里。能跑的 Demo 很多,但“换机器人也能复用、换场景也能扩展”的通用拼图仍然稀缺。

我们在做的事情:把 OpenClaw + Robot 拼成“可复用的开源方案”

在 Xbotics 社区,我们正在做一件事:

把「OpenClaw + Robot」做成一套可复用的开源方案:让任何机器人都能听懂人话,让任何 AI 都能动手创造世界。

我们的策略是把这件事拆成三块拼图,并尽量做到“可复用、可替换、可扩展”:

连接层:统一语义 + Skill 封装规范(Robot OpenClaw Bridge) 身体层(专业级):机械臂控制 + 视觉流服务化(lerobot_so100_system) 身体层(家用级):轻量模块化、开箱即玩(HomeBot)

下面是第一期我们已经跑通的三个项目。

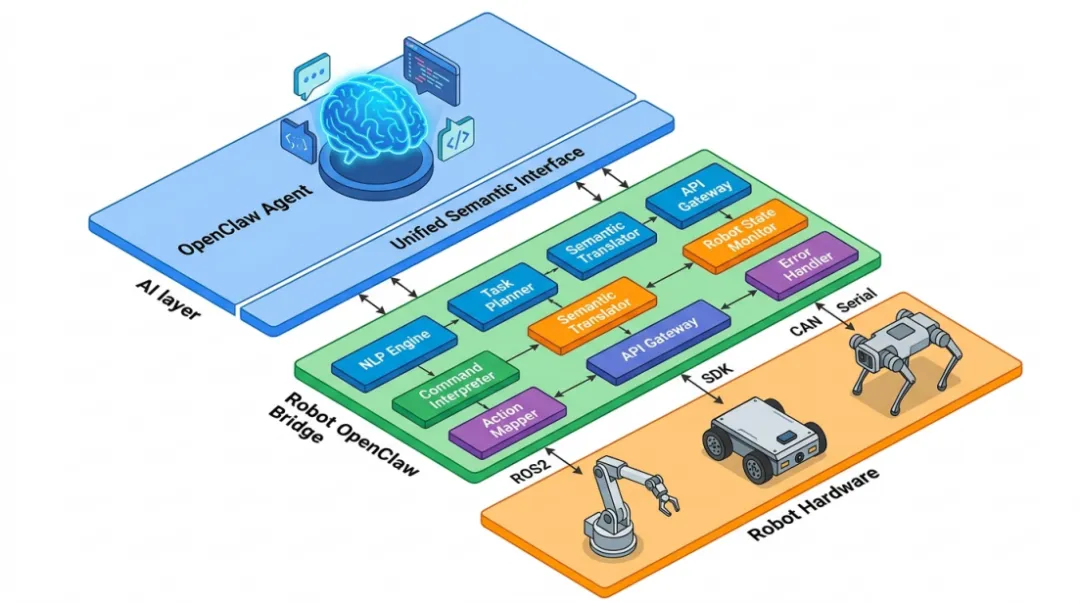

项目一:Robot OpenClaw Bridge —— 让任何机器人都能被 OpenClaw 调用

定位:连接层(能力语义统一 + Skill 封装规范)开发者:xBotics 社区核心团队项目地址:内部修改中,下周发布(上线后补正式链接)

一句话介绍

一套定义“机器人能力语义”的通用桥接框架,让 OpenClaw 能用同一种语言理解不同的机器人。

为什么需要它?

机器人型号千差万别:有的用 ROS,有的用厂商 SDK,有的走串口或 CAN 总线。如果每换一种机器人就重写一套 Agent 逻辑,维护成本会迅速爆炸。

Robot OpenClaw Bridge 的答案是:定义一层与具体机型无关的抽象——上层只面向语义编排工作流,底层再各自适配不同机器人。

核心特点

统一语义接口(标准方言)

Python# 底盘能力chassis.go_to(pose) # 导航到目标位姿chassis.stop() # 紧急停止chassis.get_pose() # 获取当前位置# 机械臂能力arm.move_to_pose(pose) # 末端移动到目标位姿arm.move_joints(positions) # 关节空间移动# 夹爪能力gripper.open(width) # 打开到指定宽度gripper.close(force) # 以指定力度闭合# 感知能力camera.get_image() # 获取图像camera.get_depth() # 获取深度图 |

任何机器人,只要按照这套语义实现接口,就能被OpenClaw无缝调用。

2)OpenClaw Skill 封装规范(让能力稳定可编排)

Skill 命名规范:robot.move_to、robot.pick、robot.place 输入/输出 Schema:统一数据结构 配置注入:机器人地址、API Key、限幅参数通过工作区传入 错误返回规范:不可达/超时/急停锁定等可被上层识别并处理

3)两条接入路径

路径一:直接用 xlerobot + OpenClaw(推荐先跑通)

Bash./skill-agent-setup/openclaw/setup.sh# 用OpenClaw Dashboard开始对话 |

路径二:接入自己的机器人

如果你有UR5、AGV或自研机械臂:

阅读 core/interfaces.md 按 docs/integration-guide.md 新增后端 在 OpenClaw 配置连接信息与安全参数

适用场景

想让现有机器人接入OpenClaw的团队 需要统一管理多种机器人型号的实验室 希望复用上层智能逻辑的机器人开发者

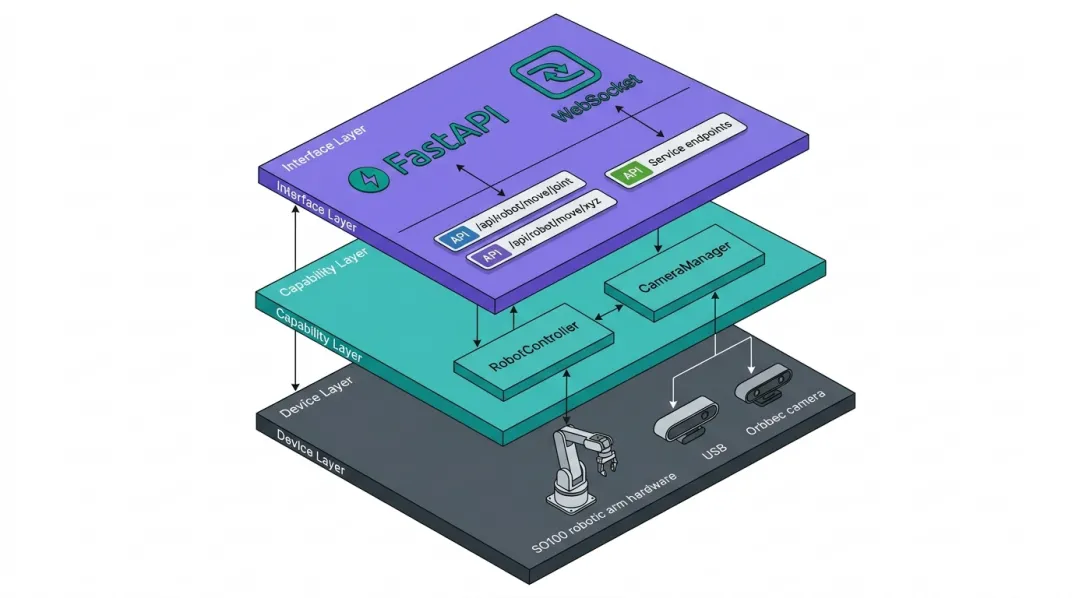

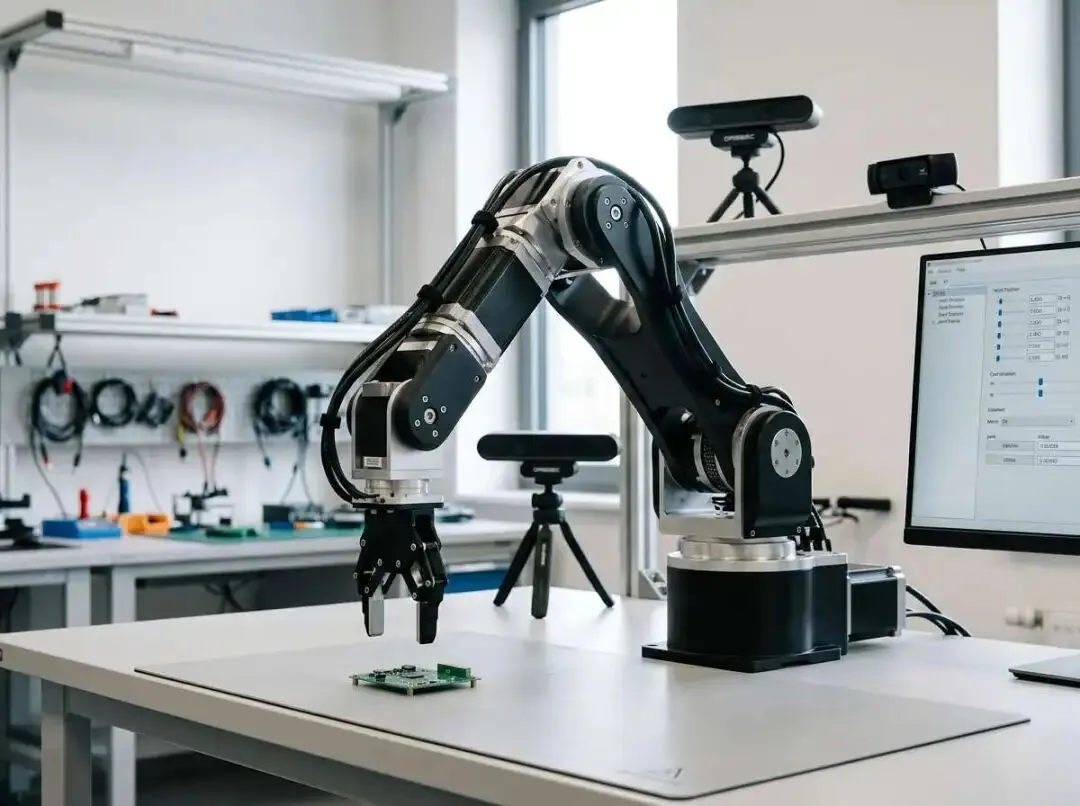

项目二:lerobot_so100_system —— 把 SO100 机器人与视觉流真正「服务化」

定位:身体层(专业级)(服务化 + 视觉统一输出 + 安全工程化)开发者:Xbotics 社区成员 @雨浩项目地址:https://github.com/IlIllllll/lerobot_so100_system

一句话介绍

面向 SO100 的机器人后台服务:同时提供机械臂控制接口和实时相机流接口,兼容 lerobot 风格的末端 XYZ 控制。

为什么需要它?

串口字节流或单脚本库调用能跑,但一旦引入多端并发、远程调用、状态同步、视觉流联动与安全机制,系统复杂度会快速上升。这个项目的解法是:把机器人做成微服务。

核心特点

1. 双控制范式:关节空间 + 笛卡尔空间

Bash# 关节空间控制curl -X POST http://localhost:8000/api/robot/move/joint -d '{"positions": [0.1, -0.2, 0.3, 0.0, 0.0, 0.0]}'# 笛卡尔空间控制(末端XYZ)curl -X POST http://localhost:8000/api/robot/move/xyz -d '{"x": -0.04, "y": -0.13, "z": 0.15}'# 相对位移curl -X POST http://localhost:8000/api/robot/move/relative -d '{"dx": 0.01, "dy": 0.0, "dz": 0.0}' |

2. 视觉流统一输出

JavaScript// 前端接入实时视频流const ws = new WebSocket("ws://localhost:8000/ws/camera/usb");ws.onmessage = (event) => {const data = JSON.parse(event.data);if (data.type === "frame") {document.getElementById("camera-view").src ="data:image/jpeg;base64," + data.data;}}; |

同时管理USB RGB、Orbbec RGB、Orbbec Depth,统一通过WebSocket输出。

3. 工程化安全机制

Bash# 失能扭矩(可手动挪动)curl -X POST http://localhost:8000/api/robot/torque -d '{"enabled": false}'# 恢复安全位姿curl -X POST http://localhost:8000/api/robot/move/safe |

安全位姿管理:记录当前姿态并可一键恢复 扭矩控制:支持电机使能/失能,方便手动调整 IK分段逼近:失败时动态缩小步长,提升可达性

4. 开箱可视化的控制页

服务内置/viewer页面,不仅能看实时画面,还能在线发送控制指令、同步当前姿态、一键恢复安全位置。

架构图

Plain Text┌─────────────────┐ ┌─────────────────┐ ┌─────────────────┐│ 接口层 │ │ 能力层 │ │ 设备层 ││ FastAPI + WS │ ───→ │ RobotController │ ───→ │ SO100 机械臂 ││ │ │ CameraManager │ ───→ │ USB/Orbbec 相机 │└─────────────────┘ └─────────────────┘ └─────────────────┘ |

与OpenClaw的集成

有了这个服务,SO100就变成了一个「HTTP服务」。接入OpenClaw只需要定义一个Skill,封装对http://robot-ip:8000/api/robot/move/xyz的调用,就能通过自然语言控制机械臂。

适用场景

有SO100机械臂,想把它做成可远程调用的服务 需要同时处理机械臂控制与视觉流的机器人应用 想把「脚本控制」升级到「服务化控制」的团队

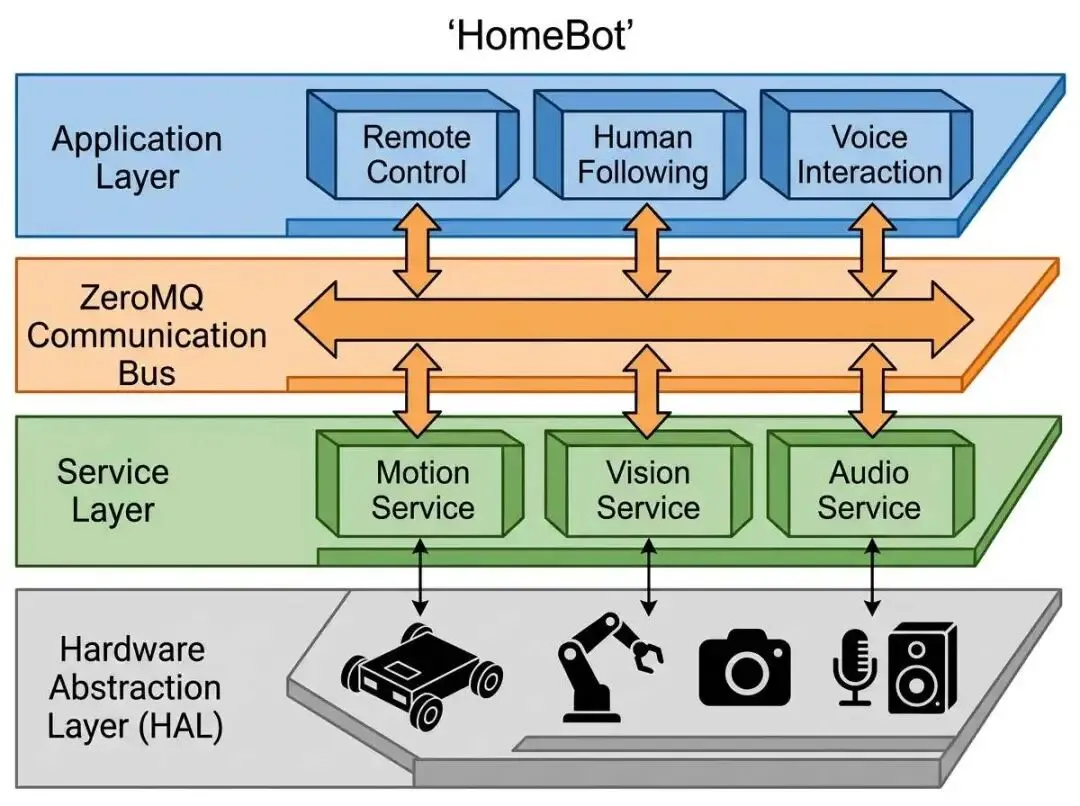

项目三:HomeBot —— 一台「会自己跟随、能听懂人话」的家用机器人

定位:身体层(家用级)(轻量模块化 + 可演示可复制 + 控制仲裁与安全)开发者:Xbotics 社区成员@陈老师 @诸老师项目地址:https://github.com/choco-robot/HomeBot

一句话介绍

面向家庭场景的轻量级机器人软件栈,用最小成本把「能动、会看、能听」都跑起来。

为什么需要它?

家用机器人常见两种极端:要么 ROS2 过重,要么脚本堆叠失控。HomeBot 试图走第三条路:轻量、模块化、开箱即玩,并把安全与仲裁机制做进骨架。

核心特点

1. 纯Python + ZeroMQ,轻量到能飞

核心语言:Python 3.11+,代码易读、易改 通信骨干:ZeroMQ,不需要中心Broker,进程之间直接对话 依赖体积:树莓派上也能轻松跑,对比ROS2是真·轻装上阵

ZeroMQ在HomeBot里的典型用法:

PUB/SUB:视觉服务广播相机图像帧 REQ/REP:应用向底盘服务发同步控制指令

2. 分层模块化架构

Plain TextApplication Layer 应用层:遥控 / 人跟随 / 语音 / 模仿学习↓ZeroMQ Bus 通信总线↓Service Layer 服务层:运动服务 / 视觉服务 / 语音服务↓HAL Layer 硬件抽象层:底盘 / 机械臂 / 摄像头 / 音频 |

对应代码目录:

Plain Textsoftware/├── src/│ ├── applications/ # 应用层│ │ ├── remote_control/ # 网页遥控│ │ ├── human_follow/ # 人体跟随│ │ └── speech_interaction/ # 语音交互(预留)│ ├── services/ # 服务层│ │ ├── motion_service/ # 运动/底盘服务│ │ └── vision_service/ # 视觉服务│ ├── hal/ # 硬件抽象层│ │ ├── chassis/ # 底盘驱动(三轮全向)│ │ ├── camera/ # 摄像头驱动│ │ └── ftservo_driver.py# 飞特舵机驱动│ └── configs/ # 配置中心└── start_system.py # 一键启动入口 |

网页遥控:手机就是遥控器

Plain Text手机浏览器↓ (WebSocket)Flask + SocketIO(remote_control应用)↓ (ZeroMQ REQ)ChassisService(底盘服务)↓三轮全向底盘 + ST3215舵机 |

打开手机浏览器输入http://

双虚拟摇杆(底盘控制 + 预留机械臂) 实时视频流 紧急停止 + 归位按钮

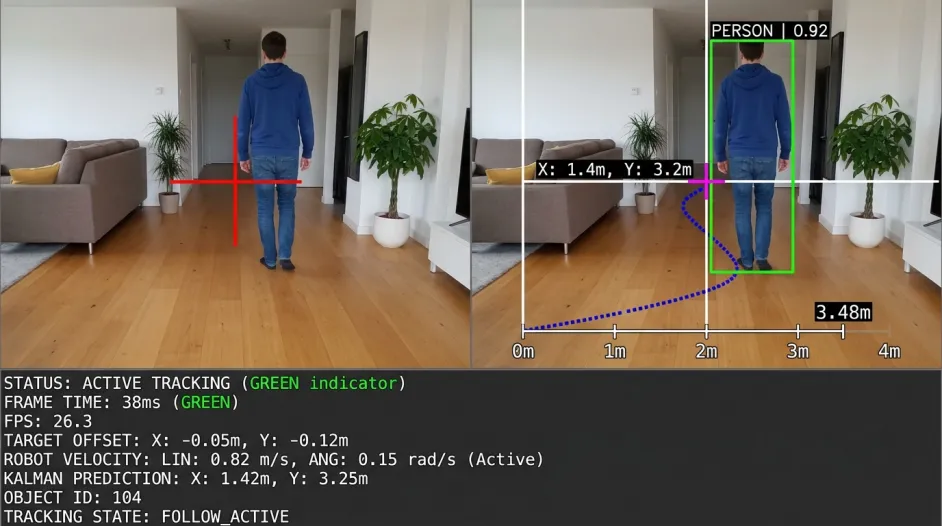

4. YOLO26实时人体跟随

Python# 核心逻辑:视觉伺服def compute_speed(target_x, target_width):# 水平控制:目标在左则左转,在右则右转if abs(target_x - frame_center) > dead_zone:angular = kp_angular * (target_x - frame_center)# 距离控制:目标太小则前进,太大则后退error = target_width - current_widthlinear = kp_linear * errorreturn linear, angular |

检测模型:YOLO26-nano(约2.4MB) 检测速度:纯CPU下38ms/帧,比YOLO11提速约43% 跟踪算法:IoU匹配 + 卡尔曼滤波 控制算法:视觉伺服,按画面偏移和目标大小自动调速度

5. 安全第一:仲裁器 + 紧急停止

PythonPRIORITIES = {"emergency": 4, # 紧急停止(最高)"auto": 3, # 自动模式(人体跟随)"voice": 2, # 语音控制"web": 1, # 网页遥控(最低)} |

紧急停止锁定后,必须点击「归位」才能解锁 超过1秒没收到指令,自动停车 所有速度在配置层统一限幅

6. 接入Picoclaw:用自然语言控制

预置的Picoclaw技能:

homebot-controller:控制底盘前进/后退/转向 homebot-arm-controller:控制机械臂 what-does-robot-see:获取视觉画面并用多模态模型解读

你可以直接说:

「让机器人前进20厘米」 「右转90度」 「机器人看到了什么?」 |

Picoclaw会自动解析、调用对应服务、返回结果。

与OpenClaw的集成

HomeBot本身不依赖OpenClaw,但它是OpenClaw最自然的「身体」:

HomeBot把机器人的所有能力封装成了ZeroMQ服务 OpenClaw通过ZeroMQ客户端调用这些服务 视觉流通过WebSocket直接推给OpenClaw或前端

适用场景

想做家用小车/机械臂,又不想被ROS2压垮的个人开发者 需要可讲解、可Demo的机器人教学平台的老师 想做物理世界代理(LLM+机器人)的工程师 对ZeroMQ、视觉伺服、人跟随感兴趣的读者

三个项目的关系:拼出「OpenClaw + Robot」的全貌

项目 | 定位 | 解决的核心问题 | 与OpenClaw的关系 |

Robot OpenClaw Bridge | 连接层 | 定义统一语义,让OpenClaw能理解不同机器人 | 定义「对话协议」 |

lerobot_so100_system | 身体层(专业级) | 把SO100机械臂服务化,提供HTTP+WebSocket接口 | 实现协议的具体「身体」 |

HomeBot | 身体层(家用级) | 轻量级家用机器人软件栈,开箱即玩 | 另一个实现协议的「身体」 |

它们共同回答一个问题:如何让 AI 不仅会「说」,还会「做」?

Robot OpenClaw Bridge 定义了大脑与身体的对话协议 lerobot_so100_system 把一个专业机械臂变成了可调用的服务 HomeBot 把一套家用机器人系统做成了模块化、可接入的软件栈

加入我们:做OpenClaw + Robot的第一社区

如果你正在做这些事——

把大模型接到真实机器人上(SO100 / UR / Franka / 四足 / AGV / 自研底盘都可以) 想让机器人从“能动一下”升级到可复用、可部署、可闭环的系统 对 OpenClaw / Picoclaw / Tidybot Universe 感兴趣,想找同好一起踩坑推进 或者只是想第一时间围观「AI + 机器人」最新进展

你可能有这些问题:

“我这台机器人要怎么抽象成通用能力接口?” “HTTP/WS/ZeroMQ/ROS2 选哪条服务化路线更合适?” “如何做急停、限幅、超时停车和控制权仲裁?” “OpenClaw/Picoclaw 的 Skill 怎么写才能更稳、更可复用?”

欢迎加入Xbotics社区的「OpenClaw + Robot」飞书群——这里是「OpenClaw + Robot」的第一社区。

进群你能获得什么?

1)项目进展与 Demo 资料

三个项目的更新、Demo 视频、关键里程碑 近期生态速报(OpenClaw / Picoclaw / ROS2 案例等)

2)接入答疑与踩坑互助

接 SO100 / 自研底盘 / ROS2 / 串口等的接口设计与调试 Skill/Schema、服务化、视觉流、权限与安全机制的工程经验

3)线上交流与共建机会

定期线上分享:工作流设计、闭环策略、安全与仲裁、评测方法 共建开源:补齐 backend、完善能力语义、扩展技能市场

让我们一起,把「OpenClaw + Robot」做成真正可跑可用的开源方案。

项目地址汇总(含生态入口)

OpenClaw:https://github.com/openclaw/openclaw OpenClaw Releases:https://github.com/openclaw/openclaw/releases OpenClaw 官网:https://openclaw.ai OpenClaw × ROS2 实践文章:https://moesani.com/blog/openclaw-is-now-controlling-my-robot/ Picoclaw:https://github.com/sipeed/picoclaw OpenClaw-RL:https://github.com/Gen-Verse/OpenClaw-RL Awesome OpenClaw Agents:https://github.com/mergisi/awesome-openclaw-agents lerobot:https://github.com/IlIllllll/lerobot_so100_system HomeBot:https://github.com/choco-robot/HomeBot Tidybot Universe:https://github.com/tidybot-universe/tidybot-universe

-END-

Ask Me Anything|提问箱

❝对文章有疑惑,或想聊更深?欢迎把你的问题丢给我们:技术方案、实操踩坑、课程与资料、项目合作、职业发展,都可以问。

怎么问:在评论区留言,或私信公众号

我们会做什么:每周集中整理高质量问题并公开回复,重点问题邀请作者或嘉宾深度解答;典型问题会加入知识库并持续更新。

提问小提示:尽量说明「你的目标—当前做法—期望产出」,附上必要信息(硬件/软件版本、数据规模等),能更快获得有用答案。

一起把问题变成知识,推动社区进步 🚀

夜雨聆风

夜雨聆风