你好,我是Bin哥,一名 AI 时代的探索者,正在努力研究如何与 AI 共生,今天是我在公众号学习分享的 第290天 。

现在我的 AI 微信群里,六个群里,有五个都在聊"小龙虾"。

不是吃的那种——是 OpenClaw,那个红遍全网的 AI Agent 开源项目。有人晒截图说"帮我自动回了 200 封邮件",有人抱怨 Mac mini 涨价还断货,还有人说公司已经组织了"小龙虾安装大赛",装不好要扣绩效。

这场景像极了 2023 年初全民注册 ChatGPT——上次那波热闹之后,真正跑起来的 AI 项目有几个?

今天不教你怎么装小龙虾。我想带你做一件更值钱,并且有意义的事:看懂它的骨架。 当你理解了 OpenClaw 为什么这样设计,你对整个 AI Agent 的认知会上一个台阶——不管你用不用它。

你只有真正了解了它,你才能知道它能给你带来什么。

一、先看全貌:把 OpenClaw 想象成一家公司

大多数人以为 OpenClaw 是一个"更强的聊天机器人"。不对。

OpenClaw 的本质是一个 Agent 操作系统——它不只是能聊天,而是能住在你电脑里、连接你的各种工具、定时帮你干活、甚至在你睡觉时自己启动任务的系统。

听起来有点抽象?我们换一种方式理解。

把 OpenClaw 想象成一家公司,每一层对应公司里的一个角色:

上面那张架构图就是这家"公司"的组织架构。接下来,我们一层一层拆开看。

二、逐层拆解:每一层是什么、干什么、为什么重要

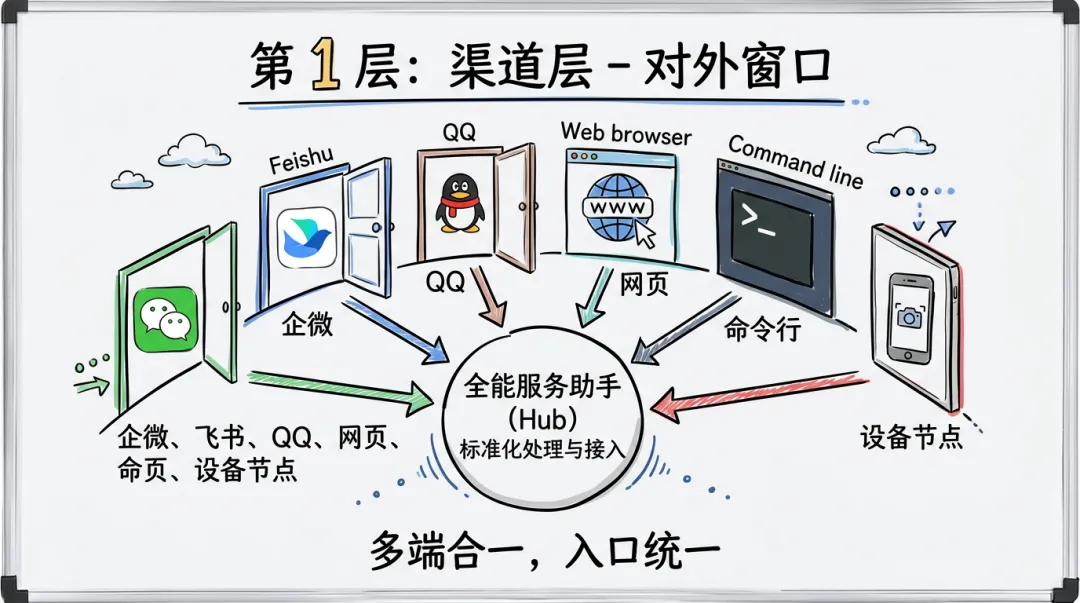

第 1 层:渠道层——"对外窗口"

OpenClaw 不是一个只能在网页里用的聊天框。你可以通过企微、飞书、QQ、Discord、Telegram、WhatsApp、命令行给它发消息下指令。

更酷的是,它还有"设备节点"概念:你的手机摄像头、电脑屏幕,都可以变成 Agent 的"感官器官"。

为什么重要? 传统 AI 助手只活在一个聊天窗口里。OpenClaw 把 Agent 放进了你日常生活的每一个入口——你在手机飞书里说一句话,它就能帮你干活,不需要打开另一个 App,这是多端合一的最好表现。

这就像一家好公司,客户从电话、企微、邮件、柜台都能联系到,体验还是连续的。

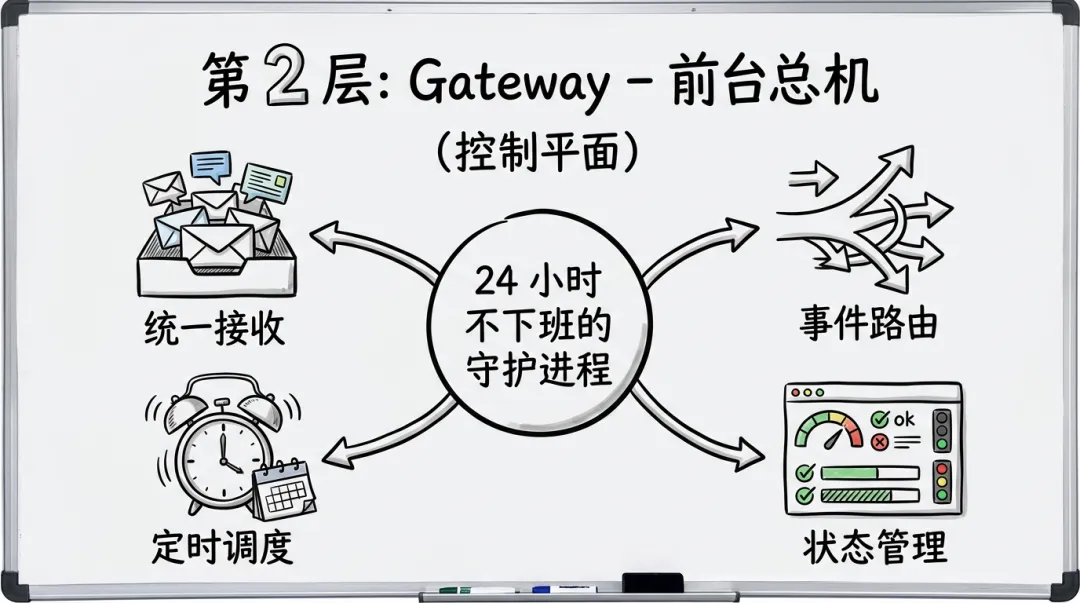

第 2 层:Gateway——"前台总机"

这是 OpenClaw 最核心的一层。

Gateway 是一个常驻运行的守护进程(可以理解为 24 小时不下班的前台),做四件关键的事:

统一接收:所有渠道的消息都先到它这里 事件路由:判断这个请求该交给哪个 Agent 处理 定时调度:内建了"闹钟"(cron),能定时触发任务——比如每天 9 点生成日报 状态管理:维护所有 Session 和 Agent 的运行状态

为什么重要? 很多团队做 Agent,都是"来一个请求临时起一个程序处理",没人记得上次聊到哪了。Gateway 的存在,让 Agent 从"一次性对话"变成了"持续运行的系统"。

第 3 层:Session——"会议室"

这是很多人忽略但极其关键的一层。

每次你和 Agent 对话,背后都有一个 Session(会话)在管理这次"会议"。Session 做的事包括:

对话隔离:你和 Agent 聊工作是一个 Session,你老婆和同一个 Agent 聊家务是另一个 Session——两边信息不会串。OpenClaw 用 dmScope来控制隔离粒度,可以按发送者、按渠道、甚至按账号分别隔离。历史保存:每个 Session 的对话记录存成 .jsonl文件(一种结构化日志),Agent 下次醒来能继续上次的话题。自动压缩:聊太久了,历史记录超过模型能处理的长度怎么办?Session 会自动把旧对话"压缩"成摘要,保留最近的完整消息——就像会议记录太长时,有人帮你做了一份精华摘要。 跨渠道续接:你在飞书上聊了一半,换到网页继续,Session 知道这是同一个人同一件事,上下文不断。

为什么重要? 没有 Session 管理的 Agent,就像一家公司没有会议室——所有对话在大厅里喊,谁都能听到,没人记得上次说了啥。Session 是 Agent 从"玩具"变成"可用系统"的基础设施。

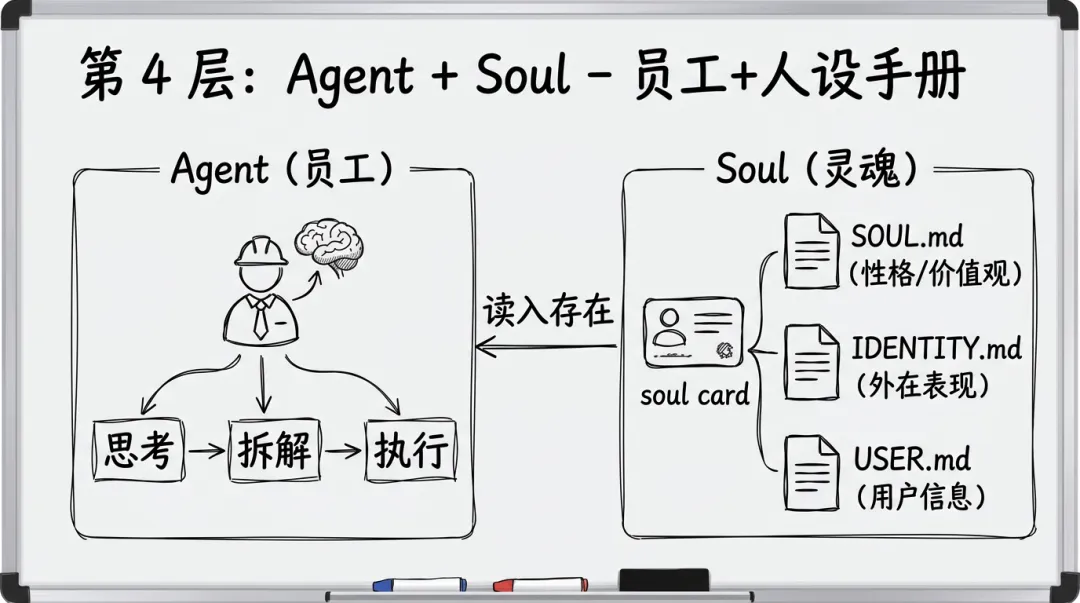

第 4 层:Agent + Soul——"员工 + 人设手册"

Agent 是真正"干活"的部分。它接到 Gateway 通过 Session 转过来的指令后,会理解意图、拆解步骤、调用工具执行、返回结果。Agent 背后调用的是大语言模型(Claude、GPT、DeepSeek 等),但模型只是它的"大脑",真正让它能做事的是下面的工具层和记忆层。

Soul 则是 Agent 的"灵魂"——一个叫 SOUL.md 的 Markdown 文件。

这个设计非常有意思:每次 Agent 启动一个新会话,它做的第一件事就是读自己的 SOUL.md——用官方的话说,它在"把自己读入存在"。

SOUL.md 里定义了什么?

性格和语气:比如"简洁直接,不说废话""适度幽默但不油腻" 价值观和边界:比如"涉及金融建议时必须加免责声明""不执行任何可能泄露用户数据的操作" 行为规则:比如"收到邮件先分类再处理""写代码前先确认需求"

你可以随时打开这个文件修改——改完之后,下次对话 Agent 就"变了一个人"。

除了 SOUL.md,还有几个配套文件:

IDENTITY.md:外在表现——名字、头像、表情符号(Soul 是内在,Identity 是外在)USER.md:关于你的信息——你的偏好、工作习惯(让 Agent 更懂你)AGENTS.md:Agent 之间的协作指令

为什么重要? 传统聊天机器人每次对话都像失忆了一样从零开始。OpenClaw 的 Agent 每次醒来都知道"我是谁、我该怎么做事、我服务的人是谁"。而且这一切都是人可以直接编辑的 Markdown 文件——改一个文本文件就能改变 AI 的"人格",不需要重新训练模型。

关于多 Agent 协作: OpenClaw 支持多个 Agent 通过 Gateway 协同工作。你可以把它想成一家公司有多个员工——主 Agent 像项目经理,接到复杂任务后,通过 sessions_spawn 派活给子 Agent(数据分析员、代码工程师等)。每个子 Agent 有自己的 Soul、Session 和 Memory,独立干活,做完把结果交回来。就像项目经理委派子任务,组员做完交付,项目经理汇总。子 Agent 的 Session 会嵌套在父 Agent 的 Session 下面,互不干扰。

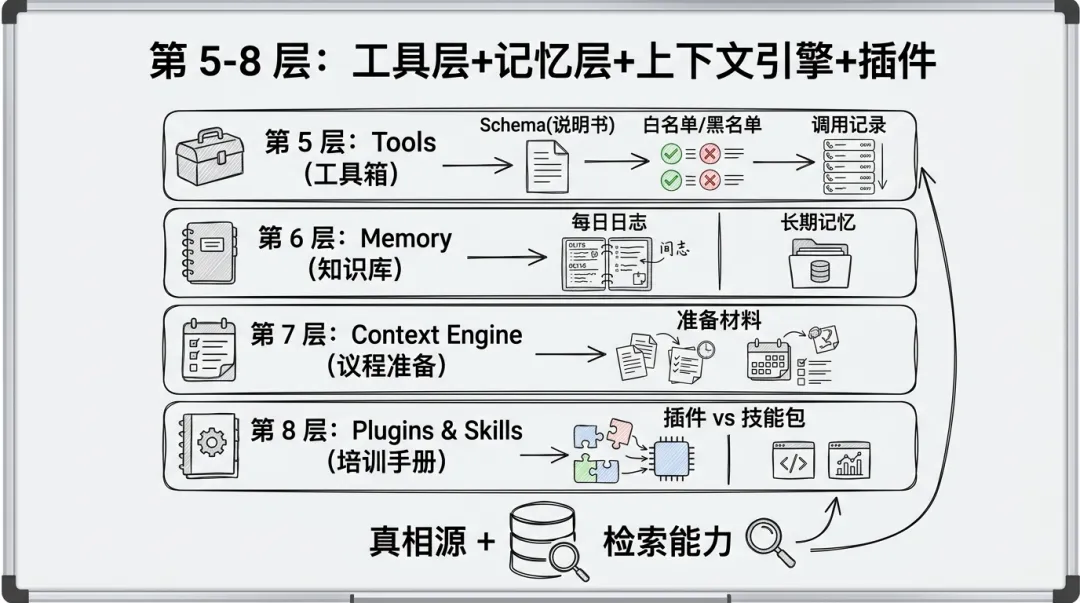

第 5 层:工具层——"员工的工具箱"

Agent 光会想没用,得有工具才能做事。OpenClaw 内建的核心工具包括浏览器(独立隔离的)、文件系统、终端命令、定时任务等。

关键设计:工具不是随便用的。 每个工具都有三重管控:

Schema 定义(说明书):明确的参数说明,模型知道该怎么调用 白名单/黑名单(权限):控制 Agent 能用哪些工具 调用记录(日志):每次操作留痕

为什么重要? 就像公司给员工配工具——发工牌、配工具、做记录,而不是给一把万能钥匙自己摸索。很多 Agent 项目翻车,不是模型"想错了",而是"做错了"——没有工具管控就是在裸奔。

第 6 层:记忆层——"知识库 + 笔记本"

Agent 的记忆分两层:

每日日志( memory/YYYY-MM-DD.md):今天做了什么、聊了什么,像工作日志每天记一份长期记忆( MEMORY.md):整理过的重要信息,比如"用户偏好简洁风格""Q2 预算确认为 500 万"

注意,记忆的真相源是 Markdown 文件——你可以直接打开看、直接修改。先有人可以看的真相,再用插件提供搜索能力。

为什么重要? 很多 Agent 系统把记忆全丢进向量数据库(一种 AI 专用的搜索引擎),结果记忆变成黑盒——没人知道 Agent 为什么"想起"了某条信息。OpenClaw 的思路是:先有真相,再有检索。 出了问题,打开文件就能查。

第 7 层:上下文引擎——"会前议程准备"

大语言模型有"窗口"限制——每次能处理的信息量有限。上下文引擎的工作是:每次模型"开会"前,准备最合适的"议程"——带什么历史记录、召回什么记忆、放哪些工具说明、压缩掉什么旧信息。

这个引擎被设计成可替换的插件——法务场景可以自动带合同模板,客服场景自动带工单历史。

为什么重要? 同一个模型,给它不同的上下文,表现天差地别。好的上下文引擎就像一个好助理——会前帮你准备好关键材料,而不是把所有历史文件一股脑堆到桌上。

底层:插件和技能包——"培训手册 + 外包能力"

插件(Plugins):运行时级别的扩展——新工具、新渠道、新记忆引擎。改变的是"Agent 能做什么"。 技能包(Skills):方法论级别的扩展——周报写作技能、需求拆解技能。改变的是"Agent 怎么做"。

同类插件(比如记忆引擎)只允许激活一个——叫"槽位(slot)"机制,像一个岗位同时只能有一个人上岗。

三、这套架构最大的好处

说了这么多层,核心好处就一个:

每一层都可以独立替换,不用牵一发动全身。

想换模型?只改 Agent 层。想加飞书?只改渠道层。想换记忆方案?只换 Memory 插件。想换 Agent 性格?改一个 SOUL.md 文件。想隔离不同用户的对话?调一个 Session 配置。

这就像一家管理好的公司——换一个前台不影响业务部门,新来一个员工不需要重建流程。

四、冷思考:别急着照搬到企业里

第一,安全模型是"个人级"的。 官方明确说了:一个 Gateway 对应一个信任边界。多人共用一个 Agent,默认没有用户间的权限隔离。Bloomberg 报道提到超过 4 万个 OpenClaw 实例暴露在公网上,超过六成存在可被利用的漏洞。

第二,Soul 文件是安全重灾区。 SOUL.md 定义了 Agent 的一切行为,一旦被恶意篡改,等于整个 Agent 被劫持——而且重启后依然生效。安全研究者已经演示了通过网页注入修改 SOUL.md 的攻击链。

第三,插件生态有"供应链风险"。 审计发现约 12% 的公开技能包含恶意代码。企业应该学它的插件架构,但必须建私有白名单注册中心。

五、设计 Agent 可以参考的五条建议

建议 1:学它的“分层思维”,别学它的“全部打通”

不管你做什么 Agent 项目,先把架构拆成“渠道层 → 控制层 → 执行层 → 能力层 → 治理层”,让每层职责清晰、接口明确。适用于任何想从 demo 走向真实使用的 Agent 项目。代价是前期需要多花 30% 的设计时间。

建议 2:给 Agent 一个可编辑的“灵魂文件”

借鉴 OpenClaw 的 SOUL.md 思路:用一个人可以直接修改的配置文件,定义 Agent 的性格、规则和边界。不要把这些内容硬编码在代码里。需要注意的是,要做好 Soul 文件的安全防护,防止被注入篡改。

建议 3:Session 隔离是底线,不是可选项

只要有超过一个用户使用你的 Agent,就必须做 Session 隔离,让每个用户的对话独立、上下文不串。代价是运维复杂度增加,存储成本上升。

建议 4:记忆一定要有“人能看懂的真相层”

不要把所有记忆一股脑丢进向量数据库。至少保留一层人工可审阅的文本或文档记忆,作为“真相源”。适用于任何需要跨对话保持状态的 Agent。代价是需要定期审阅和清理,存储成本略增。

建议 5:工具要“登记在册”,不要“偷偷开后门”

每个 Agent 能用的工具,都必须有说明书(Schema)、有权限控制(白名单)、有使用记录(日志)。适用于 Agent 需要操作外部系统(发邮件、改文件、调 API)的任何场景。代价是短期开发效率下降,需要维护工具注册表。

六、最后

这波小龙虾热潮终究会退。但 OpenClaw 真正留给行业的,不是"帮你自动回邮件"的炫酷演示——而是它用一个开源项目,向所有人展示了 Agent 从"能聊天"到"能做事",中间到底需要几层架构。

从渠道接入,到请求调度,到会话管理,到灵魂定义,到任务执行,到工具管控,到记忆存储,到上下文编排——每一层都不是多余的。

记住一句话:装小龙虾只要 10 分钟,但看懂它的骨架,够你用三年。

如果你对 AI 也感兴趣,或者在 AI 学习中有任何疑问,都可以私信我,和我交流。

有什么不同观点也可以在评论区一起讨论~如果觉得有帮助,可以点击下方卡片关注哦~谢谢~

夜雨聆风

夜雨聆风