在 AI 大模型普遍依赖云端算力的当下,AMD 的一次技术发布为本地 AI 发展撕开了新的口子。2026 年 3 月,AMD 正式推出 OpenClaw 本地化 AI 智能体运行方案,同步发布 RyzenClaw 和 RadeonClaw 两套专属硬件配置,将智能体电脑的理念落地到消费级和专业级硬件平台,让开发者和 AI 爱好者能在自家 Ryzen 设备上打造完全脱离云端的 AI 智能体,真正实现数据自主、算力可控的本地 AI 应用体验。

随着 AI 应用从单纯的对话交互向实际任务执行演进,企业和个人对数据安全、隐私保护的要求日益提升,而云端 AI 存在的网络依赖、Token 配额限制、数据泄露风险等问题,让本地化部署成为新的行业趋势。

OpenClaw 作为 2026 年爆火的开源 AI 智能体框架,自 2025 年 11 月由奥地利开发者发起以来,历经数次更名与迭代,GitHub 星标数突破 28 万,成为全球增长最快的开源项目之一,其核心优势正是让 AI 从 “能对话” 升级为 “能执行”,像一位 24 小时待命的数字员工,可实现文件操作、浏览器控制、脚本执行、自动化工作流编排等系统级任务,完美契合本地部署的需求。

与传统对话式 AI 不同,OpenClaw 采用模块化架构设计,拥有任务编排引擎、工具调用框架、记忆管理系统和安全隔离机制四大核心能力,支持 100 + 种系统工具和 API 的标准化调用,能将复杂任务自动拆解为可执行的子任务,还能通过 Memory.md 实现本地化长期记忆存储,所有操作都在沙箱环境中运行,避免对主系统造成影响。

而 AMD 此次发布的技术指南,正是为 OpenClaw 量身打造了两套基于 Windows 系统 WSL2 环境的硬件运行方案,且能在 1 小时内完成全流程配置,让高端 Ryzen 硬件的算力优势与 OpenClaw 的功能优势深度结合。

RyzenClaw 方案以锐龙旗舰处理器为核心,搭载 Ryzen AI Max+ 395 处理器与 128GB 统一内存,凭借 16 核 Zen 5 架构和 40 个 RDNA 3.5 计算单元,最高可划分 96GB 系统内存作为可变显存。

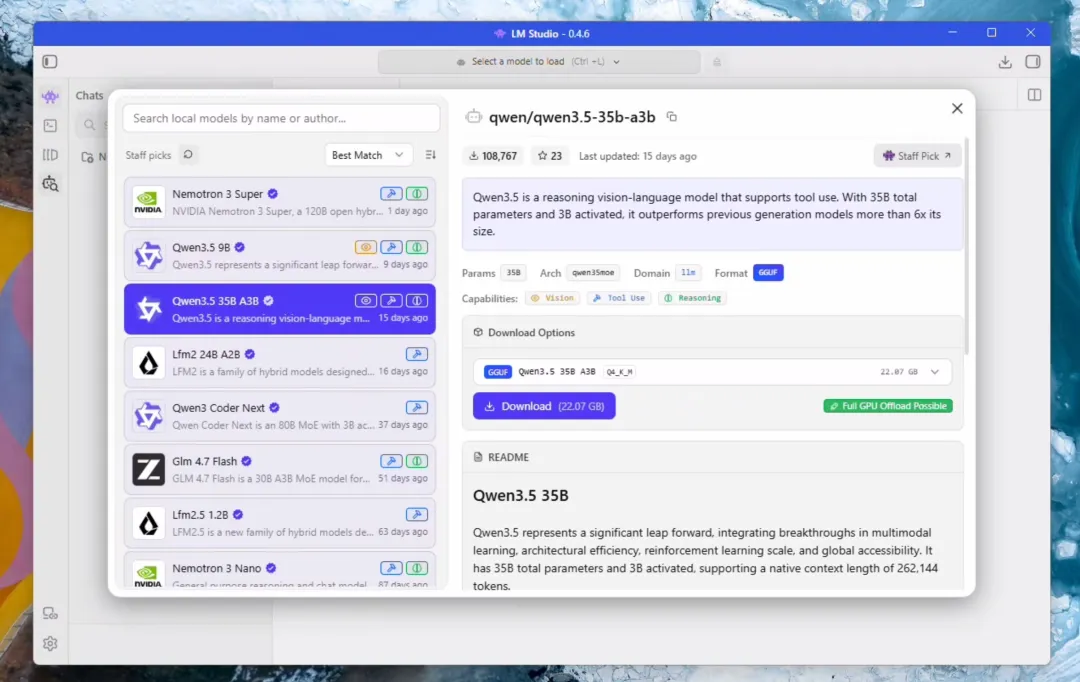

基于 AMD 独有的统一内存架构,该方案实现了 CPU 与 GPU 之间的动态资源分配和数据零拷贝,大幅降低了数据传输开销。在实际性能测试中,运行 Qwen 3.5 35B A3B 大模型时,RyzenClaw 的生成速度可达 45 token / 秒,处理 1 万输入 token 仅需 19.5 秒,支持高达 26 万 token 的超大上下文窗口,还能同时运行 6 个 AI 智能体。

这一特性让它成为多智能体集群实验、长时对话保持、复杂工作流处理的理想选择,也让消费级硬件开展 AI 研究成为可能,不过该方案的工作站设备成本普遍在 10000 元以上,定位高端开发者群体。

另一套 RadeonClaw 方案则聚焦专业级高性能推理,以拥有 32GB 显存的 Radeon AI PRO R9700 专业工作站显卡为核心,凭借专用显存的高带宽优势和独立 AI 计算单元,实现了推理性能的飞跃。

同样运行 Qwen 3.5 35B A3B 模型,RadeonClaw 的生成速度达到 120 token / 秒,是 RyzenClaw 的 2.7 倍,处理 1 万输入 token 仅需 4.4 秒,能满足实时响应要求高的专业开发、测试场景。当然,性能的提升也伴随着一定取舍,其最大上下文窗口缩减至 19 万 token,并发智能体数量为 2 个,且仅显卡本身的起售价就达 1299 美元(约合 8939 元人民币),更适合追求极致推理速度的专业用户。

两套方案虽各有侧重,但都秉持着 AMD 让用户掌控算力与数据”的核心理念。相较于云端 AI,基于 OpenClaw 的本地部署模式拥有五大核心优势:所有指令、会话记录和记忆文件均存储在本地,彻底规避云端数据泄露风险;断网状态下仍能正常运行,摆脱网络依赖;无 API 调用次数和 Token 配额限制,可 24 小时不间断工作;一次性硬件投入后无持续订阅费用,长期使用成本更低;敏感数据处理全程在本地完成,隐私保护更彻底。

而 AMD 将这一模式定义为 “Agent Computers” 的未来,认为 AI 不应只局限于远程数据中心,而应下沉到个人设备,让每个用户都能拥有专属的、可控的 AI 算力。

从技术实现来看,AMD 的 OpenClaw 方案通过 LM Studio 结合 llama.cpp 处理本地化大模型推理流程,借助本地嵌入技术支持 Memory.md,全程无需云端参与,同时保留了良好的扩展性 ——RyzenClaw 支持多智能体并行,RadeonClaw 还能实现 4 卡并行扩展至 128GB 显存。

目前,开发者不仅能通过该方案实现 OpenClaw 的基础部署,还能将其与飞书等办公工具集成,打造可远程控制的个人 AI 助手,实现定时任务、数据处理、消息推送等自动化办公场景。

当然,现阶段的 OpenClaw 方案仍有一定的入门门槛,两套硬件配置的成本均相对较高,暂时无法覆盖普通消费用户,其核心目标群体仍是正在探索本地 AI 智能体的早期开发者、工程师和 AI 爱好者。

但这一举措的意义,早已超出了单一硬件方案的发布:它标志着 AMD 在 AI PC 竞争中走出了独特的 “去云端化” 路径,将高端消费级硬件的算力潜力与开源 AI 框架深度融合,为本地 AI 从简单助手向多智能体并行演进提供了硬件支撑。

详细部署文案请参考:

https://www.amd.com/en/resources/articles/run-openclaw-locally-on-amd-ryzen-ai-max-and-radeon-gpus.html其它相关资源:

华为 HarmonyOS NEXT 系统居然还能运行安卓应用

夜雨聆风

夜雨聆风