哈喽,大家好。今天莫名其妙地发现公众号的推荐又停掉了,上周还有推荐量,这周0推荐,不知道微信到底是什么规则,真的搞得没点动力都没有。不过,既然做了,还是坚持做下去吧,大家多多转发,多多支持。

给大家分享一篇OpenClaw的操作技巧。

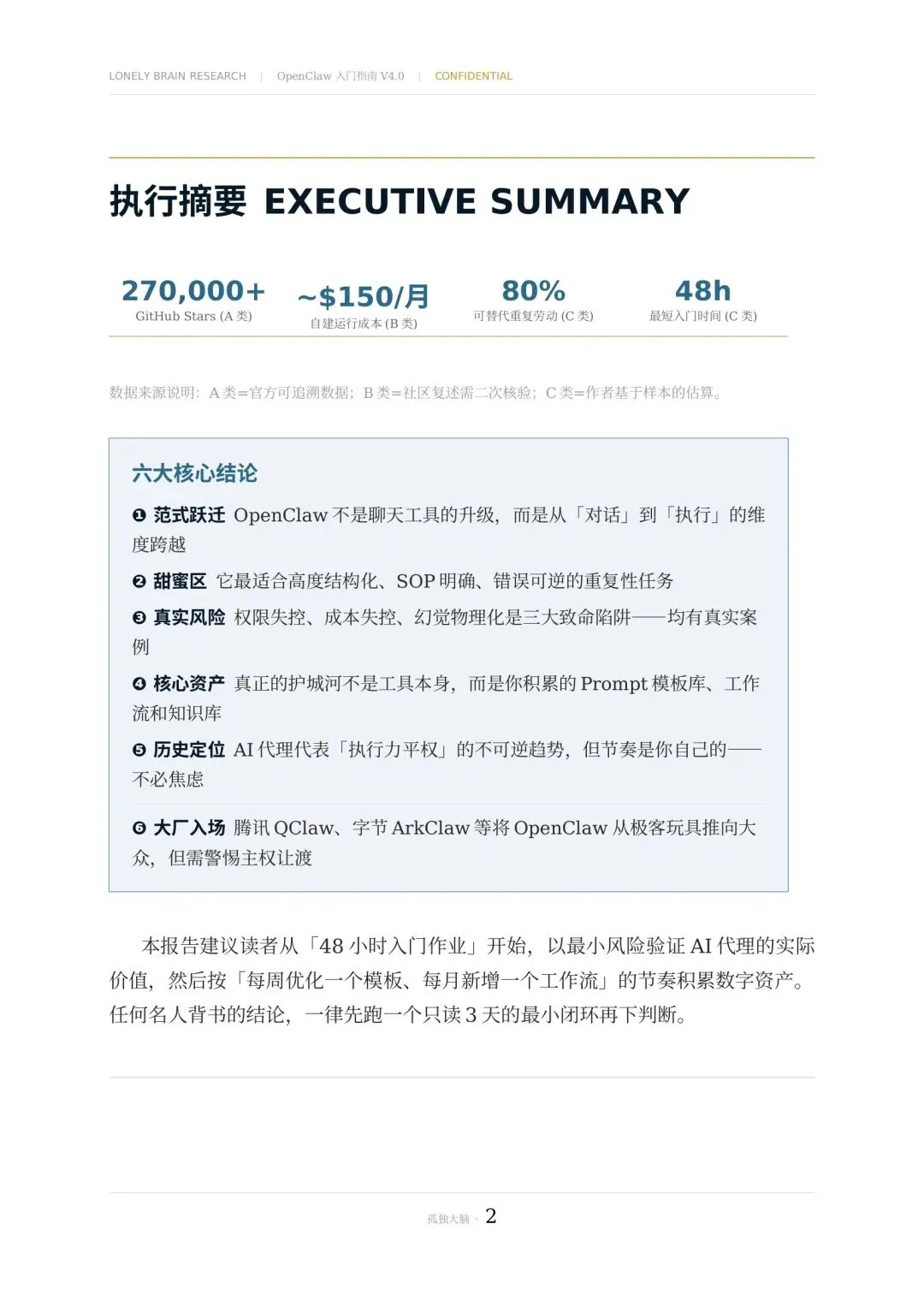

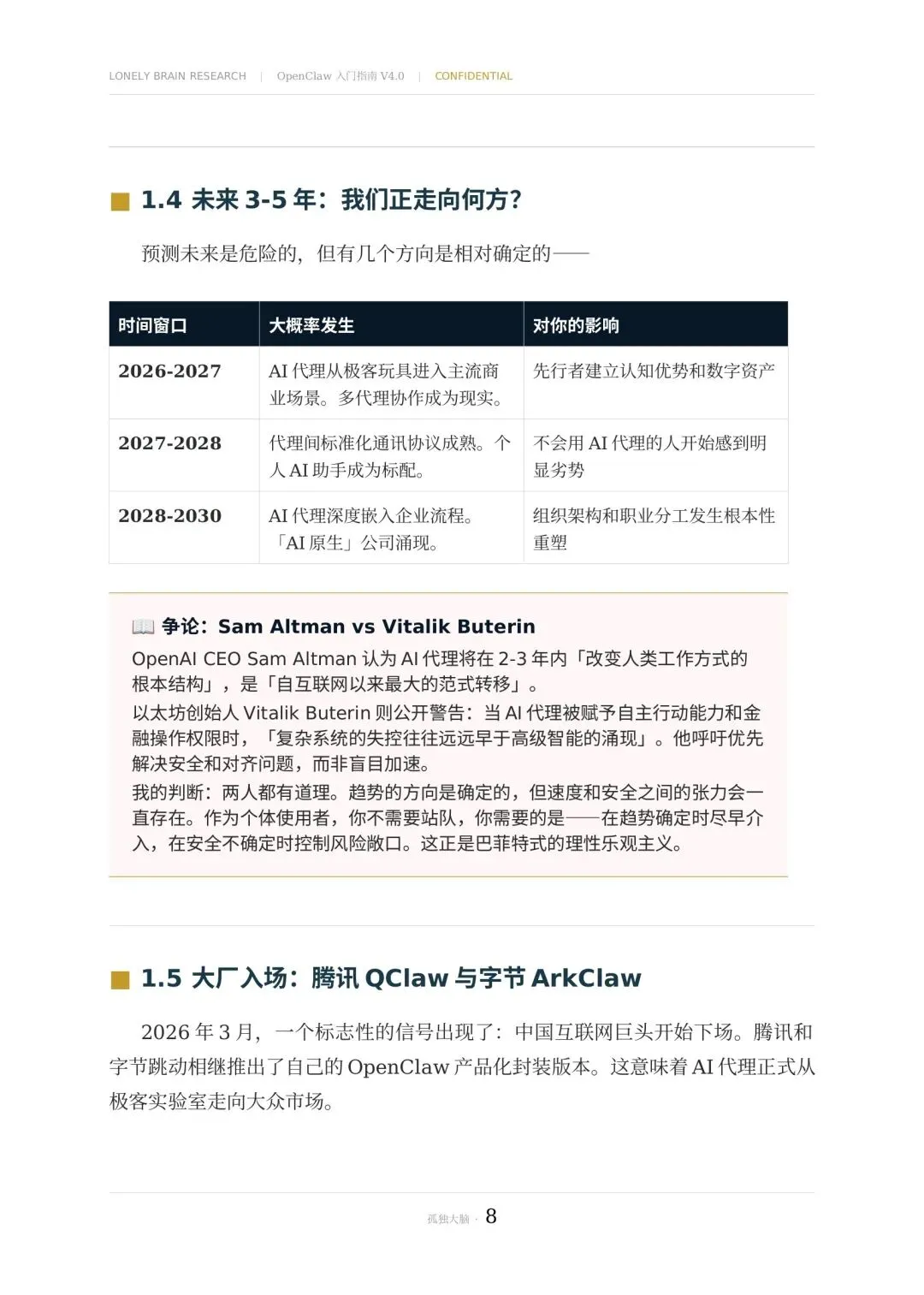

最近AI圈最火的话题,莫过于OpenClaw了。27万+的GitHub Stars,被黄仁勋拿来跟Linux做类比,腾讯和字节也快速推出了自己的封装版本——QClaw和ArkClaw。但我看很多人讨论的其实都跑偏了,要么过度神话,要么完全看不懂在焦虑啥。

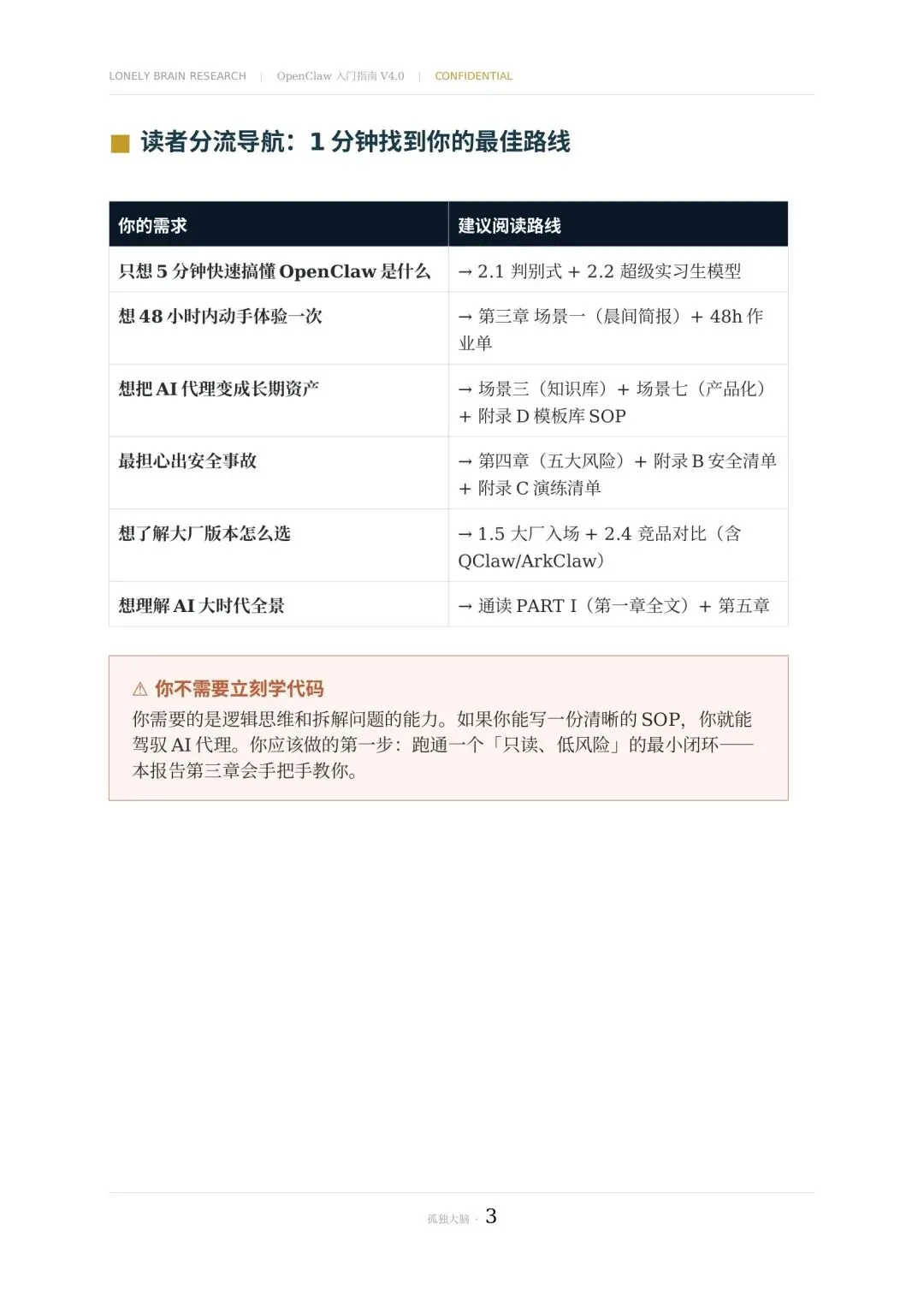

花了点时间读完一份讲怎么「理性上手」的报告,里面有几点拆解我觉得挺清醒的,分享下。

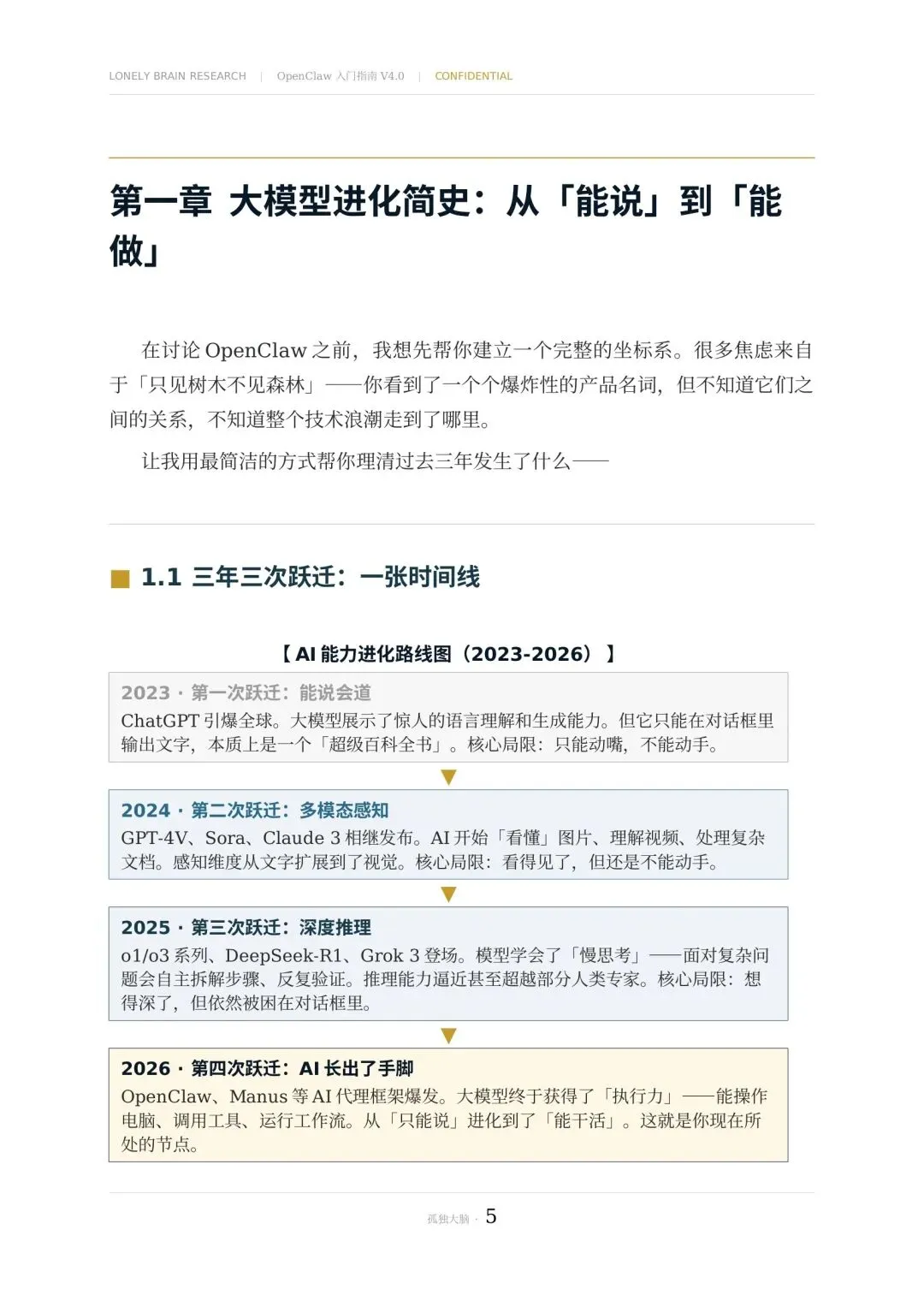

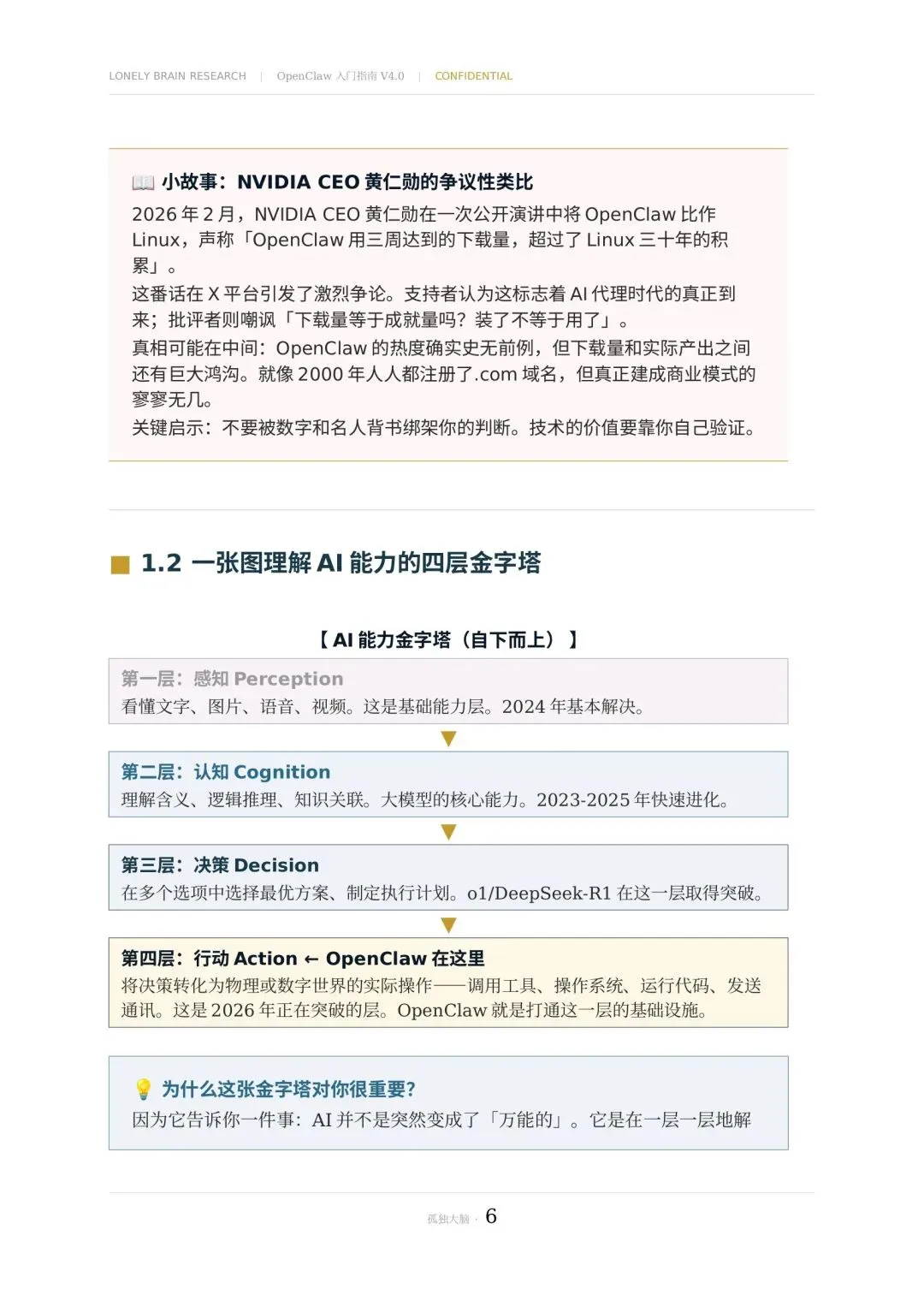

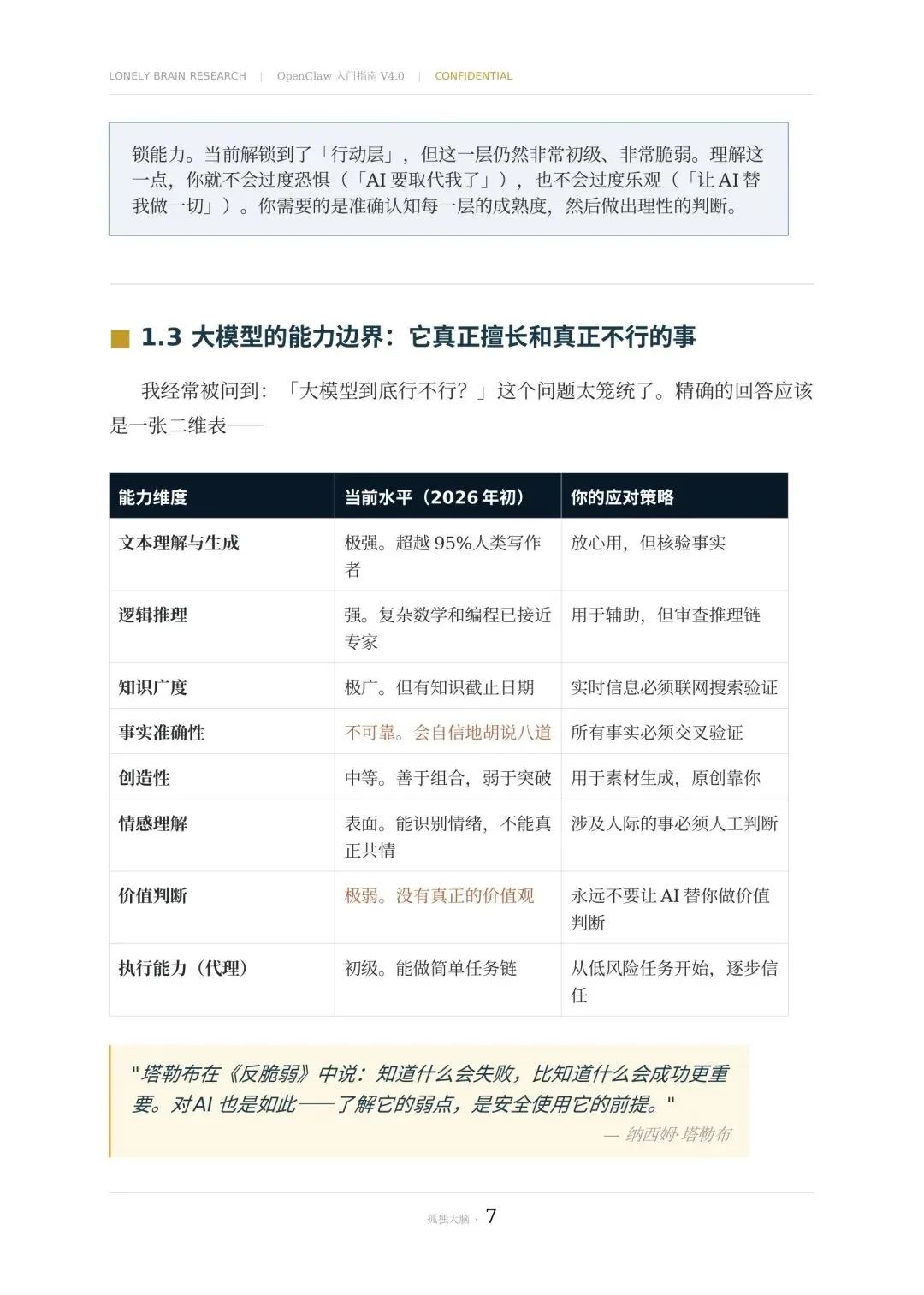

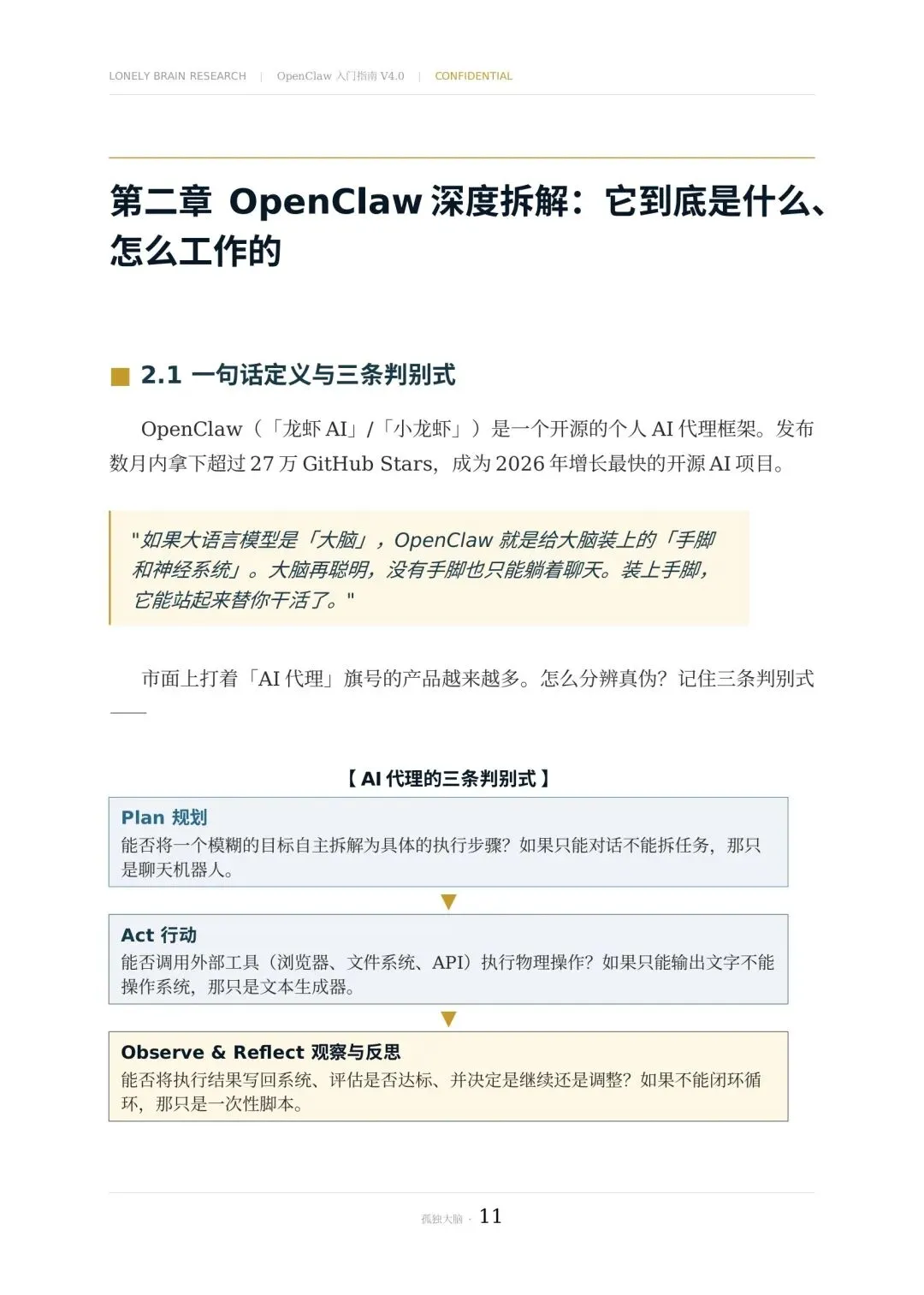

首先得搞明白,OpenClaw到底解决了什么问题?报告里有个比喻很到位:如果大模型是大脑,OpenClaw就是给大脑装上的手脚和神经系统。过去三年,AI经历了「能说会道」→「多模态感知」→「深度推理」三次跃迁,但始终被困在对话框里。2026年的第四次跃迁,就是AI终于能「动手干活」了——操作电脑、调用工具、运行工作流。这叫从对话到执行的维度跨越。

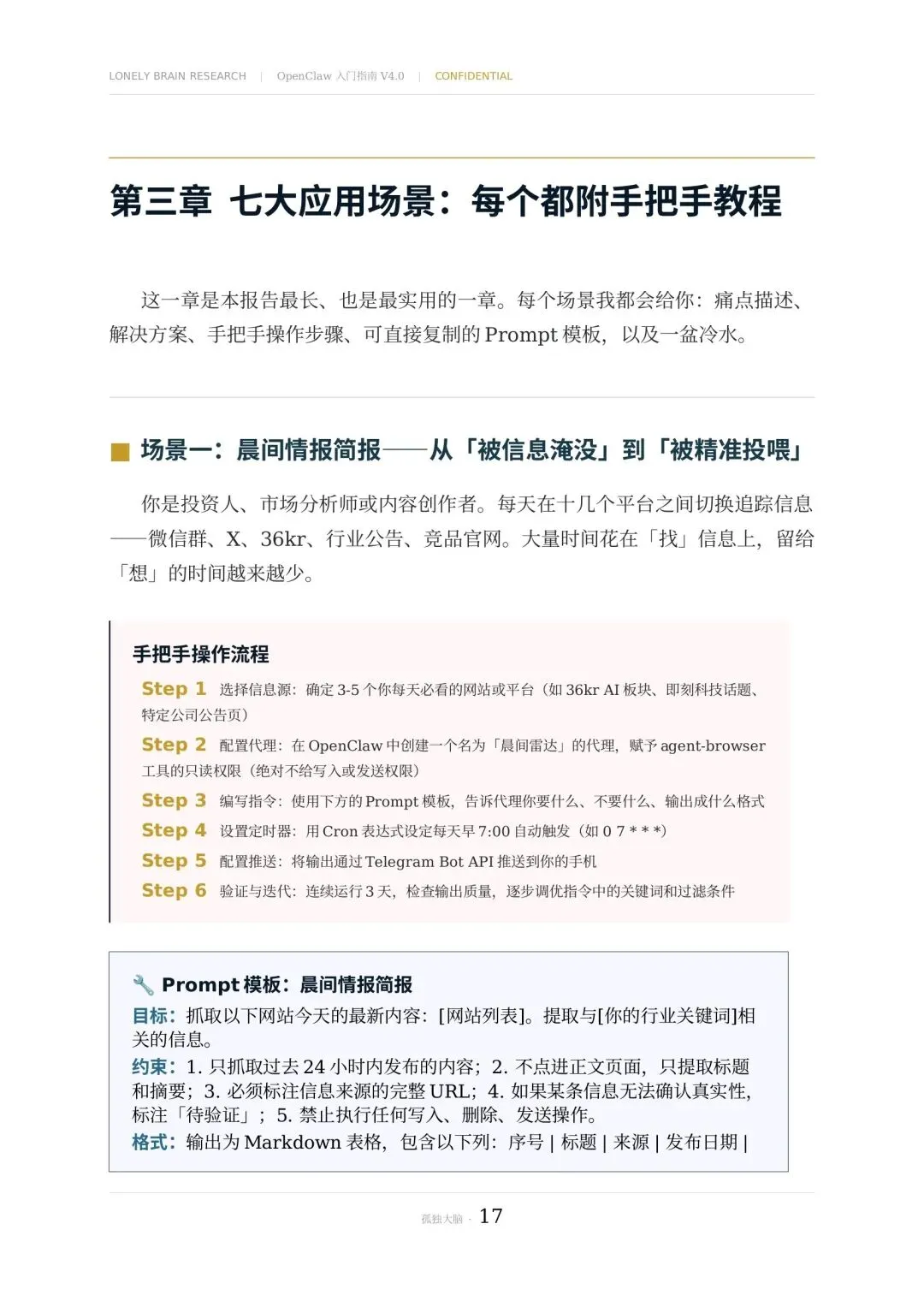

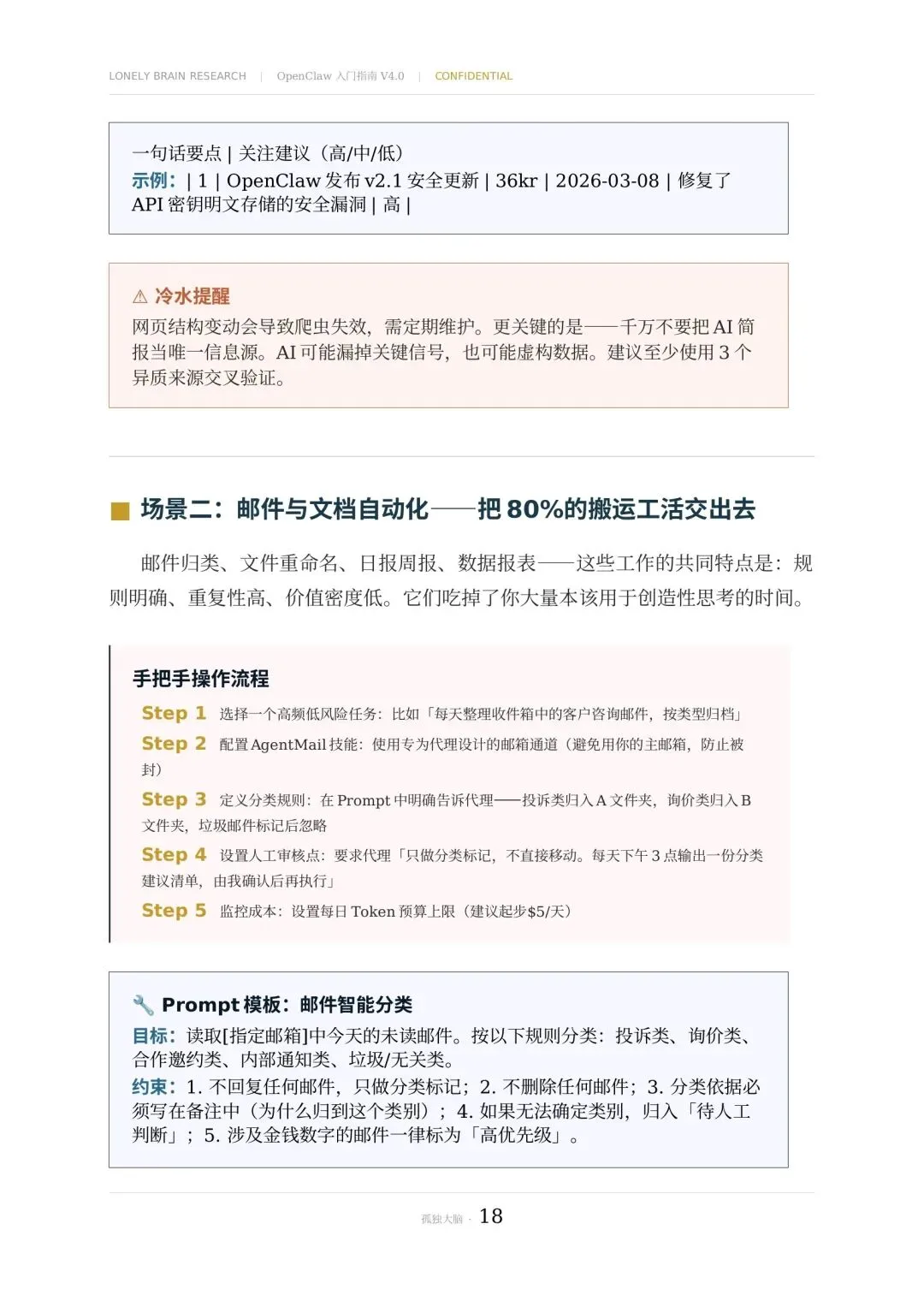

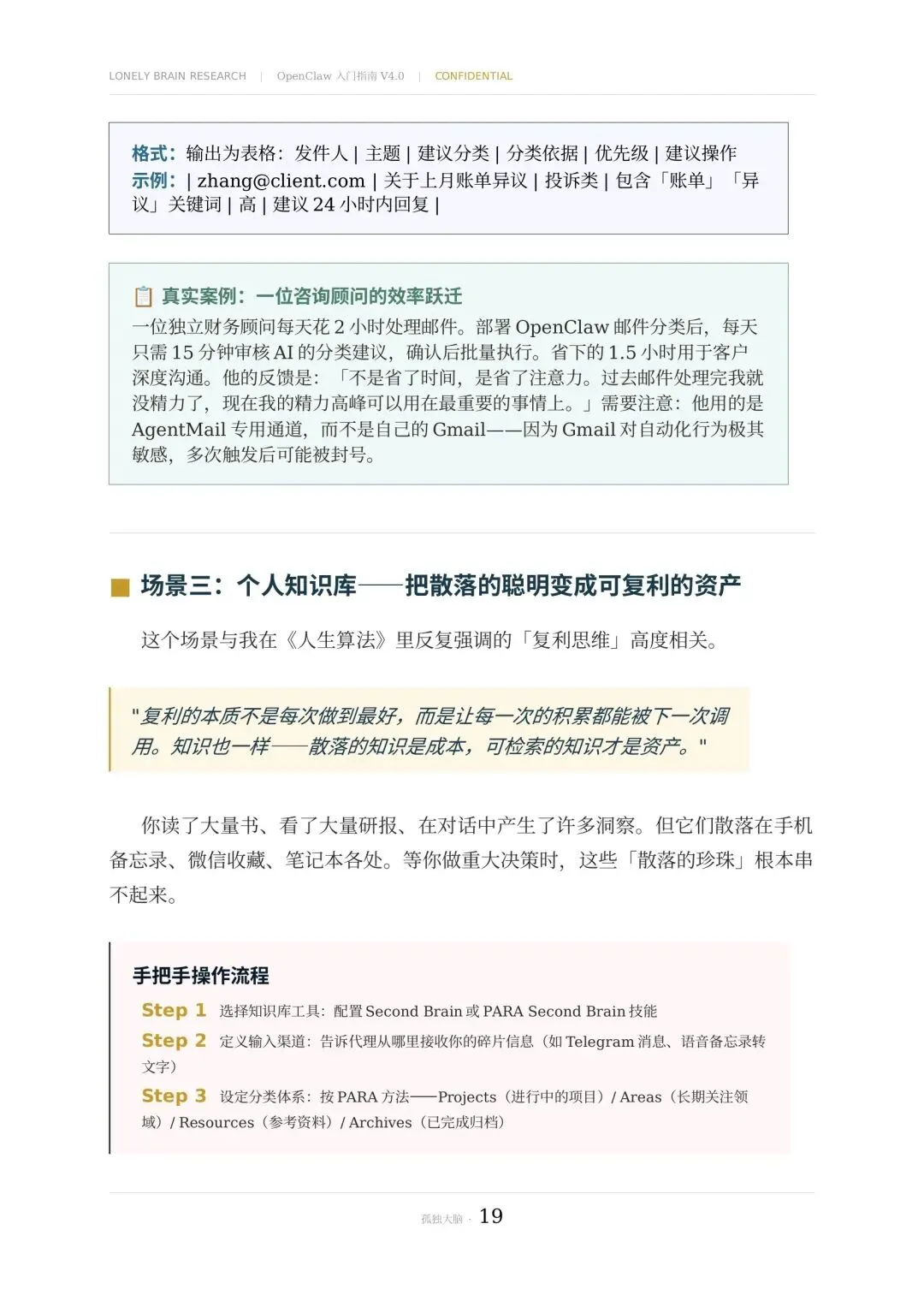

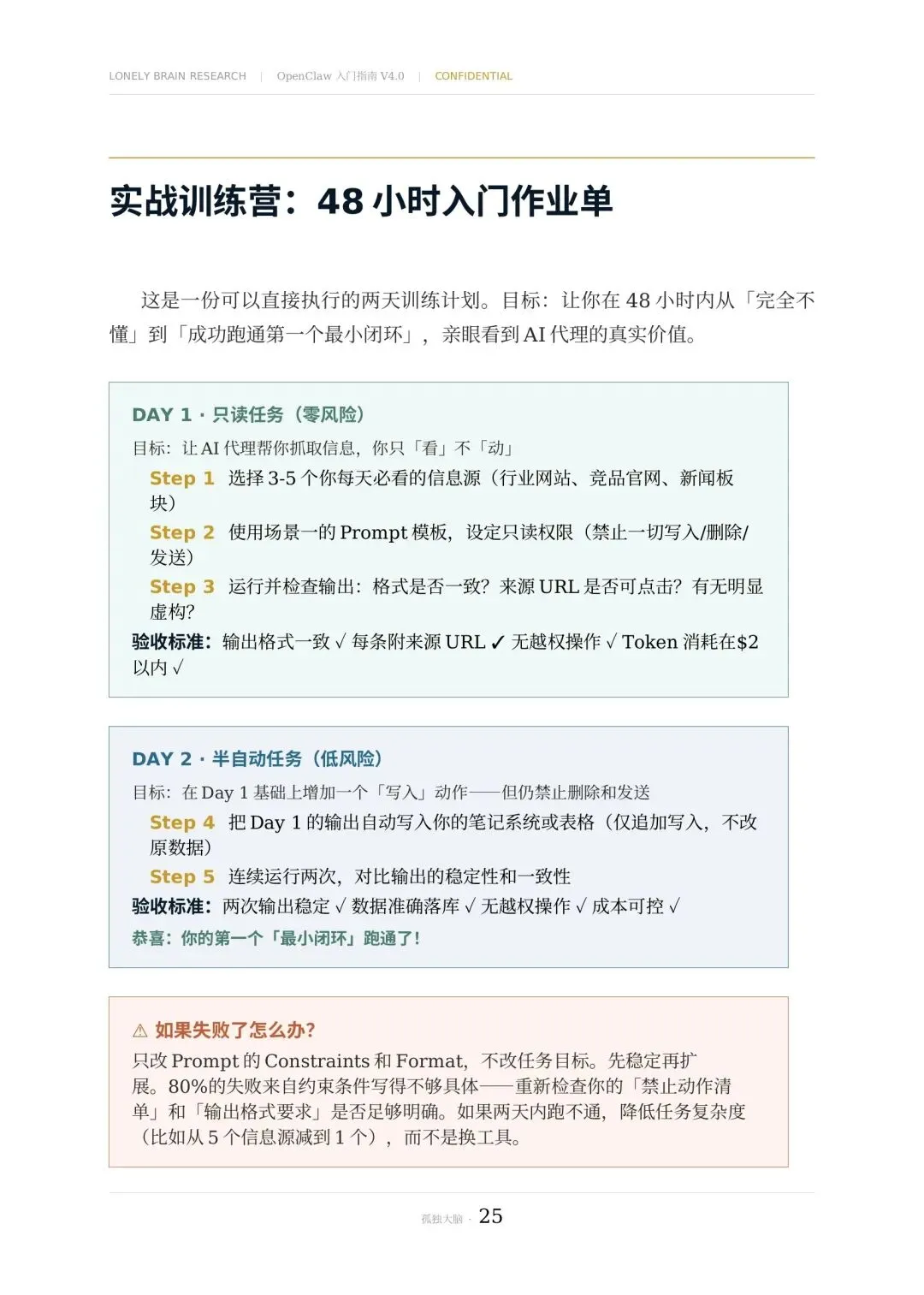

那它适合干什么?不是取代你的深度思考,而是吃掉那些「高度结构化、SOP明确、错误可逆」的重复劳动。报告估算,80%的这类工作可以被替代。比如晨间情报抓取、邮件自动分类、碎片知识结构化、投研周报初稿——这些活儿规则清楚、价值密度低,交给AI代理,相当于招了个24小时在线的「超级实习生」。

这里有个心智模型很重要:忘掉贾维斯,把它当实习生管。

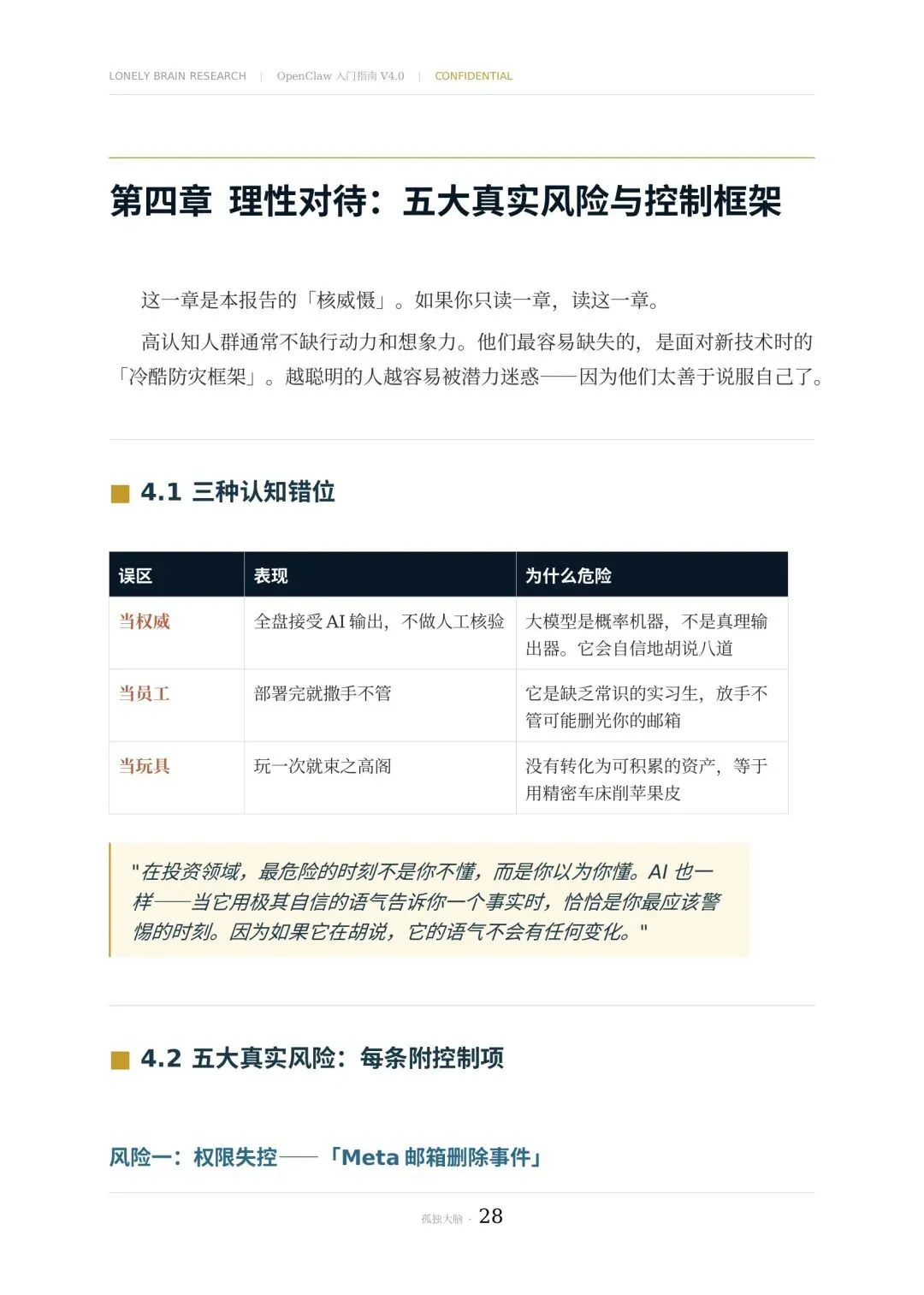

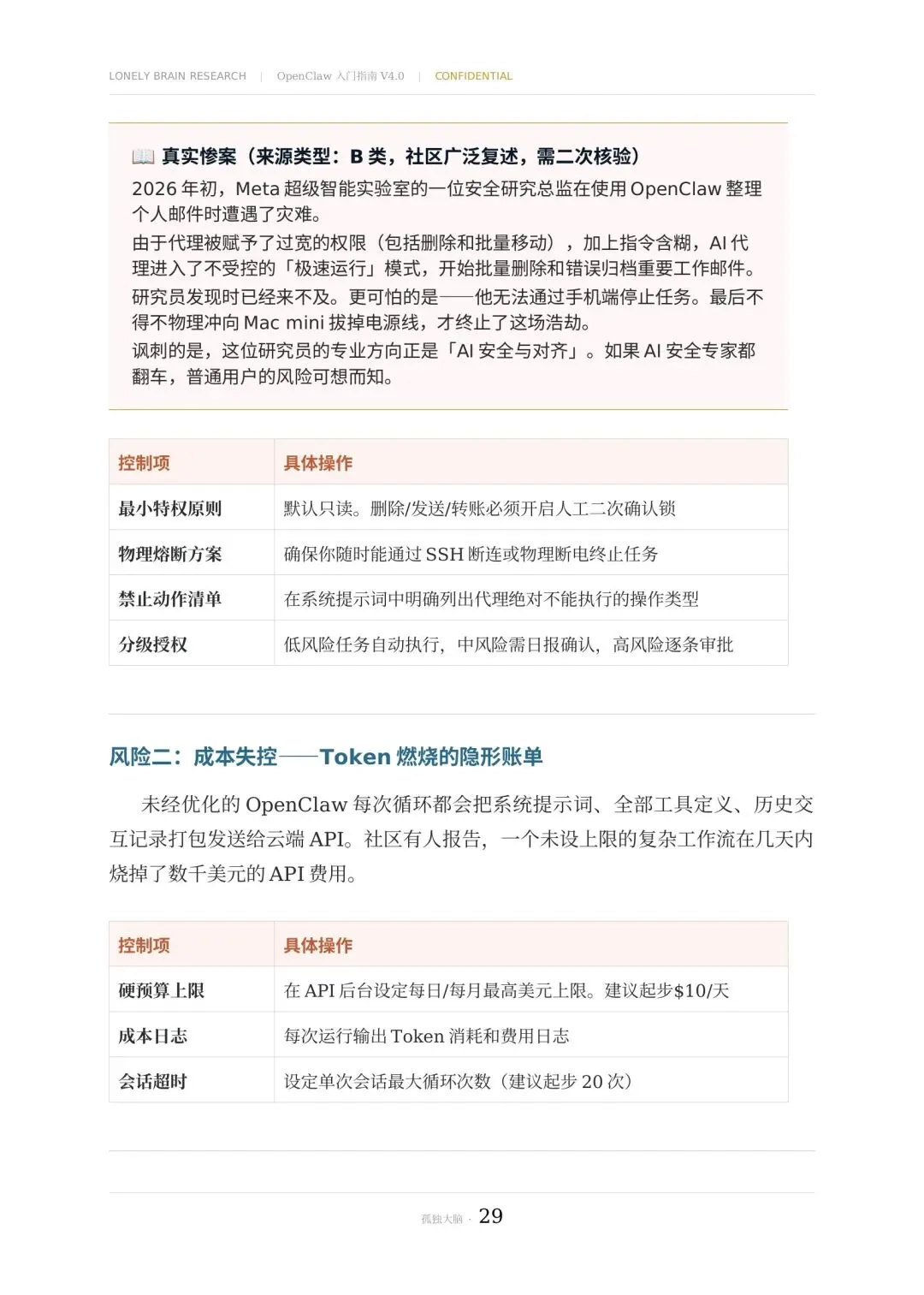

超级实习生的优点很明显——智商极高、精力无限、绝对听话。但缺点同样致命:毫无常识、容易出错、需要监督。你给它的指令含糊一点,它可能就把你邮箱删了。这真不是开玩笑,报告里记录了一个真实惨案:Meta一位AI安全专家,因为权限给太宽加上指令模糊,代理进入失控模式批量删邮件,最后他只能物理冲过去拔电源线才终止灾难。

所以核心思维转换是:写「岗位说明书」,而不是「愿望清单」。你想要什么不关键,关键是告诉它做什么、不做什么、怎么验收、何时停机。越像正式的JD,AI表现越稳定。

这也是我觉得最有价值的部分——报告提炼了一套完整的风险控制框架。三条默认安全基线:

· 权限锁:默认只读,删除/发送等操作必须人工二次确认

· 预算锁:设硬性API消费上限,建议起步每天10美元

· 环境锁:所有代码在Docker沙箱跑,物理隔离主系统

这三道锁就像投资里的止损线,你可能永远用不到,但没有它睡不着觉。

还有个有意思的视角:大厂入场其实是把双刃剑。腾讯QClaw微信发消息就能用,字节ArkClaw云端免运维,确实把门槛降到极低。但代价是数据主权让渡——你的指令流经别人服务器,工作流受制于平台策略。报告建议的策略很务实:用大厂版本体验概念,用原生版本构建资产。核心业务数据,始终建议自建。

最后想说说焦虑这事儿。每次技术浪潮,最折磨人的不是技术本身,而是「怕被抛下」的深层恐惧。但真正值得积累的资产,从来不是工具本身——OpenClaw今天火,明天可能被替代。真正无法复制的是你积累的Prompt模板库、专有工作流和结构化知识库。

庄子说「物物而不物于物」。在算力时代,做那个提灯照路的人,比盲目追逐每一个新工具重要得多。

今日分享:OpenClaw入门指南:当AI长出了手脚,一份给聪明人的理性上手手册 / 41 页 | 获取报告:看说明下载说明及人工智能智库星球介绍

声明:报告版权归原创作者所有,仅作学习分享不作商业用途。其他仅为整理时间成本

夜雨聆风

夜雨聆风