AI 智能体安全配置指南:以 OpenClaw 为例

2026 年 3 月,CNCERT 发布了一份关于 AI 智能体安全的技术报告。报告中提到,某些 AI 智能体框架的默认安全配置可能存在风险。

这条消息在技术圈内引发了一些讨论。但讨论归讨论,真正重要的是:作为用户,我们应该如何正确配置,确保自己的 AI 智能体系统安全可靠?

今天,我们就以 OpenClaw 为例,详细讲解 AI 智能体的安全配置最佳实践。

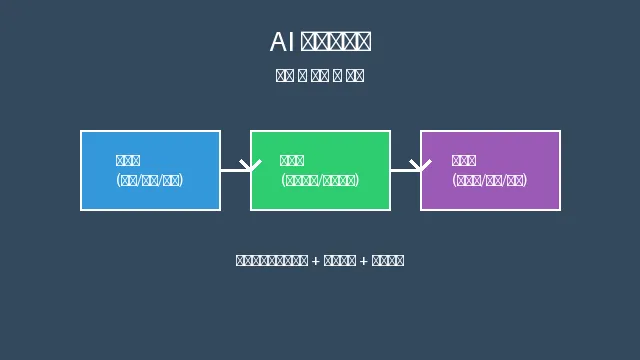

一、AI 智能体常见安全风险

在深入配置之前,我们先了解一下 AI 智能体系统可能面临的安全风险。

1. 权限管理不当

AI 智能体需要执行各种任务,但如果权限设置过大,可能带来风险:

文件系统访问权限过大,可能误删重要文件 网络访问权限过大,可能泄露敏感信息 系统命令执行权限过大,可能被恶意利用

2. 网络暴露风险

很多 AI 智能体框架默认开放网络接口,方便远程调用。但这可能带来:

未授权访问:任何人都可以调用你的 AI 智能体 数据泄露:敏感数据可能被截获 恶意利用:AI 智能体可能被用来执行恶意任务

3. 沙箱隔离不足

AI 智能体的操作如果没有适当的隔离,可能影响宿主系统:

文件系统污染:AI 智能体可能修改系统配置 资源耗尽:AI 智能体可能占用过多系统资源 安全边界模糊:AI 智能体可能访问不该访问的资源

4. 审计日志缺失

没有完整的操作日志,出现问题时无法追溯:

无法定位问题源头 无法分析攻击路径 无法进行合规审计

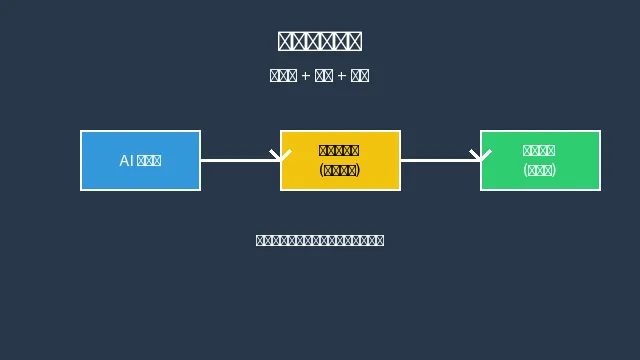

二、OpenClaw 安全配置最佳实践

了解了风险,我们来看如何正确配置 OpenClaw,确保系统安全。

1. 修改默认配置

永远不要使用默认配置运行 AI 智能体。

在 OpenClaw 的配置文件中,修改以下关键设置:

- 更改默认端口

:不要使用默认的网络端口 - 启用身份验证

:配置 API Key 或其他认证方式 - 限制访问 IP

:只允许信任的 IP 地址访问 - 关闭不必要的功能

:只启用需要的功能模块

2. 权限分级管理

遵循最小权限原则:只给 AI 智能体完成任务所需的最小权限。

在 OpenClaw 中,可以配置不同级别的权限:

- 只读权限

:只能读取文件,不能修改 - 工作区权限

:只能访问指定的工作目录 - 完全权限

:可以执行所有操作(仅限可信环境)

建议:开发环境使用工作区权限,生产环境根据实际需求精细配置。

3. 网络访问控制

严格控制 AI 智能体的网络访问。

在 OpenClaw 中,可以配置:

- 白名单模式

:只允许访问指定的域名或 IP - 代理配置

:通过网络代理监控和过滤流量 - 禁用外网访问

:完全隔离,只允许本地操作

建议:除非必要,否则禁用外网访问。

4. 沙箱隔离

使用沙箱隔离 AI 智能体的操作。

OpenClaw 支持多种沙箱模式:

- 文件系统沙箱

:限制 AI 智能体只能访问指定目录 - 进程沙箱

:限制 AI 智能体只能执行指定的命令 - 网络沙箱

:限制 AI 智能体的网络访问范围

建议:生产环境必须启用沙箱隔离。

5. 安全审计日志

启用完整的操作日志,便于追溯和审计。

在 OpenClaw 中,可以配置:

- 操作日志

:记录 AI 智能体的所有操作 - 错误日志

:记录所有错误和异常 - 安全日志

:记录所有安全相关事件

建议:日志至少保留 90 天,便于安全审计。

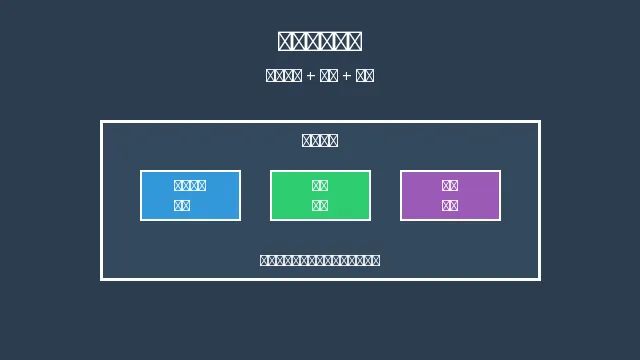

三、企业级安全建议

对于企业用户,还需要考虑更多的安全措施。

1. 多环境隔离

开发、测试、生产环境必须严格隔离。

使用不同的配置文件 使用不同的 API Key 使用不同的网络环境 禁止跨环境访问

2. 定期更新

保持 OpenClaw 和相关依赖的最新版本。

定期检查和更新 OpenClaw 版本 及时修复已知的安全漏洞 关注安全公告和更新通知

3. 员工培训

提高员工的安全意识。

不要共享 API Key 和配置文件 不要在不安全的环境中使用 AI 智能体 发现安全问题及时报告

4. 应急预案

制定安全事件的应急预案。

定义安全事件的响应流程 指定安全责任人 定期演练应急预案

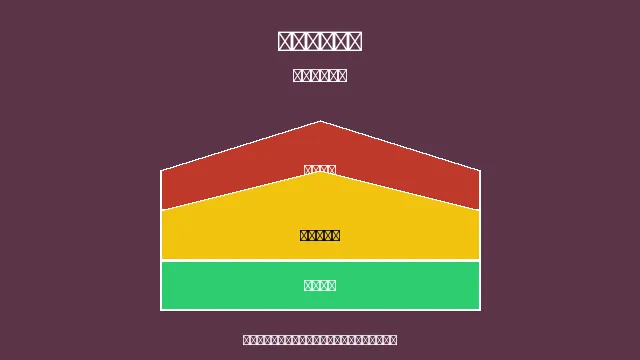

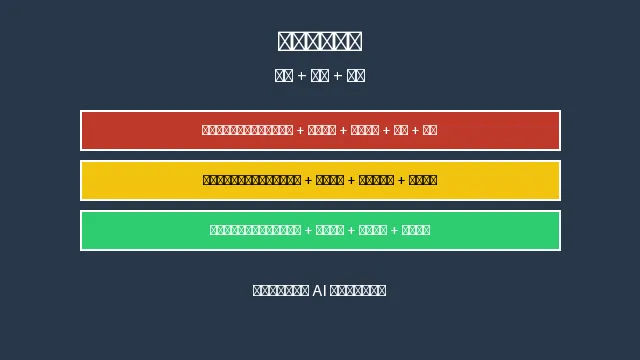

四、安全检查清单

最后,我们提供一份安全检查清单,帮助你快速评估 OpenClaw 的安全配置。

基础安全(必须)

☐ 已修改默认配置 ☐ 已启用身份验证 ☐ 已配置权限分级 ☐ 已启用沙箱隔离 ☐ 已启用操作日志

进阶安全(推荐)

☐ 已配置网络白名单 ☐ 已配置代理过滤 ☐ 已配置多环境隔离 ☐ 已制定应急预案 ☐ 已进行员工培训

企业安全(可选)

☐ 已配置安全审计系统 ☐ 已配置入侵检测系统 ☐ 已进行渗透测试 ☐ 已通过安全合规认证

写在最后

AI 智能体的安全是一个持续的过程,不是一次性的配置。

随着技术的发展和威胁的演变,我们需要不断更新安全知识,调整安全策略,确保 AI 智能体系统始终处于安全状态。

OpenClaw 作为开源的 AI 智能体框架,将持续改进安全能力,为用户提供更安全、更可靠的使用体验。

安全是 AI 智能体的基石。正确配置,安心使用。

参考资料

CNCERT 2026 年 3 月技术报告 OpenClaw 官方安全文档 AI 智能体安全最佳实践指南

延伸阅读

《Physical AI 工业化:Microsoft 与 NVIDIA 的生态之战》 《家庭机器人爆发之年,为什么中国开源框架成了标配?》

夜雨聆风

夜雨聆风