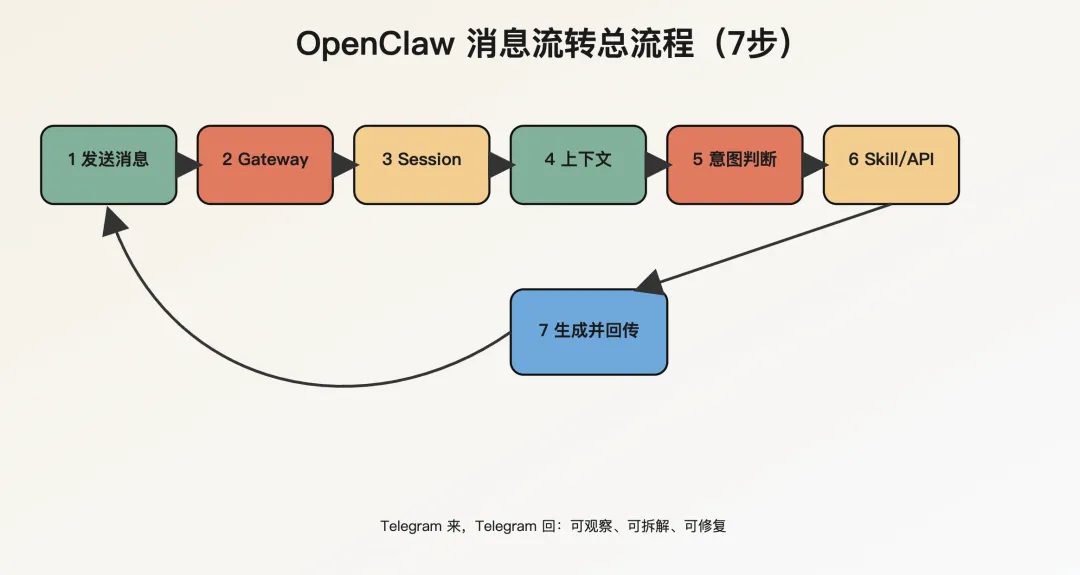

其实在 OpenClaw 里,这句话会触发一整条流水线。

比如你在 Telegram 输入: “帮我查下明天的天气。”

从按下发送,到看到回复,中间不是“AI 想了想”这么简单, 而是网关接入、会话路由、上下文装配、模型判断、工具调用、结果回传,一步接一步地跑完。

今天讲讲 OpenClaw 里,一条消息从输入到输出的完整流转路径。

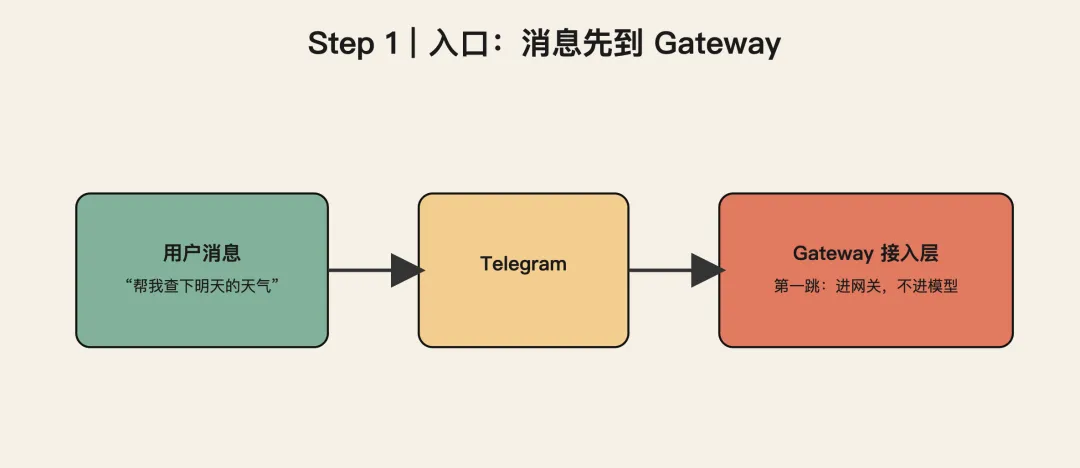

第一步:用户发送消息

你在 Telegram 里输入问题,点发送。

这条消息不会直接到模型, 而是先到 Gateway。

你可以把 Gateway 理解成“门口接待员”: 先把消息接住,再分给后面的人处理。

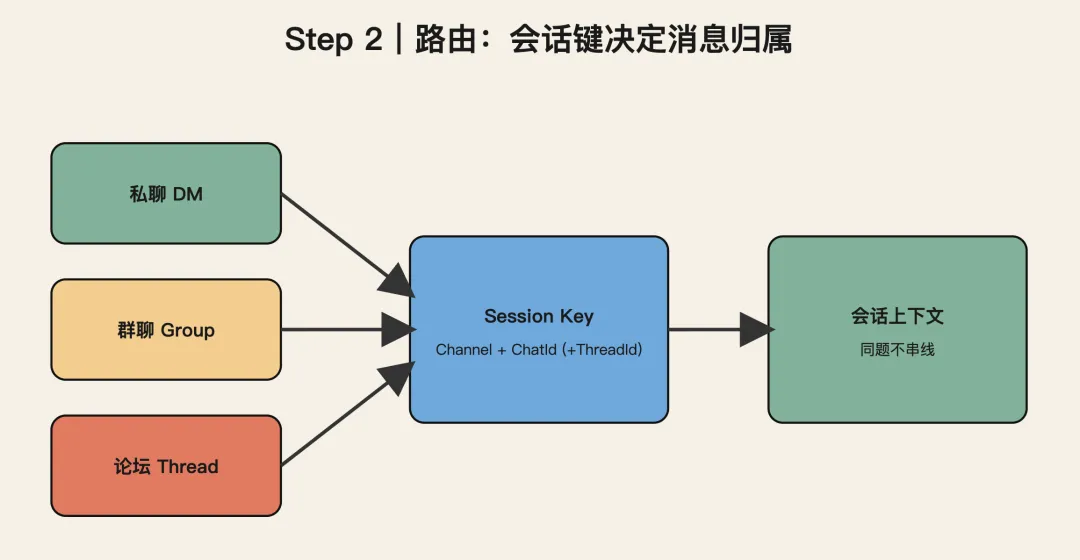

第二步:创建会话

Gateway 收到消息后,会先建一条对话记录(会话)。

简单说就是: 系统先记住“这句话是谁说的、在哪个聊天里说的”。

然后把这条消息转给后端 Agent。

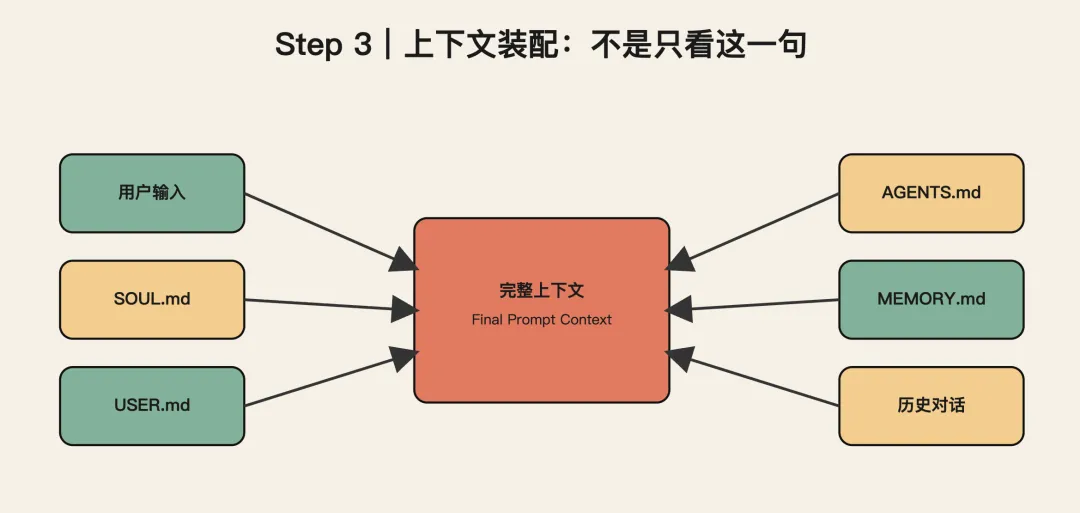

第三步:Agent 读取上下文

Agent 不会只看你这一句话。

它会先读一些关键内容,比如:

SOUL.md(这个 Agent 的性格和说话风格)USER.md(你的用户信息)MEMORY(历史对话和记忆)

所以它回答时,是“结合上下文”在回答, 不是只看当前一句。

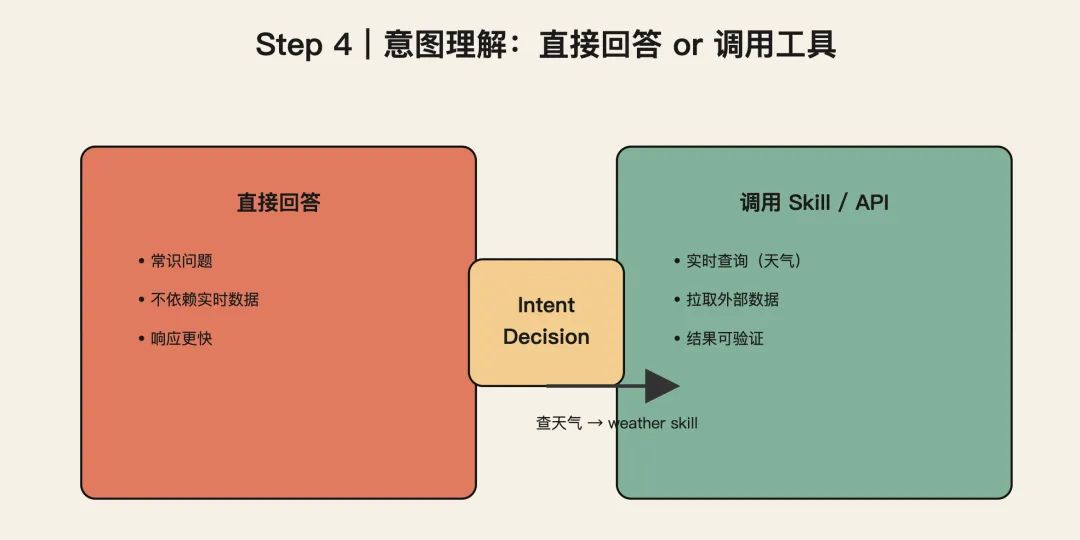

第四步:LLM 理解你的意图

接下来 Agent 会调用大语言模型,判断你到底想做什么。

在“查天气”这个例子里,模型会识别: 你的需求是“获取实时天气数据”。

于是它决定调用对应的 weather skill。

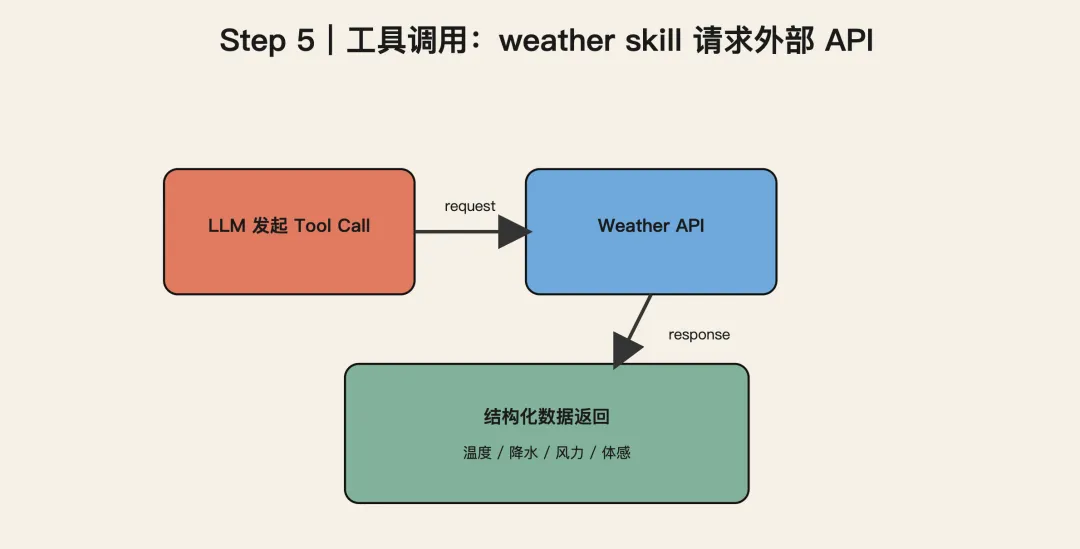

第五步:调用技能接口

weather skill 会去请求天气 API。

它会拿到具体数据,比如:

- 温度

- 天气情况(晴/阴/雨)

- 风力信息

这一步就像“去外面查资料,再带回来”。

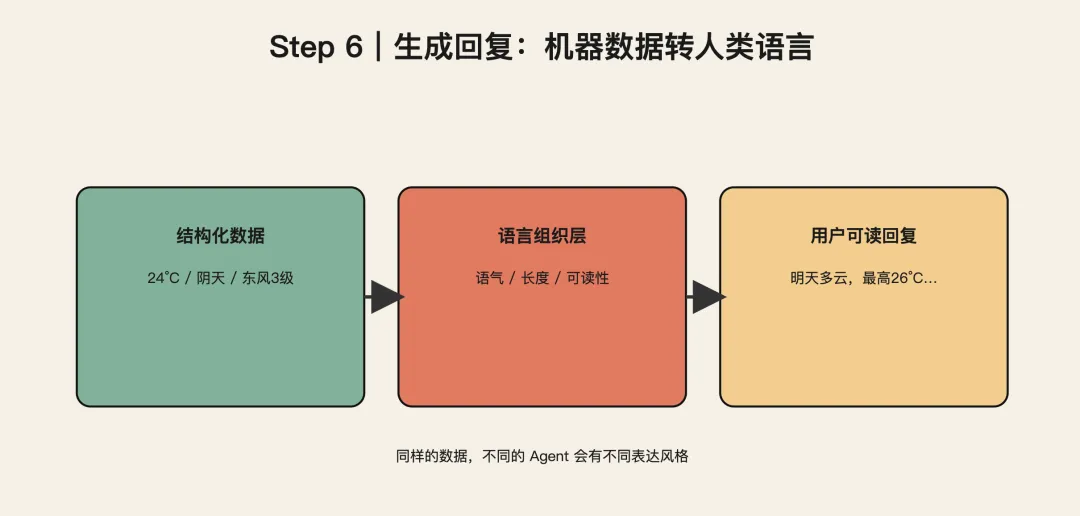

第六步:生成最终回复

Agent 拿到天气数据后, 会把这些数据整理成你能直接看懂的一句话。

比如: “明天多云,最高 26°C,东风 3 级,出门建议带薄外套。”

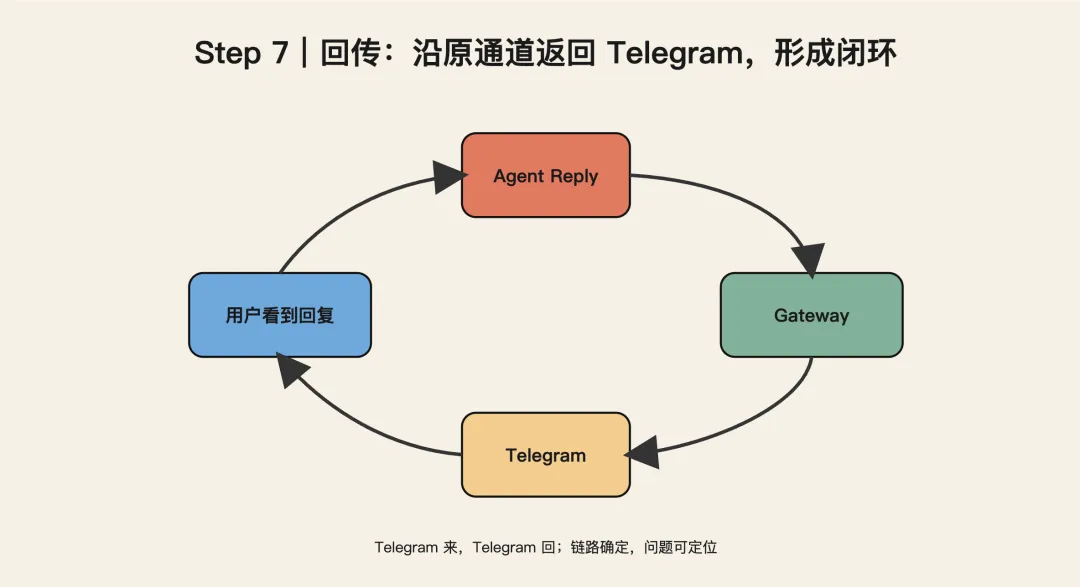

第七步:把结果发回给你

最后,回复会通过 Gateway 发回 Telegram。

你就在聊天窗口看到最终答案。

到这里,一次完整流程就结束了。

一句话总结

你看到的是“发一句,回一句”。

系统内部其实做了这 7 件事:

- 接收消息

- 创建会话

- 读取上下文

- 理解意图

- 调用技能

- 生成回复

- 返回给用户

整个过程是自动完成的。

这就是 OpenClaw 里,一条消息从输入到输出的完整流转路径。

如果你正在跑OpenClaw,但是不知道干什么或者跑不稳,我建了一个 OpenClaw 实战交流群,欢迎加入。主要聊三件事:

- OpenClaw实际应用场景

- 真实工作流拆解(从“能跑”到“稳定跑”)

- 每周案例复盘(含配置与踩坑记录)

进群方式:

回复关键词:OpenClaw

夜雨聆风

夜雨聆风