🦞 旧电脑焕新记:我在旧电脑上搭建本地AI助手的完整攻略

哈喽,今天想跟你们聊聊一个特别有意思的折腾:把家里吃灰的旧电脑变成一台本地AI服务器!

没错,就是那个最近火遍全网的"龙虾"——OpenClaw。我花了整整一个下午,总算是把整个流程跑通了。今天就把这份完整的攻略分享给你们,保证你们也能跟着一步步搞定!

💡 为什么要折腾这个?

说实话,我之前一直在想一个问题:我家里有好几台旧电脑,配置吧还行,i5、i7的处理器,8-16GB内存,有的甚至还带了张GTX 1060显卡。但是!现在这些电脑基本就是摆设,要么扔在角落里吃灰,要么就是开着当下载机用。

你们说,资源浪费不浪费?

然后我就琢磨,现在AI这么火,要是能用这些旧电脑跑一个本地AI助手,那多酷啊!最主要的是,本地部署在物理上能起到安全隔离的效果,你的那些敏感数据完全不用经过云端,就在自己家里,这隐私保护杠杠的!

再加上,如果专门开一台电脑做AI服务,平时用其他电脑访问它,AI任务完全不影响日常使用,这不比买一台高配电脑划算多了?

于是乎,说干就干!

🖥️ 先说说我的"试验田"

先让你们看看我的硬件配置:

CPU:好几年前的i5或者i7处理器(古早Surface)

内存:8GB到16GB不等

显卡:有的是GTX 1060,有的干脆就是集成显卡

讲真,这配置在今天确实有点落伍了。但我还是想试试,说不定就成了呢?

📋 开整!安装前准备

需要下载的软件

工欲善其事,必先利其器。在开始安装之前,这些软件必须先准备好:

软件 | 版本 | 去哪下载 |

Cherry Studio | 最新版(一定要官网下载,否则里面可能没有openclaw) | 官网传送门 https://docs.cherry-ai.com/cherry-studio/download |

Node.js | v22.13.1-x64 () | 戳这里 |

Git | 2.53.0-64-bit | 官网直接下载 |

⚠️ 敲黑板!版本号很重要! 我当时就是没注意版本,结果踩了不少坑,返工N小时。建议大家严格按照这个版本来,稳定性有保障。

腾讯出了一个Qclaw,但是现在邀请制,咱不稀罕。

学习资料

OpenClaw官方教程:https://ollama.com/blog/openclaw-tutorial (这个必须看!)

🔧 安装过程:一步步跟我来

第一步:前置准备工作,Node.js和Git,这两个必须装!

Node.js安装

打开 https://nodejs.org/zh-cn/download

下载 node-v22.13.1-x64 这个版本(Windows Installer .msi)

运行安装程序,一定要勾选"Add to PATH"这个选项!

安装完成后,打开命令行,输入

node -v,看到版本号就算成功了

Git安装

下载 Git-2.53.0-64-bit 版本

运行安装程序,我推荐这么选:

编辑器选 Vim 或者 VS Code 都行

PATH环境变量一定要选 "Git from the command line and also from 3rd-party software"

完成后在PowerShell里输入

git --version验证一下

💡 小贴士:这两个是基础中的基础一定要装!OpenClaw能不能跑起来就靠它们了。

第二步:Cherry Studio安排上!

这可是今天的主角之一!Cherry Studio就是那个让你管理AI模型的界面工具。

访问 Cherry Studio 官网下载页面

下载Windows版本,双击安装

一路Next到底就完事儿了

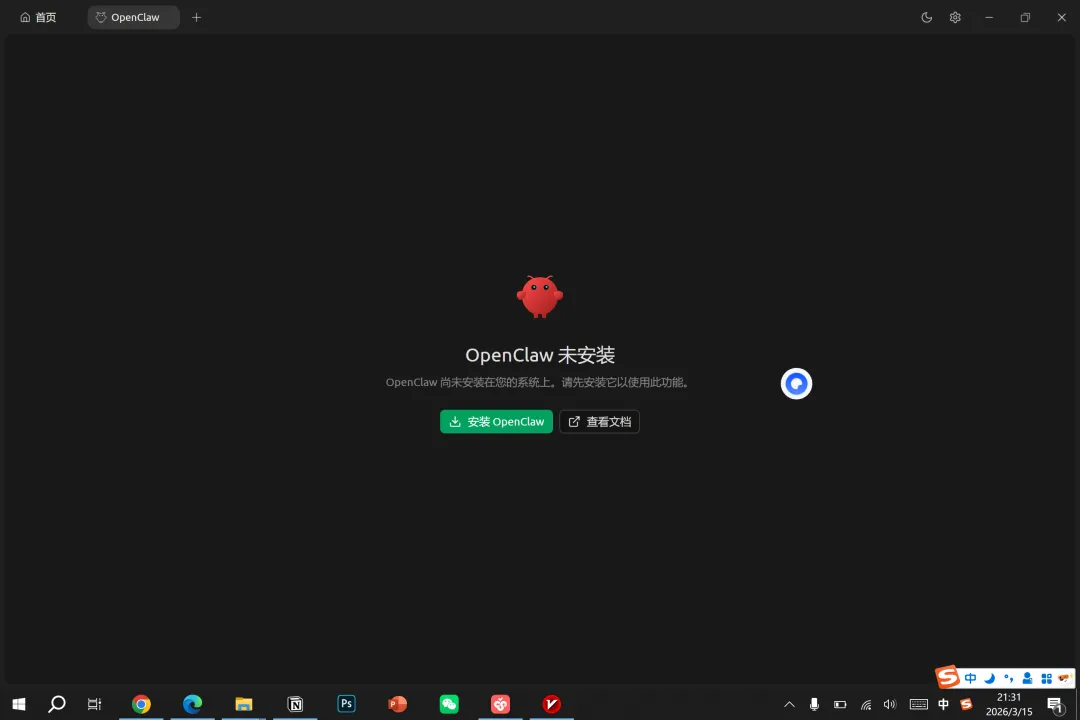

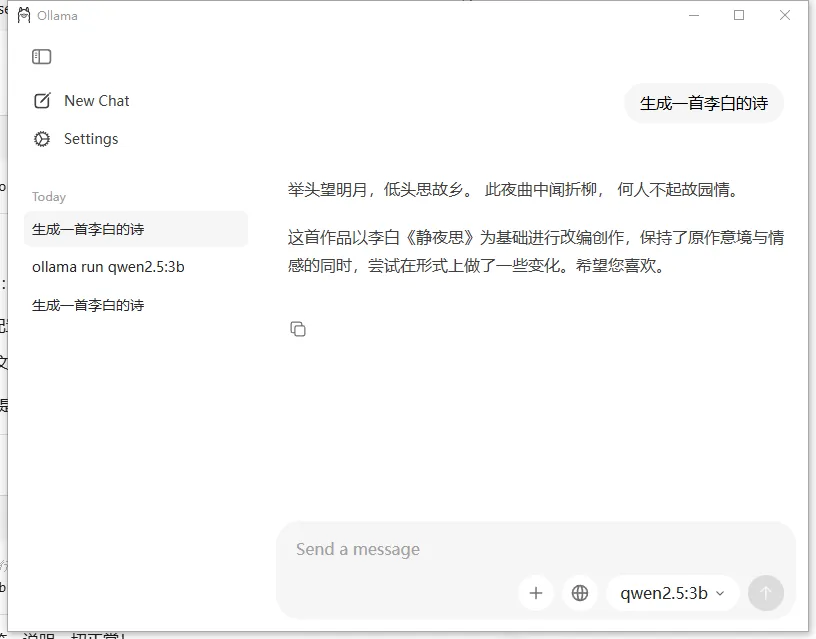

首次启动之后,你会看到这样一个界面:

左边是模型选择和聊天窗口

右上角是设置和配置面板

整体风格还挺简洁大气的

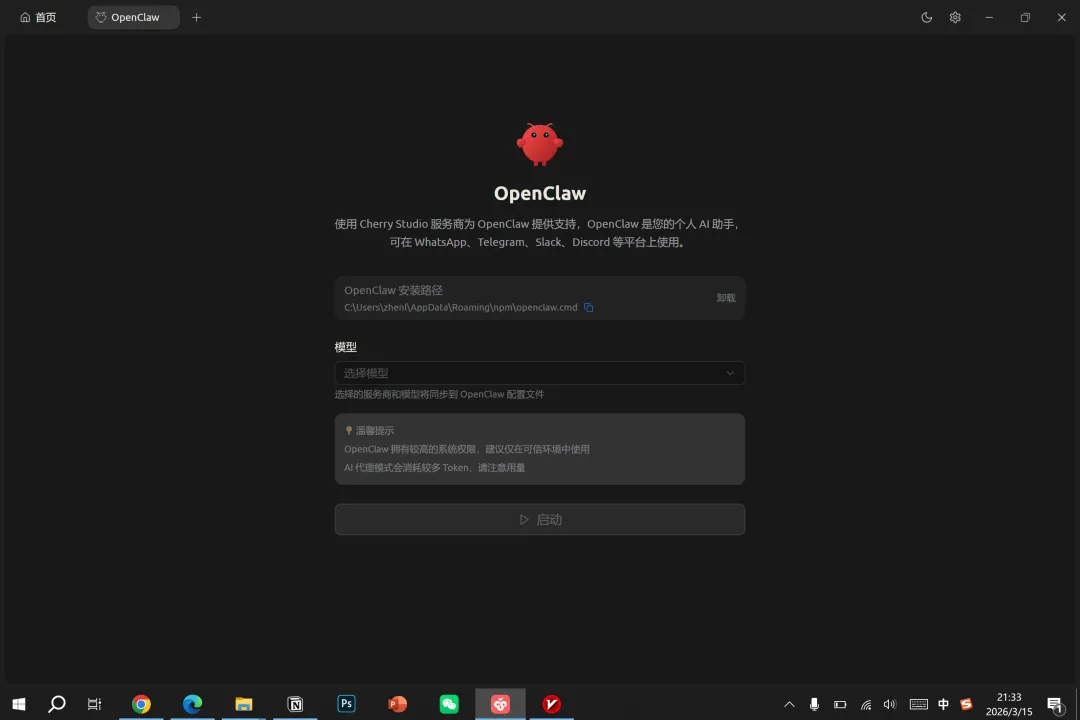

第三步:安装和配置Openclaw,获取API Token!这是最关键的一步!

兄弟姐妹们,这一步绝对不能出错!没有Token,后面的都白搭!

操作步骤:

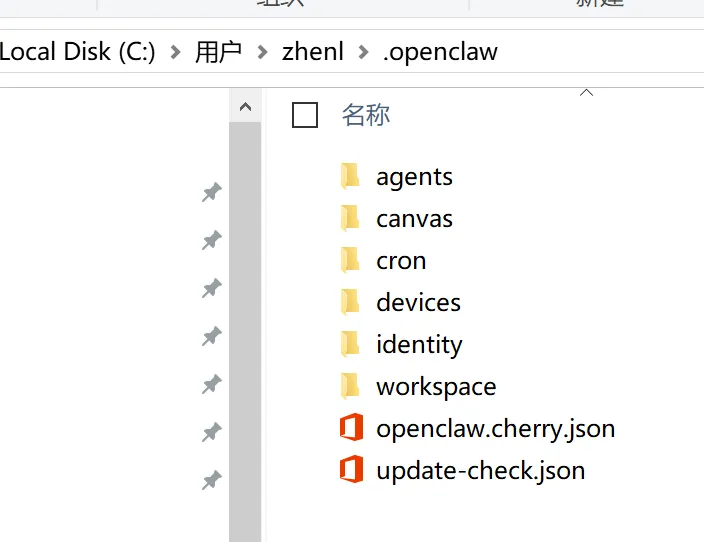

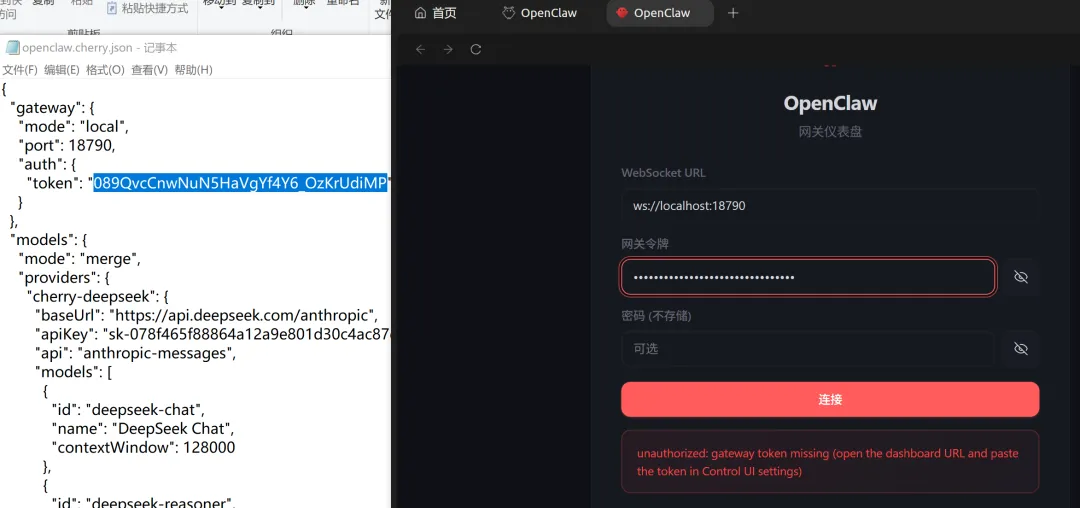

去你本地的openclaw安装文件夹里,用记事本打开openclaw.cherry.json文件,在里面能看到网关令牌(token)。

填入网关令牌。

⚠️ 血泪教训:Token一定要保管好,泄露出去可就不妙了。

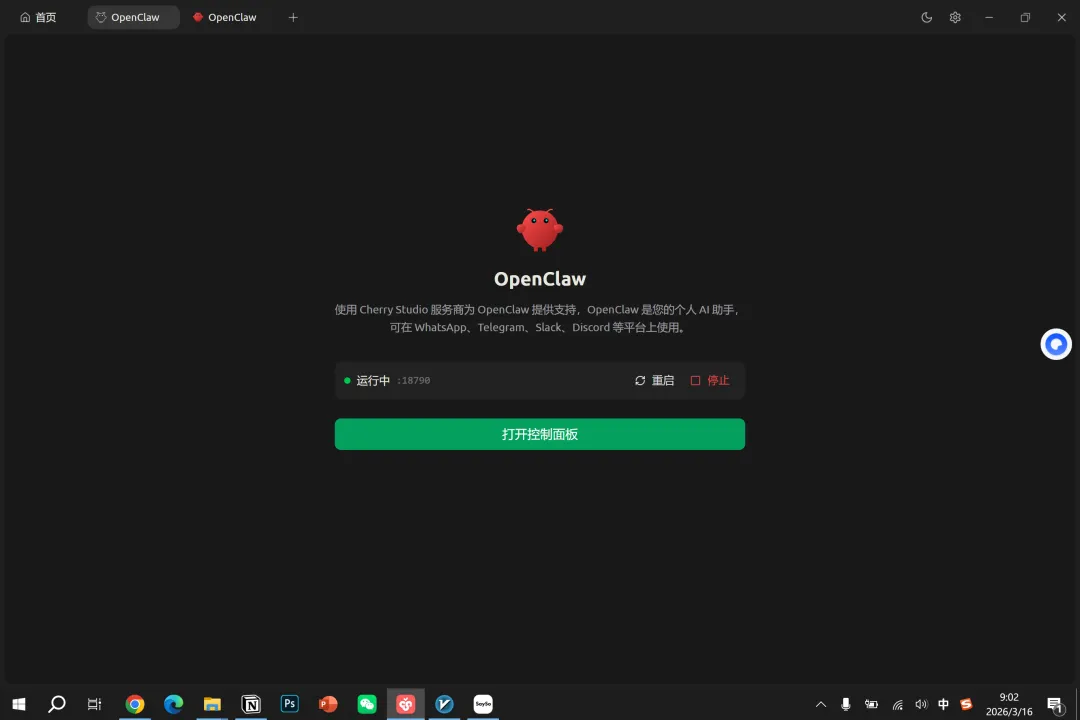

完成了是这个样子。启动按钮点一下。如果出现问题,那就是前面的步骤踩坑了。重复前面的步骤。把出错代码和提示复制给到百度搜索解决方案一步步做,也能最终解决。这个耗时很多。

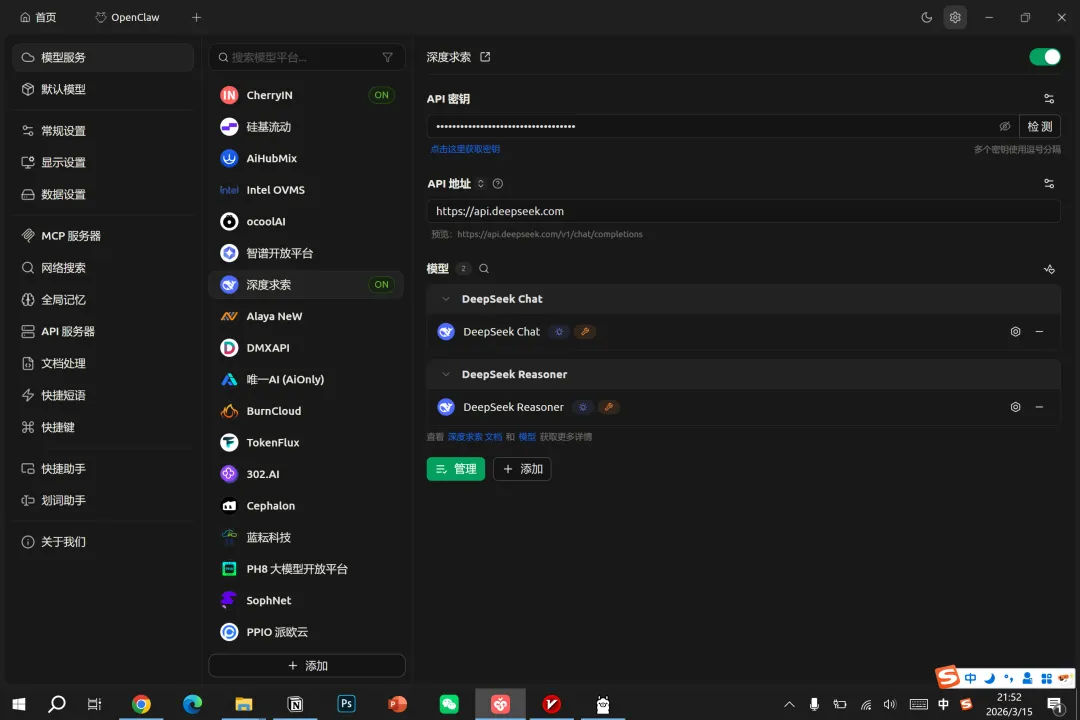

第四步:模型配置搞起来!

Token到手了,现在轮到配置模型了:

打开Cherry Studio,点开设置

找到"模型配置"或者"API设置"

把选择你想用的模型,配起来,用云服务很方便。

目前有千问的免费模型可用。

配置一下连接参数,比如API地址、模型名称之类的,你买过的大模型的API Token粘贴进去,这部分我不赘述

第五步:Ollama安装!本地大模型安排!

重头戏来了!现在我们要通过Ollama来安装本地的大语言模型。

Ollama是一个本地的模型管理软件。

安装之前请确认CUBA的显卡驱动是最新的。这样Ollama在调用大模型的时候才会用你的GPU运算。

Ollama安装

打开 https://ollama.com

下载Windows版本

安装程序一路Next

安装过程中会自动识别你的GPU和环境

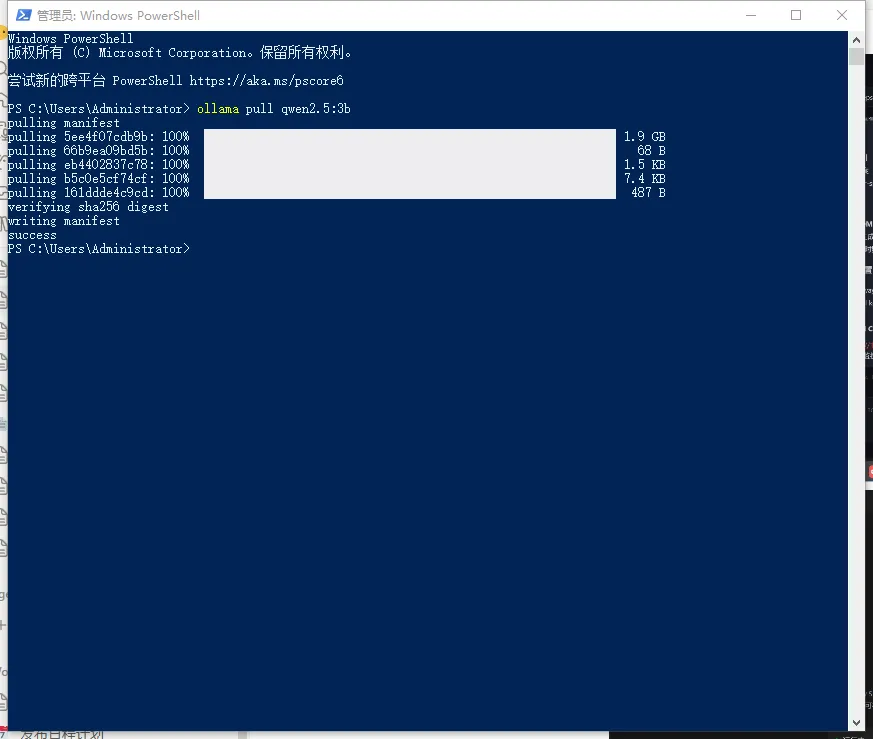

在PowerShell中安装模型(windows里搜索powershell就能找到)

打开PowerShell(不是CMD!),执行这些命令:

代码块

# 先看看有哪些模型可以用

ollama list

# 安装7B模型(内存16GB以上的可以考虑)

ollama pull llama2:7b

# 内存小的同学看这里,装个小一点的模型

ollama pull qwen2.5:0.5b

💡 配置选择建议:

16GB内存:7B模型可以试试

8GB内存:3B或者更小的模型更靠谱

没独立显卡:只能选CPU推理的小模型,别为难自己

配置完成右下角能够识别和选用。Ollama可以用了。

如果几轮对话就卡死的话,那应该就是你电脑的配置不足以支撑这个模型。升级电脑吧,没有特别好的解决方法。

🧪 第一次综合测试:心情忐忑!

好了,所有组件都装完了。深吸一口气,开始测试!

打开Cherry Studio,找到OpenClaw应用

把本地模型连接配置好

输入第一个问题,然后...等待...

你们猜怎么着?

跑起来是这个样子。

对话界面出来了!模型开始思考了!相应速度还是挺快的。它跑起来了!在自己电脑上的AI模型,这种感觉真的太奇妙了!

⚠️ 但现实给了我当头一棒...

高兴了没几分钟,问题就来了...

问题一:内存根本不够用

8GB内存的电脑?那就是个弟弟,根本跑不起来。16GB的稍微好一点,但是系统也变得巨慢无比,感觉随时要宕机。

问题二:响应太慢了

简单的问题要等几十秒,复杂一点的几分钟都有可能。这也太考验耐心了吧!

问题三:上下文太短

0.5B的模型,聊不了几句就超限了。多轮对话?想都别想,根本进行不下去。

问题四:频繁崩溃

想好好聊个天吧,聊着聊着就崩了。GTX 1060在这种计算密集型任务面前就是个弟弟,集成显卡更是连想都不要想。

💭 折腾了半天的感悟

技术真的在进步

说真的,现在AI技术的门槛是真低了啊!放在几年前,谁能想到在自己家电脑上跑AI模型?现在有了Ollama这种工具,普通人也能玩了。虽然安装步骤是多了点,但是有教程跟着走,总能跑起来。

硬件依然是硬伤

但是吧,硬件这关还是过不去。我这配置好几年前还算不错,结果在AI面前完全不够看。这也让我意识到,AI要普及,软件生态固然重要,但硬件性能和成本也得跟上来啊。

换个思路:云端它不香吗?

折腾到最后,我想明白了:对于我们这种普通用户来说,完全本地化目前还是不现实。

但是!OpenClaw连接云端服务不香吗?界面一样好用,响应速度还快,只要网络稳定,体验直接起飞!

✅ 我的最终方案

经过这番折腾,我算是想明白了:

OpenClaw继续用:界面友好,功能强大

连接云端模型:让专业服务器去跑AI计算(用了些方法,已经实测连同了Gemini等国外模型)

享受丝滑体验:响应速度快到飞起

这样组合一下,既能享受AI的便利,又不用被硬件卡脖子。只要网络够快,体验绝对一流!

📊 性能对比表

方案 | 响应速度 | 内存占用 | 隐私性 | 推荐指数 |

本地0.5B | 不好用 | 8GB+ | 最高 | ⭐ |

本地7B | 慢到哭 | 16GB+ | 最高 | ⭐⭐ |

云端连接 | 纵享丝滑 | 忽略不计 | 中等 | ⭐⭐⭐⭐⭐ |

🎬 总结:折腾的意义

虽然这次本地部署AI的尝试最后没完全成功,但是这一趟折腾下来,收获还是蛮大的:

学到了:了解了AI模型运行的基本原理

悟到了:硬件对AI应用的影响太大了

找到了:适合自己的使用方式

我觉得吧,技术这东西就是这样,不断尝试,不断踩坑,最后总能找到一个最适合自己的方案。也许再过个一两年,随着硬件升级和模型优化,在个人电脑上跑本地AI会成为常态。那时候再回想起今天的折腾,也是一段有意思的经历!

所以我的建议是:别死磕本地化,找到适合自己的用法最重要。云端还是本地,能帮你解决问题的就是好方案!

📎 Resources

Cherry Studio:https://docs.cherry-ai.com/cherry-studio/download

Node.js:https://nodejs.org/zh-cn/download

Ollama:https://ollama.com

OpenClaw教程:https://ollama.com/blog/openclaw-tutorial

好了,这就是今天的全部分享!如果你们也有什么有趣的科技折腾经历,欢迎在评论区跟我聊聊!我们下期再见~👋

/ END /

【阅读更多】

夜雨聆风

夜雨聆风