(有图有真相,养🦞第一步,被多维表格权限卡住)

OpenClaw从春节前夕就开始爆火,凭一己之力让Mac mini断供。相较于之前的各种模型遥远的军备竞赛,OpenClaw🦞对我最初的意义是:终于不用自己整理download里面的文件了!(哪怕之前尝试过用Hazel来定义规则自动整理,也没有🦞这么好用,一步到位管理本地文件,解放脑力,我真的记不住这么多版本的文件在哪里)。

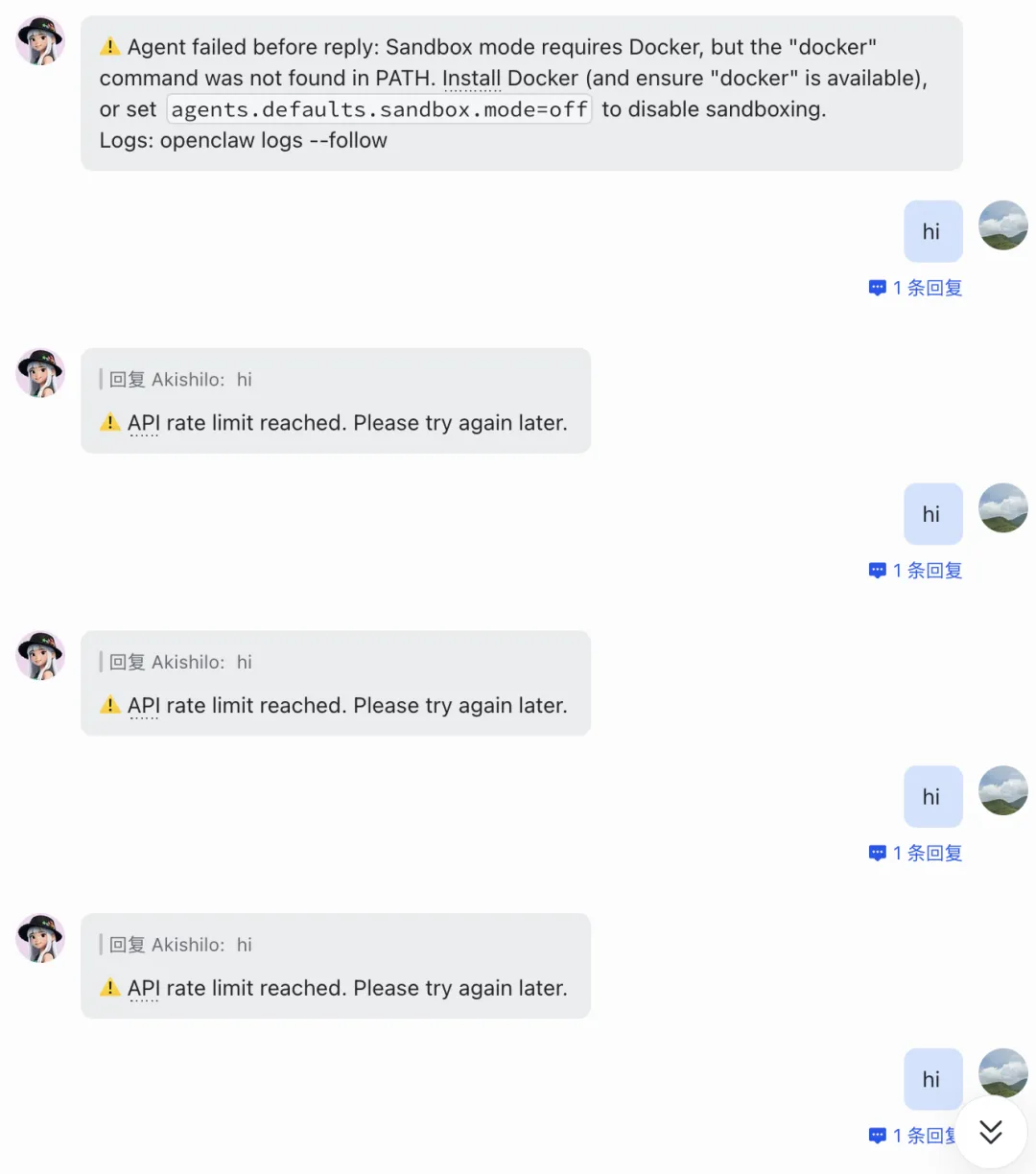

能调用插件、管理文件、浏览网页、执行定时任务,甚至“夜间下达指令、晨间获取成果”,“影分身”同志成为我的第一个“数字牛马”伙伴,虽然它经常掉线让我抓狂,变身罗老师连续不停“在吗,在吗,在吗?”⬇️。

(讲真,谈恋爱都不会这么疯狂发消息祈祷对方会秒回,骚扰到要被拉黑的程度)

也正因为如此,围绕 OpenClaw 的争议,已经不再是“它聪不聪明”,而是“它该被放进什么边界里”、“稳定性如何”。OpenClaw 的高权限、自主执行和插件生态,会带来主机被接管、数据被窃取、言论被篡改和恶意插件投毒等风险,也把讨论热度引向概括成“能力与安全的平衡”。

我开始想,当 AI 开始接任务、碰权限、进流程之后,我的价值如何定义?

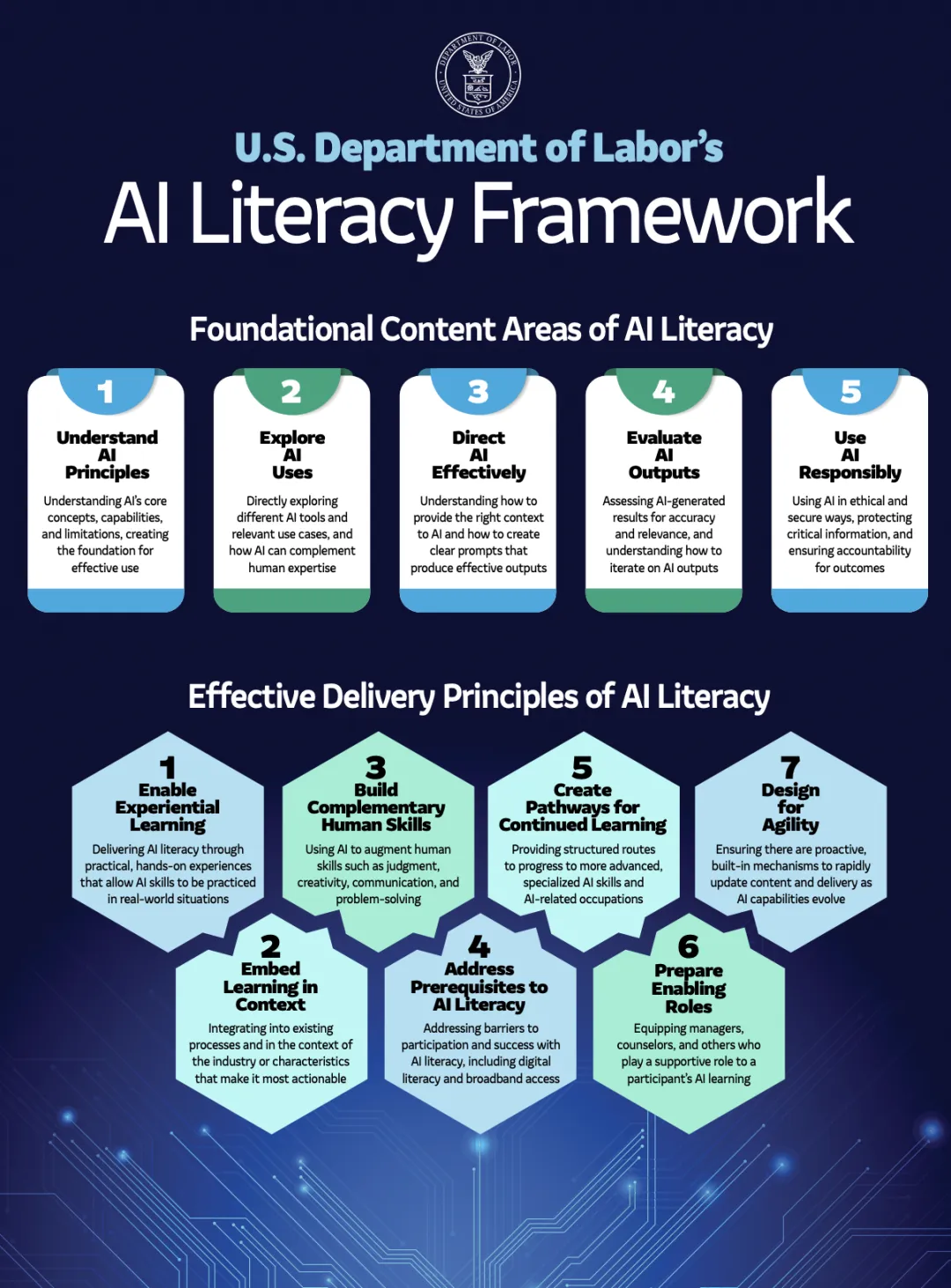

过去谈劳动力,习惯按岗位分层。谁是程序员,谁是运营,谁是助理,谁是管理者。AI 时代,这种分层方式还会存在,但它已经不够了。美国劳工部今年 2 月发布的 AI Literacy Framework,已经把 AI literacy 明确界定为一套面向所有劳动者和学生的基础能力。它不是少数技术岗位的附加技能,而是 AI 嵌入经济之后的“底座能力”。文件同时强调,这只是基础层,很多岗位还会进一步需要更高阶的 AI proficiency,比如管理和构建 AI 系统。

这意味着,未来的劳动力市场不会只按岗位名称分层,而会越来越按一个人与 AI 协作的能力层级分层。至少会出现三层人:

会调用 AI 的人,

会和 AI 稳定协作的人,

会治理 AI 工作流的人。

前者只是把 AI 当工具,后两者才真正进入了新的劳动力结构。这也是为什么,真正的门槛正在悄悄变化。过去一段时间,很多人把 AI 能力理解成会不会写 prompt,会不会让模型帮自己生成文案、表格、代码。这个阶段当然重要,但它很快会变成最基础的部分。

美国劳工部给出的五个 AI literacy 核心内容里,前三项确实包括理解 AI 原理、探索 AI 用途、有效下指令;但后两项更关键,分别是 Evaluate AI Outputs 和 Use AI Responsibly。

也就是说,劳动者不仅要会让 AI 产出内容,还要能判断它是否准确、完整、适合任务,并在伦理、安全、隐私和责任边界内使用它。

这一点非常重要。因为真正稀缺的是对 AI 结果负责的能力。毕竟AI无法背锅,跟老板和同事说“基于我的调查,事实确实如此,我也不知道咋整”(be like B站职场卸博操里,前总统是大羊驼)。

OpenClaw 这个热点,恰好把这个问题变得非常具体。普通聊天机器人出错,很多时候只是答非所问。可一旦像 OpenClaw 这样的智能体开始拥有插件、权限、记忆和主动触发能力,出错的含义就变了。它不只是“说错”,而是可能真的改错文件、碰错数据、发错信息、执行错动作。当 AI 从内容生成器变成流程参与者,人类的角色就必须从“使用者”升级为“管理者”。

过去,一个人值不值钱,往往看他能不能亲自完成任务。 以后,一个人值不值钱,会越来越看他能不能:

定义什么任务该交给 AI,什么任务不能交给 AI

判断 AI 产出的结果可不可用,值不值得信

在 AI 偏航、越权、失真时及时接管

最终对质量、风险和后果负责

这也是为什么美国劳工部在 AI literacy 的交付原则里,专门强调要建立 continued learning 路径,并把 AI literacy 与更深层的岗位技能、AI 相关职业路径连接起来;同时又强调 AI 应当增强人的判断、创造、沟通和领域知识,而不是替代这些能力。

AI 工具不是独立发挥固定价值的能力,它们是对人类输入的放大器,其效果高度依赖设计、管理和使用它们的人的技能、知识与判断。

AI 不会先淘汰所有人,它会先淘汰那些只能独立做重复执行、却不会与 AI 协作、也不会治理 AI 工作流的人。

因为对前一类人来说,AI 是替代。 对后一类人来说,AI 是杠杆。

当数字员工真的开始工作,人类员工的门槛到底是什么。

所以,回到 OpenClaw 这个热点,我更愿意把它理解成一次预演,不是“AI 替代人”的老故事,而是一个新现实。

夜雨聆风

夜雨聆风