字数 1983,阅读大约需 10 分钟

之前看到很多人询问如何在 Windows上安装 OpenClaw,这里我将按照官网的操作,教你完成安装并使用本地模型进行问答,让你无需花费一分钱就能体验 OpenClaw。

一、前置工作

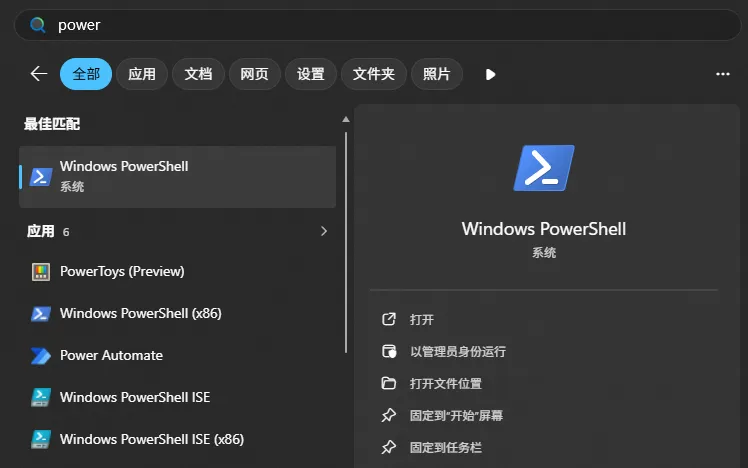

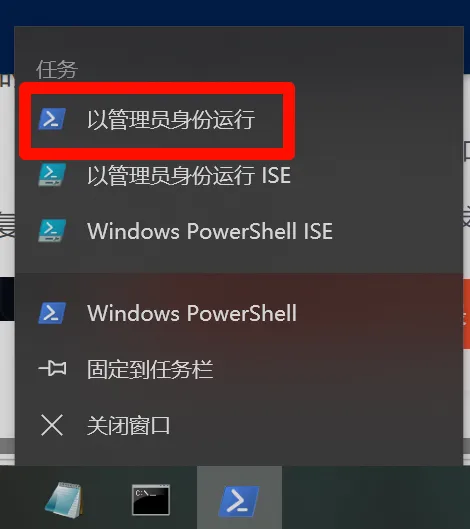

如何打开 powershell

点击 Windows徽标,输入 powershell,即可找到该应用。

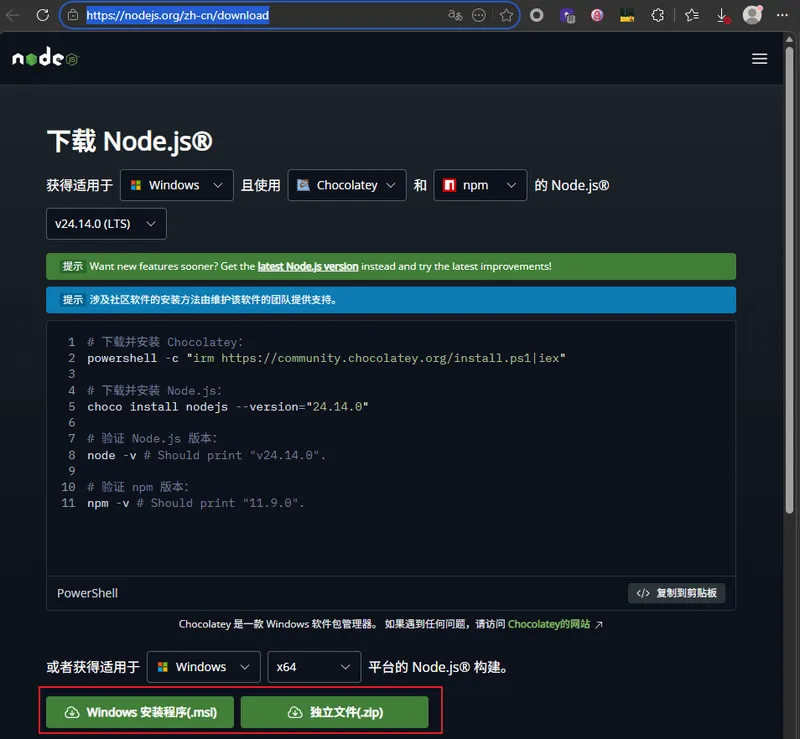

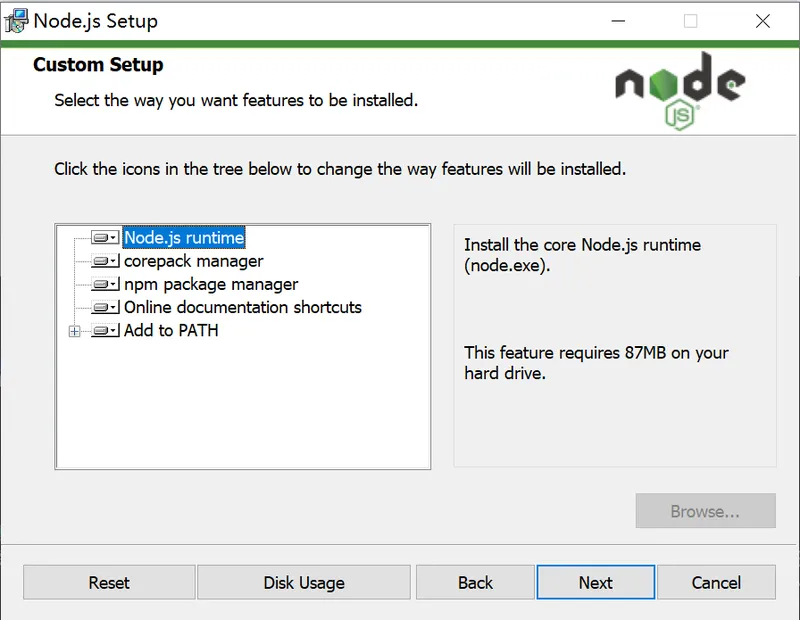

1.1 安装 node

目前 openclaw 是使用 nodejs 编写的,需要有 nodejs 的运行环境这里可以先手动安装 nodejs 环境,避免出现网络问题无法继续下一步的安装。下载页面:https://nodejs.org/zh-cn/download

安装包地址https://nodejs.org/dist/v24.14.0/node-v24.14.0-x64.msi

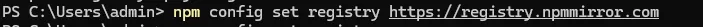

1.2 换源

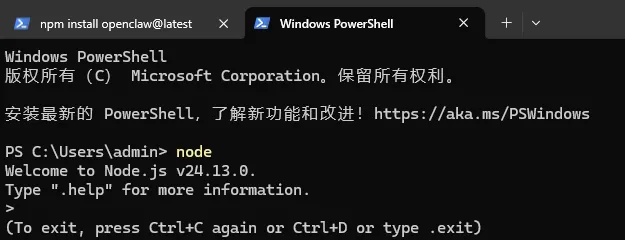

node 安装成功后,在 powershell 中使用命令npm config set registry https://registry.npmmirror.com将 npm 的源换成国内源。

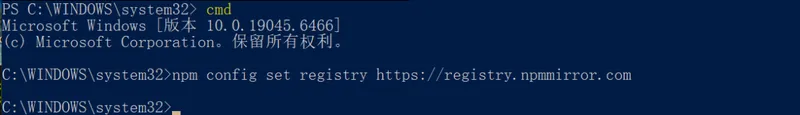

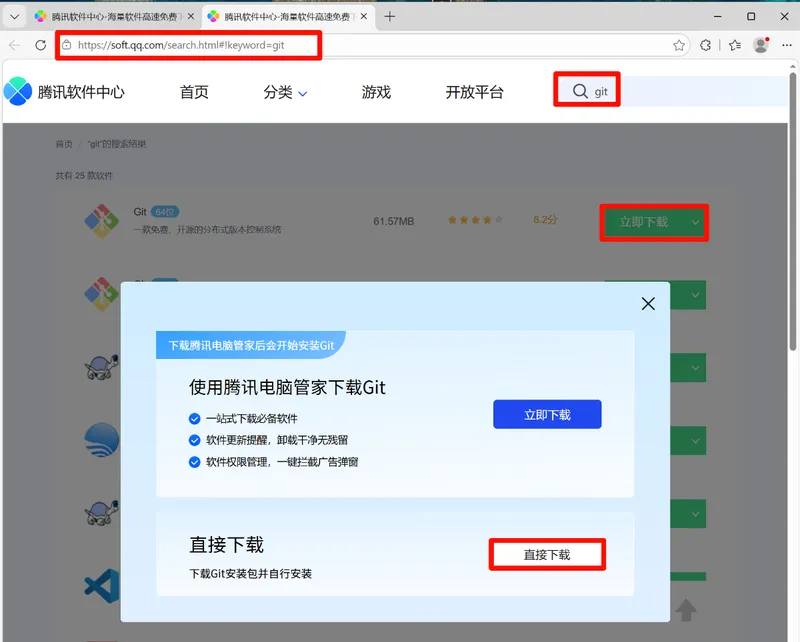

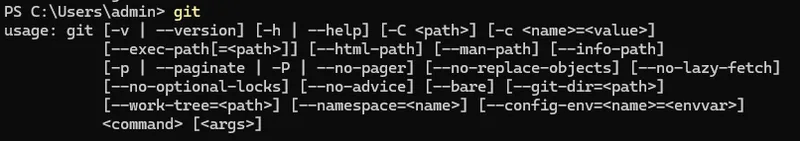

1.3 安装 git

git 下载地址,在 soft.qq.com 上搜索 git 并下载

git会出现如下内容

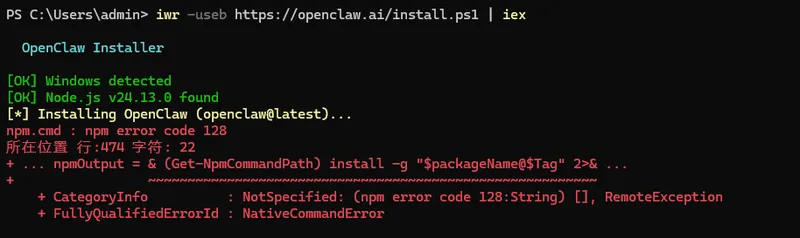

二、安装 openclaw 本体

目前 openclaw 官网提供了两种命令来在 Windows 上安装,分别是 cmd 跟 powershell,我们这里使用 powershell 的方式来进行。之后再打开的应用中输入命令iwr -useb https://openclaw.ai/install.ps1 | iex来进行安装。

2.1 常见问题

1.因国内网络原因无法安装 Openclaw

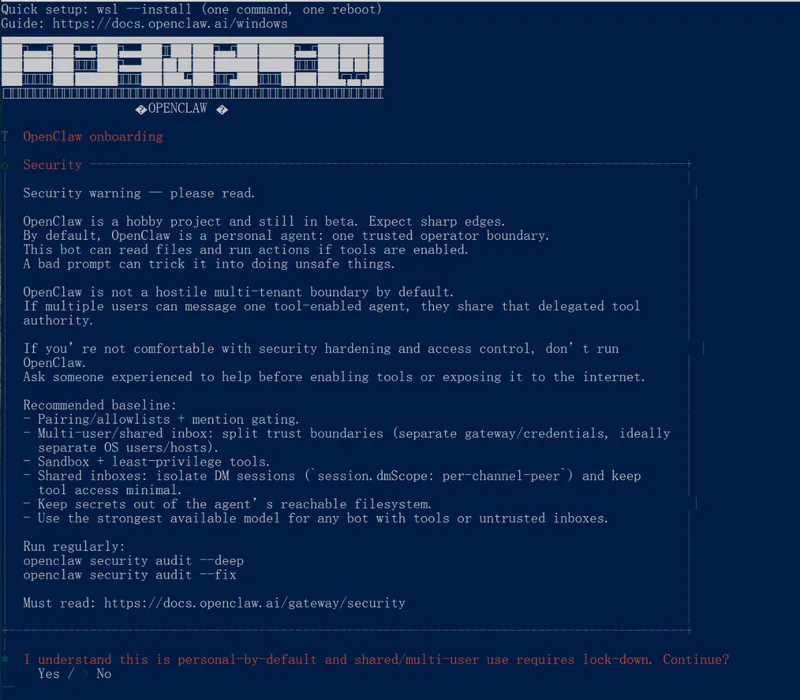

三、配置

3.1 安全告警

选择 yes

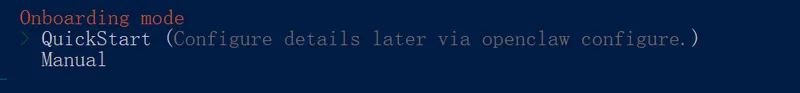

3.2 设置方式

选择 QuickStart

3.3 模型选择

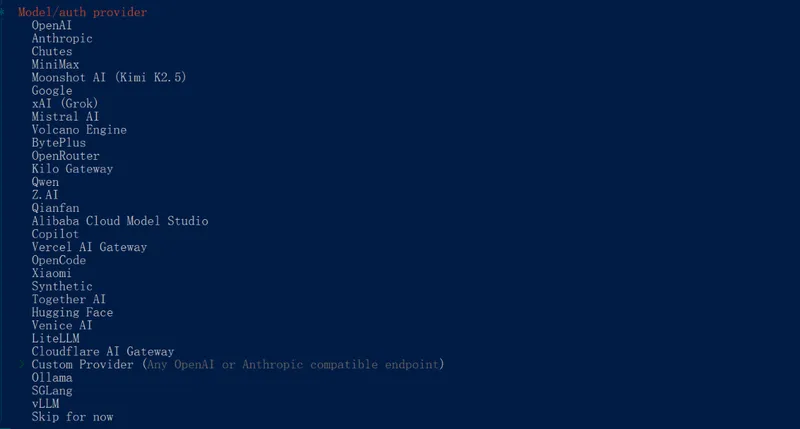

根据情况选择国内在线模型推荐 mimax code plan、 kimi code plan 、z.ai code plan、alibaba code plan 等方式,不建议直接配置普通 api,消耗有点严重,我之前一个月消耗 6 个亿的 token。使用 code plan 的情况下,只会限制使用,到时间后可以继续使用。其中 alibaba code plan 包含多种开源模型。本地模型推荐使用 lmstudio

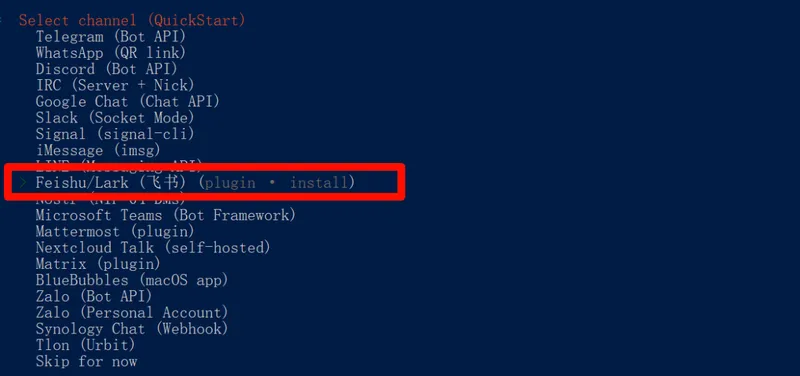

3.4 聊天软件选择:

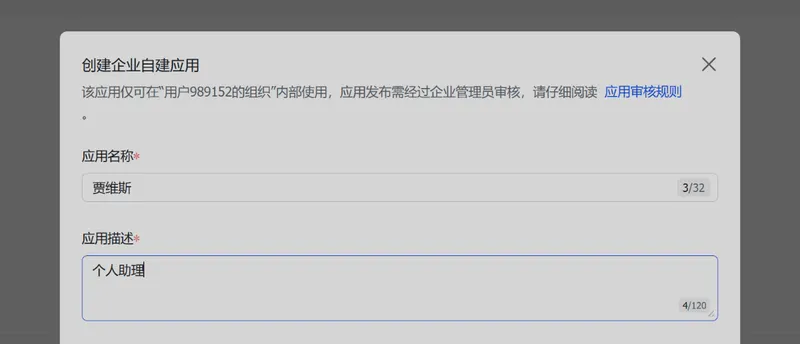

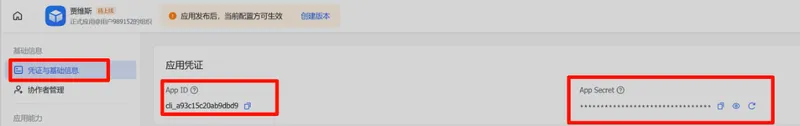

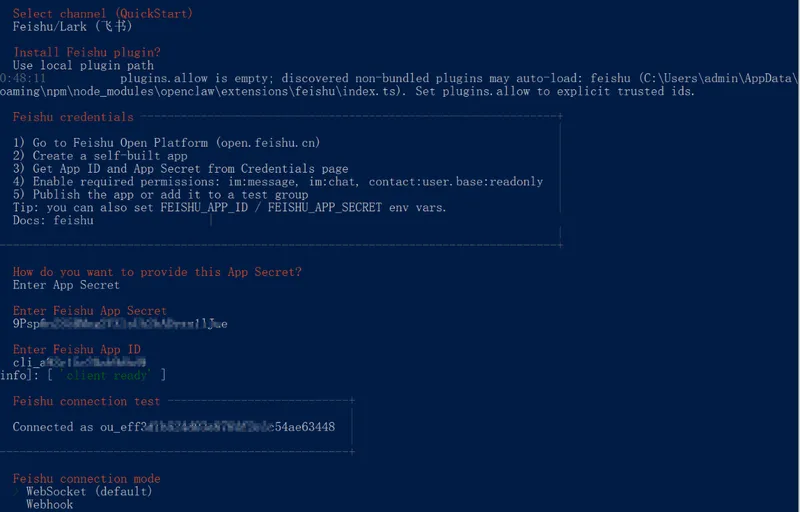

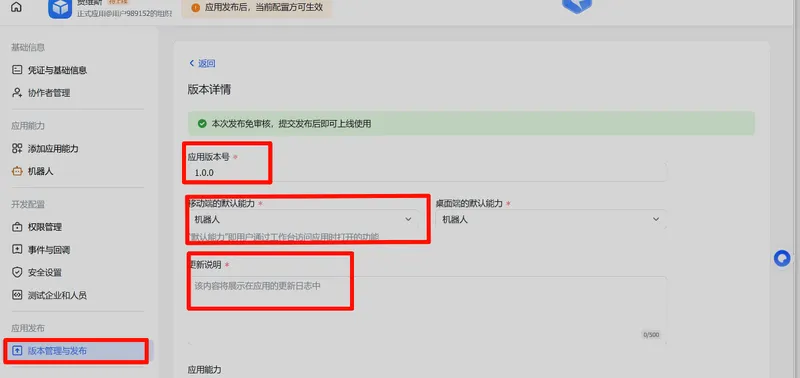

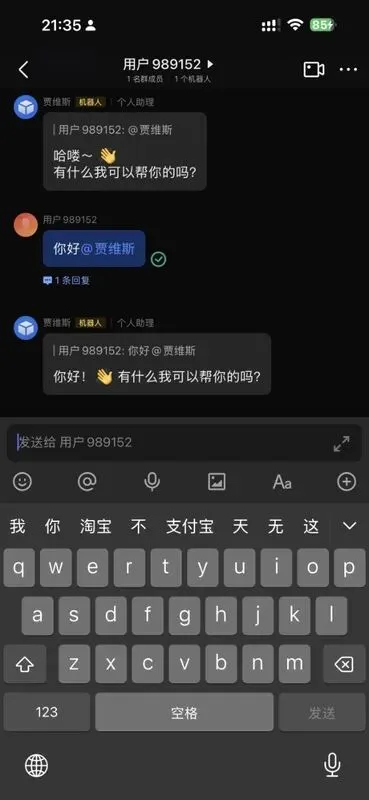

国内推荐飞书、国外推荐 discord这里我们使用飞书进行首先访问网站创建一个应用开发者后台 - 飞书开放平台[1]

后续内容根据需求选择就行,大部分可以直接选择 skip 跳过

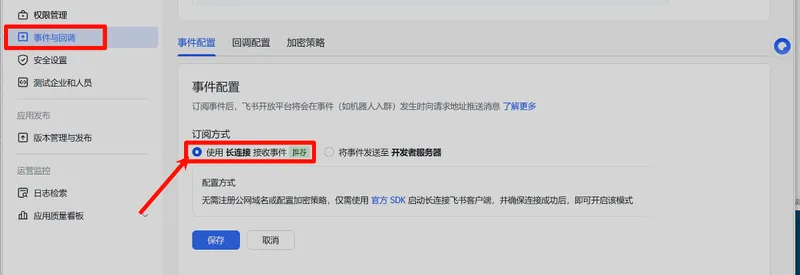

四、飞书配置

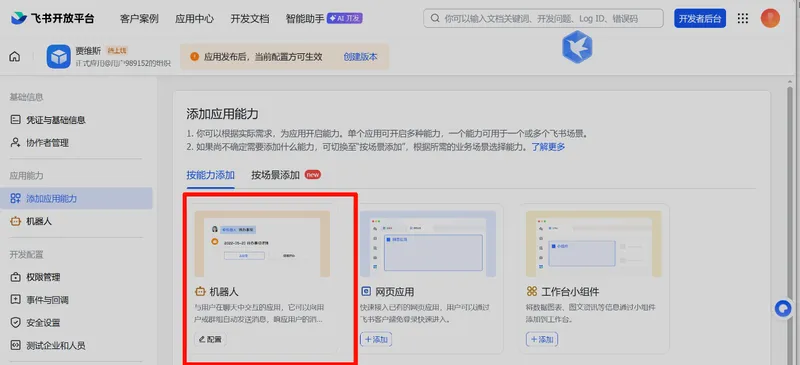

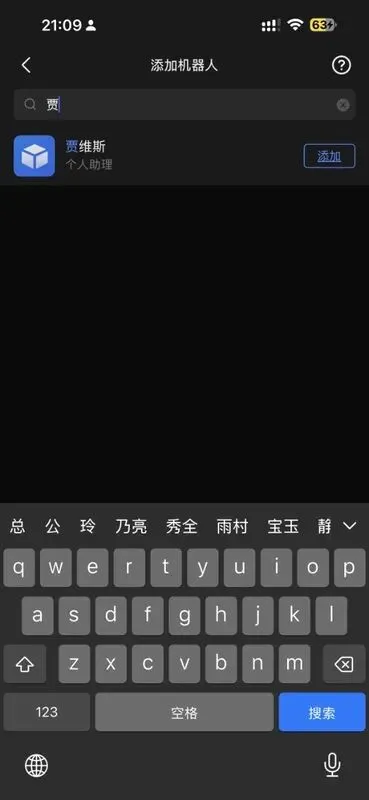

4.1 添加机器人

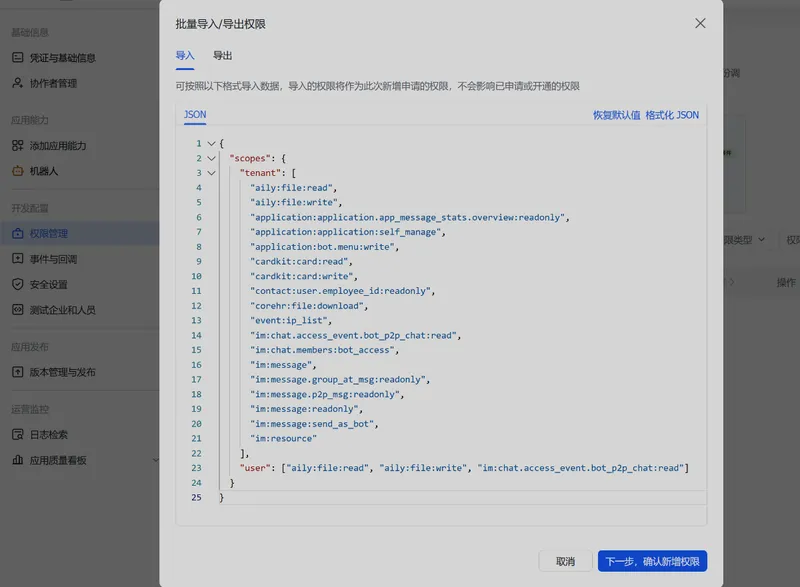

4.2 权限配置

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 { "scopes": { "tenant": [ "aily:file:read", "aily:file:write", "application:application.app_message_stats.overview:readonly", "application:application:self_manage", "application:bot.menu:write", "cardkit:card:read", "cardkit:card:write", "contact:user.employee_id:readonly", "corehr:file:download", "event:ip_list", "im:chat.access_event.bot_p2p_chat:read", "im:chat.members:bot_access", "im:message", "im:message.group_at_msg:readonly", "im:message.p2p_msg:readonly", "im:message:readonly", "im:message:send_as_bot", "im:resource" ], "user": [ "aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read" ] }}

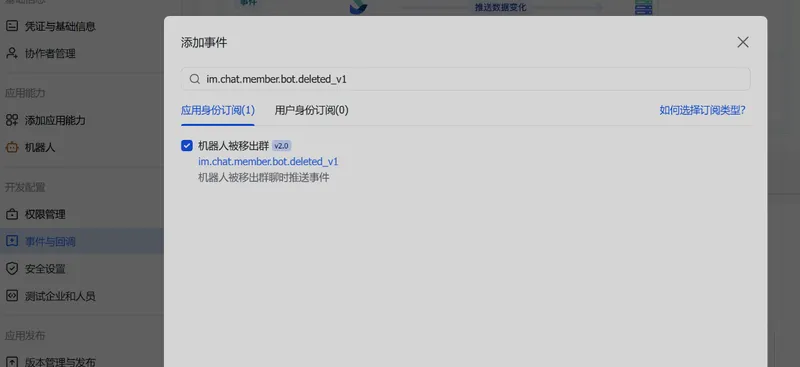

• im.message.receive_v1- 接收消息 • im.message.message_read_v1- 消息已读回执 • im.chat.member.bot.added_v1- 机器人进群 • im.chat.member.bot.deleted_v1- 机器人被移出群

五、本地大模型软件安装

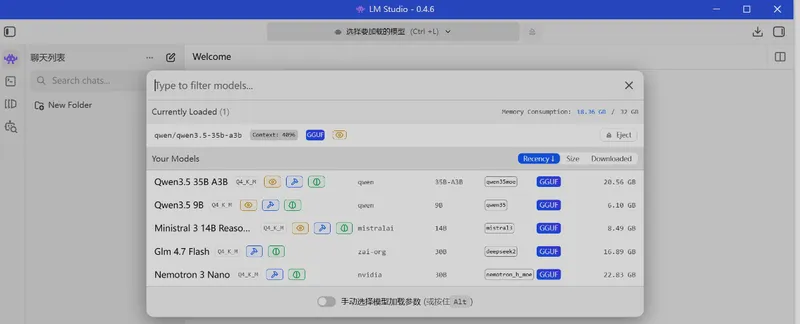

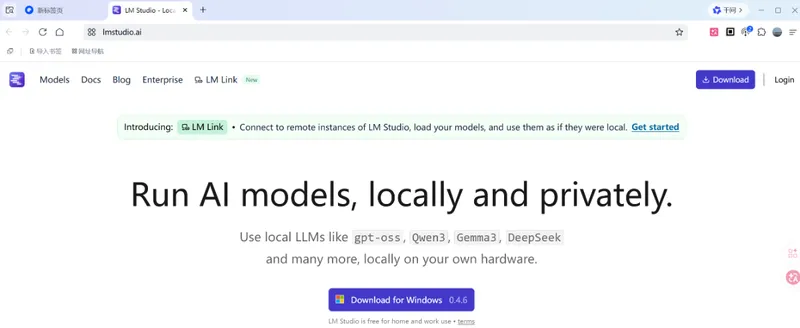

这里我推荐使用图形化软件 lmstudio,api 兼容 openai 与 Antropic,当然你也可以使用 ollama 来替代。

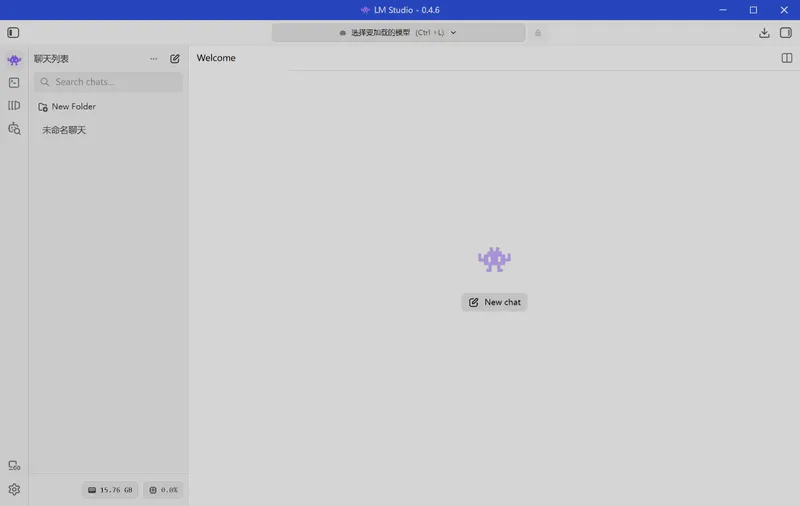

5.1 下载安装lmstudio

下载地址:https://lmstudio.ai/ 目前最新版 0.4.6

5.2 下载大模型

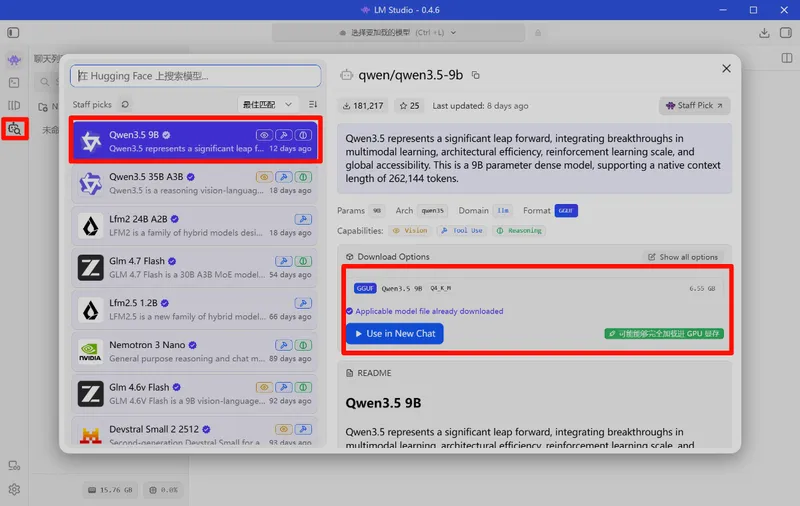

下载本地模型,我这里推荐使用 Qweb3.5 9B,你可以根据你机器的性能来选择你喜欢的模型

5.3 配置api 服务

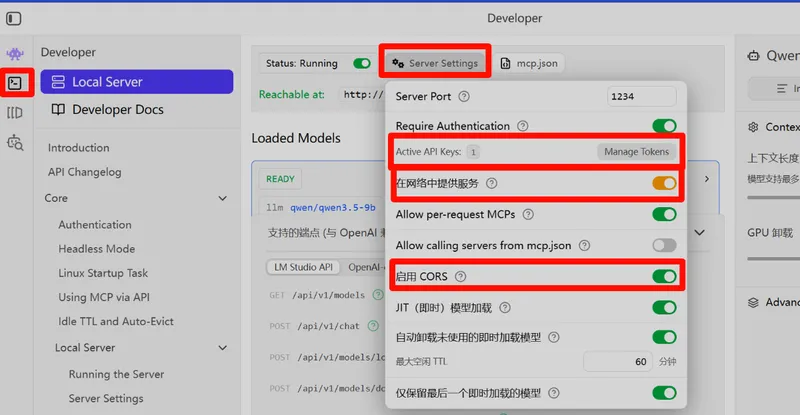

下载完成后,进行本地配置,方便在 openclaw 添加 ai 模型点击 Developer -> Server Settings

• api key 配置:在 Manage Tokens 中来进行,根据情况来选择,如果不配置就可以使用任意字符代替 • 在网络中提供服务:如果你的 openclaw 跟 lmstudio 运行在不同的设置上需要开启此选项 • 启用 CORS:建议开启 • JIT (即时)模型加载:如果你有多个模型并给不同的应用使用可以考虑开启该功能,可以让应用调用 api 时自主加载需要的模型 • 自动卸载未使用的即时加载模型与仅保留最后一个即时加载的模型建议开启,可以节约设备性能。

设置

5.4 加载大模型

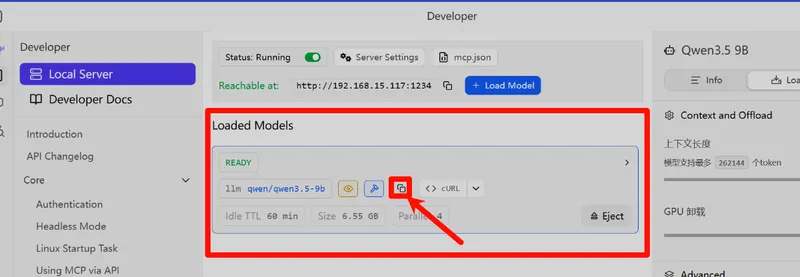

选择你要使用的模型加载之后复制模型名称,用于后续添加到 openclaw 中

5.5 获取大模型 api 地址

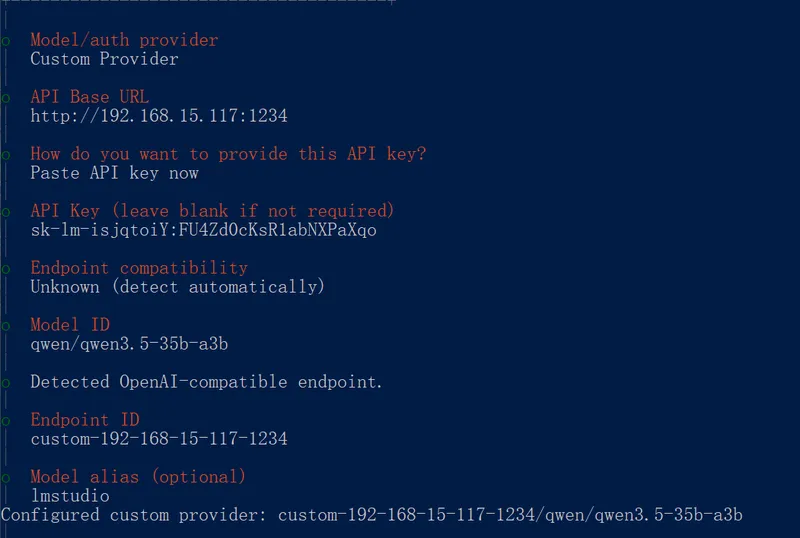

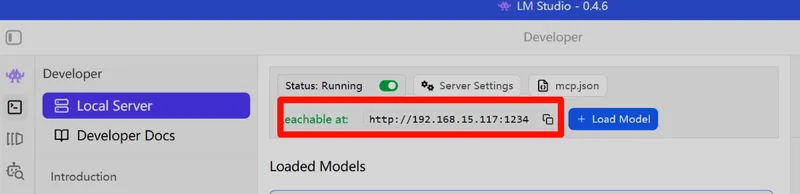

模型 api base url,通过复制获取,但这里的模型地址需要加上/v1 才能在 openclaw 中使用,比如你复制的是http://192.168.15.117:1234你要改成http://192.168.15.117:1234/v1才能使用,这种写法是openai的api接口的兼容模式。

5.6 配置模型到 openclaw

如果你之前已经配置了其他模型或者选择了跳过,这里你可以使用命令来将lmstudio作为openclaw的模型提供商

1 2 3 openclaw configure # 或者openclaw onboard

跟随提示填写信息:

当询问模型供应商时,由于 LM Studio 并非内置选项,请选择 Custom 或 OpenAI Compatible 。

根据提示,填入以下关键参数 :

Base URL (基础地址): http://localhost:1234/v1 (如果 LM Studio 运行在其他机器或端口,请相应修改)

API Key (API密钥): 可以填入任意非空字符,如何你配置了api密钥就填写对应的密钥,没有配置就随意填写字符即可 。Model Name (模型名称): 填入你在 LM Studio 中加载的模型的确切名称。例如 minimax-m2.5-gs32、qwen2.5-coder:7b 或 glm-4.7-flash 。完成并重启:完成向导后,务必重启 OpenClaw 网关服务,让新配置生效。

六、报错处理

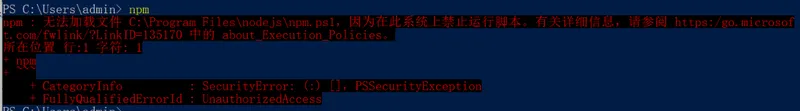

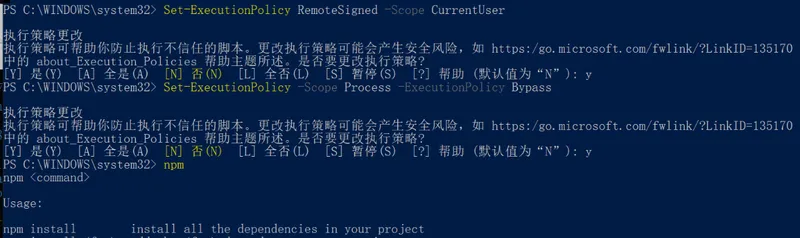

6.1 powershell 执行命令报错此系统上禁止运行脚本解决方案

1 2 3 # 允许当前用户运行本地和下载的脚本Set-ExecutionPolicy RemoteSigned -Scope CurrentUserSet-ExecutionPolicy -Scope Process -ExecutionPolicy Bypass

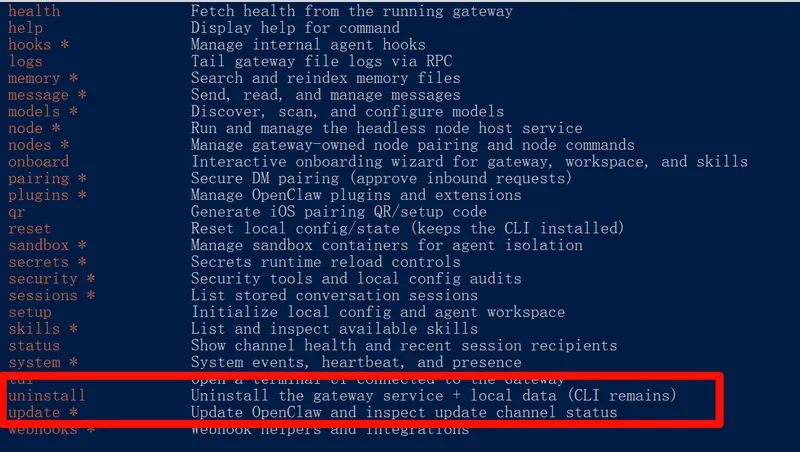

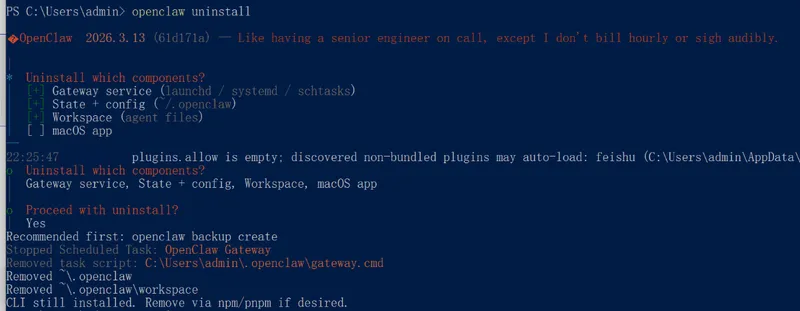

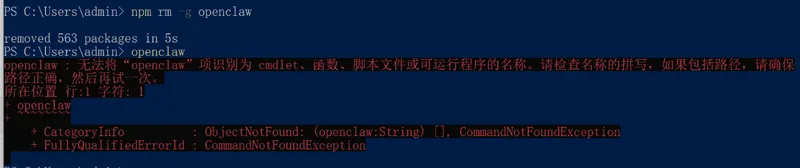

七、 关于卸载

实际上 openclaw 官方提供了卸载命令,你只要在 powershell 中,输入命令openclaw uninstall就可以完成卸载了,你可以打开电脑,找到用户目录下 .openclaw 文件夹,将整个目录删除即可。你完全不用花钱找人上门卸载这玩意儿。

openclaw uninstall

npm rm -g openclaw删除应用程序包

引用链接

[1]开发者后台 - 飞书开放平台:https://open.feishu.cn/app

夜雨聆风

夜雨聆风