三月初,一款图标酷似红色龙虾的开源AI智能体OpenClaw在国内迅速走红,被大家亲切地称为“龙虾”。这款能实现“聊天即操作”的智能体,让用户可通过日常通讯工具驱动AI完成浏览器操作、文件处理、邮件收发等各类任务。目前全球活跃的OpenClaw互联网资产已超20万个,其中境内活跃的OpenClaw互联网资产约2.3万个,呈现爆发式增长。并且由于安装存在技术门槛,不同平台上迅速催生了收费几百至上千元的“代装”服务。

不同于ChatGPT、豆包等传统AI的被动型生成模式,OpenClaw通过整合通信软件和大语言模型,依托高权限实现自主操作,随之而来的是各种风险。在这场技术狂欢背后,已经出现了“代养龙虾”暴雷、API密钥被盗产生1.2万元账单、AI擅自删除核心数据等真实案例。近期,工信部网络安全威胁和漏洞信息共享平台、国家互联网应急中心已紧急发布高危风险预警。

当AI获得“执行”这一跨越虚拟与现实边界的权力时,它也必然带来相应的法律风险。

图片来源于豆包AI

OpenClaw的法律地位

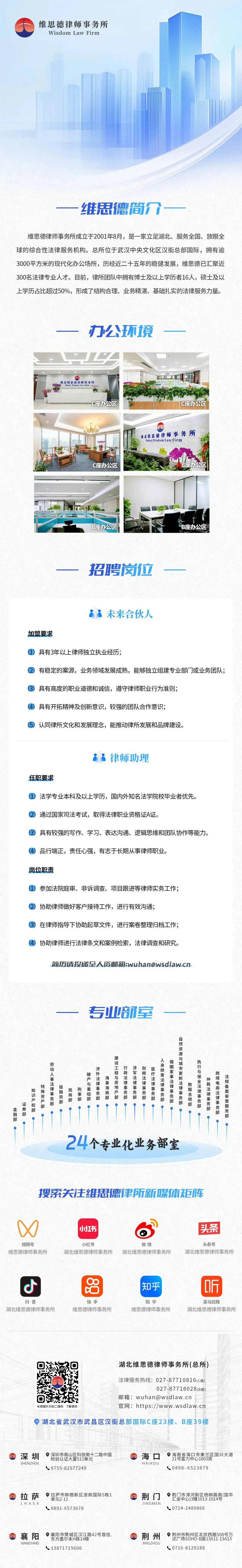

WISDOM

OpenClaw不具有民事主体资格,不能作为意思表示的传达人、代理人或代表人,而是一种具备自动执行能力的软件工具。作为一款AI,它只是执行的媒介,背后的账号持有人、具体服务提供者等才是真正的归责对象。在全国首例生成式AI“幻觉”引发的侵权之诉中,杭州互联网法院认为:依据《生成式人工智能服务管理暂行办法》,生成式人工智能服务属于“服务”范畴,因生成式人工智能提供内容引发的纠纷属于提供服务引发的侵权责任纠纷。那么,背后的服务提供者就是侵权主体。

图片来源于豆包AI

民事与行政法律风险

WISDOM

1

信息与数据安全风险

OpenClaw高权限运行的特性,产生的信息泄露、权限失控等问题,可能违反《网络安全法》《数据安全法》《个人信息保护法》《反不正当竞争法》等多项法律法规引起相关主体的民事赔偿及行政监管责任、刑事责任。

一方面,其早期版本默认将控制界面绑定至所有网络接口,相当于为外部访问敞开了大门;另一方面,它未能贯彻最小权限原则,使得执行任务时对聊天记录、本地文件等敏感信息的读取毫无节制。两者叠加,直接导致用户的大量数据被超范围抓取并暴露于公网。若用户指令设置不当,OpenClaw在执行过程中还可能产生删除大量核心数据的情况。

此外,盗版插件的泛滥更将这一风险放大。大量非正规的第三方代装服务缺乏监管,这类私自篡改原版代码制作的插件,常通过非正规代装服务暗中安装,诱导用户“一键全授权”,在用户无戒备的情况下获取无差别设备访问权限。这类代装者可能会严重侵害个人隐私权与数据资产权益。

图片来源于豆包AI

2

资金损失与交易责任风险

OpenClaw已公开披露的安全漏洞多达258个,攻击者可利用此类漏洞或通过提示词注入等方式获取设备控制权。另外插件的恶意投毒事件层出不穷。两相叠加,在金融场景下的风险尤为致命——网银密码、支付密钥、交易凭证一旦失窃,攻击者便可登录系统转走资金,造成客户直接经济损失。深圳一名程序员安装OpenClaw后仅三天,就因API密钥被盗产生1.2万元账单,其个人设备中的敏感数据也面临泄漏风险。

中国互联网金融协会明确建议:金融消费者在办理网上银行、证券交易、支付等个人金融业务的终端上极其谨慎安装OpenClaw;从业机构不在涉及客户信息处理、资金操作、风控审核、交易执行等金融业务的终端上安装OpenClaw,不将客户金融信息、交易数据、信贷审批材料等敏感数据输入该智能体或接入其处理链路。

图片来源于豆包AI

3

商业秘密与知识产权风险

当OpenClaw被深度嵌入企业日常运转(例如企业微信、挂载文档库、群发流程),它所能触及的不光是那些摆在表面的公开信息,还有企业真正赖以生存的核心资产:客户名单、报价规则、项目模板、未公开的产品计划等内容。这些内容可能构成商业秘密、经营信息、技术秘密或竞争优势。要通过OpenClaw来执行工作就不可避免地会将这些隐藏内容显性化的写进参数中导致泄露。若员工在做业务时自建或部署OpenClaw,可能会违反与公司的保密协议,承担违约及重大经济损失赔偿。此外,生成式AI也容易引发知识产权方面的争议。

网络生态环境中,众多经营主体需要履行法定的网络安全义务,在承担民事责任以外,还要面对来自行政部门的合规监管。openclaw的出现让各种法律风险剧增。

刑事责任风险

WISDOM

1

“代养龙虾”背后的帮信罪陷阱

社交平台上出现的很多“代养OpenClaw赚收益”,实则可能是黑灰产设下的陷阱。有机构打着“零成本躺赢”“高分红”旗号,诱导用户交出设备权限、付费加盟,实则利用用户设备从事批量注册账号、刷单、网络攻击等违法犯罪活动。

根据《刑法》第二百八十七条,明知他人利用网络实施违法犯罪,仍提供技术支持或帮助,情节严重的构成帮助信息网络犯罪活动罪(帮信罪)。所谓的“分红佣金”只是吸引用户入局的诱饵,多数用户最终不仅拿不到任何收益,还会因将设备交由他人用于违法活动,无意间成为黑灰产的“帮凶”。

图片来源于豆包AI

2

开发与代装者的刑事风险

若在开源代码中夹杂病毒获取用户隐私数据可能构成侵犯公民个人信息罪、非法获取计算机信息系统数据罪。收费代装者若为规避安全防御修改底层配置或提供绕过验证的安装包,可能构成提供侵入、非法控制计算机信息系统程序、工具罪。

3

外部攻击者的责任

如果外部行为人通过恶意指令、伪装插件、诱导访问恶意网站等方式接管OpenClaw并获取数据、操控设备、操纵支付,也可能涉及非法获取计算机信息系统数据、非法控制计算机信息系统、侵犯公民个人信息、诈骗、盗窃等罪名。

图片来源于豆包AI

合规建议:守住法律红线

WISDOM

1.信息隔离:对普通个人用户而言最基础的合规即“信息隔离”。绝不能向该类实验性工具提供包含银行卡密码、股票账户或家庭隐私照片的文件夹,以防在模型失控时遭遇“灭顶之灾”。

2.部署隔离。根据《网络安全法》的相关精神,建议使用虚拟机或闲置设备来运行OpenClaw,坚决避免在存有敏感信息的主力机、工作电脑上安装。公网访问如非必需,一律关闭;安全防护机制要定期检查和更新。

3.来源干净。拒绝一切破解版、魔改版,只从官方渠道获取。严格遵守MIT开源协议,保留原始版权声明。

4.权限克制。遵守《个人信息保护法》的“最小必要”精神,对“一键全授权”保持警惕。对要求读取通讯录、全部文件等敏感权限的操作保持警惕。

5.操作留痕。养成留存操作日志的习惯,对涉及删除、修改、外发等高风险的AI指令,务必进行人工二次确认。

6.风险告知:对于代装者,请务必履行告知义务,把风险清清楚楚告诉用户,并留存相关记录。否则一旦出事,连带责任跑不掉。

图片来源于豆包AI

结 语

WISDOM

技术的发展始终在试探规则的边界,但法律的规制从未缺席。OpenClaw的迅速走红,勾勒出“全自动数字助理”的未来愿景,但接连发生的失控案例也敲响了警钟。

即便AI系统从“被动应答”走向了“主动执行”,其产生的法律后果依然由人类这一责任主体承担。无论是开发者、部署机构,还是普通用户,在享受技术红利的同时,必须清醒认知:AI本身不构成法律上的责任承担者,AI的自动执行行为,完全可能为背后的自然人、法人带来法律风险。

以审慎授权守住入口,以最小必要约束权限,以人工复核卡住风险节点,以全程留痕实现可回溯追责——这是人工智能时代不可或缺的底线思维。正如中国互联网金融协会所警示:在安全合规要求较高的领域,OpenClaw尚不具备进入核心业务场景的条件。全民拥抱AI的浪潮之中,理性判断与合规意识,才是最根本的防火墙。

图片来源于豆包AI

罗宏易

维思德律师事务所执业律师

毕业于西南政法大学 法学专业

具有扎实的法学专业基础,主要研究领域为民商事诉讼、非诉法律服务。

往期 · 推荐

撰稿|罗宏易

排版|刘晨卉

审核|丁 静

冯颖琼

夜雨聆风

夜雨聆风