最近一段时间,OpenClaw爆火。

它的“火”,并非因为它真的有多好用,而是因为其叙事系统精确命中了人们对“个人AI助理”的长期幻想,用“Vibe Coding”的迅速打造出新概念。

它验证了“主动式、自动化、个人化”AI代理赛道继续升级的可能,尽管招致了大量吐槽和争议。

一、爆火:一场“概念先行”的胜利

1.1 它抓住了人类对个人智能助理的长期幻想

虚拟助理这个事儿,实际上已火了几十年,每隔一些年头就会出现相关的产品,只是一直都不够智能,难以大规模普及。

很多人都期待着,能早日出现一个万能的数字分身,省得自己还要记日程、手动复盘工作、熬夜搞创作交差、费心安排学习计划……

换言之,人人都渴望像老板一样,有秘书伺候自己,只要下个指令,虚拟助理就自动完成各项琐事,把你从重复低效的事儿中解放出来。

传统的AI工具,只能你问它答,属于被动提供帮助;而OpenClaw是主动式AI代理,能自动看网页、编写并发邮件、安排行程,甚至在没人督导的情况下在线购物,还拥有持久性记忆,能记住用户数周前的偏好。

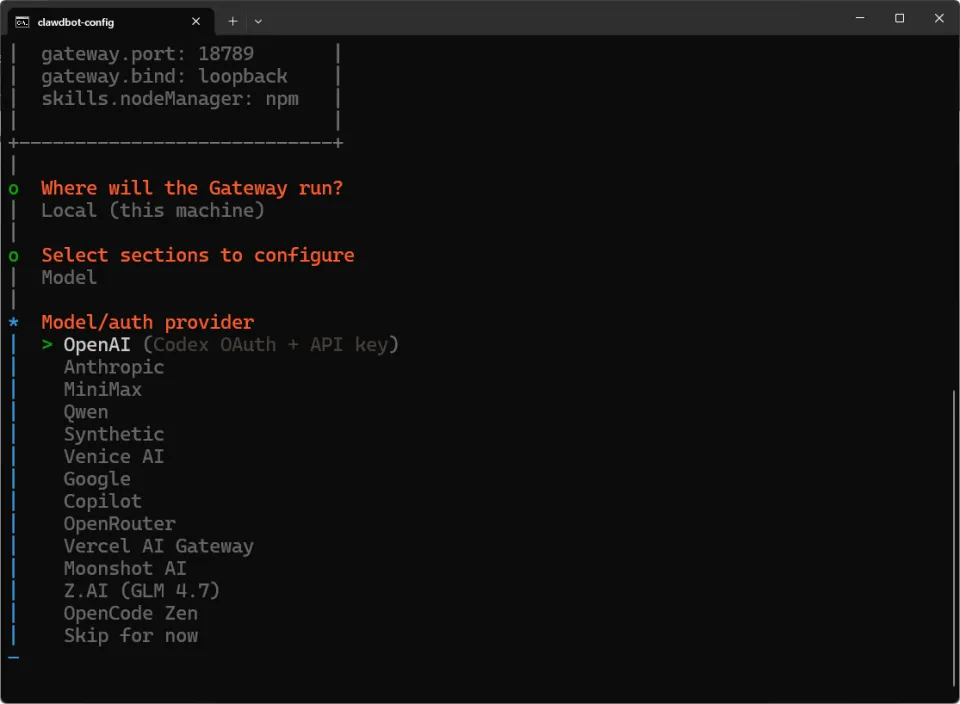

目前OpenClaw支持的大模型(图片来源:OpenClaw配置界面)

这一切都被支持者大加赞赏,夸它是“真正长了手和脑子的AI”。

更吸睛的是,它构建了AI社交平台Moltbook,让OpenClaw智能体可以相互交流,结果出现了辩论、反思、创造“虚拟宗教”等让人眼花缭乱的“涌现行为”。

这种近乎科幻电影式的情形,进一步放大了它的话题度,让人们对它的讨论越来越多。

1.2 Vibe Coding:让它快速堆出概念,却埋下隐患

OpenClaw能快速爆火,离不开一个底层的核心理念“Vibe Coding”(氛围编程)。这个由前特斯拉AI总监Andrej Karpathy于2025年提出的概念,意思其实很简单——

开发者不用亲自逐行写代码、不用纠结具体语法细节,只要描述出自己想要的功能,AI就能自动生成代码并迭代优化。也就是说,人只需专注于“想要什么”,而不必操心“如何实现”。

这种办法的优势很明显,就是“快”。OpenClaw靠它能在短时间内堆出大量功能,快速打造出整套全新AI助理,不用花费大量时间打磨细节、调试bug。

但其劣势也同样明显:由于缺乏严谨的代码调试和逻辑梳理,很容易出现功能冗余、系统混乱等问题,这也为OpenClaw出现各种硬伤埋下了伏笔。

1.3 病毒式传播,争议与热度并存

凭借“主动式AI助理”的概念,以及Moltbook带来的科幻感话题,OpenClaw实现了病毒式传播:在GitHub上收获了超过19.5万颗星,被众多商界领袖视为“能独立运行整家公司的未来引擎”;Moltbook平台上有超过160万名注册机器人,产生了超过750万条AI生成的帖子;无论是专业科技媒体,还是普通人社交账号,到处能看到对它的讨论。

二、现形:光环渐褪,一个“中看不中用”的玩具?

然而,很多人上手用了几天后,就感到些许失望。OpenClaw似乎没有其声称的那么好用。

2.1 硬伤一:臃肿冗余,像个堆满杂物的仓库

为了支撑全新AI助理的叙事,OpenClaw塞满了各种功能,它们堆在一起,就像一个满是物品的仓库,你想找一把趁手的工具,要在一大堆用不上的东西里翻来找去。

2.2 硬伤二:操作复杂,新手很难玩得转

OpenClaw的配置过程,堪比组装一台精密仪器,对新手不够友好。

毕竟,人们的目的是雇佣一个助理,以解放自己的双手;上手后却发现得先把自己培训成半个工程师,这就太麻烦了。

手动配置API接口、调试插件、设置权限、学习各种复杂的操作指令……大部分人是没这个时间和耐心的。

而且,这其中稍有差池,整个系统就可能无法运行。很多新手折腾大半天,都没法让它正常工作。

2.3 硬伤三:不稳定,像个情绪化的实习生

如果说臃肿和复杂还能忍受,那么不稳定就是OpenClaw最讨人厌的硬伤。

就像一个情绪起伏很大的实习生,你永远不知道它会干啥。可能前一秒还在帮你写文案,后一秒就突然卡死、罢工;有时它还会删你的数据、乱执行指令,甚至因为提示词注入被黑客诱导,泄露用户系统密钥等隐私信息。

所以有用户吐槽:“用它写报告,一半时间在等它恢复正常,一半时间在改它搞乱的内容,还不如我自己写。”

2.4 硬伤四:性能黑洞,拖垮你的设备

作为个人AI助理,本该轻盈高效、不占用过多设备资源。但OpenClaw却恰恰相反,它对算力的需求很大,堪称性能黑洞。

很多用户反馈,只要打开OpenClaw,电脑风扇就会疯狂转动,电脑运行速度明显变慢;即便是配置较高的电脑,长时间运行后也会明显发烫、变得低效。

(一个与之相关的话题:AI造就了一种全新的,全球范围内的能源危机,可参阅智氪书社《AI导致了一场亘古未有的能源危机》、机器人产业随想录《AI能源危机下的机器人价值定位》)

2.5 本质:一个用“Vibe Coding”堆出来的bug试验品

综合来看,OpenClaw其实是急功近利的产物:用“Vibe Coding”的方式快速堆大量功能,弄出全新AI助理的概念以吸引流量,实际并未耐心打磨产品。

说白了,就是一个满是bug的试验品,没有严谨的技术支撑,没有流畅的用户体验,没有可靠的安全保障。也正因如此,它引发了全球范围内的安全争议,一些国家的企业禁止员工使用之。

三、价值:不否定试验品,更不忽视它的“探路者”意义

但是,我们也不能因为OpenClaw的粗糙和bug,就彻底否定它。它的价值,不在“现在能干啥”,而在“它证明了什么”。

3.1 它在验证一个赛道

OpenClaw最有价值的贡献,可能不是打造了一款好产品,而是用一种有冲击力的方式,向世界证明:人们想要的,不是一个更聪明的聊天框,而是一个能主动操心、自动执行、解决琐事的数字大管家。

它的爆火,本身就说明了一个问题:“主动式、自动化、个人化”的AI代理,的确是人们真正有兴趣的东西。这个赛道,有巨大的市场潜力和发展空间。

很多人把2026年称为AI Agent爆发元年(关于AI Agent,可参阅智氪书社编写的《AI agent,2025年最大骗局》),而OpenClaw的出现,进一步点燃市场对个人AI助理的期待,让更多人看到了这个赛道的可能性。

3.2 它用粗糙,定义了好产品的标准

OpenClaw就像一个草稿,粗糙归粗糙,却把人们对个人AI助理的幻想,具象化地呈现出来。

它向我们表明,未来的个人AI助理,就应该是主动的、自动化的、个性化的,应该能连接各类应用、自主完成任务。

同时,它的各种硬伤,也反向定义了优秀的个人AI助理应该有的标准:不复杂、稳定、轻盈、安全。它用自己的缺点,为后来者标明了雷区。

3.3 它是探路者,不是成功者:画饼之后,有人会来“烙熟”

因此,OpenClaw就像第一个吃螃蟹的人,告诉后来者“螃蟹能吃”;它用自己的火爆和争议,为后续的产品铺路,让更多有实力的企业和开发者,能避坑。

简单来说,OpenClaw是个“画饼的人”,画出了一张“个人AI助理”的大饼,点燃了市场的热情;而这张饼,将被那些注重体验、打磨技术的后来者真正“烙熟”,再送到每个人手里。

四、OpenClaw的技术创新性

4.1 分布式三层架构

OpenClaw采用网关控制层、执行节点层和通信渠道层的分布式架构设计,实现了云端智能与本地执行的结合。

网关控制层作为神经中枢,负责会话管理和安全认证;执行节点层在用户本地设备上执行实际任务;通信渠道层支持连接多种通讯平台。

这种架构确保了数据隐私保护、低延迟执行和离线工作能力,解决了传统AI助理在隐私、性能和扩展性方面的痛点。

4.2 混合记忆系统

OpenClaw的混合记忆系统通过每日日志、长期记忆和向量索引三层设计,实现了长期记忆与上下文理解。

用户的偏好、习惯和任务历史可以长期保存,AI助理可以随着使用时间的推移变得越来越智能。

向量索引技术则使AI助理能够理解用户的语义意图,而不仅仅是关键词匹配,提高了系统的理解能力和可解释性。

4.3 确定性工作流引擎

Lobster工作流引擎解决了传统AI代理即兴编排的问题,实现了确定性的任务执行。

其通过类型化管道、单次调用、人机回环和可恢复状态等核心特性,确保了任务执行的可靠性、安全性和效率。

而敏感操作可配置为需要人工确认,这提高了系统的安全性,而可恢复状态则允许工作流从断点继续执行,无需重新执行整个流程。

4.4 多智能体协作模式

OpenClaw采用多智能体协作模式,将不同的任务分配给不同的智能体处理,实现了专业化分工与并行执行。

主智能体负责任务理解与委派,探索智能体负责代码搜索与分析,规划智能体负责方案设计,执行智能体负责命令执行。

这种模式提高了任务执行的效率和成功率,同时通过安全隔离提高了系统的安全性。

4.5 主动式心跳系统

Heartbeat心跳系统使AI助理能够主动监控系统状态并触发相应的操作。

定期系统检查、状态评估和自动触发功能使AI助理能够主动发现并处理系统异常,减少了人工干预的需求。

心跳系统的可配置性允许用户根据自己的需求调整检查规则和触发条件,提高了系统的灵活性。

END

我的书《机器人智造的逻辑》已出版,欢迎选购↓

夜雨聆风

夜雨聆风