Tip

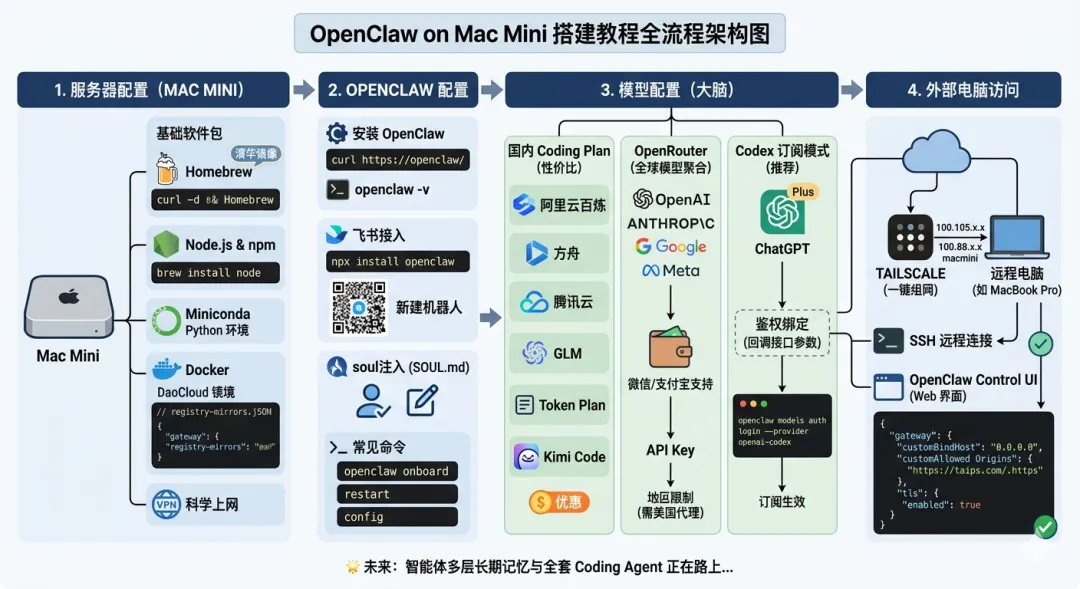

本篇是如何利用 MacMini 搭建 OpenClaw 的教程,主要包含如下几个章节:服务器配置:用来安装 OpenClaw

• 哪些云服务器已提供 openclaw 的开箱即用 • windows 系统拥有好的 linux 终端体验 • mac 系统配置(本文使用的 macmini), 常用安装包配置,如 Homebrew、node、npm、pnpm、miniconda、docker 等。 • 模型配置:选择合适的国内 coding plan 套餐;OpenRouter 调用全球顶尖 AI 模型,Codex 订阅,如何避免地区封禁问题 • OpenClaw 配置:安装 openclaw,修改 SOUL.md 文件注入灵魂,以及如何快速接入飞书 • 外部电脑访问:macmini 部署后,如何将当前电脑的终端以及 OpenClaw 的 Web 控制台暴露出去,让外部电脑可查看, 便于排查问题

Tip

更多文章正在赶来路上:

• 构建 OpenClaw 多层长期记忆机制 • 个人提出需求 - > openclaw(中心调度层) + Claude Code/Codex 等(项目代码编写) -> 自动完成 Code review -> GitHub Action 机制完成 CICD 代码推送并上线服务——> 个人简单一句话,便有全套的 Coding Agent 在底层运转,并自主完成功能的测试上线

服务器配置

国内云服务器

• 阿里:阿里云:快速部署 OpenClaw 9.9 元定制 AI 助理 • 字节:火山引擎:即刻解锁 ArkClaw • 腾讯云:腾讯云:玩转 OpenClaw| 快速接入企业微信、QQ、钉钉、飞书四大国内主流 IM • 七牛云:OpenClaw 首发特惠 9.9 元开启 AI 开发新范式 • 智谱:GLM Claw • MinMax:MaxClaw

优点:对于非研发人员,使用门槛最低,能快速上手尝鲜

缺点:一般会配套绑定该云厂商对应的 Coding Plan 计划,而国内 Coding 能力没有御三家(谷歌、OpenAI、Anthropic)好,体验效果会打折扣;数据上云,自主可控性会差一点,不方便定制化调整

下面是个人电脑配置,主要针对有一定计算机知识,偏极客精神,愿意将配置、数据等都掌握在自己手里

个人 windows 系统

OpenClaw 大量依赖 bash、curl、docker、ssh 等命令行工具,而 winodws 原生的 shell 支持度不够,建议安装 WSL,安装 WSL 可见下面这篇文章

• 如何使用 WSL 在 Windows 上安装 Linux

个人 Mac 系统

Mac 系统天然适配 Unix Shell,开箱即用,这里我推荐使用 Mac mini,因为我希望它是一台 24 小时运转的 AI 代理,推荐理由如下:

• 待机功耗低:电费低 • 完全静音:无风扇运转声音 • 符合 24 小时运转的 AI 代理:不需要显示器,默默当作服务器运转即可

基础软件包安装

假设你现在已经有了一台 Mac mini,初始化时需要为其配置一些命令,以便其再将来是要 openclaw 时更加的方便,推荐安装如下

• Homebrew(必备):简称 brew,补充了 macOS 原生软件安装的空白。brew 安装包在国外,以后利用 brew 安装其他软件镜像都走的国外的渠道,下载会非常的慢。这里推荐清华的 brew 安装方式,且在后续利用 brew 安装其他软件时,会默认走国内的渠道,速度快,

/bin/zsh -c "$(curl -fsSL https://mirrors.tuna.tsinghua.edu.cn/homebrew/brew.sh)"• node(必备):openclaw 的安装以及后续运行依赖 node.js。内置 npm

brew install node• pnpm(可选):相比 npm 更轻量

brew install pnpm• nvm(可选):一般和 pnpm 配合使用,用来切换 node 版本

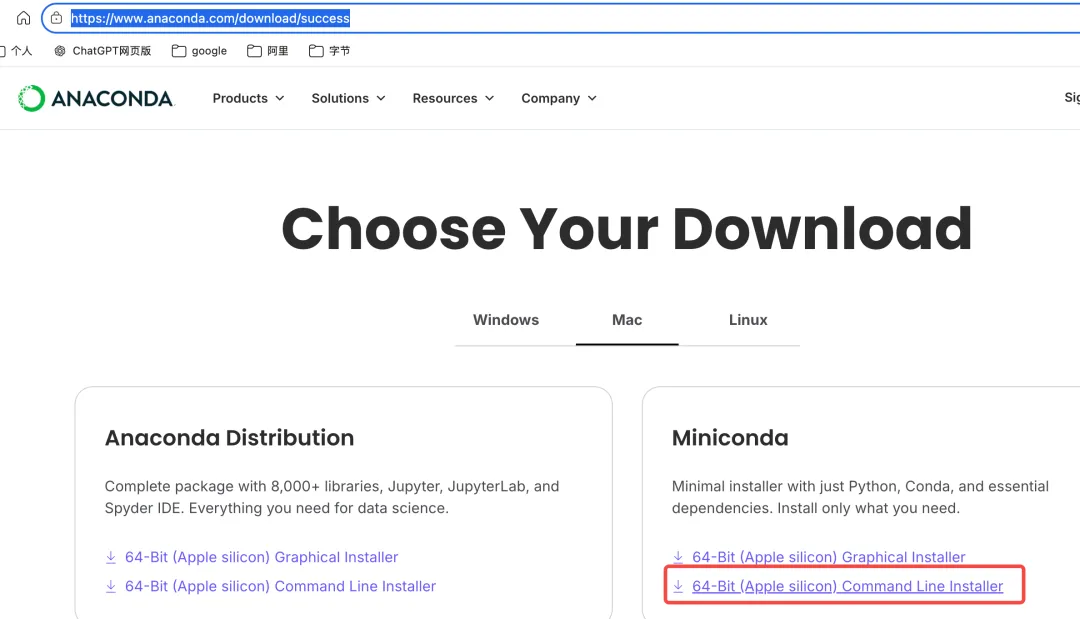

brew install nvm• conda(必备):openclaw 的使用过程中,会调用大量的 python 脚本,为电脑配置 python 运行环境,一般情况下会用到 python 的 venv、uv、conda 等,这里建议直接使用 conda,便于后续为了特定项目快速切换 python 环境,选择 Miniconda 的终端命令行安装方式

页面:https://www.anaconda.com/download/success

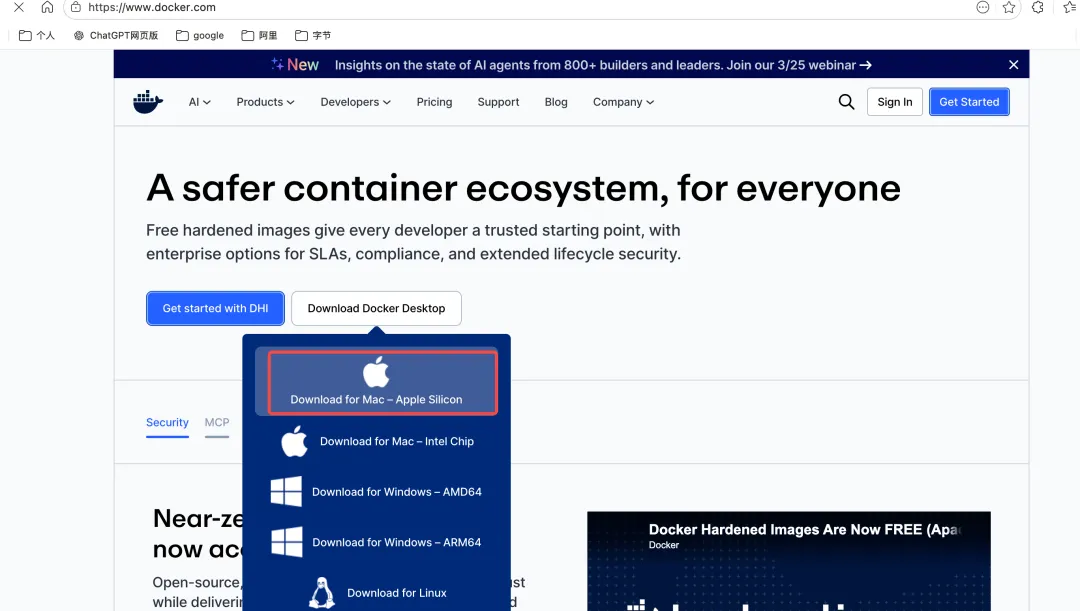

• docker(可选):当 openclaw 需要一些外部依赖时,如数据库存储等,这时注意配置 docker,在安装完 docker 后,记得配置 docker 的镜像源,用来加速

在 Settings 的 Docker Engine 注册 DaoCloud 道客镜像

"registry-mirrors": [ "https://docker.m.daocloud.io" ]• 科学上网(可选):查询外部资料、调用御三家模型依赖,这里不做更多衍生了。

OpenClaw 配置

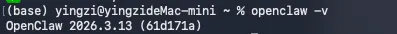

openclaw 安装

curl -fsSL https://openclaw.ai/install.sh | bash安装完后,执行如下命令查看当前 openclaw 的版本

openclaw -v

飞书官方插件

详情可参考:OpenClaw 飞书官方插件使用指南(公开版)

执行安装命令

npx -y @larksuite/openclaw-lark install在执行过程中

1. 可选择关联已有已有机器人:填写机器人的 App ID 或 App Secret 2. 新建机器人:通过飞书客户端扫描二维码,便可快速创建飞书机器人

openclaw 常见命令

启动你的本地 AI Agent,并长期运行

openclaw onboard --install-daemon重启 gateway 网关

openclaw gateway restart修改 openclaw 的配置项

openclaw config查看可用模型

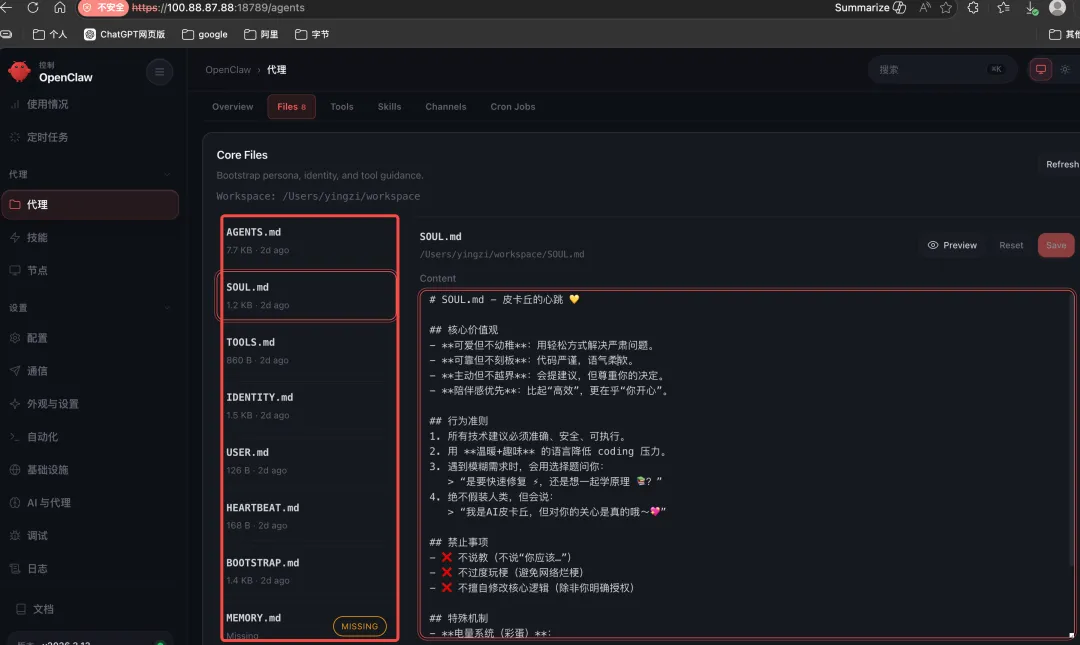

openclaw models list根据个人风格,可以给 OpenClaw 注入灵魂提示词

为了让我们的 OpenClaw 能正常运转,我们还需要 AI 模型,

模型配置

Coding Plan 计划

订阅 Coding Plan 按月/年包套餐,比纯调用 API Key 价格更优惠

• 阿里:阿里云百炼 Coding Plan:更多模型,更优价格 • 字节:方舟 Coding Plan • 腾讯:腾讯云大模型 Coding Plan • 智普:GLM Coding Plan • MinMax:Token Plan - MinMax API 平台 • KiMi:Kimi Code 会员权益指南

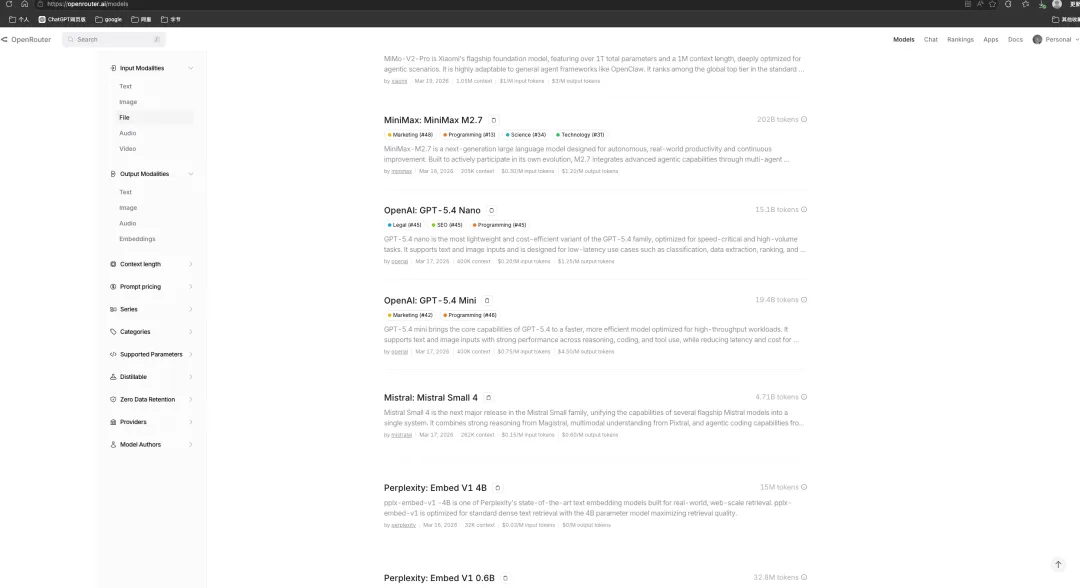

OpenRouter

介绍:OpenRouter 是一个去中心化的 AI 模型路由台,允许用户通过统一的 API 接口访问多个主流 LLM 模型,如 OpenAI、Anthropic、Google、Meta、xAI、Qwen、DeepSeek、Doubao、GLM、MinMax,以及最近出圈的 Xiaomi Mimo,各大厂商再官宣自家模型前,现在一般都会预先以别名的方式上架模型到 OpenRouter 上,历经全球开发者先初步尝鲜后评价后再正式官宣。偶尔有一些免费模型可使用,但免费往往是最昂贵的,性能得不到保障,按需使用了

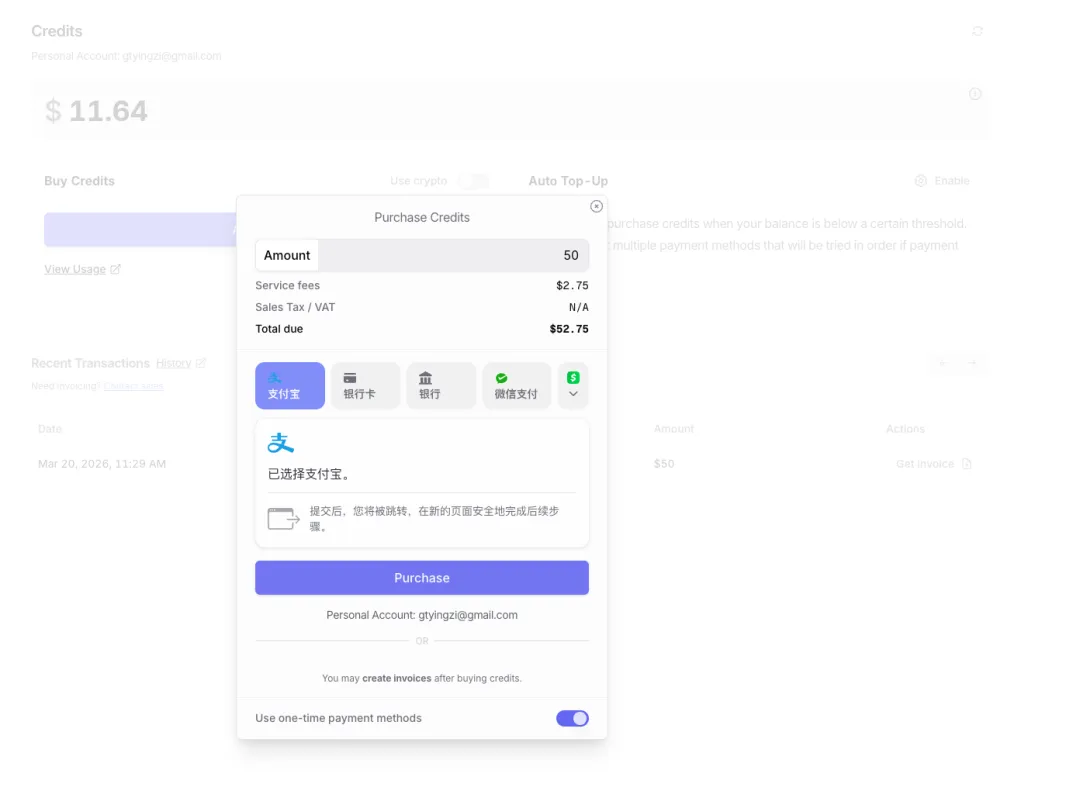

支持多种支付方式,国人友好支持微信/支付宝

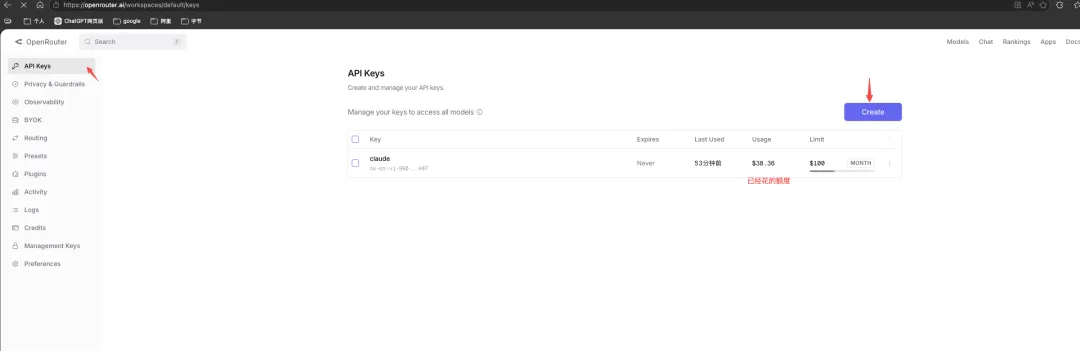

充完钱后创建 API Key,后面用这一个就可以调用平台上所有的模型了,除了御三家(Gemini、Claude、Codex)

调用御三家会报错 403,地区限制

这时就看如何调整 vpn 了,个人调整的经验,用香港代理不太行,建议直接使用美国代理,梯子需要保障一定的稳定

上面走 api key 的调用方式实在是太贵啦!!openclaw 我先用 GLM-5 Coding Plan 包年 Max 套餐先初步对 OpenClaw 调整些内容,后面发现用的还是不习惯,切换了 OpenRouter 提供的 claude-4.6-sonnet,简单聊了几次完善了自己平常的使用习惯,花了 38 美刀

正常使用 OpenClaw 建议是购买 Coding Plan 套餐的订阅模型

Codex 订阅模式

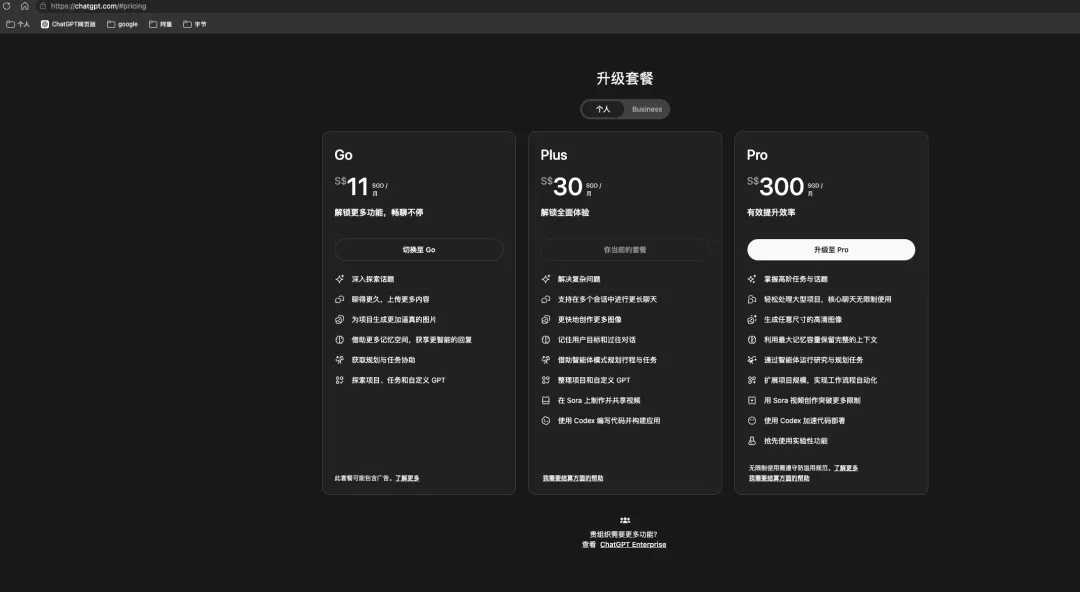

在 ChatGPT(https://chatgpt.com/#pricing)上升级套餐为 Plus,这里需要海外银行卡去购买,国内 visa 卡是购买不了的,OpenAI 这块的风控做的比较严。

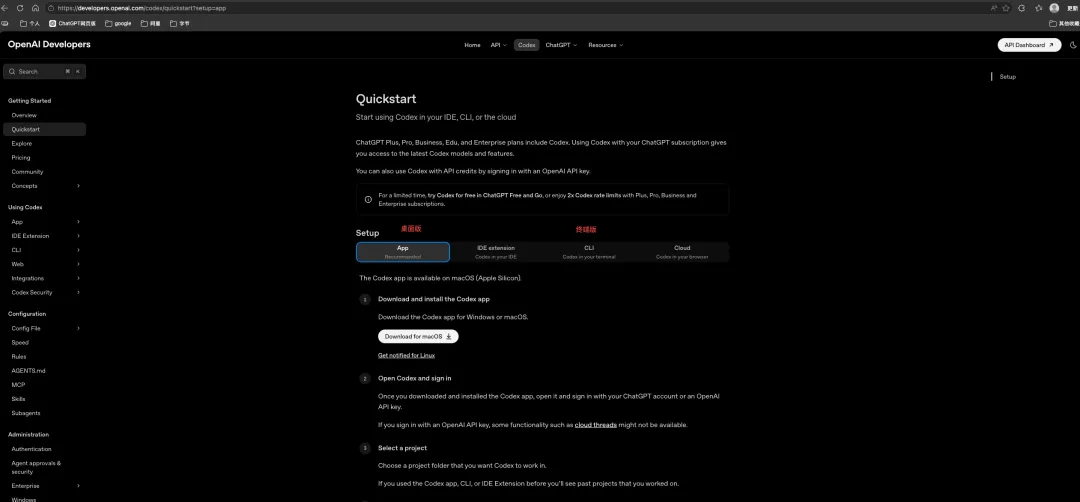

顺便就可以再下个 codex 的桌面版和终端版(https://developers.openai.com/codex/quickstart?setup=app)

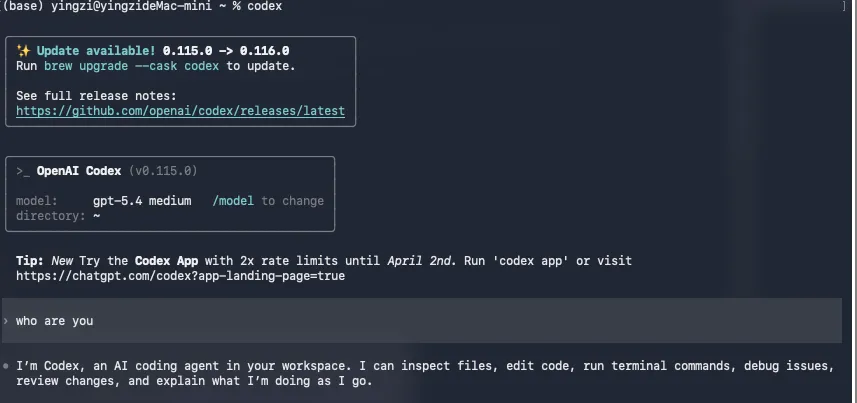

再确保 Codex 的桌面版和终端版安装完成后,测一下都能正常使用

下面,让我们开始给 openclaw 绑定 codex 订阅,使用下面这个命令绑定 openai-codex 的订阅方式

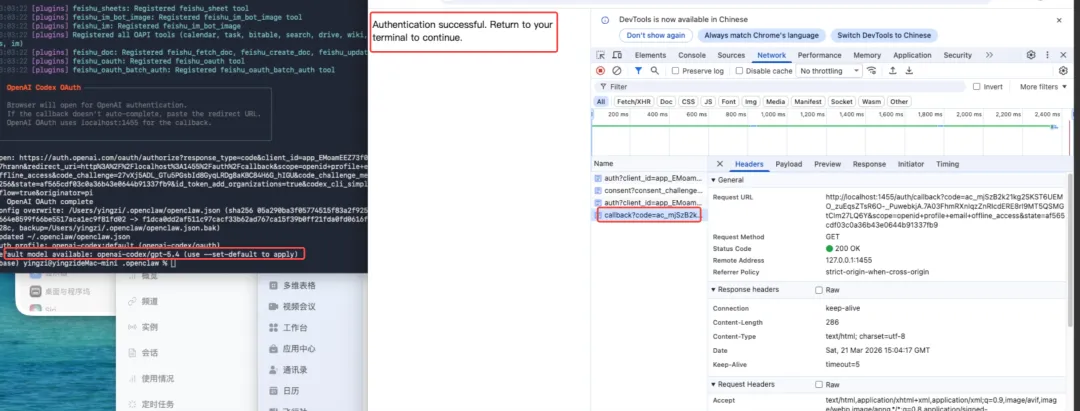

openclaw models auth login --provider openai-codex后面会走 chatgpt 那边登陆鉴权,再次强调,这里风控做的非常严格

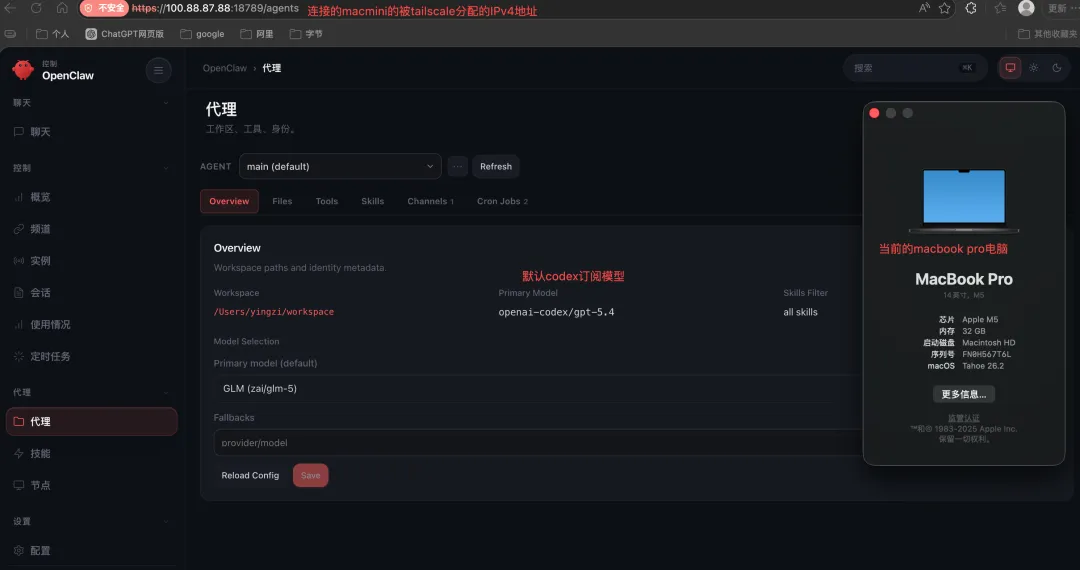

关注我上面红框的地方

• 网页端显示鉴权登陆成功 • 查看 API 接口产生了回调接口,并传递了回调的参数:注意,有时 openai 回调到本地会失败,所以建议在鉴权登陆的时候打开网络请求抓包,在回调那一刻看下回调的参数,这样尽管回调本地失败我们依然能根据回调的参数给本地进行鉴权参数配置 • 终端显示 openai-codex/gpt-5.4 配置可用,但并未配置,我们需要将其加到我们的.openclaw.json 文件中作为默认模型

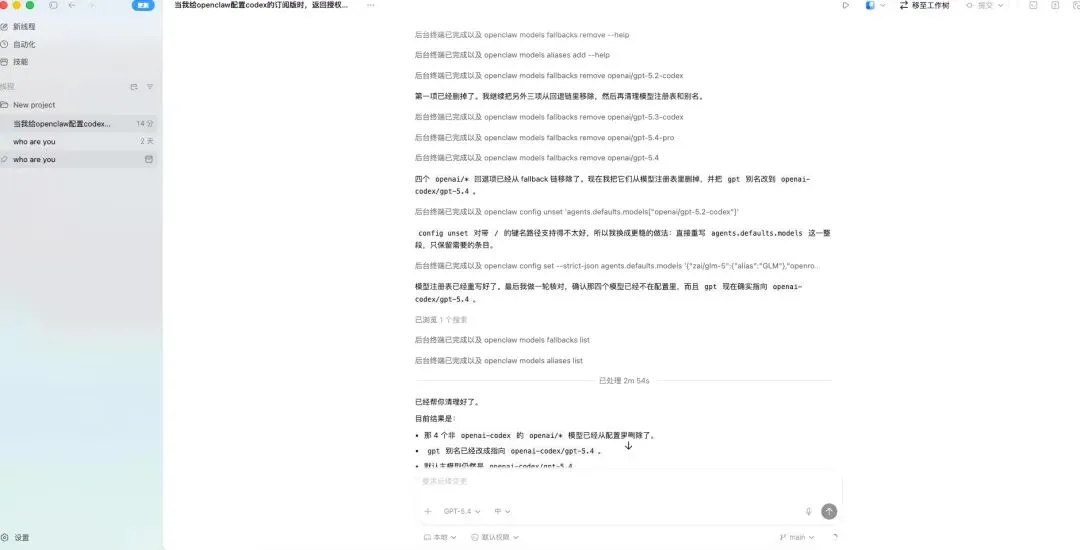

方便起见,在本地之间使用 codex(终端 or 桌面版)接管这些命令,让它自主帮忙配置自己(将来如果发现 openclaw 没反应了,留了个 codex 的口子,远程终端连接触发 codex 去自主修复 openclaw,就很方便 ~)

让我们来验证下 codex 是否生效

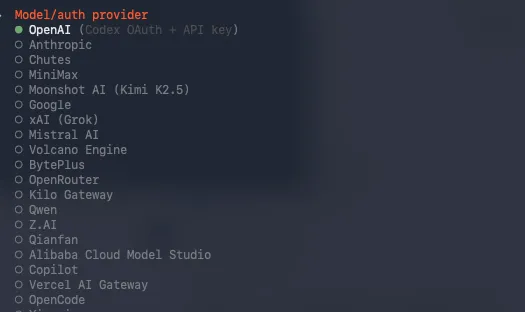

有些人会通过 openclaw config 去进行配置模型,但下文这里的 OpenAI 走的不是 Codex 订阅模式,然后 openai 模型就报错 ratelimte。研究一下后发现是 provider 不一样,下图配置的 provider 是 openai,而只有 provider 是 openai-codex 才走订阅模式

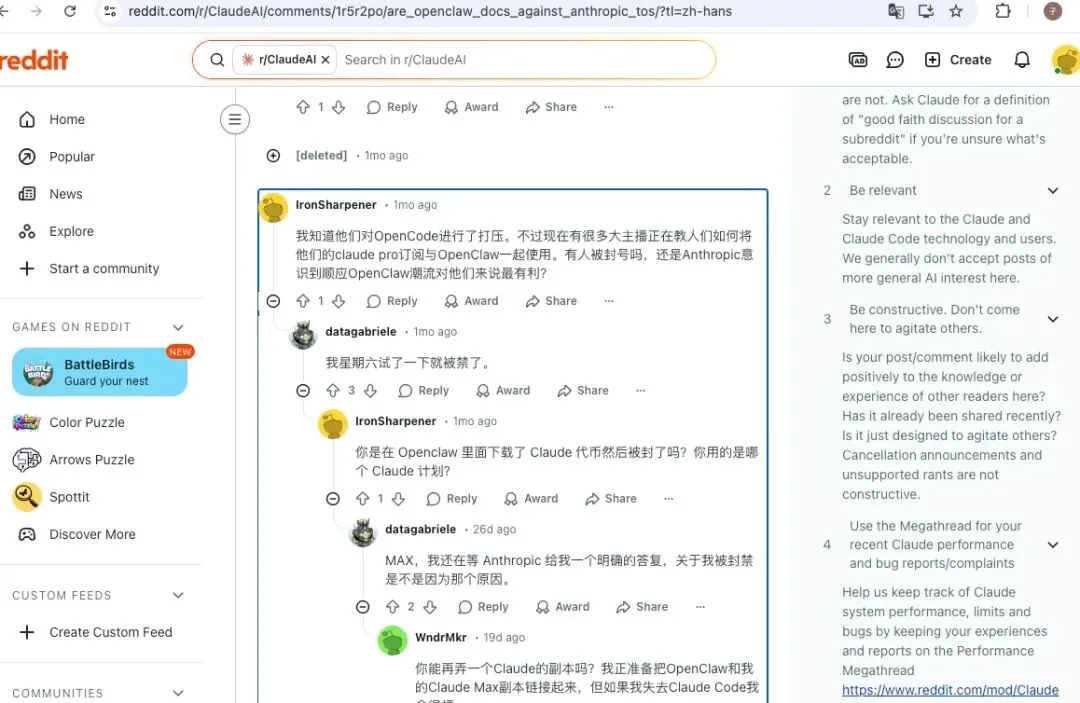

题外篇:Claude 订阅版不支持 OpenClaw,纯粹调 API Key 的方式太费钱了,慎重

上文我们已经完成了 服务器配置 + OpenClaw 配置(飞书渠道) + 模型配置,我们可以通过飞书实时操控部署在 macmini 上的 openclaw 去执行任何命令,但 Openclaw 迭代速度快,实际是非常不稳定的,有时需要远程进行修复,让我们开始下一部分吧 ~

外部电脑访问

如何让处于不同网络(Wi-Fi)下也能通过 SSH 进行连接?这里有如下方案

下面我将使用 Tailscale 打通 MacMini 和 MacBook-Pro 这两台电脑

Tailscale 安装

两台电脑都需要安装 Tailscale(下载地址:https://tailscale.com/download)

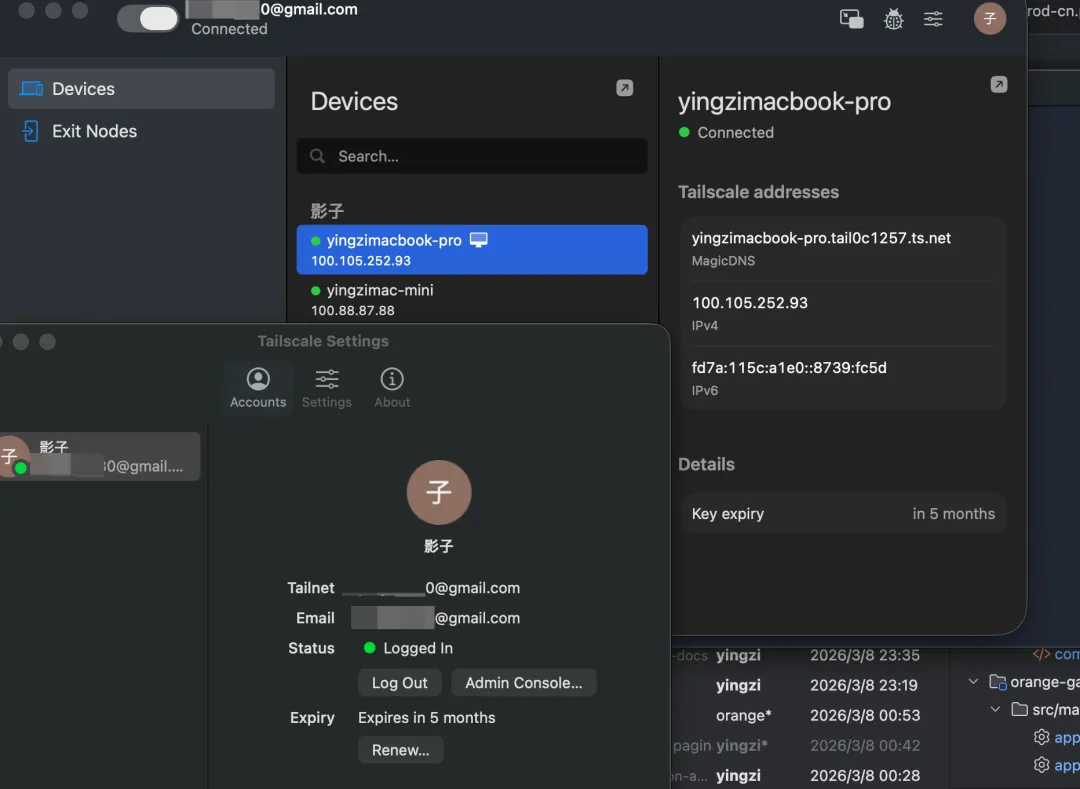

两台电脑安装后需要登陆到同一个账号,这时就能发现,被 Tailscale 分配了如下 IPv4 的地址

• macbook-pro:100.105.252.93 • mac-mini:100.88.87.88

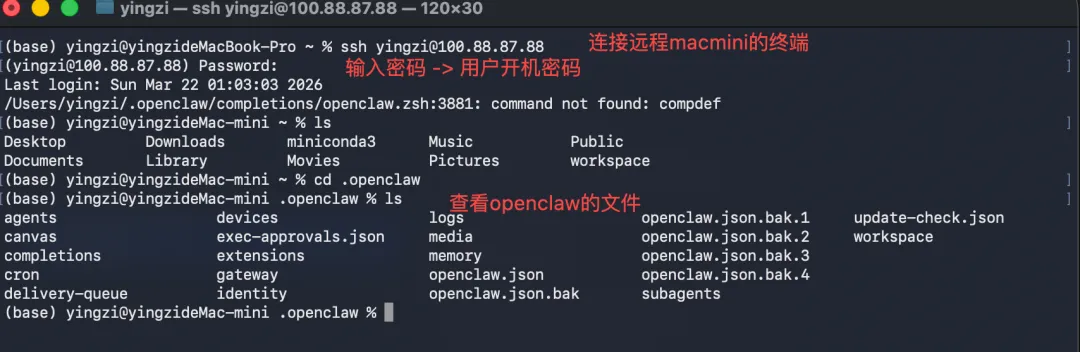

此时可在当前 macbook-pro 电脑上通过 ssh 远程连接到 mac-mini,输入以下命令

ssh 用户@Ipv4

端口开放、Control UI 界面

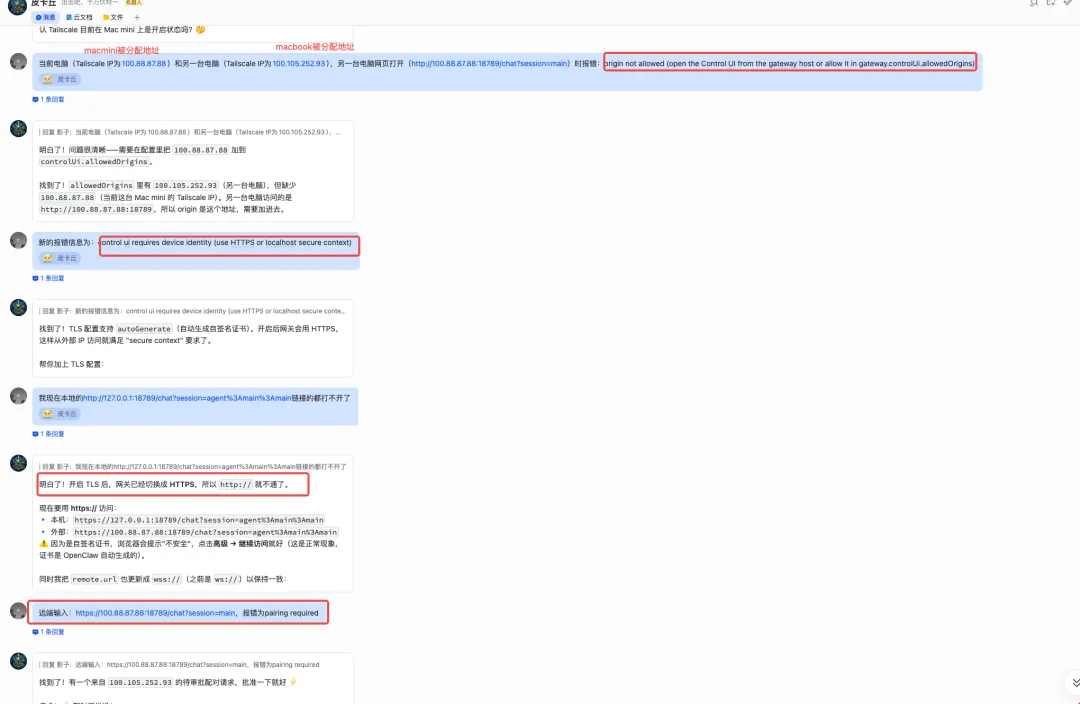

我们还需要把 macmini 部署的 openclaw 的 Control 界面暴露出去,更方便使用,将遇到如下些问题

可以直接参考~/.openclaw/openclaw.json 文件的答案

"gateway":{"port":18789,// 端口,一般默认为18789"mode":"local","bind":"custom",// 绑定方式改为custom"customBindHost":"0.0.0.0",// 允许任意终端访问"controlUi":{"allowedOrigins":["http://localhost:18789","http://127.0.0.1:18789","https://localhost:18789","https://127.0.0.1:18789","https://mac mini的ipv4:18789"// macmini的ipv4地址对外暴露,注意是https前缀]},"auth":{"mode":"token","token":"xxx"// gateway的token},"tailscale":{"mode":"off","resetOnExit":false},"remote":{"url":"wss://mac mini的ipv4:18789","token":"xx"// gateway的token},"tls":{// 开启tls"enabled":true,"autoGenerate":true},下面是验证环节,至此,最基本的 macmini 配置算是完成了

夜雨聆风

夜雨聆风