用 OpenClaw 的人,大概都遇到过一个很烦的时刻。

项目刚聊到顺手,前面铺垫过的人设、目录结构、改过的方案、甚至你反复强调过的约束,突然就像被它自己吃掉了一样。你只能重新提醒一遍。一次两次还行,次数多了,真的很像在带一个记性不太稳定的实习生。

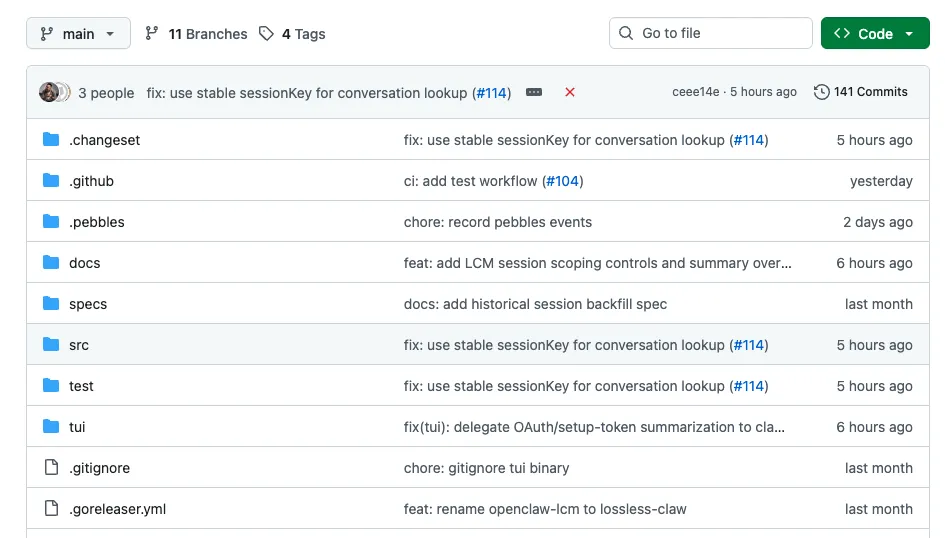

OpenClaw 作者自己显然也意识到了这事,所以最近推荐了一个开源插件:lossless-claw。

这东西我觉得有意思,不是因为它又发明了什么新交互,而是它很实在,解决的就是 AI 工具最常见、也最影响体验的老毛病:上下文会掉。

它的做法也不复杂。简单说,就是把每条消息都先存进 SQLite,不让原始记录直接消失;然后后台再把旧消息一点点压成树状摘要。这样一来,模型眼前看到的是被整理过的“精简上下文”,但真要追细节的时候,又能顺着摘要把原始内容捞回来。

这个思路挺像什么呢。不是把旧聊天记录粗暴删了,而是先收进档案室,再给你做索引卡。

所以它最值钱的地方,不只是“省 token”,而是省掉那种反复提醒 AI 的疲惫感。你和它聊复杂项目时,不会总担心前面那些关键设定白讲了。

更细一点说,lossless-claw 还给 AI 配了几把专用“翻档案”的工具,比如 lcm_grep、lcm_describe。忘了某个细节,它可以自己去翻旧记录,而不是继续一本正经地瞎接话。这个体验上的差别,其实很大。

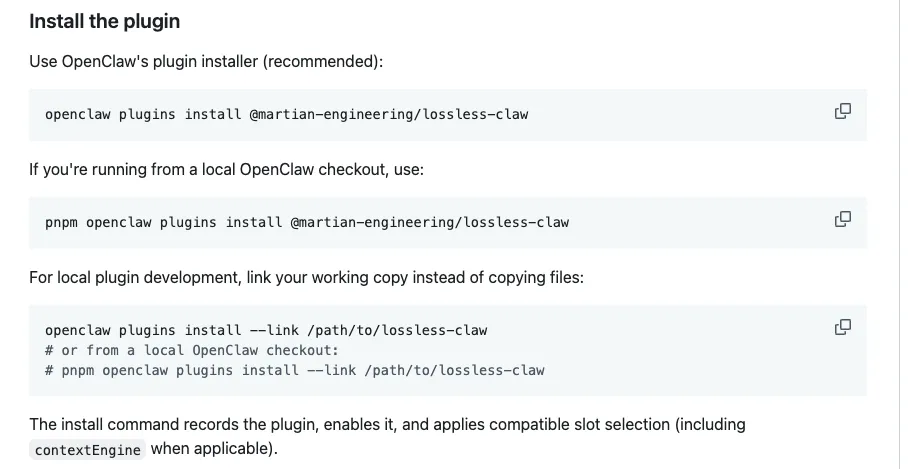

安装也很直接,一条命令就能进 OpenClaw。你还能自己调参数,比如最近多少条消息不要压缩、上下文到什么阈值开始整理、摘要用哪个模型来跑。对折腾工作流的人来说,这种可调节空间比“装完就完事”的黑盒方案更舒服。

我自己的感觉是,很多 AI 工具现在的问题,已经不是“不够聪明”,而是记忆管理太粗糙。明明能干活,但聊长了就断片,整个协作感会立刻塌下来。

如果你正拿 OpenClaw,或者别的 AI Agent 工具做复杂项目,又总被上下文限制折腾到反复喂信息,那这个插件确实值得试一下。

它不是什么很炸裂的新能力。

但它做的是另一件更重要的事:尽量别让 AI 把你已经说过的话,再忘一遍。

GitHub地址:martian-engineering/lossless-claw

夜雨聆风

夜雨聆风