编辑:姐玞

编辑:姐玞 排版:姐玞

排版:姐玞1. 趋势背景:为什么供应链要选择本地化的AI模型?

上周跟一个做医疗器械的朋友吃饭,他跟姐玞吐苦水:"姐玞,我们现在找供应商,跟大海捞针一样。每家都得手动查资质、看产能、核ESG报告,光一个产品就要筛上百家,眼睛都快瞎了。"

我很疑惑:"为啥不用AI帮你筛?我两周前公众号还分享方法来着..."

他苦笑:"我们试过啊!但一上传供应商资料,法务就跳脚——医疗器械这种敏感数据,谁敢放到云端API处理?万一泄露,整个公司都得跟着遭殃。"

这对话让我意识到:供应链AI应用的痛点,已经从"能不能用"变成了"敢不敢用"。

在数据隐私法规日益严格的2026年,企业面临两难选择:

- 云端API

:方便快捷,但每次调用都在"裸奔"——数据飞向第三方服务器,存在泄露风险 - 本地部署

:数据安全,但技术门槛高、部署复杂、维护成本大

然而,这种困境正在被打破。随着Ollama这样的本地大模型框架成熟,以及OpenClaw爆火出现和不断完善,本地化AI部署的门槛已从"专家级"降到"小白级"。今天,姐玞就带小伙伴们,手把手搭建一个完全私有化的供应链本地AI模型,姐玞已经亲测使用中了。

2. 技术架构:Ollama+Anything LLM+OpenClaw黄金组合解析

要理解本地AI的搭建逻辑,你得先知道这三大核心组件如何协同工作:

| Ollama | ||

| OpenClaw | ||

| Anything LLM |

这个三层架构的核心逻辑是:

- Ollama作为"大脑"

:负责自然语言理解和推理,全程在本地运行,零API调用 - OpenClaw作为"双手"

:根据指令执行具体任务,如搜索供应商、评估风险、发送邮件 - Anything LLM作为"记忆"

:存储企业专属知识,如供应商数据库、行业标准、合规要求

这个架构的最大优势是数据闭环:所有信息都在企业内部流转,绝不触碰外部服务器。对于医疗器械、军工、金融这类敏感行业,这种私有化部署是刚需而非可选项。

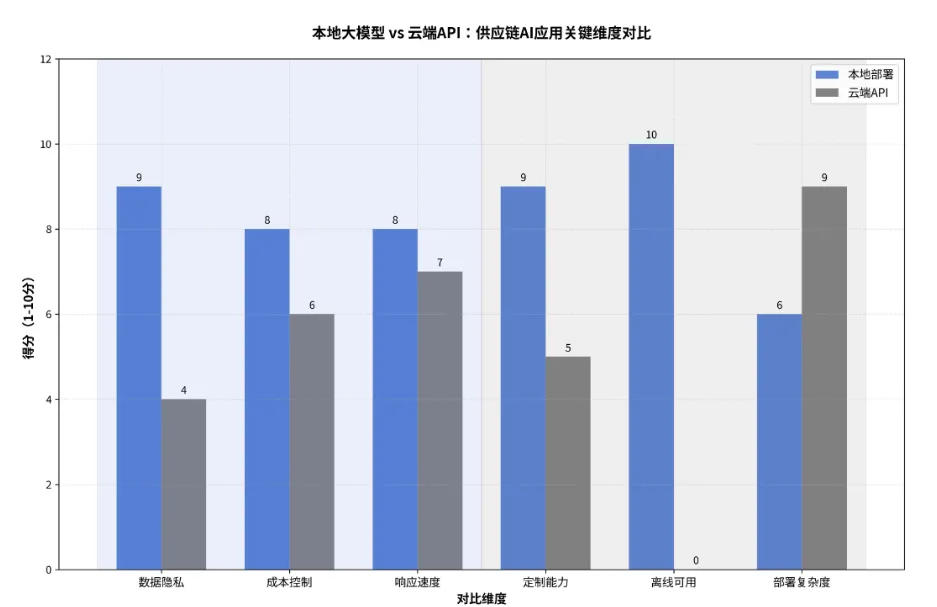

本地大模型 vs 云端API在供应链AI应用中的关键维度对比

3. 应用示例:供应链AI的典型应用场景(简化版)

你可能在想:"这套技术听起来很酷,但具体能帮我做什么?"姐玞给你三个典型应用示例:

场景一:智能供应商初步筛选

传统方式:采购专员需要手动登录1688、阿里巴巴等平台,一家家查看资质、产能、评价。

AI赋能后:通过自然语言指令让AI自动搜索符合条件的供应商。

场景二:需求预测辅助分析

传统痛点:供应链经理凭经验判断备货量,容易出现判断偏差。

AI解决方案:将历史数据上传到知识库,让AI基于数据进行分析预测。

场景三:供应链风险基础监控

AI能做什么:设置监控Agent,关注供应商动态、行业新闻等基础信息。

重点说明:这些是基础应用示例,实际部署后可以根据企业具体需求进行深度定制。本地化AI的最大优势就是可以完全按照你的业务逻辑进行训练和优化。

4. 详细部署实操:小白喂饭操作!

现在进入核心实操环节。按照以下8大步骤、30+具体命令行操作,小白也能30分钟完成部署。每一步姐玞都为你准备了详细的命令、验证方法和常见问题排查:

第1步:系统环境检查与准备(3分钟)

操作系统:

Windows 10/11 或 Linux (Ubuntu 20.04+)

硬件要求:

GPU: 推荐 RTX 30xx 系列或以上(支持 CUDA)

显存: ≥16GB VRAM

CPU: Intel i5 / AMD Ryzen 5 或更高

内存: ≥32GB 推荐(大量代码上下文可能占用内存)

其实姐玞试过集成显卡(办公级)也可行,只是模型的支持问题,咱们先做起来,然后大部分职场小伙伴或者供应链伙伴,使用的多是Windows系统,所以姐玞以Windows本文以这个为例。(其他系统小伙伴可以私信姐玞手把手教程~~)

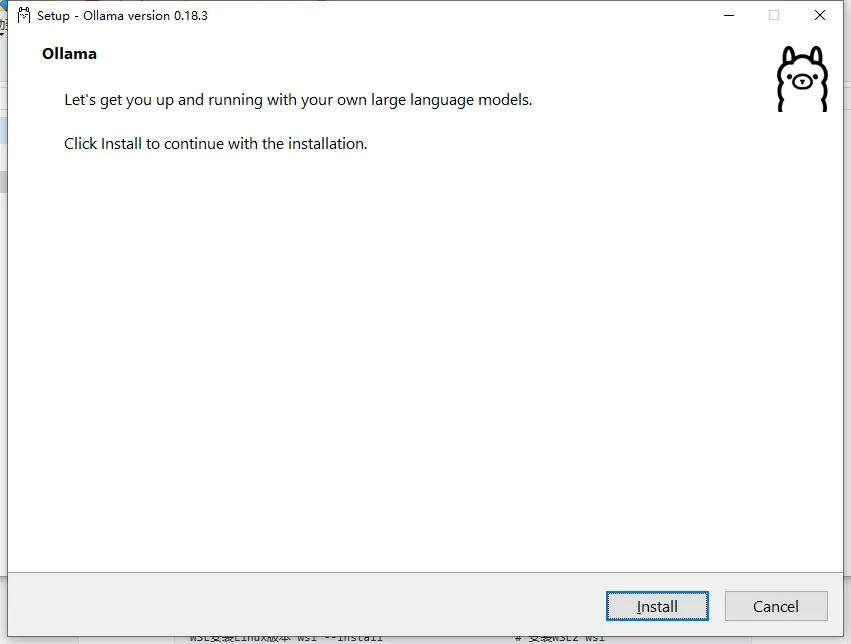

第2步:安装Ollama本地大模型框架(5分钟)

首先姐玞先介绍下Ollama:它并非一款大模型,可以理解成它就是一个新手友好的,本地大模型部署工具,降低开源大模型本地部署的门槛,让非专业程序员也能轻松把Qwen(千问)、Deepseek 等开源大模型部署到自己的电脑服务器上。

Ollama 的特性就是 “简单快捷,小白友好”:

简化部署流程:无需复杂的环境配置,一个安装包就可以搞定~

内置标准化 API 服务:默认在固定端口提供兼容各类AI的接口规范的 API 服务,极大降低开发成本;

丰富的模型仓库:最关键的就是它具有可以免费下载的各类市面上的模型(Qwen、Deepseek);

多平台兼容:支持 Windows、Mac、Linux 等主流系统,无需担心环境适配问题。

一句话说明:Ollama就是本地大模型的“专用手机”,各类大模型已经在Ollama的应用商店了。它已经把复杂的部署、接口适配工作都包揽了,我们需要的模型等直接在应用商店进行下载就可以了。

下载安装包:

官网地址:https://ollama.com,官网界面是一只可爱的羊驼~~

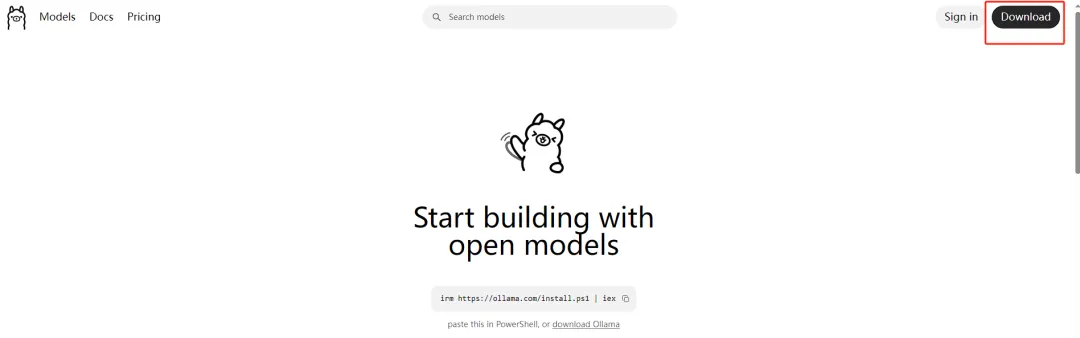

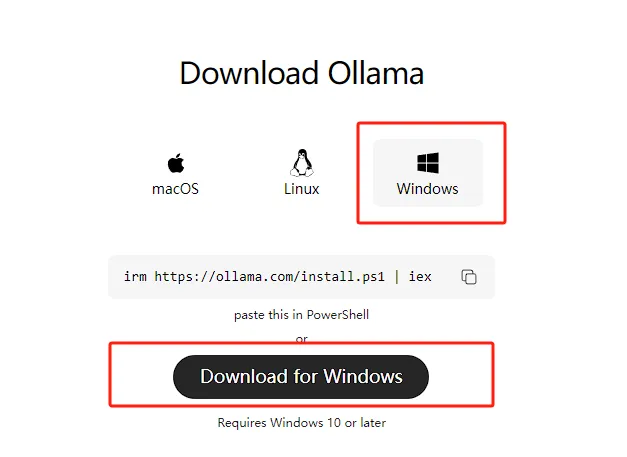

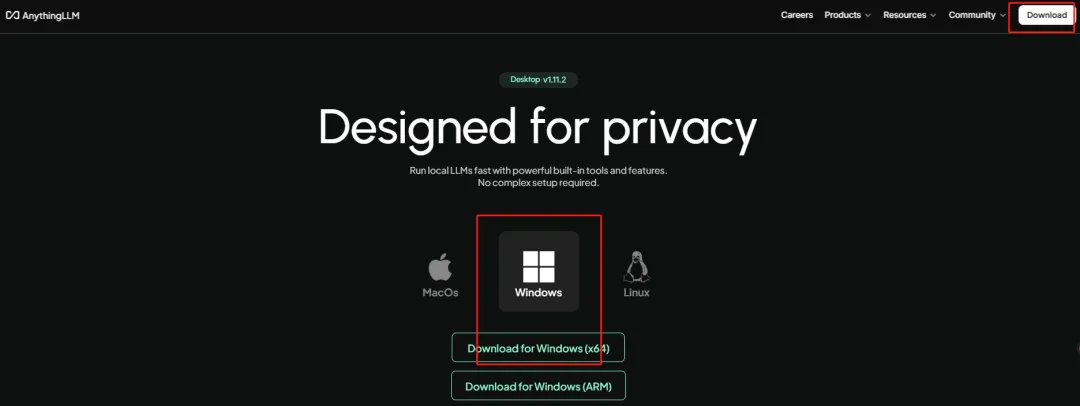

然后我们点击右上角的Download,就可以进入下载界面啦~然后选择对应系统的选项,在点击Download for Windows(如果是Windows系统的话)

注意,因为Ollama毕竟是外网,所以国内的用户下载起来会比较慢~~可以耐心等待or采用国内的镜像链接(也可以私信姐玞,姐玞可以提供安装包~~)

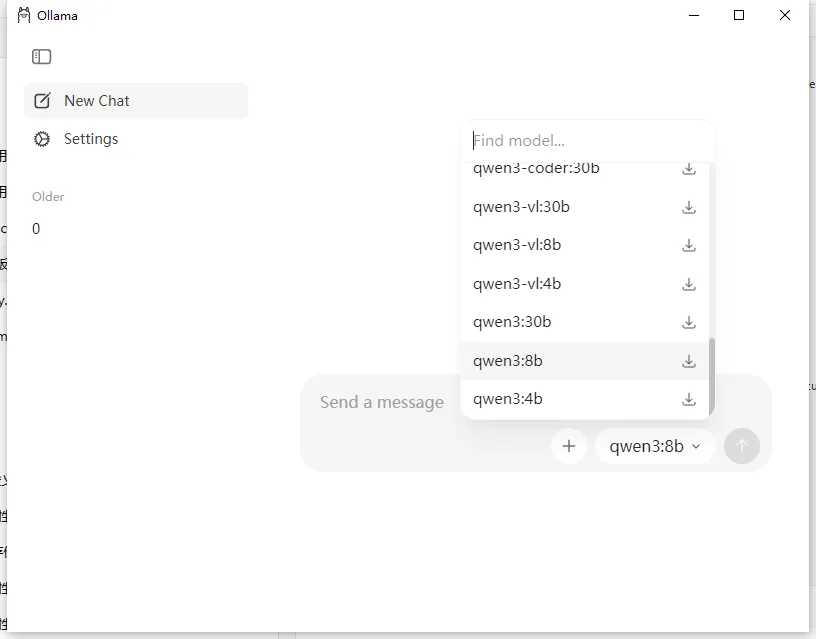

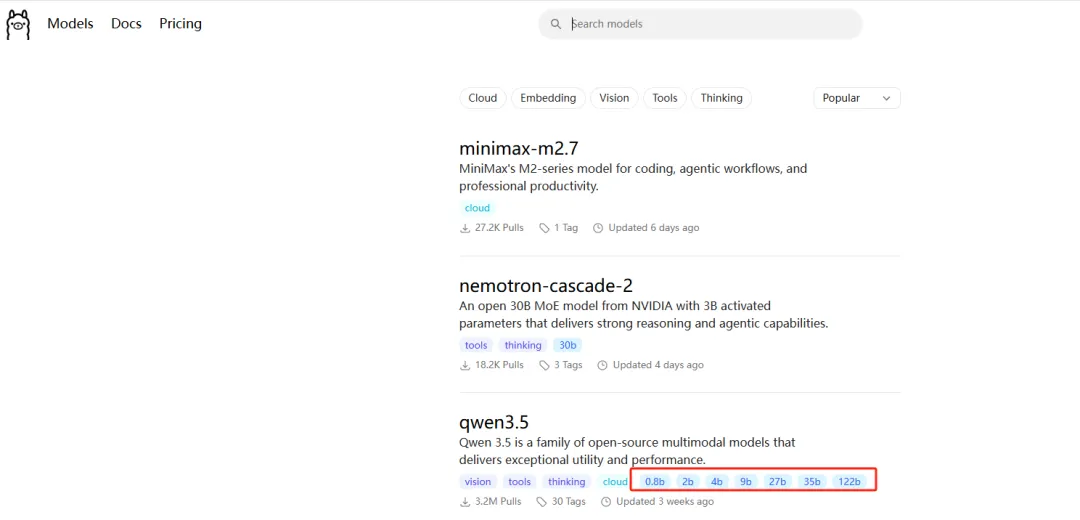

模型选择建议:【注意:ollama会有一个下载地址是models的这个建议不要放在C盘,因为这个是下载对应的大模型,整体空间占用比较大~】

| Qwen3.5:7b | |||

| DeepSeek-R1:8b | |||

| Llama3.2:7b |

第4步:部署Anything LLM知识库系统(4分钟)

同样的官网地址:https://anythingllm.com

选择download-Windows

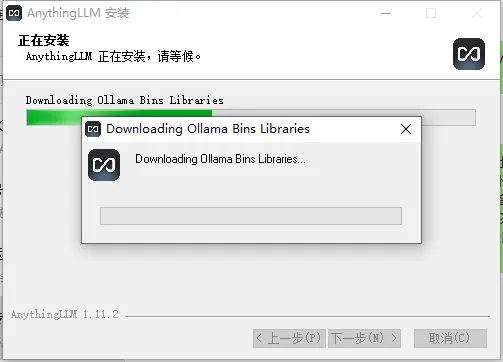

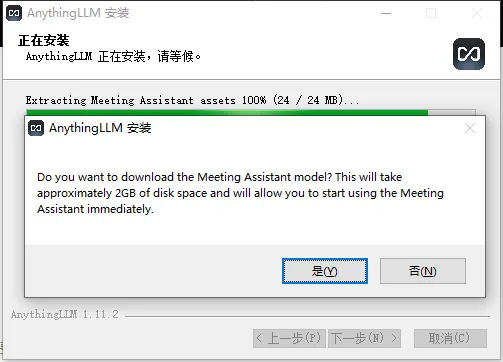

整体安装进度比较快~耐心等待即可~其实上述进度卡主的话,也可以关闭,不影响整体进度额~

这里可以点击否,然后就是完成安装运行我们的知识库Anything LLMl啦~【注意注意注意!!Anything LLM运行期间,一定要保持ollama正常运行,这个是前提条件,也就是ollama运行,启动LLM才可以选择对应的本地大模型】--不过现在Anything LLM也可以自行下载对应的大模型,姐玞主要还是觉得ollama比较稳定选择较多~~

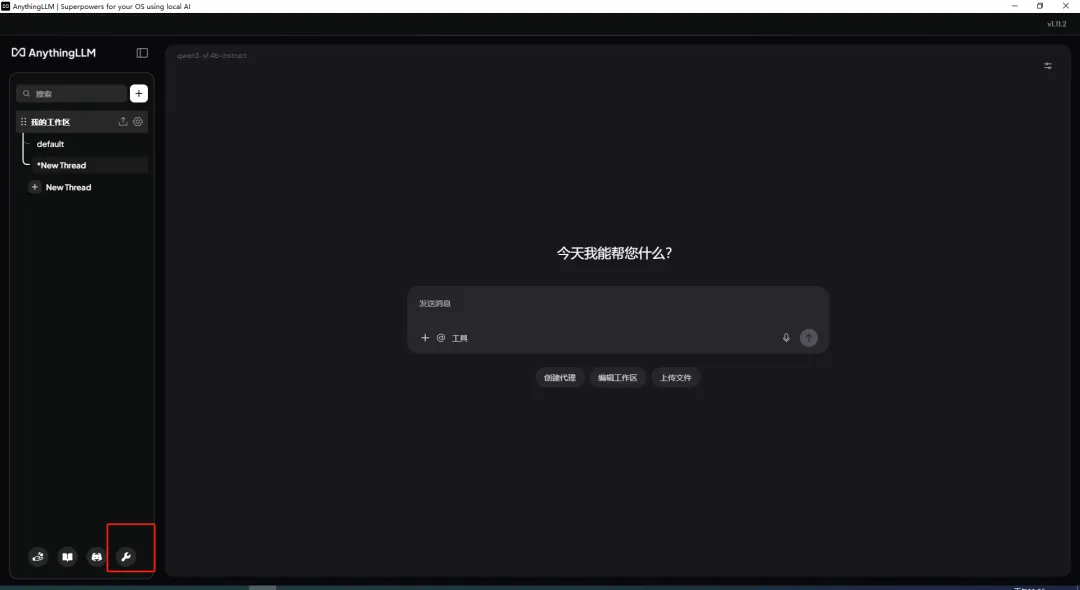

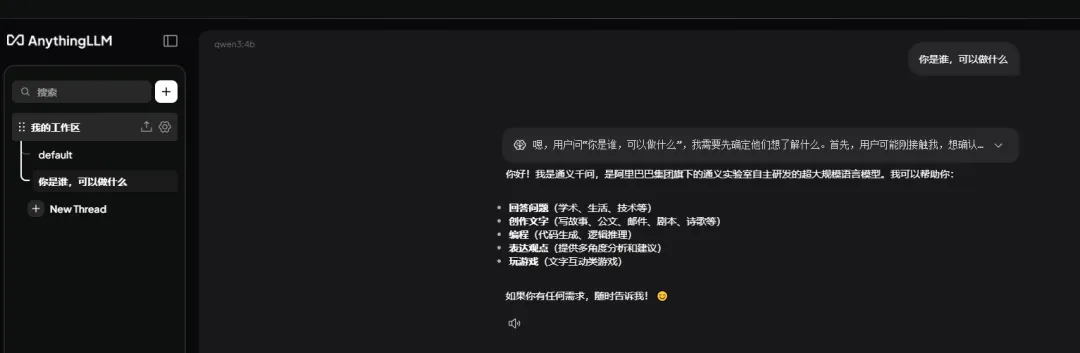

这就是我们的主界面,点击左下角的小扳手~就是设置按钮

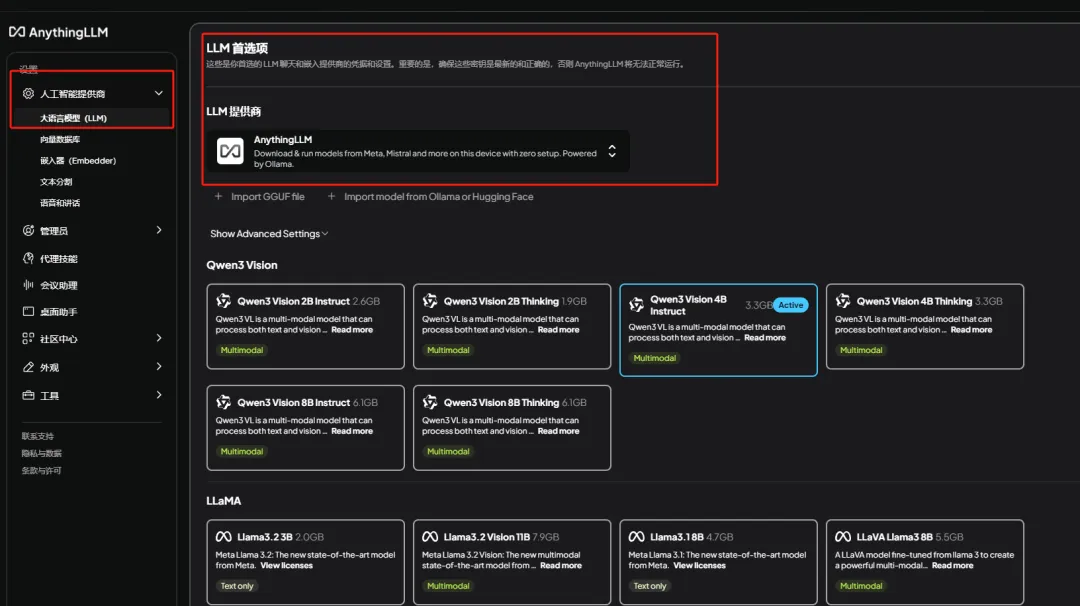

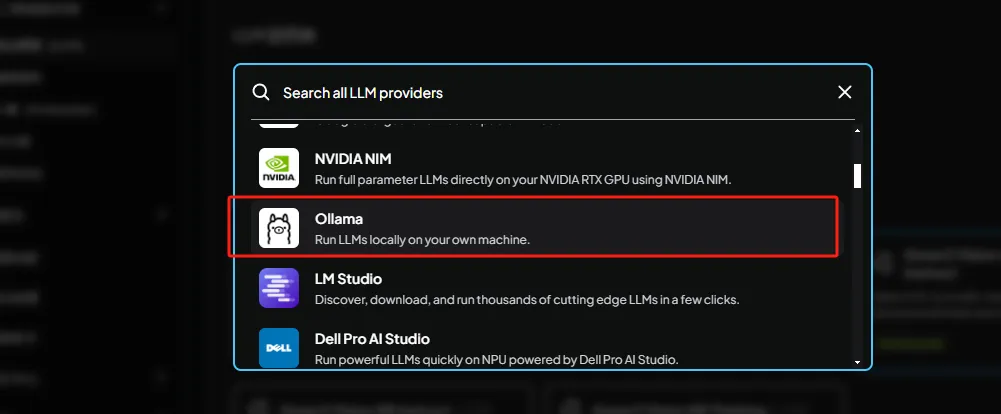

可以看到左侧有对应的LLM提供商,我们在右侧这里点击下拉

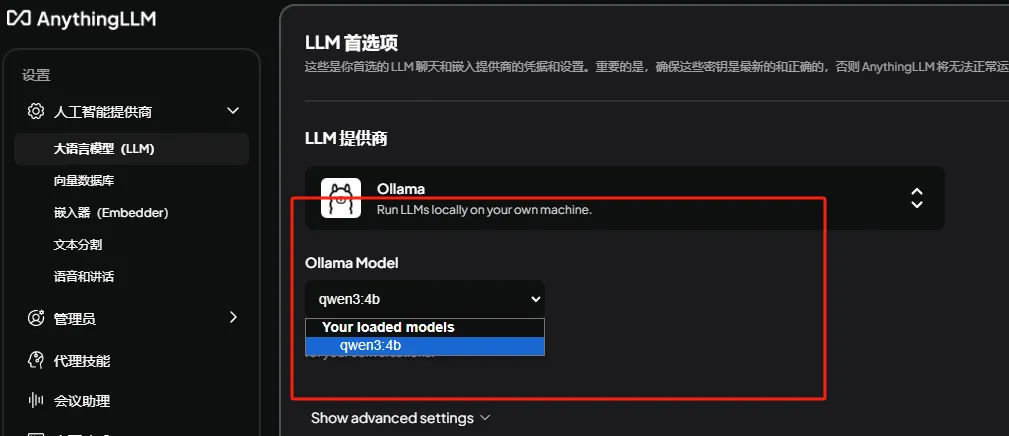

这里选择我们已经下载的模型,比如姐玞这里就是qwen的4b模型

保存后,我们返回工作区试着问一下:

所以整体我们的第一步,ollama本地部署大模型+Anything LLM知识库的首次互通已经达成啦!

第5步:常见问题排查与优化(3分钟)

问题排查表:

性能优化建议:

部署完成验证清单:

✓ Ollama服务正常运行(端口11434) ✓ 至少一个AI模型下载完成 ✓ OpenClaw网关正常运行(端口18789) ✓ Anything LLM服务可访问(端口3001) ✓ 知识库至少上传了3个文档 ✓ 测试指令能正常响应

至此,一个完整的本地AI系统就搭建完成了。整个过程无需一行代码,全是复制粘贴的"喂饭级"操作。

小伙伴们可以先自己尝试不同的模型和调试,ollama的界面也是可以直接和大模型进行沟通,部署实操的上篇先到这里~下一篇的和openclaw的协作调用,也会详细喂饭操作给到大家~~~

与其担忧AI会替代什么,不如思考AI能为你创造什么。从现在开始,打造一个真正属于你的供应链智能大脑——它不向云端泄露任何秘密,却能为你的决策提供无限智慧。

我是姐玞,一个致力于让AI技术"说人话、办实事"的供应链从业者。如果你在部署过程中遇到问题,随时可以来找我交流。

💡 思考题

小伙伴们有在业务中碰到合规和保密的卡点么?欢迎在评论区分享~

如果觉得这篇文章对你有启发,欢迎:

👍 点赞 · 👀 在看 · 📨 转发

下一篇预告:《从"超级供应链"到OpenClaw:AI如何重塑采购寻源的全链路?》关注姐玞的公众号,第一时间接收更新!

夜雨聆风

夜雨聆风