OpenClaw(小龙虾)被Red Hat选中!一套方案解决AI智能体上生产的4个致命问题

LangChain/CrewAI/OpenClaw——带着你的智能体来,我们给它企业级能力

"本地好好的,一上生产就出事"

这是很多企业AI团队的困境。

隔离、身份、权限、审计——这些在笔记本上不重要的东西,在生产环境全是坑。

这4个致命问题,Red Hat刚刚给出了一套不用重写代码的解决方案。

而OpenClaw(小龙虾),成为首个完整验证的参考实现。

引言:从"本地跑得通"到"生产跑得稳"

AI智能体的世界很"混乱"——团队们各显神通:LangChain、LlamaIndex、CrewAI、AutoGen,或者从零自建。这很好,创新阶段本应如此自由。

但当智能体离开开发者的笔记本电脑,开始访问生产数据、调用外部API、在共享基础设施上运行时,没有护栏的自由就不再是特性,而是隐患。

2026年3月,Red Hat正式发布AI智能体企业化部署蓝图,选用OpenClaw作为参考实现:

平台提供安全、治理、可观测性和生命周期管理,智能体保持原样——你带你的智能体来,我们给它企业级能力。

一、为什么选择OpenClaw?

OpenClaw(昵称「小龙虾」)是一个个人AI助手,能够跨多个渠道(WhatsApp、Telegram、Slack、Discord等)路由智能体交互,通过中央WebSocket Gateway统一管理。

关键特点:

多渠道整合能力 灵活的智能体交互路由 活跃的开源社区

但OpenClaw默认配置缺乏企业级管控:

无沙箱隔离 无角色访问控制(RBAC) 无工具调用追踪 无外部服务访问控制

Red Hat AI的解决方案: 用OpenShift原生能力填补这些空白,无需修改OpenClaw一行代码。

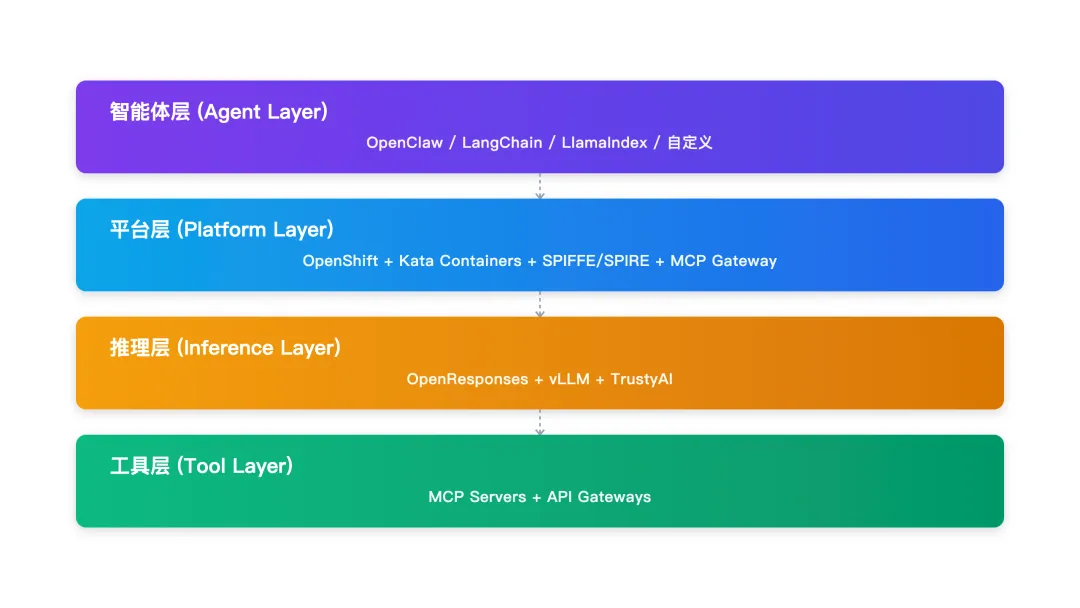

二、BYOA的核心架构

Red Hat AI的AgentOps策略建立在四个核心支柱上:

┌─────────────────────────────────────────────────────────────┐│ 智能体层 (Agent Layer) ││ OpenClaw / LangChain / LlamaIndex / 自定义 │├─────────────────────────────────────────────────────────────┤│ 平台层 (Platform Layer) ││ OpenShift + Kata Containers + SPIFFE/SPIRE + MCP Gateway │├─────────────────────────────────────────────────────────────┤│ 推理层 (Inference Layer) ││ OpenResponses + vLLM + TrustyAI │├─────────────────────────────────────────────────────────────┤│ 工具层 (Tool Layer) ││ MCP Servers + API Gateways │└─────────────────────────────────────────────────────────────┘三、4个致命问题,Red Hat逐一击破

问题1:隔离——一个智能体被攻陷,会不会殃及池鱼?

答案:内核级隔离。

OpenShift沙箱容器(基于Kata Containers项目,已GA)提供内核隔离执行,每个智能体会话独立运行:

主机和其他智能体的数据得到保护 即使智能体被攻陷,也不会影响其他工作负载 即将推出的agent-sandbox集成将提供更精细的智能体级隔离

问题2:身份——怎么证明这个智能体是"它自己"?

答案:加密身份,零硬编码密钥。

SPIFFE/SPIRE提供加密工作负载身份:

平台验证智能体身份 自动注入短生命周期、范围受限的服务账户令牌 无需硬编码密钥,由Kagenti集成管理智能体生命周期

问题3:权限——智能体能不能调用这个API?

答案:MCP Gateway在基础设施层做身份过滤。

基于Envoy构建,作为所有MCP服务器的单一安全端点:

| 身份过滤 | |

| OAuth2令牌交换 | |

| 凭据管理 |

关键价值:在基础设施层阻止提示注入攻击。

对于OpenClaw,只需设置一个MCP_URL环境变量。能调用哪些工具,取决于令牌声明,而非提示词内容。

问题4:审计——智能体干了什么,能查吗?

答案:全链路追踪,MLflow + OpenTelemetry。

MLflow Tracing(开发预览,计划GA):

捕获提示词、推理步骤、工具调用 记录LLM API请求和Token成本 OpenTelemetry兼容,可对接任何OTEL兼容的存储

四、安全生命周期:从开发到运维的完整闭环

4.1 部署前:对抗性扫描

Garak(计划集成到Red Hat AI)提供模型级漏洞扫描:

越狱攻击检测 提示注入检测 其他攻击向量识别

通过TrustyAI Operator集成,可在CI/CD流水线中执行对抗性扫描,确保智能体上线前通过安全测试。

4.2 运行时:推理边界防护

TrustyAI Guardrails Orchestrator(OpenShift AI 3.0已GA):

筛选模型输入输出 在响应到达智能体前强制执行安全策略

NeMo Guardrails(技术预览):

可编程的对话护栏 拦截不合规的LLM调用

4.3 部署后:持续评估

MLflow的评分和评估能力可用于随时间评估智能体质量,这些工作流计划通过EvalHub评估控制平面调用。

五、Kagenti:智能体生命周期自动化

Kagenti(计划作为OpenShift AI组成部分)填补了从笔记本到生产的鸿沟。

5.1 核心能力

| 自动发现 | |

| 身份注入 | |

| 追踪集成 | |

| 工具治理 |

5.2 AgentRuntime构造

Kagenti Operator通过AgentRuntime自定义资源,在不修改智能体代码的情况下:

注入身份 配置追踪 启用工具治理 管理完整生命周期

六、API选择:OpenResponses + vLLM

6.1 OpenResponses规范

OpenAI已开放Responses API规范,这是代理工作负载的主流API之一。Red Hat AI提供完全符合OpenResponses规范的实现,让团队能够:

在自托管或混合模型基础设施上运行智能体工作负载 保持OpenAI Responses API导向的智能体行为 将执行迁移到自主控制的基础设施

6.2 vLLM集成

对于不需要Responses API编排层的团队,vLLM(Red Hat AI组成部分)提供OpenAI兼容的/v1/chat/completions端点。

七、企业架构模式:四层架构

Red Hat这一方案验证了OpenClaw作为生产级工作负载的可行性,确立了企业架构模式:

┌─────────────────────────────────────────────────────────────┐│ 🤖 智能体层 - 保持原样,无需重写 ││ OpenClaw / LangChain / CrewAI / 自定义智能体 │├─────────────────────────────────────────────────────────────┤│ 🛡️ 平台层 - 提供安全、隔离、身份 ││ OpenShift + Kata + SPIFFE + MCP Gateway + Kuadrant │├─────────────────────────────────────────────────────────────┤│ 🧠 推理层 - 模型服务 + 安全护栏 ││ OpenResponses + vLLM + TrustyAI + NeMo Guardrails │├─────────────────────────────────────────────────────────────┤│ 🔧 工具层 - MCP服务器 + API网关 ││ 身份过滤 + OAuth2 + 凭据管理 │└─────────────────────────────────────────────────────────────┘八、开源生态:关键项目一览

九、总结:企业智能体的正确姿势

Red Hat的BYOA策略给企业AI团队带来三个关键启示:

✅ 1. 不要重写,要包装

智能体框架百花齐放是好事,企业不应该强制统一框架,而应该用平台基础设施统一安全、治理、可观测性标准。

✅ 2. 安全是多层次的

部署前:对抗性扫描(Garak) 运行时:推理边界护栏(TrustyAI + NeMo Guardrails) 基础设施层:身份、隔离、策略(SPIFFE + Kata + MCP Gateway)

✅ 3. 可观测性是信任的基础

智能体是随机的,没有执行追踪就无法调试或信任。MLflow Tracing + OpenTelemetry + EvalHub构成完整的可观测性栈。

💡 三步落地检查清单

如果你现在有一个准备上生产的智能体,先问自己三个问题:

隔离方案是什么?(Kata Containers已GA) 身份验证怎么搞?(SPIFFE/SPIRE,不用硬编码密钥) 工具调用谁管?(MCP Gateway做身份过滤)

文中提到的所有项目都是开源的。收藏这篇文章,下次架构评审用得上。

参考资料

Red Hat官方博客:Operationalizing "Bring Your Own Agent" on Red Hat AI, the OpenClaw edition OpenClaw官方博客:Red Hat Shows How to Operationalize OpenClaw for the Enterprise Red Hat AI产品文档

本文整理自Red Hat官方博客和OpenClaw官方发布内容,发布日期:2026年3月。

#AI智能体 #OpenClaw #RedHat #企业级部署 #AgentOps #BYOA #MCP #安全治理 #云原生

夜雨聆风

夜雨聆风