图 1:配置明明正确,却一直报"余额不足"

前言

最近在用 OpenClaw 接智谱(Z.AI)的 GLM 模型,明明订阅了 Coding Plan 套餐,配置也照着官方文档一步步来了,结果发消息一直报 429 余额不足。折腾了好一阵才找到根因,写下来希望能帮到遇到同样问题的朋友。

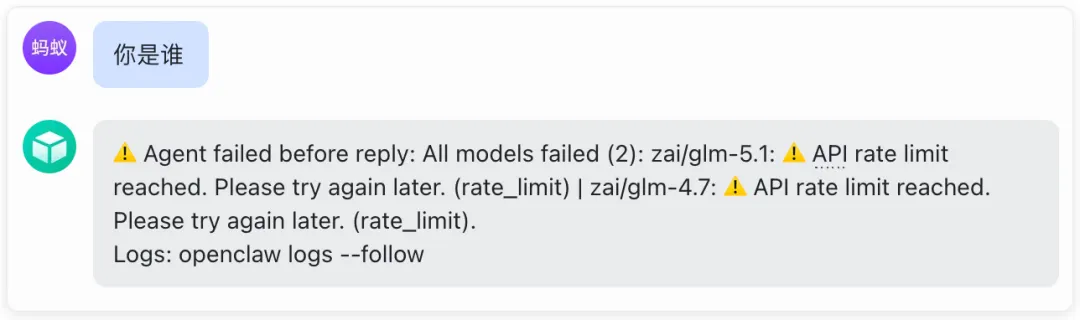

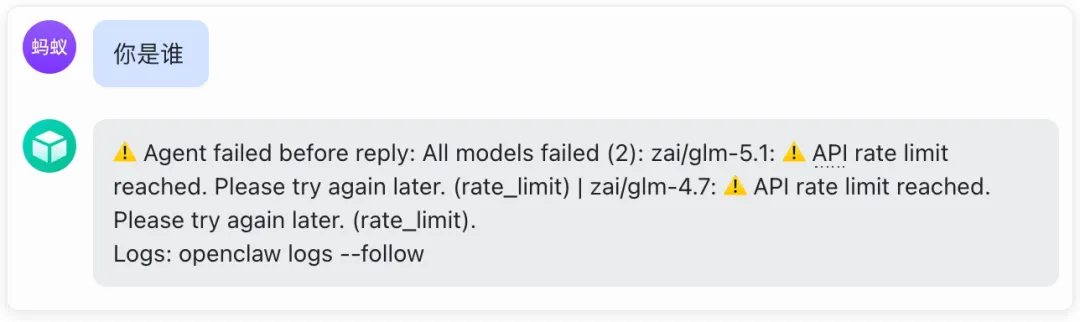

问题现象

OpenClaw Gateway 运行正常,飞书机器人也在线,但一发消息就收到错误:

⚠️ API rate limit reached. Please try again later. (rate_limit)

看日志,实际返回的是:

429 余额不足或无可用资源包,请充值。

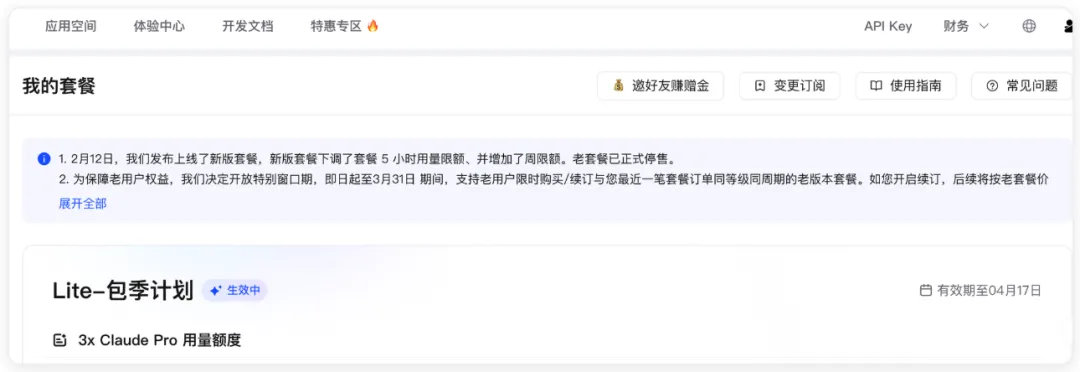

试了 glm-5.1、glm-4.7,全都报余额不足。但我的 Coding Plan 明明还在有效期啊!

图 3:套餐明明在有效期(生效中,有效期至 4 月 17 日),却还是报余额不足

图 2:OpenClaw 聊天界面显示 429 错误 — glm-5.1 和 glm-4.7 全部失败

踩坑过程

第一轮:怀疑 API Key 过期

刚开始以为是 API Key 的问题,去智谱开放平台重新生成了一个新的 Key。换上之后,还是 429。

第二轮:怀疑模型配置不对

仔细对照了官方文档 https://docs.bigmodel.cn/cn/coding-plan/tool/openclaw,把模型列表、参数(reasoning、contextWindow、maxTokens)、默认模型、fallback 配置全都改成和文档一模一样。结果——还是 429。

第三轮:直接 curl 测试 API

为了排除 OpenClaw 的问题,直接用 curl 调智谱 API:

# 用配置文件里的 baseUrl 测试curl https://open.bigmodel.cn/api/paas/v4/chat/completions \ -H "Authorization: Bearer <my-api-key>" \ -H "Content-Type: application/json" \ -d '{"model":"glm-5.1","messages":[{"role":"user","content":"你好"}]}'返回:

{"error":{"code":"1113","message":"余额不足或无可用资源包,请充值。"}}}再试免费模型 glm-4-flash:

curl https://open.bigmodel.cn/api/paas/v4/chat/completions \ -H "Authorization: Bearer <my-api-key>" \ -H "Content-Type: application/json" \ -d '{"model":"glm-4-flash","messages":[{"role":"user","content":"你好"}]}'返回正常!有回复内容。

第四轮:发现关键线索

既然配置和文档一致,问题肯定在更底层。我检查了 openclaw onboard 命令的帮助信息:

openclaw onboard --help在 --auth-choice 参数的选项中,发现了这几行:

--auth-choice zai-api-key # 普通 Z.AI API Key--auth-choice zai-coding-cn # 智谱 Coding Plan(国内)--auth-choice zai-coding-global # 智谱 Coding Plan(国际)根本原因

智谱有两套 API 端点,走不同的计费通道:

/api/paas/v4/ | ||

/api/coding/paas/v4 |

我之前配置的 baseUrl 是 https://open.bigmodel.cn/api/paas/v4/(普通端点),请求走的独立 API 余额计费通道,不是 Coding Plan 的额度池。所以即使套餐有效,系统也判定为"余额不足"。

解决方案

用 Coding Plan 专用模式重新运行 onboard:

openclaw onboard \ --auth-choice zai-coding-cn \ --zai-api-key "你的API Key" \ --non-interactive \ --skip-channels \ --skip-skills \ --skip-ui \ --accept-risk执行后,OpenClaw 会自动生成正确的配置:

- baseUrl

自动变为 https://open.bigmodel.cn/api/coding/paas/v4 - 模型列表

自动扩展到 12 个(glm-5、glm-4.7、glm-5.1、glm-5-turbo、glm-4.7-flash 等),并包含完整的参数和定价信息 自动添加 tools.profile: "coding"和 zai 插件

然后把默认模型改成官方推荐的 glm-5.1,重启 Gateway:

# 修改 ~/.openclaw/openclaw.json 中 agents.defaults.model.primary"model": { "primary": "zai/glm-5.1", "fallbacks": ["zai/glm-4.7"]}# 重启 Gatewaylaunchctl bootout gui/$(id -u) ~/Library/LaunchAgents/ai.openclaw.gateway.plistlaunchctl bootstrap gui/$(id -u) ~/Library/LaunchAgents/ai.openclaw.gateway.plist验证一下:

curl https://open.bigmodel.cn/api/coding/paas/v4/chat/completions \ -H "Authorization: Bearer <你的API Key>" \ -H "Content-Type: application/json" \ -d '{"model":"glm-5.1","messages":[{"role":"user","content":"你好"}]}'

避坑指南

总结几条经验,希望大家不要再踩:

1不要手动编辑 baseUrl

智谱 Coding Plan 有专用端点,不要照着普通 API 文档手动填 /api/paas/v4/,一定要用 onboard 的 zai-coding-cn 模式自动配置。

2不要用普通 API Key 模式初始化

如果你有 Coding Plan 套餐,初始化时认准这个参数:

--auth-choice zai-coding-cn而不是:

--auth-choice zai-api-key3遇到 429 先测端点

如果模型报 429 余额不足,先检查 baseUrl 是否包含 /coding/ 路径。可以用 curl 直接测试,排除 OpenClaw 的问题。

4官方文档可能不够全面

官方文档给了手动配置的参考,但没有强调 Coding Plan 和普通 API 的端点差异。如果照着文档配了还是有问题,看看 openclaw onboard --help,可能有更适合你场景的配置模式。

写在最后

这个问题说到底就是一个端点路径的差异,但排查起来真的挺绕的——因为配置看起来和官方文档完全一致,API Key 也没问题,套餐也在有效期,所有表象都指向"应该能用"。

最终发现 onboard 命令本身藏着答案:它早就内置了 Coding Plan 的专用配置模式,只是这个选项不那么显眼。

觉得有用?分享给更多开发者

如果你也在配置 OpenClaw 或智谱 AI 时遇到问题

欢迎在评论区分享你的踩坑经历

点赞 · 在看 · 转发

本文为原创技术文章,转载请注明出处

夜雨聆风

夜雨聆风