中国执业律师正从70万向100万激增,但企业法务预算却在收缩。一边是供给过剩,一边是需求萎缩——法律行业正在经历前所未有的效率倒逼。

与此同时,OpenClaw(龙虾)等开源AI代理工具正在快速渗透法律场景。大厂也在加速,阿里"悟空"已经推出了覆盖争议焦点分析、立案检索、证据分析、律师函撰写的法律垂直技能包。

当AI工具加速成熟,律师如何借助这些"超级助手"释放更多精力,聚焦真正需要专业判断的高价值工作?

3月28日,思行AI第五期线下分享会在华东师范大学上海人工智能金融产业研究院举办,三位深耕法律+AI领域的创业者——王杰文律师、谈舒杰、徐诗楠,与十余位来自投资、设计、工程、学术等领域的嘉宾,围绕"法律行业AI代理应用与挑战"展开了一场超过两小时的深度讨论。

PART

01

龙虾来了,谁在拥抱?

法律行业三类群体的真实反应

王杰文律师的分享从一个犀利的观察切入:面对OpenClaw这只"龙虾",法律行业的三类群体表现截然不同。

法律AI公司两极分化。多数公司选择抵制,担心用户流失到开源工具;少数已经意识到大厂垂直下压的趋势,开始尝试将自己的能力原子化,嵌入更大的生态链。王杰文在法律AI社群的一次龙虾活动中问同仁们开始养虾了吗,结果令人意外——没有一个执业律师真正用过OpenClaw。律师群体的风险厌恶属性太强,对新技术普遍持观望态度。

反倒是企业法务最直接。他们的需求简单粗暴:"十万年薪换你做个系统审合同,我不再雇外所。"这些法务部门手里积累了大量合同模板和语料,只差一个AI来激活这些资产的价值。

更值得关注的是大厂的动作。阿里"悟空"已经把资深律师的经验封装成了可调用的Skill模块——争议焦点分析、立案检索报告、证据分析、律师函撰写、模拟裁判报告,甚至支持通过钉钉语音转写生成谈案笔录。技术逻辑很清晰:将资深律师的经验沉淀为可复用的Token和Skill,帮助更多律师快速调用行业最佳实践。

王杰文律师在现场还分享了一个小技巧——如何学习Skill资源,引发了全场浓厚的兴趣。用他的话说——

"你以为你在用AI,其实你的前同事都在里面打工。"

龙虾的真正意义不是发明新东西,而是像iPhone一样,把已有技术用全新方式组合,让非技术人员也能使用复杂功能。国家级法律数据库"法信"已经接入腾讯IMA,未来将通过OpenClaw触达普通公众。当每个人都能连上法院的知识库,很多因认知偏差导致的"不公感"——比如诉讼时效误解——就有机会被消解。

PART

02

别让用户反复解释自己在干什么

Agent产品设计的环境感知哲学

谈舒杰的视角从产品设计切入,他先分享了一个律师使用AI的真实工作流:收集优质判例→上传到Notebook LM做总结→把结果喂给Gemini执行进一步任务。问题在于,每一步都需要手动迁移数据、切换平台,用户不断在重复告诉AI"我在做什么"。

他提出了一个核心概念:环境感知,分为显性环境和隐性环境两层。

显性环境是用户可见的——文件系统、当前文档、Agent交互区。隐性环境是系统应该自动感知的——当前正在编辑哪个文档、最近修改了什么、文本选中的区域(这反映了用户的注意力焦点)。如果Agent能融合这两类信息,用户就不用反复解释上下文。

但感知也有边界。过度感知会引入噪声——比如你修改了一个无关文档,Agent却把它纳入了当前任务的判断依据,结果反而出错。设计的关键在于平衡:既不能"被忽略",也不能"被干扰"。

在信任构建方面,谈舒杰提出了EIOC模型:

可解释性(Explainability):法条和判例来源可追溯,能显示原文及有效性

可理解性(Interpretability):用Diff模式展示修改内容,用户决定接受或拒绝

可观测性(Observability):主动提问模糊需求,补全关键信息

可控性(Controllability):Fail-fast机制拦截错误输出,防止污染原始文档

这套框架的底层逻辑是:AI时代律师的核心能力正在从"起草者"(Drafter)转向"定义者"(Definer)。提出精准问题、做战略性调整、进行批判性监督——这些才是人类不可替代的价值。

他还指出了一个悖论:Skill开放对普通律师来说门槛过高,本质上是把产品经理的工作转嫁给了用户。真正合理的做法是,合同审查、尽职调查这类标准化流程应该内建为默认功能,而律师个人积累的独特案例和见解,才应该成为他们的"品味"护城河。

"真正的专业壁垒,是你独有的'品味',而不是你会写的合同类型。"

PART

03

从Prompt到Architecture

Agent的下半场不是调参,是造操作系统

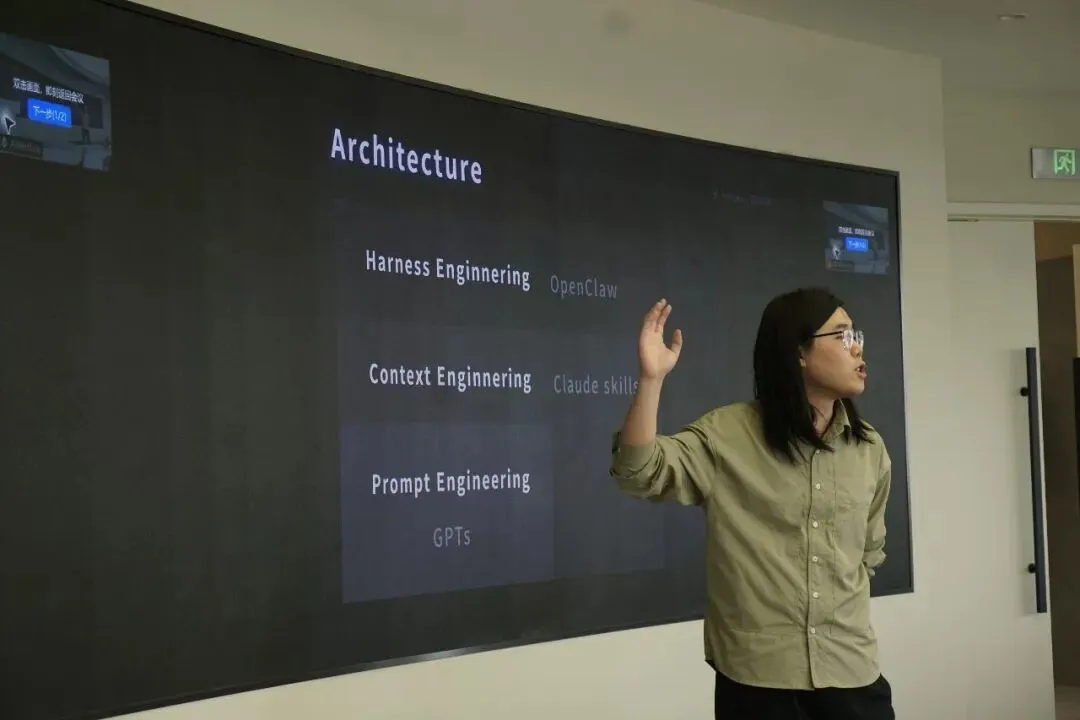

徐诗楠的分享将讨论拉到了更底层的架构视角。他先梳理了Agent技术的演进脉络:

Prompt Engineering(2022–2023):以GPTs为代表,已基本退出舞台

Context Engineering(2024–2025):强调上下文管理能力

Harness Engineering(2026起):用外部机制增强Agent鲁棒性

Harness Engineering是什么意思?简单说,就是不再指望模型本身完美,而是用外部架构来"兜底"。比如用Observer监控Master Agent的失败并注入上下文重启。不是调参数,是造操作系统。

他以自己的产品Quote为例,展示了几个技术实现亮点:

目的式披露(Purpose-driven Disclosure)是其中最值得关注的设计。传统做法是把91页法律文档全部加载进上下文,这不仅浪费Token,频繁Compact还会导致关键信息丢失。Quote的做法是先识别用户意图——比如"查找法院批准条款"——然后只提取相关内容。不是给AI所有信息,而是给它需要的信息。

另一个亮点是Sub-agent分工体系:Master Agent只持有精简上下文做决策,Draft/Edit等Sub-agent按需访问完整原文执行操作,实现"短记忆控制 + 长记忆执行"的分离。

在此基础上,徐诗楠提出了Agent下半场的三大命题:

第一,Long Horizon Tasks(长程任务)。当前Agent擅长单轮响应,但法律工作中大量任务是跨步骤、长时间的——从立案准备到证据整理到诉状起草到模拟答辩。解决方案是引入外部终止条件和上下文回注机制,支持中断后恢复。

第二,Universal Environment(统一环境)。理想状态是打通电脑、手机、微信、数据库甚至物理世界。但实际策略更务实:先在垂直场景内实现环境闭环——整合本地文件、云端判例库、客户沟通记录。这样做还有一个好处:天然保障了数据隐私隔离。

第三,Evaluation Framework(评估体系)缺失。代码领域有SWEBench,基于真实GitHub Issue加代码仓库快照加Patch测试。但法律领域缺乏公开案件数据集、缺少多轮交互评估标准、缺乏长程文书生成的Benchmark。徐诗楠透露,他们已经启动了"The Law Bench"项目,要为法律AI构建专用评估基准。

"不要迷信某个词有多火,要看它背后的架构有没有生命力。"

PART

04

人的判断力,才是最后的壁垒

圆桌讨论中的共识与洞察

三场分享之后,讨论进入了更深入的地带。

AI能处理复杂的现实博弈吗?有人分享了一个真实案例:某投资纠纷案中,律师从海量材料中捕捉到一条关键聊天记录,成功逆转了案件定性,为当事人挽回了重大损失。这种"临场判断"——在海量信息中找到那个改变局面的关键线索——恰恰是律师不可替代的价值所在,也正是AI工具应该帮助律师更高效地做到的事情。

讨论中形成的共识是:AI最大的价值不是替代律师的判断,而是把律师从繁琐的信息整理和流程事务中解放出来,让他们有更多精力聚焦在真正需要专业洞察的高价值工作上。当前受益的是主动拥抱变化的律师(Mid-to-Senior Level)——他们既有独立判断能力,又能借助AI放大杠杆。初级律师和小微企业主是潜在的C端用户,但产品形态需要大幅简化,做到"一句话下达任务,自动完成全流程"。

如何沉淀专家的Know-How?这个问题的讨论产生了一个精彩的方法论——"用魔法打败魔法":不要逼专家写文档,而是让专家先用通用AI完成任务,再用Agent将其过程总结为Skill。让专家"表演",系统来学习。另一条路径是通过用户行为数据——接受或拒绝AI的修改建议、后续的调整动作——反向提炼有效模式。

至于护城河在哪里,讨论的结论是:即便所有人调用的是同一个大模型,壁垒仍然存在。行业知识建模能力、多Agent协作架构设计、私有数据闭环积累、用户行为反馈迭代——这些构成了法律AI产品的真正差异化。

用一位嘉宾的原话说:"你调用的是同一个模型,但跑的是完全不同的操作系统。"

写在最后

这场讨论揭示了法律AI发展的三层演进逻辑:工具层,从Prompt到Skill,提升操作效率;体验层,通过环境感知与信任机制,降低使用门槛;架构层,构建长程、统一、可评估的Agent系统,迈向自主服务。

贯穿始终的一个共识是:AI不会取代律师,但善用AI的律师将获得前所未有的竞争优势。未来的赢家是那些懂得借助AI释放效率、同时持续深耕自己独有判断力和行业洞察的人。

或者,用王杰文律师那句话说——“老兵不死,而是开始定义Meta-Architect,Skills 和 Gold Standard”。

本次活动由华东师范大学上海人工智能金融产业研究院提供场地支持

感谢邵院长与汤院长的大力协助

思行AI(ThinksAct)是一个邀请制的AI实践社群

我们不讨论AI能做什么,只讨论用户真正需要什么

Think Deep. Act Real.

夜雨聆风

夜雨聆风