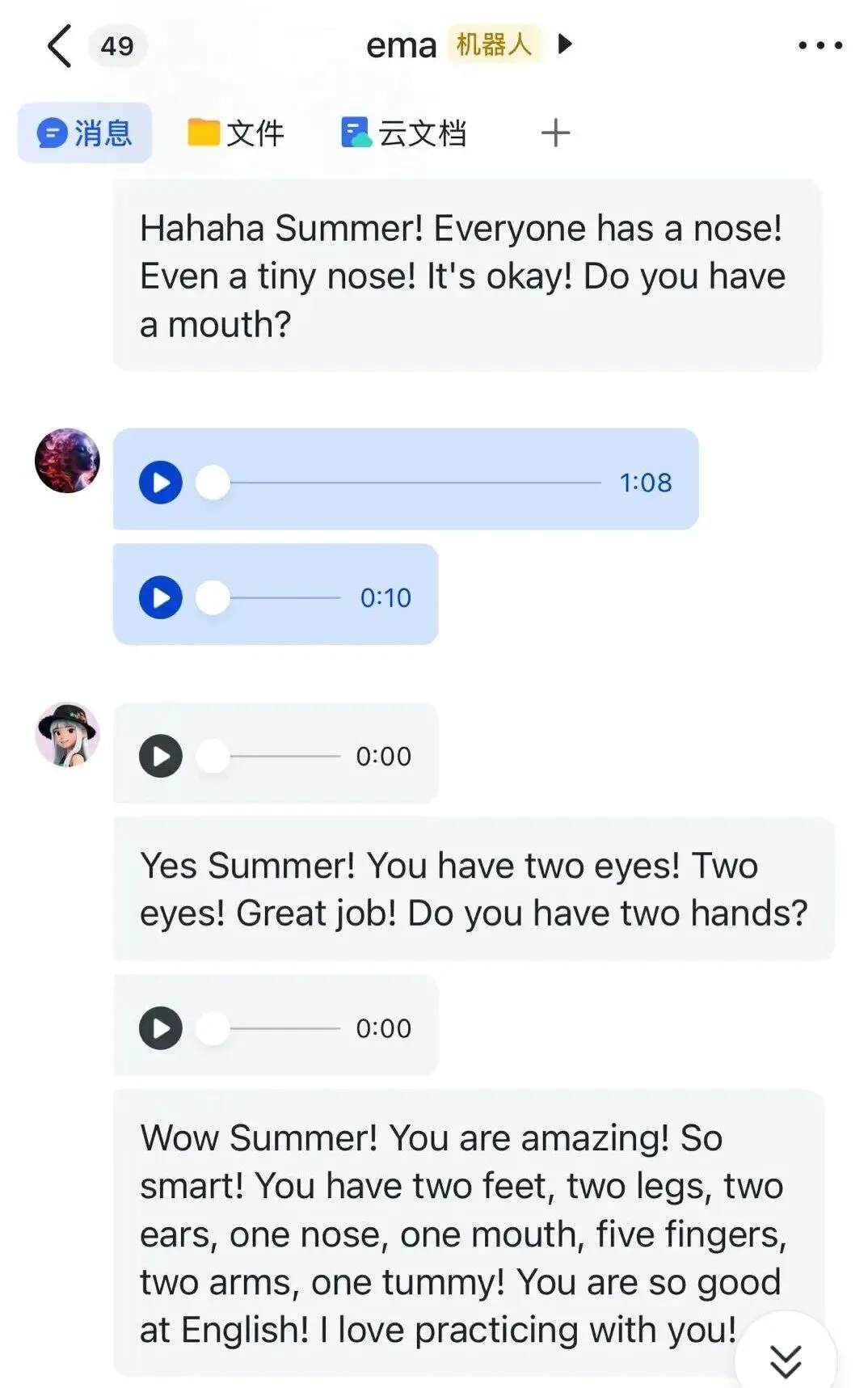

市面上很多 AI 英语陪练,但没找到那种能在孩子掌握的范围里对话的陪练AI,聊不了几句就会因为听不懂没兴趣了。openclaw 出来后就想着用它做个英语陪练 agent,这事儿听起来很美好—— 可定时主动发起对话、还能个性化定制。但真正做下来,我发现中间的坑比想象中的多。这篇文章把我实际踩过的坑、走过的弯路总结出来,帮你少跳几个。

一、选模型:选对模型,可以少费很多“口舌”

创建Agent 这事儿,模型选错了就像开车选错了路——越努力越离谱。

国内的模型我测试过三个:

Kimi 2.5:问题理解还不错,但给的解决方案幻觉问题严重,还需要很多手工介入,甚至需要用别的模型交叉验证。

千问 3.5:不太适合做复杂及涉及到编码的任务,有时一些要求回复完成了,但实际完全没执行。

Minimax 2.7:任务完成度最高,能理解我的意图并自主执行,遇到问题还能自己调试验证。

Minimax 2.7 现在是我在 openclaw 主力用的国内模型了。

二、一个 agent 里干太多事,回复混乱怎么办?

一开始我把所有功能都塞进一个 Agent,结果对话一多,它就开始"失忆",要么就是陪练着陪练着突然不按设定回复。

所以要给英语陪练建立独立的 Agent 和独立的飞书机器人。

这样做有两个好处:

1. 独立记忆空间,不受主 Agent 影响2. 独立对话通道,不用 @ 就能语音对话

三、调教 agent,正向要求行不通时,换个思路

这是踩坑最密集的部分。

在设置回复语音消息时,一开始我反复告诉它:"回复的时候发语音消息,不要发 mp3 文件"

结果:Agent 坚持自己没发 mp3,还越调越乱,最后连语音都不发了。

后来我换了个思路,问它:"你查一下是哪个环节发出 mp3 文件的?"

结果:它开始认真排查,对比测试,最终找到了问题——是 TTS 转换环节的问题,换了方案,成功了。

这适用于调试任何 agent 的情况,当你反复陈述需求但 Agent 始终做不到时,不要重复要求,换成让它自己排查问题。AI 在"解决问题"模式下比"执行指令"模式下表现好得多。

四、调试好的功能,第二天可能又没了

调好的语音回复,第二天对话发现又变回文字了。稳定的流程最好是让 Agent 创建一个 Skill 来稳定执行,而不是靠"记忆"。实测设定 skill后,agent 回复语音消息的发挥更稳定了

如果你想看完整的一步步安装部署调试的教程,关注公众号后回复「英语陪练」,我把完整的操作手册发给你。

包括: openclaw云端部署、多 Agent 飞书机器人配置、让 agent 回复语音消息、词汇范围设置,全部有截图和详细步骤。

夜雨聆风

夜雨聆风